Strumenti di progettazione tempestiva per la produttività: la guida completa per il 2026

⏱ Lettura di 25 minuti · Categoria: Strumenti AI

La Prompt Engineering è passata dall’abilità sperimentale alla competenza aziendale principale. Nel 2026, il 75% delle aziende che utilizzano l’intelligenza artificiale generativa considererà la gestione tempestiva come un’infrastruttura di produzione critica, importante quanto il controllo della versione del codice o la gestione dei database.

Il divario qualitativo tra un messaggio scritto male e uno ben progettato non corrisponde a un risultato migliore del 10%. È un risultato 3-5 volte migliore allo stesso costo. I team che investono in strumenti e pratiche di ingegneria tempestiva ottengono un valore notevolmente maggiore dagli stessi abbonamenti all’intelligenza artificiale.

Questa guida illustra i migliori strumenti di ingegneria dei prompt per la produttività nel 2026: dai singoli strumenti che ti aiutano a scrivere prompt migliori, alle piattaforme aziendali che gestiscono, versionizzano e valutano i prompt su larga scala.

Sommario

- Perché gli strumenti di ingegneria rapida sono importanti

- Categoria 1: gestione dei prompt e controllo delle versioni

- Categoria 2: test e valutazione rapidi

- Categoria 3: modelli di prompt e librerie

- Categoria 4: Costruttori di suggerimenti visivi

- Categoria 5: Campi da gioco e test LLM

- Categoria 6: Ingegneria rapida per sviluppatori

- Best practice di ingegneria tempestiva per la produttività

- Tecniche di suggerimento avanzate che funzionano nel 2026

- Tabella di confronto

- Costruire un flusso di lavoro di ingegneria rapida per il team

- Domande frequenti

Perché gli strumenti di ingegneria rapida sono importanti

Un messaggio non è semplicemente un testo digitato per un’intelligenza artificiale. È l’interfaccia principale tra il tuo intento e l’output del modello. La differenza tra un prompt ben strutturato e una richiesta casuale può significare:

- Miglioramento di 3-5 volte nella qualità e nella pertinenza dell’output

- Riduzione del 50–80% del tempo di editing

- Risultati coerenti e ripetibili tra i membri del team

- Riduzione significativa dei costi grazie all’uso efficiente dei token

Senza strumenti di ingegneria tempestiva, la maggior parte dei team sperimenta:

- “Lotteria AI” — risultati incoerenti dagli stessi tipi di richieste

- Silos di conoscenza: i suggerimenti migliori risiedono nella testa di una persona o sparsi nella cronologia della chat

- Nessuna misurazione: non c’è modo di sapere se le modifiche tempestive abbiano effettivamente migliorato i risultati

Gli strumenti di prompt engineering risolvono questi problemi trattando i prompt come risorse gestite: controllate dalla versione, testabili, misurabili e condivisibili.

Conclusione fondamentale: gli strumenti di Prompt Engineering stanno all’intelligenza artificiale come gli IDE stanno alla programmazione: non cambiano ciò che è fondamentalmente possibile, ma aumentano notevolmente l’efficienza e l’affidabilità con cui lo si ottiene.

Categoria 1: gestione dei prompt e controllo delle versioni

Questi strumenti trattano i prompt come codice: controllato dalla versione, collaborativo e riconducibile a output specifici.

PromptLayer: la migliore piattaforma di osservabilità rapida

PromptLayer è la piattaforma LLMOps leader per i team che desiderano una visibilità completa sul rendimento dei propri prompt in produzione. Registra ogni richiesta e risposta API, tiene traccia di quale versione del prompt ha prodotto quale output e consente test A/B tra le varianti del prompt.

Funzionalità principali:

- Registrazione delle richieste: ogni richiesta, risposta, versione del modello e latenza vengono monitorate automaticamente

- Versione richiesta: tagga le versioni dei prompt, confronta le prestazioni, ripristina quando la qualità diminuisce

- Collaborazione in team: condividi suggerimenti tra i team, lascia commenti e tieni traccia di chi ha cambiato cosa

- Analisi: identifica quali prompt presentano i costi token più elevati, la latenza peggiore o il maggior numero di errori

dall'importazione di promptlayer openai risposta = openai.ChatCompletion.create( modello="gpt-5", messaggi=[{"role": "utente", "content": "Scrivi una descrizione del prodotto..."}], pl_tags=["descrizioni-prodotto", "v2"] )

- Prezzi: gratuito per i privati; Teams $ 20/utente/mese

- Ideale per: team di sviluppo che spediscono prodotti basati su LLM

Langfuse: la migliore gestione dei prompt open source

Langfuse è una piattaforma di osservabilità e gestione tempestiva LLM completamente open source. Langfuse self-hosted fornisce le stesse funzionalità principali di PromptLayer a costo zero: tracciamento, controllo delle versioni tempestivo, valutazione e collaborazione in team.

L’API di gestione dei prompt Langfuse ti consente di aggiornare i prompt in produzione senza distribuire nuovo codice, un aspetto fondamentale per i team che eseguono iterazioni sulla qualità dei prompt senza un ciclo di rilascio completo.

- Prezzi: gratuito (hosting autonomo); Cloud da $ 49 al mese

- Ideale per: team di sviluppatori che desiderano il pieno controllo sull’infrastruttura tempestiva a costi minimi

Microsoft PromptFlow (Azure): il migliore per le aziende

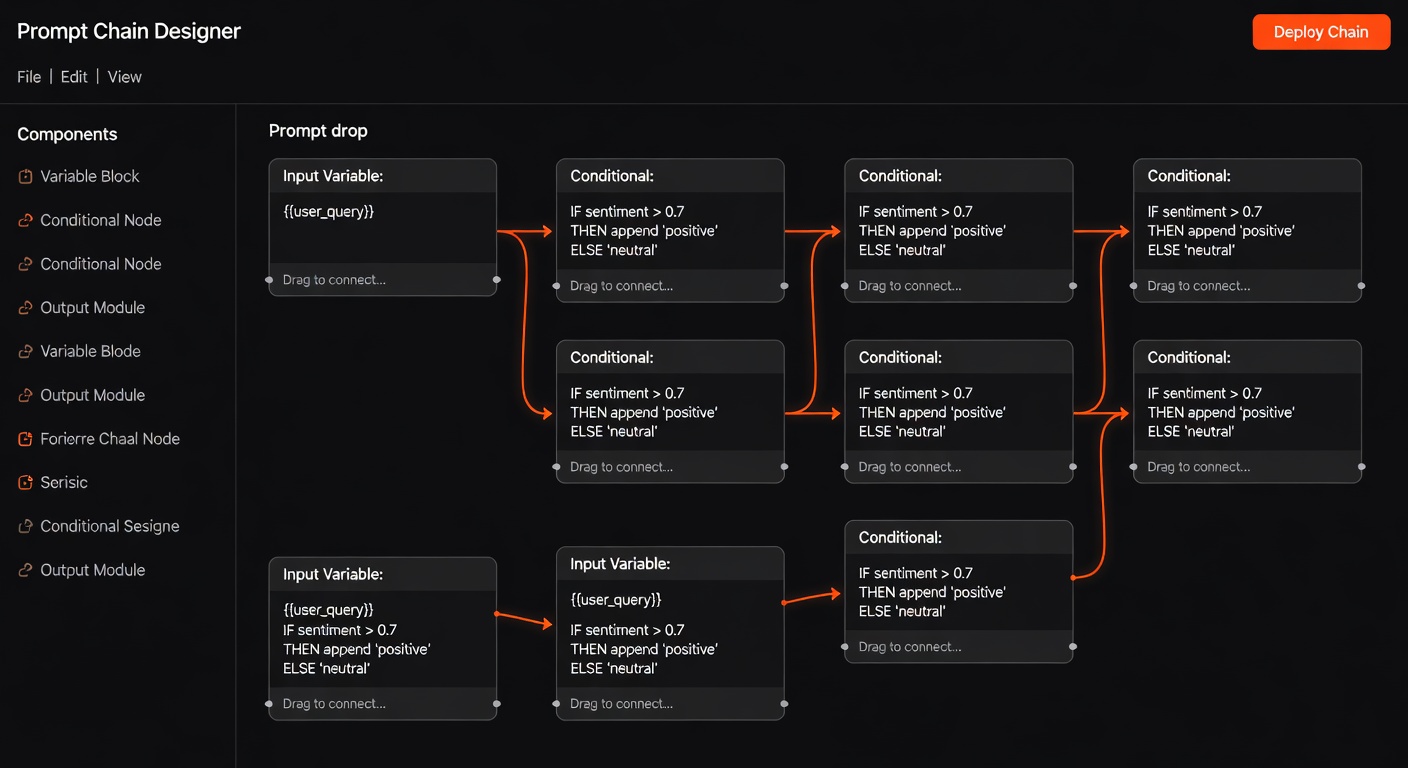

PromptFlow è lo strumento Microsoft gratuito, open source e low-code per lo sviluppo di applicazioni LLM. Fornisce concatenamento di prompt basati sul flusso, pipeline di valutazione e distribuzione in Azure, rendendolo la scelta naturale per le aziende già presenti nell’ecosistema Microsoft.

Il generatore di flusso visivo consente ai product manager e ai non ingegneri di partecipare alla progettazione tempestiva insieme agli sviluppatori, riducendo il collo di bottiglia sulle risorse di progettazione.

- Prezzi: gratuito (open source); Opzioni ospitate su Azure disponibili

- Ideale per: team aziendali su Azure; gestione del flusso di lavoro con prompt in più fasi

Categoria 2: test e valutazione rapidi

La qualità immediata senza misurazione è solo una supposizione. Questi strumenti apportano rigore per promuovere il miglioramento.

Braintrust: la migliore piattaforma di valutazione tempestiva

Braintrust è una piattaforma di valutazione dell’intelligenza artificiale appositamente creata. Ti consente di definire criteri di valutazione (utilizzando valutatori AI, valutatori umani o codice personalizzato), eseguire esperimenti su diverse versioni e modelli di prompt e monitorare quale combinazione produce i risultati migliori.

L’intuizione chiave che Braintrust consente: “La mia modifica tempestiva ha effettivamente migliorato l’output?” diventa una domanda a cui è possibile rispondere empiricamente con dati, piuttosto che un giudizio soggettivo.

- Prezzi: gratuito per uso individuale; Piani Teams disponibili

- Ideale per: team che puntano sulla qualità tempestiva e desiderano decisioni basate sui dati

Valutazioni (OpenAI): ideale per i primi team OpenAI

Il framework Evals di OpenAI è una libreria open source per la valutazione dei risultati LLM. Scrivi valutatori personalizzati per i tuoi criteri di qualità specifici, eseguili rispetto a batch di completamenti e confronta le prestazioni tra versioni di prompt o versioni di modelli.

- Prezzi: gratuito (open source)

- Ideale per: utenti OpenAI che desiderano una valutazione strutturata senza una piattaforma gestita

Valutazione LangSmith: ideale per gli utenti LangChain

Le funzionalità di valutazione di LangSmith ti consentono di creare set di dati di test, eseguire valutazioni automaticamente e confrontare le prestazioni tra le esecuzioni. Il livello gratuito è sufficiente per piccoli team e per la valutazione della fase di sviluppo.

- Prezzi: livello gratuito; Sviluppatore $ 39/mese; Più $ 299 al mese

- Ideale per: team che utilizzano LangChain e desiderano una valutazione integrata

Categoria 3: modelli di prompt e librerie

Invece di scrivere ogni volta prompt da zero, i team intelligenti creano librerie di prompt riutilizzabili.

PromptHub: comunità di condivisione dei prompt

PromptHub è una piattaforma della community per scoprire, condividere e valutare i suggerimenti. Trova suggerimenti di alta qualità per attività comuni (scrittura di contenuti, generazione di codice, servizio clienti, analisi dei dati), adattali al tuo caso d’uso e contribuisci con i tuoi.

- Prezzi: accesso gratuito alla community

- Ideale per: scoprire suggerimenti comprovati; costruendo la tua libreria iniziale

Fantastici prompt ChatGPT (GitHub): libreria di prompt gratuita

Uno dei repository più apprezzati su GitHub: una raccolta curata di istruzioni basate sui ruoli che migliorano notevolmente gli output per casi d’uso specifici. Agisci come uno specialista SEO, un avvocato, un consulente finanziario, un terminale Linux: ogni richiesta di ruolo viene testata sul campo da migliaia di utenti.

- Prezzi: gratuito (open source)

- Ideale per: creare una libreria iniziale di istruzioni basate sui ruoli

FlowGPT: piattaforma di rilevamento rapido

FlowGPT è una piattaforma della community specifica per i suggerimenti dell’intelligenza artificiale, con categorie per affari, scrittura creativa, programmazione, istruzione e altro ancora. I suggerimenti votati positivamente mostrano i contributi della community di altissima qualità.

- Prezzi: gratuito

- Ideale per: trovare suggerimenti per attività specifiche; feedback della community sui tuoi suggerimenti

Categoria 4: Costruttori di suggerimenti visivi

Per i non sviluppatori che desiderano progettare prompt sofisticati senza scriverli da zero.

Dust.tt: il miglior generatore di app Visual LLM

Dust fornisce un’interfaccia visiva per la creazione di applicazioni LLM: collega origini dati, definisci catene di prompt e distribuisci strumenti di intelligenza artificiale al tuo team, senza codice. Il componente di ingegneria dei prompt ti consente di progettare e testare visivamente i prompt prima di distribuirli.

- Prezzi: livello gratuito; Team a partire da $ 29 al mese

- Ideale per: team di prodotto che creano strumenti IA interni senza colli di bottiglia per gli sviluppatori

Dify: ideale per RAG e flussi di lavoro rapidi

Il generatore di flussi di lavoro di Dify include una sofisticata configurazione dei prompt: inserimento di variabili, logica condizionale e test A/B all’interno di un’interfaccia visiva. Per i team che creano applicazioni basate su RAG con catene di prompt complesse, Dify fornisce un ambiente visivo per gestire tale complessità.

- Prezzi: gratuito (hosting autonomo); Piani cloud disponibili

- Ideale per: team che creano applicazioni RAG con un’orchestrazione di prompt complessa

Flowise: il miglior costruttore di LangChain visivi

Flowise traduce le catene di prompt basate su codice di LangChain in un’interfaccia visiva drag-and-drop. Progetta visivamente catene di prompt, sistemi di memoria e agenti potenziati da strumenti, quindi testali immediatamente nell’interfaccia di chat integrata.

- Prezzi: gratuito (hosting autonomo)

- Ideale per: prototipazione visiva di architetture prompt LangChain

Categoria 5: Campi da gioco e test LLM

Prima di distribuire i prompt in produzione, è essenziale testarli in un parco giochi.

Console antropica (Claude) – Miglior parco giochi modello

La console Anthropic fornisce un ambiente di sviluppo sofisticato per costruire con Claude: configurazione dei prompt del sistema, controlli della temperatura e del campionamento e confronto fianco a fianco dei diversi prompt del sistema. Per i team che creano applicazioni basate su Claude, la console è il modo più rapido per eseguire iterazioni sulla progettazione tempestiva.

- Accesso: console.anthropic.com: account gratuito con crediti API

OpenAI Playground: l’ambiente di test LLM più utilizzato

OpenAI Playground rimane l’ambiente più utilizzato per testare i modelli GPT. Supporta la configurazione completa dei prompt del sistema, le definizioni delle funzioni e il confronto affiancato dei prompt. La modalità di output strutturati nel 2026 semplifica il test dei prompt che devono produrre output JSON coerenti.

- Accesso: platform.openai.com/playground — gratuito con account API

Google AI Studio (Gemini): i migliori test multimodali

Google AI Studio fornisce un ambiente di test gratuito per i modelli Gemini, con un forte supporto per istruzioni multimodali (testo + immagini + documenti). Le “Istruzioni di sistema” la funzionalità ti consente di progettare istruzioni di sistema persistenti che si applicano a tutta la conversazione.

- Accesso: aistudio.google.com — gratuito con un account Google

TypingMind: il miglior parco giochi multimodello

TypingMind fornisce un’interfaccia unificata per testare le richieste su più modelli (GPT-5, Claude, Gemini) con le tue chiavi API. Il confronto affiancato degli output del modello per lo stesso prompt semplifica l’identificazione del modello con le prestazioni migliori per il tuo caso d’uso specifico.

- Prezzi: $ 29 una tantum; $ 9/mese per la sincronizzazione cloud

- Ideale per: team che desiderano testare i suggerimenti su più modelli in un’unica interfaccia

Categoria 6: Prompt Engineering per sviluppatori

Strumenti incentrati sugli sviluppatori che integrano la gestione dei prompt nei flussi di lavoro esistenti.

LangChain PromptTemplate: ideale per gli sviluppatori Python

La classe PromptTemplate di LangChain è il modo standard per creare prompt parametrizzati e riutilizzabili in Python. Le variabili vengono inserite in fase di esecuzione, rendendo i prompt flessibili e testabili:

dall'importazione langchain PromptTemplate modello = PromptTemplate( input_variables=["prodotto", "pubblico", "tono"], template="Scrivi una descrizione del prodotto {tone} per {prodotto} indirizzata a {audience}." ) prompt = template.format(product="AI writing tool", audience="marketing manager", tone="professional")

Questo approccio rende i prompt cittadini di prima classe nella tua base di codice: testabili, controllati dalla versione con Git e riutilizzabili nella tua applicazione.

Kernel semantico (Microsoft): ideale per .NET/Enterprise

Il sistema di modelli di prompt del kernel semantico supporta prompt con parametri in Python, C# e Java. Il concetto di funzioni semantiche tratta i prompt come funzioni richiamabili con input e output, rendendoli gestibili quanto le funzioni di codice tradizionali.

Mirascope: la migliore libreria di prompt Python tipizzata

Mirascope è una libreria Python tipizzata che rende i prompt indipendenti dai tipi, compatibili con l’IDE e testabili. I prompt sono definiti come classi Python con input digitati, rendendo l’analisi statica, il completamento automatico e il test semplici.

da mirascope.core import openai, prompt_template @openai.call("gpt-5") @prompt_template("Consiglia un libro di {genere} per {pubblico}") def consiglia_libro(genere: str, pubblico: str): ... risultato = libro_raccomandato("fantascienza", "giovani adulti")

- Prezzi: gratuito (open source)

- Ideale per: sviluppatori Python che desiderano una gestione dei prompt digitata e testabile

Best practice di ingegneria tempestiva per la produttività

Gli strumenti sono validi tanto quanto le tecniche che li supportano. Ecco le pratiche che offrono i maggiori guadagni di produttività:

1. Suggerimenti basati sui ruoli

Assegnare un ruolo all’intelligenza artificiale prima di assegnare un compito migliora notevolmente la qualità e la coerenza dell’output:

Invece di: “Scrivi un post sul blog sugli strumenti di intelligenza artificiale”

Utilizza:“Sei uno scrittore tecnologico senior per una pubblicazione SaaS B2B con 10 anni di esperienza. Il tuo stile di scrittura è chiaro, diretto e basato sull’evidenza. Scrivi un post sul blog di 1.000 parole su …”

Il contesto del ruolo attiva modelli di conoscenza rilevanti nel modello e vincola lo stile di output in modo più efficace rispetto alle sole istruzioni esplicite.

2. Promuovere la catena di pensiero

Per compiti complessi, chiedere al modello di ragionare passo dopo passo prima di arrivare a una risposta migliora significativamente la precisione:

Aggiungi a qualsiasi richiesta complessa: “Pensa a questo passo dopo passo prima di dare la risposta finale.”

Oppure utilizza catene di ragionamento esplicite: “Per prima cosa, analizza il problema. Quindi, considera 2-3 approcci. Quindi, consiglia l’approccio migliore con la giustificazione.”

3. Fornire esempi (richiesta di pochi scatti)

Includi 2-3 esempi delle coppie input-output che desideri:

“Ecco alcuni esempi del formato che desidero:

Input: [esempio 1 input]

Output: [esempio 1 output]

Input: [esempio 2 input]

Output: [esempio 2 output]

Ora fai lo stesso per: [il tuo input effettivo]”

Il suggerimento in pochi scatti è una delle tecniche con il ROI più elevato: comunica l’intento in modo più preciso di qualsiasi quantità di istruzioni descrittive.

4. Specifiche di output strutturato

Per gli output AI che verranno elaborati a livello di codice, specificare il formato esatto:

“Restituisci la tua risposta come oggetto JSON con questi campi esatti:

{ "titolo": "stringa", "summary": "stringa (max 100 parole)", "tags": ["array", "of", "strings"], "fiducia": "alta|media|bassa" }

L’utilizzo della modalità output strutturati di OpenAI o della modalità JSON di Anthropic impone questo formato a livello API.

5. Istruzioni negative (cosa NON fare)

Dichiarare esplicitamente cosa evitare è spesso importante quanto dichiarare cosa fare:

“NON includere introduzioni generiche come ‘Nel mondo di oggi’’. NON utilizzare elenchi puntati. NON aggiungere una conclusione a meno che non aggiunga nuove informazioni.”

Le istruzioni negative sono particolarmente efficaci per i vincoli di stile e formato.

6. Regolazione della temperatura e dei parametri

Temperatura inferiore (0,0–0,3) per risultati concreti e coerenti (estrazione di dati, classificazione, generazione di codice). Temperatura più elevata (0,7–1,0) per risultati creativi e vari (brainstorming, scrittura creativa, generazione di idee).

La maggior parte dei casi d’uso legati alla produttività beneficiano di temperature più basse: la coerenza è più importante della varietà per le applicazioni aziendali.

Tecniche di suggerimento avanzate che funzionano nel 2026

Suggerimenti costituzionali

Definire le regole che l’IA deve seguire durante tutta la sua risposta: una “costituzione” incorporato nel prompt del sistema. Utile per la voce del marchio, i requisiti di conformità e i vincoli etici.

Esempio di aggiunta di richieste di sistema: “Devi sempre seguire queste regole: [1] Non fare mai previsioni finanziarie specifiche. [2] Citare sempre le fonti per le affermazioni fattuali. [3] Mantieni un tono professionale ma caloroso.”

Prompt potenziata per il recupero

Inserisci dinamicamente il contesto pertinente dalla tua knowledge base nei prompt in fase di runtime. Il prompt diventa: istruzioni di sistema + contesto recuperato + query utente. Questo modello migliora notevolmente l’accuratezza fattuale per domande specifiche del dominio senza alcuna messa a punto.

Perfezionamento ricorsivo

Utilizza l’intelligenza artificiale per migliorare l’output dell’intelligenza artificiale: genera prima una bozza, quindi chiedi al modello di criticarlo e migliorarlo. “Esamina il testo seguente e identifica 3 modi per migliorarlo: [testo]. Quindi riscrivilo incorporando questi miglioramenti.”

Questo modello produce costantemente output di qualità superiore rispetto alla generazione a passaggio singolo.

Generazione parallela + selezione

Genera più output contemporaneamente (tramite chiamate API parallele) e utilizza un secondo prompt per selezionare quello migliore. Particolarmente utile per attività creative in cui la varianza tra i risultati è elevata e uno di essi è probabilmente eccellente.

Tabella di confronto

| Strumento | Categoria | Ideale per | Prezzi |

|---|---|---|---|

| PromptLayer | Gestione | Richiesta di registrazione e controllo delle versioni | Gratuito/$ 20/utente/mese |

| Langfuse | Gestione | Operazioni prompt open source | Gratuito (ospitato autonomamente) |

| PromptFlow | Gestione | Gestione dei prompt aziendali di Azure | Gratuito (open source) |

| Braintrust | Valutazione | Miglioramento rapido basato sui dati | Individuo libero |

| LangSmith | Valutazione | Valutazione rapida di LangChain | Livello gratuito |

| Console antropica | Parco giochi | Claude richiede il test | Gratuito con API |

| Parco giochi OpenAI | Parco giochi | Test del prompt GPT | Gratuito con API |

| PromptHub | Libreria | Alla scoperta di suggerimenti comprovati | Gratuito |

| Dificare | Costruttore visivo | RAG + progettazione visiva del flusso di lavoro rapido | Gratuito (ospitato autonomamente) |

| Mirascopio | Sviluppatore | Gestione dei prompt Python digitati | Gratuito |