Strumenti di strategia AI per sviluppatori

Se sei uno sviluppatore che cerca di capire dove si inserisce l’intelligenza artificiale nel tuo flusso di lavoro, nella tua carriera o nella tua attività, l’enorme numero di strumenti e framework può sembrare paralizzante. Ogni settimana c’è un nuovo modello, un nuovo SDK, una nuova parola d’ordine. La vera sfida non è accedere all’intelligenza artificiale, ma sapere come utilizzarla strategicamente per costruire cose che contano e guadagnare denaro facendolo.

Questa guida elimina il rumore. Abbiamo esaminato e confrontato i principali strumenti di strategia IA per gli sviluppatori, coprendo tutto, dalle API dei modelli e i framework degli agenti ai builder senza codice e alle piattaforme di monitoraggio. Che tu stia creando prodotti basati sull’intelligenza artificiale, automatizzando i tuoi flussi di lavoro o posizionandoti come esperto di intelligenza artificiale, qui troverai gli strumenti e la strategia.

Che cosa significa “AI Strategy” Significa per gli sviluppatori?

Prima di approfondire gli strumenti, chiariamo cosa intendiamo per strategia AI in un contesto di sviluppatore.

La strategia basata sull’intelligenza artificiale non consiste semplicemente nello scegliere il modello più interessante o nel copiare un tutorial. Significa:

- Sapere quali funzionalità di intelligenza artificiale si applicano al tuo problema specifico

- Scegliere strumenti che bilanciano costi, velocità e qualità per il tuo caso d’uso

- Costruire sistemi scalabili, non esperimenti una tantum

- Comprendere come l’intelligenza artificiale si inserisce in un prodotto o modello di business più ampio

- Rimanere aggiornati senza inseguire ogni tendenza

Gli sviluppatori che trattano l’intelligenza artificiale in modo strategico sono quelli che stipulano contratti più remunerativi, spediscono i prodotti più velocemente e creano flussi di reddito passivo. Gli strumenti seguenti sono organizzati in base al ruolo che svolgono in una strategia pratica di intelligenza artificiale.

Categoria 1: API del modello Foundation

Il punto di partenza per qualsiasi strategia di intelligenza artificiale è l’accesso a un modello linguistico capace. Ecco come si confrontano i principali fornitori.

OpenAI (GPT-5, GPT-5.3 istantaneo, o3)

Ideale per: testo generico, generazione di codice, chiamata di funzioni, output strutturati

L’attuale fiore all’occhiello di OpenAI è GPT-5: un passo avanti significativo rispetto a GPT-4o, con prestazioni all’avanguardia in attività di codifica, matematica e multimodali e circa l’80% in meno di allucinazioni rispetto a o3 quando è abilitato il pensiero. Per le attività quotidiane sensibili alla velocità, GPT-5.3 Instant è il modello predefinito. o3 e o3-pro rimangono il punto di riferimento per il ragionamento approfondito, commettendo il 20% di errori in meno rispetto a o1 nelle attività complesse del mondo reale. La variante GPT-5.3-Codex è il modello di codifica ad agenti più capace oggi disponibile.

- Prezzi: i prezzi di GPT-5 variano in base al livello; GPT-5.3 Instant è il modello quotidiano a costi ottimizzati

- Punti di forza: Affidabilità, vasto ecosistema, richiamo di strumenti/funzioni, codifica ad agenti con Codex

- Punti deboli: il rapido controllo delle versioni rende difficile definire un modello stabile a lungo termine

- Adattamento strategico: ideale per le app di produzione che richiedono la massima affidabilità e un’ampia capacità

Antropico (Claude Opus 4.6, Sonetto 4.6, Haiku 4.5)

Ideale per: contesto lungo, ragionamento, applicazioni sensibili alla sicurezza, elaborazione di documenti

L’attuale formazione di Anthropic è guidata da Claude Opus 4.6 (rilasciato a febbraio 2026), che supera GPT-5.2 di circa 144 punti Elo su GDPval-AA e presenta una finestra di contesto dei token da 1 milione in beta. Claude Sonetto 4.6è la nuova impostazione predefinita per la maggior parte degli utenti, colmando in modo significativo il divario con Opus pur rimanendo altamente conveniente. Claude Haiku 4.5 rimane uno dei modelli più veloci ed economici disponibili ovunque. Tutti i modelli sono dotati di specifiche di utilizzo degli strumenti pulite e di un eccellente seguito delle istruzioni.

- Prezzo: Claude Haiku 4.5 a $ 0,25/1 milione di token di input è estremamente competitivo

- Punti di forza: contesto token da 1 milione (Opus), eccezionale analisi dei documenti, istruzioni dettagliate seguite

- Punti deboli: ecosistema di terze parti più piccolo rispetto a OpenAI

- Adattamento strategico: ideale per pipeline con numerosi documenti, sistemi RAG o flussi di lavoro complessi in più fasi

Google Gemini (3.1 Pro, 3.1 Flash Lite)

Ideale per: attività multimodali, integrazione di Google Workspace, elaborazione di volumi elevati

L’attuale fiore all’occhiello di Google è Gemini 3.1 Pro (rilasciato a febbraio 2026), con un forte ragionamento multimodale su testo, immagini, audio e video. Per i carichi di lavoro sensibili ai costi, Gemini 3.1 Flash Lite (rilasciato a marzo 2026) è straordinariamente potente: al prezzo di soli $ 0,25/1 milione di token di input, è 2,5 volte più veloce del suo predecessore e supera GPT-5 mini e Claude Haiku 4.5 su diversi benchmark, supportando una finestra di contesto dei token da 1 milione.

- Prezzi: Gemini 3.1 Flash Lite a 0,25 $/1 milione di input e 1,50 $/1 milione di token di output

- Punti di forza: ampia finestra di contesto, livello Flash Lite multimodale e ultraveloce, ecosistema Google

- Punti deboli: l’ecosistema API sta ancora recuperando terreno rispetto a OpenAI

- Adattamento strategico: eccellente per pipeline ricche di media, ad alta produttività o sensibili ai costi

Meta Llama 4 (tramite Groq, Together AI, Ollama)

Ideale per: applicazioni sensibili ai costi, distribuzione in sede, messa a punto

Llama 4 è l’attuale formazione open-weight di Meta. Llama 4 Scout (17 miliardi di parametri attivi, 16 esperti) si adatta a una singola GPU H100 e offre una finestra di contesto token da 10 milioni leader del settore. Llama 4 Maverick (17 miliardi di parametri attivi, 128 esperti) batte GPT-4o e Gemini 2.0 Flash sui principali benchmark pur rimanendo completamente open-weight. Entrambi sono nativamente multimodali. Eseguirli tramite Groq fornisce un’inferenza quasi istantanea; l’esecuzione locale tramite Ollama significa zero costi API.

- Prezzi: esecuzione gratuita in locale; Groq/Together I prezzi del cloud AI sono molto competitivi

- Punti di forza: pesi aperti, multimodale nativo, contesto 10M (Scout), completamente personalizzabile, zero perdite di dati

- Punti deboli: richiede che l’infrastruttura GPU si ospiti autonomamente su larga scala

- Adattamento strategico: ideale per applicazioni che mettono al primo posto la privacy, lavori ad alto volume in cui il costo è fondamentale e team che desiderano il controllo completo del modello

Categoria 2: Framework di agenti AI

Se una singola chiamata LLM è un martello, un framework di agenti AI è un kit di strumenti completo. Queste sono le piattaforme e le librerie che ti consentono di creare flussi di lavoro IA autonomi e in più fasi.

LangChain

Il framework open source più ampiamente adottato per la creazione di applicazioni LLM. LangChain fornisce astrazioni per catene, agenti, memoria e utilizzo degli strumenti. Si integra praticamente con tutti i principali modelli e database vettoriali.

- Lingua: Python e amp; JavaScript

- Ideale per: prototipazione rapida, apprendimento, pipeline RAG

- Attenzione a: complessità dell’astrazione; può diventare ingombrante nella produzione; frequenti cambi di rottura

- Uso strategico: utilizza LangChain per prototipare rapidamente; migra a un codice più leggero una volta che la tua architettura è chiara

GraficoLang

Costruito sulla base di LangChain, LangGraph aggiunge un modello di esecuzione basato su grafici per agenti complessi con cicli, ramificazioni e persistenza dello stato. È la soluzione ideale per i sistemi multi-agente di livello produttivo.

- Ideale per: flussi di lavoro multi-agente, sistemi human-in-the-loop, agenti con stato

- Perché è importante:La maggior parte dei prodotti di intelligenza artificiale reale necessitano di qualcosa di più di una catena lineare: necessitano di una logica di ramificazione e della capacità di tornare indietro

- Uso strategico: se il tuo agente ha bisogno di “pensare” attraverso più passaggi o collabora con altri agenti, LangGraph è il tuo framework

Generazione automatica (Microsoft)

AutoGen consente a più agenti IA di conversare tra loro per completare attività complesse. Un agente potrebbe scrivere codice; un altro lo recensisce; un terzo esegue i test. È particolarmente utile per gli assistenti di codifica e gli strumenti di ricerca.

- Ideale per: collaborazione tra più agenti, generazione e revisione automatizzate del codice

- Punti di forza: strumenti efficaci per i casi d’uso degli sviluppatori; bravo a scomporre compiti complessi

- Uso strategico: eccellente per strumenti o prodotti di sviluppo interni in cui la generazione di codice è il valore fondamentale

EquipaggioAI

CrewAI è un framework di livello superiore per sistemi multi-agente, con un’enfasi sugli agenti basati sui ruoli organizzati in “crew”. È più supponente di LangGraph e più veloce da eseguire.

- Ideale per: realizzare rapidamente prodotti; orchestrazione degli agenti non di facile utilizzo

- Punti di forza: Veloce nella realizzazione del prototipo; struttura del codice leggibile; comunità attiva

- Utilizzo strategico: da utilizzare quando vuoi spedire velocemente; considera LangGraph se hai bisogno di maggiore controllo

SDK AI Vercel

Per gli sviluppatori JavaScript/TypeScript che creano app web, Vercel AI SDK è il modo più semplice per trasmettere risposte, gestire chiamate a strumenti e integrare l’intelligenza artificiale in Next.js e altri framework frontend.

- Ideale per: sviluppatori di app Web; interfacce utente in streaming; Integrazione con Next.js

- Uso strategico: se il tuo prodotto ha un’interfaccia di chat o un’interfaccia utente basata sull’intelligenza artificiale, questa è l’opzione più ergonomica nell’ecosistema JS

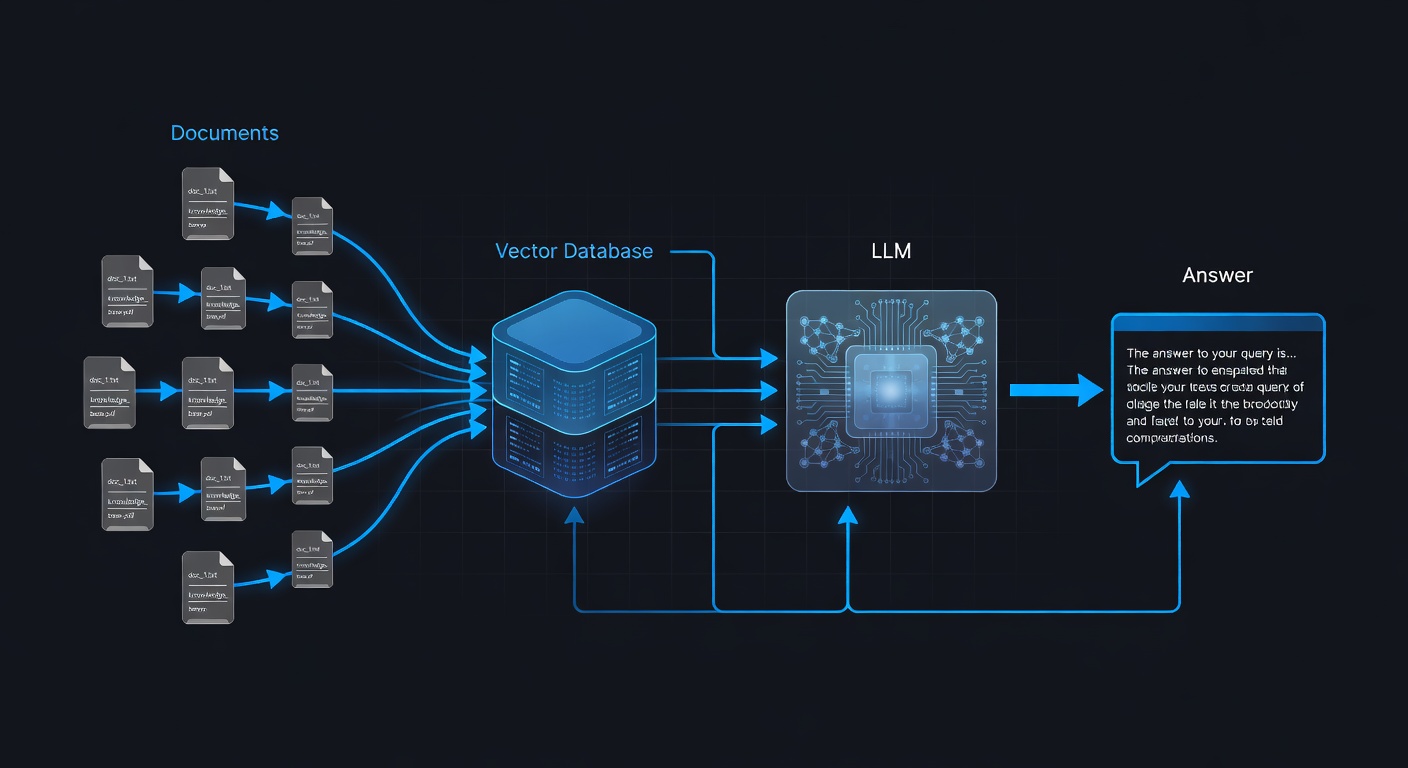

Categoria 3: database vettoriali e infrastruttura RAG

Retrieval-Augmented Generation (RAG) è l’architettura che consente all’intelligenza artificiale di rispondere alle domande in base ai tuoi dati. Un database vettoriale è la spina dorsale di qualsiasi sistema RAG.

Pigna

Il database vettoriale gestito più maturo. Pinecone gestisce l’indicizzazione, le query e il ridimensionamento senza richiedere la gestione dell’infrastruttura. Si integra perfettamente con LangChain, LlamaIndex e la maggior parte dei framework di agenti.

- Prezzi: livello gratuito disponibile; inizia a crescere a $ 70 al mese per la produzione

- Ideale per: sistemi RAG di produzione in cui non si desidera gestire l’infrastruttura

- Uso strategico: se stai creando un prodotto con RAG al centro, Pinecone ti consente di concentrarti sul livello dell’applicazione

Intreccia

Un database vettoriale open source con un’eccellente ricerca ibrida integrata (che combina la ricerca semantica e quella per parole chiave). Può essere ospitato autonomamente o utilizzato come servizio cloud gestito.

- Ideale per: ricerca ibrida, multi-tenancy, filtri complessi

- Uso strategico: buona scelta quando è necessaria la ricerca sia semantica che per parole chiave o quando è importante il self-hosting

Cromaticità

L’opzione più semplice per iniziare. Chroma è un database vettoriale leggero e open source che viene eseguito in memoria o persiste su disco. Ideale per lo sviluppo e la produzione su piccola scala.

- Ideale per: apprendimento, prototipazione, app su piccola scala

- Uso strategico: inizia qui; migra a Pinecone o Weaviate man mano che i tuoi dati crescono

Supabase pgvettore

Se sei già su Postgres (ad esempio tramite Supabase), pgvector ti offre la ricerca vettoriale senza aggiungere un altro servizio. Abbastanza buono per la maggior parte delle app che non hanno milioni di vettori.

- Ideale per: utenti Postgres esistenti; mantenendo lo stack semplice

- Uso strategico: se utilizzi Supabase o Postgres, questo è il percorso con il minor attrito verso RAG

Categoria 4: Osservabilità e valutazione dell’IA

Uno degli aspetti più trascurati della strategia di intelligenza artificiale è sapere se il tuo sistema funziona effettivamente. Gli strumenti di osservabilità ti aiutano a monitorare, eseguire il debug e migliorare i tuoi prodotti IA nel tempo.

LangSmith

Piattaforma di osservabilità di LangChain. LangSmith traccia ogni passaggio della catena o dell’agente, mostra l’utilizzo dei token, la latenza e gli errori e ti consente di eseguire valutazioni rispetto a set di dati di test.

- Ideale per: team che utilizzano LangChain/LangGraph

- Perché è importante: il debug di un agente a più passaggi senza tracciamento è un’ipotesi

- Uso strategico: essenziale se stai spedendo un prodotto basato su LangChain

Braintrust

Una piattaforma di valutazione indipendente dal modello. Braintrust ti consente di eseguire esperimenti, confrontare modelli e monitorare le prestazioni nel tempo utilizzando punteggi personalizzati e valutazioni basate sull’intelligenza artificiale.

- Ideale per: team che ripetono le istruzioni e confrontano i modelli

- Uso strategico: se sei seriamente interessato al prompt engineering e desideri che i dati supportino le tue decisioni

Elicone

Un livello di osservabilità basato su proxy che funziona con qualsiasi API compatibile con OpenAI. Aggiungi una riga di codice e ottieni la registrazione completa delle richieste, il monitoraggio dei costi, la memorizzazione nella cache e la limitazione della velocità.

- Ideale per: configurazione rapida; funziona con qualsiasi modello

- Utilizzo strategico: il modo più semplice per ottenere visibilità sull’utilizzo e sui costi dell’API senza modificare l’architettura

Categoria 5: costruttori di IA senza codice e a basso codice

Non tutte le parti della tua strategia di intelligenza artificiale richiedono la scrittura di codice. Questi strumenti ti consentono di creare e testare flussi di lavoro IA più velocemente.

n8n

Uno strumento di automazione del flusso di lavoro open source con supporto crescente dei nodi AI. Connetti modelli di intelligenza artificiale a database, API, piattaforme di messaggistica e altro ancora con uno strumento per la creazione di flussi di lavoro visivi.

- Ideale per: automatizzare i processi aziendali; integrare l’intelligenza artificiale con gli strumenti esistenti

- Uso strategico: eccellente per creare strumenti interni o automazioni client senza codice personalizzato

Fluente

Un builder LangChain visivo open source. Trascina e rilascia catene, agenti e componenti di memoria per prototipare applicazioni IA senza scrivere codice.

- Ideale per: prototipazione; non sviluppatori che comprendono i concetti di intelligenza artificiale

- Uso strategico: ottimo per testare rapidamente un’architettura prima di implementarla nel codice

Dificare

Uno strumento per la creazione di app AI più raffinato e incentrato sul prodotto. Dify supporta RAG, flussi di lavoro degli agenti e gestione dei modelli con un’interfaccia utente pulita. Può essere ospitato autonomamente o utilizzato come servizio cloud.

- Ideale per: creare rapidamente strumenti interni basati sull’intelligenza artificiale; team senza risorse ingegneristiche approfondite

- Utilizzo strategico: se stai creando prodotti per clienti non tecnici, Dify può ridurre drasticamente i tempi di sviluppo

Categoria 6: Produttività degli sviluppatori e strumenti di codifica AI

La tua produttività fa parte della tua strategia di intelligenza artificiale. Questi strumenti ti aiutano a costruire più velocemente.

Copilota GitHub

Ancora l’assistente di codifica AI più utilizzato. Copilot completa automaticamente il codice, spiega le funzioni, scrive test e si integra in VS Code, JetBrains e altri editor.

- Prezzi: $ 10/mese individuale; $ 19 al mese per affari

- Uso strategico: se non utilizzi un assistente di codifica AI, sei più lento della concorrenza

Cursore

Un fork VS Code con intelligenza artificiale profondamente integrata. Il cursore ti consente di chattare con la tua base di codice, applicare modifiche a più file e utilizzare modelli come Claude e GPT-4o direttamente nell’editor. Molti sviluppatori lo considerano un gradino sopra Copilot.

- Prezzi: $ 20 al mese per Pro

- Utilizzo strategico: se prendi sul serio lo sviluppo basato sull’intelligenza artificiale, la consapevolezza contestuale di Cursor è un moltiplicatore di produttività

Aiutante

Un assistente di codifica da riga di comando open source che funziona direttamente con il tuo repository Git. Aider invia differenze al modello e applica le modifiche automaticamente, utile per il refactoring automatizzato e le modifiche al codice tramite script.

- Ideale per: utenti esperti; refactoring automatizzato su larga scala; Integrazione CI/CD

- Uso strategico:Abbinalo a LLaMA su Ollama per uno sviluppo assistito dall’intelligenza artificiale a costo zero

Creare la tua strategia di intelligenza artificiale: un framework per sviluppatori

Con così tanti strumenti disponibili, la domanda non è “quali siano i migliori”; in astratto, è “quale combinazione serve ai miei obiettivi specifici”.

Ecco un quadro pratico:

Passaggio 1: Definisci il tuo obiettivo

Stai creando un prodotto, automatizzando un servizio o migliorando le competenze? Il tuo obiettivo determina la selezione dello strumento. Un libero professionista che automatizza i flussi di lavoro dei clienti ha bisogno di strumenti diversi rispetto a uno sviluppatore che crea un prodotto SaaS.

Passaggio 2: inizia in modo semplice

Non costruire eccessivamente. Una singola chiamata API OpenAI e un buon prompt possono risolvere un numero sorprendente di problemi. Raggiungi framework e database quando il tuo caso d’uso li richiede realmente.

Passaggio 3: misura tutto

Senza osservabilità, voli alla cieca. Aggiungi LangSmith, Helicone o Braintrust fin dal primo giorno. Conosci i costi dei token, la latenza e i tassi di fallimento.

Passaggio 4: iterazione dei prompt prima dell’architettura

La maggior parte dei problemi di qualità dell’intelligenza artificiale sono problemi immediati. Prima di eseguire il refactoring della tua architettura, investi in un’ingegneria tempestiva. Piccole modifiche tempestive possono raddoppiare la qualità senza costi aggiuntivi.

Passaggio 5: monetizza in anticipo

La migliore strategia di intelligenza artificiale prevede un percorso verso le entrate. Che tu stia offrendo un servizio di intelligenza artificiale ai clienti, costruendo uno strumento prodotto o creando contenuti incentrati sulla tua esperienza nel campo dell’intelligenza artificiale, inizia a pensare alla monetizzazione fin dalla prima settimana. La pagina pilastro Come guadagnare con l’intelligenza artificiale su learnAI tratta questo argomento in modo approfondito.

Passaggio 6: resta modulare

Il panorama dell’IA cambia mensilmente. Costruisci il tuo sistema in modo da poter scambiare modelli e fornitori senza riscrivere la tua logica di base. Ciò significa utilizzare astrazioni (come l’interfaccia del modello di LangChain) e non codificare mai il codice specifico del provider nella logica aziendale.

Tabella riepilogativa comparativa

Modelli di strategia AI nel mondo reale per sviluppatori

Comprendere gli strumenti è una cosa, sapere come si combinano nella pratica è un’altra. Ecco tre modelli che gli sviluppatori esperti utilizzano regolarmente.

Il modello di prodotto RAG

Costruisci una base di conoscenza dai documenti di un cliente (PDF, wiki, database), suddividili in blocchi e incorporali in un archivio vettoriale (Chroma per la prototipazione, Pinecone per la produzione) e offri un’interfaccia di chat basata su Claude o GPT-4o. Questo modello da solo alimenta dozzine di prodotti IA redditizi, dai robot di assistenza clienti agli assistenti interni alla conoscenza. Stack: Claude + Pinecone + LangChain + Vercel AI SDK.

Il modello dell’agenzia di automazione

Utilizza n8n o Make.com per collegare le chiamate ai modelli AI con gli strumenti esistenti del cliente (CRM, email, Slack, fogli di calcolo). Lo sviluppatore scrive una logica di prompt leggera e collega i tubi. Il cliente ottiene flussi di lavoro automatizzati; ottieni un acconto ricorrente. Questo è uno dei percorsi più rapidi per ottenere entrate per gli sviluppatori esperti di intelligenza artificiale. Stack: n8n + API OpenAI + strumenti esistenti del cliente.

Il modello SaaS potenziato dall’intelligenza artificiale

Prendi una categoria esistente di SaaS (gestione di progetti, strumenti di scrittura, CRM) e aggiungi un livello di intelligenza artificiale che rende il prodotto notevolmente più utile. Non stai competendo sulle funzionalità: stai competendo sull’intelligenza. Utilizza Cursor per creare velocemente, LangGraph per la logica dell’agente e LangSmith per monitorare la qualità. Stack: Cursore + LangGraph + LangSmith + qualsiasi modello di base.

Domande frequenti

Devo scegliere un modello di fondazione e mantenerlo?

Niente affatto. La maggior parte dei sistemi di intelligenza artificiale maturi utilizza più modelli in modo strategico: un modello più economico e veloce per compiti semplici e un modello più capace per ragionamenti complessi. L’astrazione delle chiamate del modello tramite un’interfaccia unificata semplifica la gestione.

Vale ancora la pena imparare LangChain nel 2026?

Sì, ma con sfumature. LangChain è utile per apprendere concetti e costruire rapidamente. Per i sistemi di produzione, molti sviluppatori migrano verso implementazioni più snelle o LangGraph per l’orchestrazione degli agenti. Comprendere LangChain ti aiuta a comprendere l’ecosistema.

Come posso tenere sotto controllo i costi delle mie API AI?

Utilizza l’osservabilità fin dal primo giorno (Helicone è il più semplice da aggiungere). Memorizza nella cache richieste identiche o quasi identiche. Utilizzare modelli più piccoli ed economici per attività di routine e riservare modelli costosi per ragionamenti veramente complessi. Aggiungi la limitazione della velocità per evitare costi fuori controllo.

Devo ospitare autonomamente i modelli o utilizzare le API?

Per la maggior parte degli sviluppatori, le API gestite rappresentano il giusto punto di partenza: costi operativi inferiori, nessun costo per la GPU e iterazione più rapida. Il self-hosting è utile quando si hanno volumi elevati (per ridurre i costi per chiamata), requisiti rigorosi sulla privacy dei dati o è necessario ottimizzare i dati proprietari.

Conclusione

La strategia di intelligenza artificiale per gli sviluppatori non consiste nel disporre del maggior numero possibile di strumenti, ma nello scegliere quelli giusti, combinarli in modo intelligente e fornire elementi che creino valore reale. Gli sviluppatori che vincono in questo momento sono quelli che hanno superato la sperimentazione con l’intelligenza artificiale. nella creazione di sistemi e prodotti ripetibili.

Inizia con un obiettivo chiaro. Scegli un modello di fondazione. Aggiungi osservabilità prima che ne abbia bisogno. Costruisci modulare. E non smettere mai di imparare: il panorama continuerà a cambiare, ma i fondamentali solidi si consolidano.

Pronto per imparare l’intelligenza artificiale? Unisciti alla comunità learnAI → comunità learnAI Skool