Que sont les grands modèles linguistiques (LLM) ? Explication complète

Temps de lecture : 22 minutes

Mise à jour : mars 2026

Présentation

Des milliards de personnes utilisent désormais les grands modèles linguistiques chaque jour, de ChatGPT et Claude à Gemini de Google et Meta’s Llama. Vous avez probablement interagi avec l’un d’eux sans même vous en rendre compte. Pourtant, la plupart des utilisateurs n’ont aucune idée du fonctionnement réel de ces systèmes ni de ce qui les différencie des moteurs de recherche traditionnels et de l’IA.

Le problème ? Les LLM sont devenus si parfaitement intégrés dans nos vies numériques que leur pouvoir, leurs limites et leurs capacités restent mystérieux pour la personne moyenne. Ce manque de connaissances conduit à la fois à des attentes irréalistes et à des opportunités manquées.

La promesse de ce guide est simple : expliquer les grands modèles linguistiques à partir des principes premiers, couvrant tout, depuis la façon dont ils sont formés jusqu’à ce qu’ils peuvent et ne peuvent pas faire, avec des exemples concrets et des références actuelles à partir de 2026.

À la fin de cet article, vous comprendrez :

– Qu’est-ce qu’un LLM et en quoi il diffère des autres IA

– L’architecture du transformateur qui alimente les LLM modernes

– Comment les entreprises forment ces modèles à des échelles de plusieurs milliards de dollars

– Les plus grands modèles disponibles aujourd’hui et leurs spécifications

– Plus de 15 applications concrètes qui transforment les industries

– Les dures limites des LLM actuels

– Bonnes pratiques pour les utiliser efficacement

Allons-y.

Table des matières

- Qu’est-ce qu’un LLM ? La définition simple

- Comment fonctionnent les LLM : l’architecture du transformateur expliquée simplement

- Comment sont formés les LLM : pré-formation, mise au point et RLHF

- Les plus gros LLM en 2026 : GPT-4o, Claude 3.5, Gemini 1.5, Llama 3, Mistral

- Ce que les LLM peuvent faire : 15 applications réelles

- Ce que les LLM ne peuvent pas faire : limitations et hallucinations

- LLM vs IA traditionnelle vs moteurs de recherche

- Comment utiliser efficacement les LLM : conseils pratiques

- L’avenir des LLM : ce qui nous attend en 2026 et au-delà

- FAQ : Réponses à vos questions sur les LLM

Qu’est-ce qu’un LLM ? La définition simple

Un Large Language Model (LLM) est un système d’intelligence artificielle entraîné sur de grandes quantités de données textuelles pour comprendre et générer le langage humain.

Voici ce que cela signifie en pratique :

Le concept de base

Un LLM fonctionne en prédisant le mot suivant (ou « jeton », un petit morceau de langage) dans une séquence. Lorsque vous écrivez une invite telle que « Expliquez l’informatique quantique en termes simples », le LLM lit votre entrée, puis génère une réponse appropriée, un jeton à la fois, en prédisant toujours ce qui devrait suivre en fonction des modèles appris au cours de la formation.

Considérez-le comme une fonctionnalité de saisie semi-automatique extrêmement sophistiquée, semblable à la façon dont votre téléphone suggère le mot suivant au fur et à mesure que vous tapez. Mais au lieu de faire des prédictions basées sur quelques milliers de documents, les LLM sont formés sur des milliards de jetons extraits de livres, de sites Web, d’articles universitaires, de référentiels de codes et d’autres sources de texte.

Caractéristiques clés

Grand : Les LLM modernes contiennent des milliards, voire des milliards de paramètres (des valeurs mathématiques qui codent des modèles de langage). GPT-5 possède plus de 10 000 milliards de paramètres. Les modèles plus grands fonctionnent généralement mieux mais nécessitent plus de puissance de calcul.

Langue : les LLM se spécialisent dans la compréhension et la génération d’un langage textuel. Les modèles les plus récents (2026) peuvent également traiter des images, de l’audio et de la vidéo parallèlement au texte, ce qui les rend multimodaux.

Modèle :Un LLM est un réseau neuronal : une structure mathématique inspirée de la façon dont les neurones biologiques se connectent. Ces réseaux apprennent en ajustant des millions de paramètres grâce à l’entraînement, de la même manière que votre cerveau renforce les connexions neuronales grâce à l’apprentissage.

Exemple rapide

Invite : « Qu’est-ce que la photosynthèse ? »

Ce que fait le LLM :

1. Tokenise votre entrée (la divise en morceaux)

2. Traite chaque jeton via des couches de transformateur (expliqué ensuite)

3. Prédit le prochain jeton le plus probable : « Photosynthèse »

4. Puis prédit le suivant : « est »

5. Puis : « le »

6. Et ainsi de suite jusqu’à ce qu’il complète une réponse cohérente

À retenir : Un LLM est un réseau neuronal entraîné sur d’énormes quantités de texte pour prédire les modèles de langage et générer des réponses de type humain.

Comment fonctionnent les LLM : l’architecture du transformateur expliquée simplement

La percée qui a rendu possible les LLM modernes a été l’architecture Transformer, introduite en 2017 dans un article intitulé « L’attention est tout ce dont vous avez besoin ».

Comprendre les transformateurs est essentiel pour comprendre pourquoi les LLM sont si puissants.

Le problème des transformateurs résolu

Avant les transformateurs, les chercheurs en IA utilisaient des architectures appelées RNN (Recurrent Neural Networks) qui traitaient le texte un mot à la fois, de manière séquentielle. Cette approche présentait une faiblesse critique : ils avaient du mal à se souvenir de mots lointains dans de longs passages. Si vous aviez une phrase de 50 mots, le modèle aurait du mal à se souvenir du premier mot au moment où il traiterait le 50ème mot.

Les Transformers ont résolu ce problème grâce à un mécanisme intelligent appelé auto-attention.

L’auto-attention : l’innovation fondamentale

L’auto-attention permet au modèle d’examiner simultanément tous les mots d’une phrase et de comprendre quels mots sont les plus importants pour comprendre d’autres mots.

Voici un exemple concret :

Phrase : « Le dirigeant de la banque était assis au bord de la rivière. »

Lors du traitement du mot « banque » (première occurrence), le modèle utilise l’auto-attention pour demander : « Quels autres mots de cette phrase sont les plus pertinents pour comprendre ce mot ? » Il découvre que « cadre » et « sat » sont des indices contextuels importants suggérant qu’il s’agit d’une institution financière.

Lors du traitement de la deuxième « rive », l’attention du modèle se rend compte que « rivière » est l’indice contextuel clé, indiquant que nous parlons d’un emplacement géographique.

Ce traitement parallèle de tous les jetons à la fois, ainsi que la possibilité de peser l’importance des jetons distants, est ce qui rend les transformateurs si efficaces.

Le pipeline de transformateur complet

Voici comment le texte circule dans un modèle de transformateur :

1. Tokenisation

Votre texte saisi est divisé en jetons, petits morceaux représentant des mots ou des sous-mots. La phrase « Bonjour tout le monde » pourrait devenir des jetons [101, 7592, 2088] (des nombres représentant chaque pièce).

2. Intégration

Chaque jeton est converti en un vecteur (une liste de nombres) qui capture le sens. Le jeton pour « bonjour » devient quelque chose comme [0.2, -0.5, 0.8, 1.2, …] avec des centaines ou des milliers de dimensions.

3. Encodage positionnel

Étant donné que les transformateurs traitent tous les jetons en même temps, ils doivent connaître l’ordre des mots. Des codages de position spéciaux sont ajoutés à chaque intégration pour indiquer au modèle où dans la séquence chaque jeton apparaît.

4. Couches de transformateur (Attention + Feed-Forward)

L’intégration passe par plusieurs couches de transformateur (les modèles modernes utilisent plus de 40 à 100 couches). Chaque couche contient :

– Attention multi-têtes : plusieurs mécanismes d’auto-attention fonctionnant en parallèle, chacun se concentrant sur différents aspects du langage

– Réseau Feed-forward : Un réseau neuronal simple qui traite chaque jeton indépendamment

– Normalisation des couches et connexions résiduelles : Techniques qui stabilisent l’entraînement

5. Génération de résultats

Après avoir traversé toutes les couches, l’intégration finale est reconvertie en une distribution de probabilité sur tous les jetons possibles. Le modèle sélectionne le prochain jeton le plus probable (ou en échantillonne un en utilisant diverses stratégies) et l’ajoute à la sortie.

6. Génération autorégressive

Le jeton nouvellement généré est renvoyé en entrée et le processus se répète. Cette approche « autorégressive » (dans laquelle la sortie devient la nouvelle entrée) se poursuit jusqu’à ce que le modèle génère un jeton d’arrêt ou atteigne une limite de longueur.

Pourquoi cette architecture fonctionne

Les transformateurs sont puissants car ils peuvent :

– Traitez les séquences en parallèle plutôt que séquentiellement, ce qui rend la formation plus rapide

– Apprendre les dépendances à long terme grâce à l’attention personnelle et à la mémorisation du contexte pertinent dans de longs documents

– Transférer l’apprentissage efficacement afin qu’un modèle pré-entraîné sur une tâche puisse bien fonctionner sur différentes tâches

– Évoluez efficacement avec plus de paramètres, plus de données et plus de puissance de calcul, améliorant généralement les performances

À retenir : L’architecture du transformateur utilise l’auto-attention pour permettre aux modèles d’évaluer simultanément l’importance de différents mots, leur permettant ainsi de comprendre le contexte et de générer un texte long et cohérent.

Comment les LLM sont formés : pré-formation, réglage fin et RLHF

Construire un LLM nécessite trois phases de formation distinctes. Comprendre ce processus révèle pourquoi les LLM sont si chers et pourquoi ils présentent certaines forces et faiblesses.

Phase 1 : Pré-formation (La Fondation)

La pré-formation est le moment où la puissance de calcul brute se produit. Voici ce qui se passe :

Le processus :

1. Les entreprises collectent des milliards de jetons provenant de diverses sources : livres, sites Web, articles universitaires, référentiels de codes, articles de presse et autres textes publics

2. Le modèle est entraîné sur un objectif simple : étant donné N jetons, prédire le (N+1)ème jeton

3. La formation utilise des clusters de calcul massifs (souvent plus de 10 000 GPU) fonctionnant pendant des semaines ou des mois

4. Des milliards d’étapes de formation ajustent progressivement les paramètres du modèle

Le coût :

– La formation GPT-5 coûte environ 500 millions de dollars à plus d’un milliard de dollars en ressources informatiques (estimations 2026)

– Consommation d’énergie : la formation de grands modèles consomme suffisamment d’électricité pour alimenter les petites villes

– Temps de formation : semaines à mois de calcul continu

Ce que le modèle apprend :

Lors de la pré-formation, le modèle absorbe :

– Modèles de langage et grammaire

– Connaissance factuelle (ce qu’elle lit dans les données de formation)

– Modèles de raisonnement et approches de résolution de problèmes

– Code, mathématiques et connaissances spécialisées

– Biais présents dans ses données d’entraînement

Limites du pré-entraînement seul :

Un modèle pré-entraîné, bien que performant, n’est pas encore optimisé pour être utile aux utilisateurs. Cela pourrait :

– Compléter le texte de manière non naturelle (imitant des modèles de données d’entraînement)

– Générer du contenu nuisible s’il apparaît dans les données d’entraînement

– Ne pas bien suivre les instructions d’utilisation

– Halluciner ou inventer des faits

C’est pourquoi la phase 2 est nécessaire.

Phase 2 : Affiner (le rendre utile)

Le réglage fin adapte le modèle pré-entraîné pour qu’il soit plus utile, inoffensif et honnête.

Réglage fin supervisé (SFT) :

1. Les entreprises embauchent des annotateurs (évaluateurs humains) pour créer des exemples de formation de haute qualité

2. Chaque exemple montre une invite et une réponse de haute qualité

3. Le modèle apprend à imiter ces réponses de haute qualité

4. Cette phase utilise généralement des millions d’exemples de formation (plus petits que la pré-formation)

5. Durée de formation : jours, voire semaines sur des clusters de calcul plus petits

Exemple de paire d’entraînement :

– Entrée : « Quelle est la meilleure façon d’apprendre le machine learning ? »

– Résultat idéal : « Commencez par les principes fondamentaux de l’algèbre linéaire et des statistiques. Apprenez ensuite Python. Progressez vers l’apprentissage supervisé (régression, classification), puis l’apprentissage non supervisé. Entraînez-vous avec les ensembles de données Kaggle… »

Grâce à un réglage fin supervisé, le modèle apprend :

– Comment structurer les réponses de manière professionnelle

– De refuser les demandes nuisibles

– Pour suivre des instructions en plusieurs étapes

– Comment décomposer clairement des sujets complexes

Phase 3 : Apprentissage par renforcement à partir du feedback humain (RLHF)

Le RLHF est l’ingrédient secret qui donne aux LLM modernes l’impression qu’ils essaient réellement de vous aider.

Comment fonctionne le RLHF :

- Générer les réponses des candidats : pour une invite, le modèle génère 4 à 8 réponses possibles différentes

- Classement humain : les annotateurs classent ces réponses de la meilleure à la pire, en tenant compte :

- Précision

- Servabilité

- Sécurité

- Clarté

- Concision

- Former un modèle de récompense : un réseau neuronal distinct apprend à prédire les préférences humaines. Compte tenu d’une réponse, il attribue un score (plus élevé = plus proche de ce que les humains préfèrent)

- Optimiser le LLM : Le LLM d’origine est ajusté pour maximiser son score de récompense, apprenant ainsi à générer des réponses que les humains préfèrent

- Itérer : les entreprises effectuent plusieurs cycles de RLHF, améliorant ainsi continuellement l’alignement.

Pourquoi c’est important :

RLHF explique pourquoi Claude se sent différent de GPT, qui est différent des Gémeaux. Chaque entreprise gère RLHF avec des préférences, des annotateurs et des signaux de récompense légèrement différents, ce qui donne lieu à des modèles avec des « personnalités » distinctes.

Résumé du calendrier de formation

Principaux points à retenir : la formation LLM est un processus en trois phases : la pré-formation développe la compréhension fondamentale de la langue, le réglage fin supervisé apprend au modèle à être utile et le RLHF l’optimise en fonction des préférences humaines.

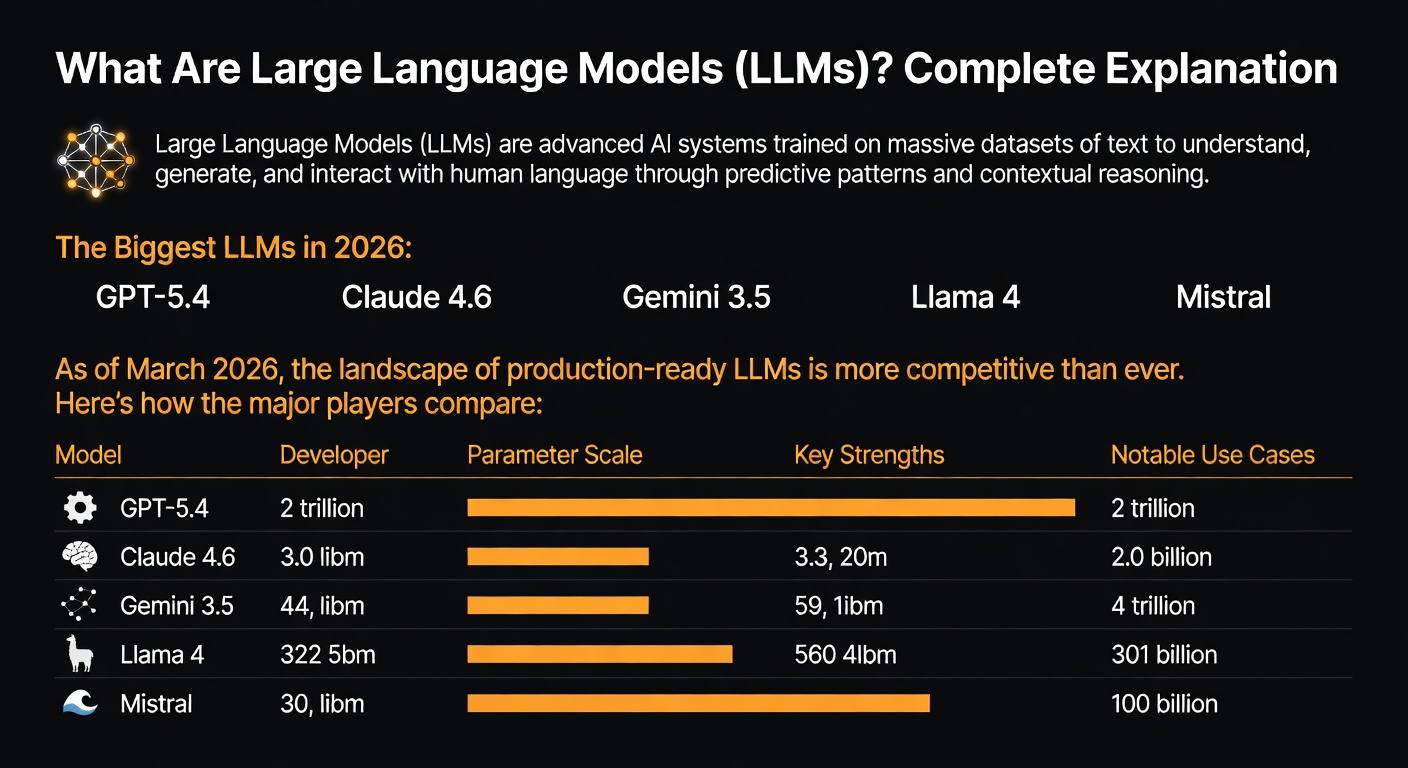

Les plus gros LLM en 2026 : GPT-4o, Claude 3.5, Gemini 1.5, Llama 3, Mistral

Depuis mars 2026, le paysage des LLM prêts à la production est plus compétitif que jamais. Voici comment les principaux acteurs se comparent :

OpenAI GPT-5.4

Sortie : mars 2026

Paramètres : plus de 10 000 milliards (estimés)

Fenêtre contextuelle : 1 000 000 de jetons (~750 000 mots)

Principales fonctionnalités :

– Modèles unifiés à usage général et de codage en un seul produit phare

– Capacité native d’utilisation de l’ordinateur (peut contrôler votre ordinateur)

– Effort de raisonnement configurable (choisissez vitesse ou précision)

– Saisie multimodale native (texte, images, vidéo dans une seule invite)

– Performances de référence à la pointe du secteur

Idéal pour : les utilisateurs souhaitant le modèle le plus performant ; entreprises ayant besoin d’automatisation de l’utilisation de l’informatique

Tarifs : 20 $/mois (Plus), 200 $/mois (Pro) ou API de paiement à l’utilisation

Documents officiels : Documentation OpenAI GPT

Atouts :

– Les scores de référence les plus élevés dans la plupart des tests

– Raisonnement le plus sophistiqué

– Le plus rapide pour la plupart des tâches

– La plus grande communauté et écosystème

Faiblesses :

– Le plus cher à utiliser

– Moins transparent sur la formation

– Nécessite une confiance dans un système à code source fermé

Claude Anthropique Opus 4.1

Sortie : août 2025

Paramètres : plus de 2 000 milliards (estimés)

Fenêtre contextuelle : 1 000 000 de jetons (~750 000 mots)

Principales fonctionnalités :

– IA constitutionnelle (formée pour être utile, inoffensive, honnête)

– Taux d’hallucinations extrêmement faibles parmi tous les modèles

– Fort en analyse et en raisonnement

– Excellent pour suivre des instructions détaillées

– Traitement natif de PDF, d’images et de vidéos

Idéal pour : Recherche, rédaction détaillée, analyse ; les utilisateurs privilégient la précision à la puissance brute ; travail créatif

Tarifs : 20 $/mois (Claude.ai Plus), 1 000 $/mois (Claude.ai Teams) ou paiement à l’utilisation de l’API

Documents officiels : Documentation Anthropic Claude

Atouts :

– Le plus fiable pour la précision

– Meilleur en analyse longue durée

– Approche constitutionnelle la plus solide en matière d’IA

– Idéal pour les tâches créatives et nuancées

Faiblesses :

– Légèrement plus lent que GPT pour certaines tâches

– Écosystème plus petit qu’OpenAI

– Moins connu sur le marché grand public

Google Gemini 3.1 Pro

Sortie : mars 2026

Paramètres : plus de 1 200 milliards (estimé)

Fenêtre contextuelle : 1 000 000 de jetons (peut traiter des films entiers en contexte)

Principales fonctionnalités :

– La plus grande fenêtre contextuelle de tous les modèles commerciaux

– Intégration transparente avec l’écosystème Google (Workspace, Search, Android)

– Fonctionne simultanément comme assistant de productivité et moteur de recherche

– Multimodal avec une compréhension exceptionnelle des images

– Accès en temps réel aux résultats de recherche Google

Idéal pour : les gros utilisateurs de Google Workspace ; automatisation de la productivité ; besoins d’information en temps réel

Tarifs : niveau gratuit avec limitations, 20 $/mois (Gemini Advanced) ou API payante à l’utilisation

Documents officiels : Documentation Google sur l’IA

Atouts :

– Fenêtre contextuelle massive pour le traitement des documents

– Intégration transparente de Google

– Accès à la recherche en temps réel

– Excellent pour le multimédia

– Forte compréhension de l’image

Faiblesses :

– L’API peut être plus lente que celle des concurrents

– Problèmes de confidentialité liés à l’intégration de Google

– Moins testé pour certaines tâches spécialisées

Meta Llama 4 (Open-Source)

Sortie : avril 2025

Paramètres : 400B (Scout), 1.4T (Maverick) (versions standard ; variantes MoE plus grandes)

Fenêtre contextuelle : 10 000 000 de jetons (Scout) – la plus grande de tous les modèles

Principales fonctionnalités :

– Architecture Mixture-of-Experts (MoE) – utilise uniquement les parties pertinentes du modèle par requête

– Nativement multimodal (texte, images, vidéo)

– Open source – peut être exécuté localement ou auto-hébergé

– Benchmarks compétitifs avec GPT et Gemini à 1/10ème du coût

– Fortes capacités de codage et de raisonnement

Idéal pour : les développeurs souhaitant s’auto-héberger ; les entreprises ayant besoin de rentabilité ; les organisations souhaitant un contrôle total sur les données

Tarif : gratuit (open source) ou inférence via des fournisseurs comme Together, Replicate (0,50 $ à 2 $ par million de jetons)

Documents officiels : Documentation Meta Llama

Atouts :

– Fenêtre contextuelle massive

– Extrêmement rentable

– Aucune restriction d’utilisation

– Peut être auto-hébergé

– Fort rapport performance/coût

Faiblesses :

– Nécessite une configuration technique pour l’utiliser

– Moins poli que les modèles commerciaux

– Communauté d’utilisateurs plus petite

– Taux d’hallucinations légèrement supérieurs à Claude

Mistral AI Mixtral 8x22B

Sortie : avril 2025

Paramètres : 141B (mélange d’experts, utilise 39B actif)

Fenêtre contextuelle : 65 000 jetons

Principales fonctionnalités :

– Mélange efficace d’experts (achemine les requêtes vers des experts spécialisés)

– Open source et facile à déployer

– Raisonnement exceptionnel pour sa taille

– Solides compétences en codage et en mathématiques

– Inférence à faible latence

Idéal pour : les développeurs souhaitant des modèles open source efficaces ; applications sensibles aux coûts ; tâches spécialisées

Tarifs : inférence gratuite (open source) ou bon marché via des fournisseurs (0,10 $ à 0,50 $ par million de jetons)

Documents officiels : Documentation Mistral AI

Points forts :

– Meilleur rapport performance/coût

– Assez petit pour les appareils de périphérie

– Open source et modifiable

– Inférence rapide

– Fort dans les tâches spécialisées

Faiblesses :

– Fenêtre contextuelle plus petite que celle des dirigeants

– Pas aussi performant pour les tâches à durée indéterminée

– Taux d’hallucinations plus élevés que les modèles frontières

Tableau de comparaison des modèles

Principaux points à retenir : Le marché LLM 2026 offre des options pour chaque cas d’utilisation : puissance maximale (GPT-5), précision la plus élevée (Claude), meilleure productivité (Gemini), rentabilité (Llama) et efficacité Lean (Mistral). Votre choix dépend de vos besoins spécifiques, de votre budget et de votre infrastructure.

Ce que les LLM peuvent faire : 15 applications du monde réel

Les LLM sont passés des laboratoires de recherche à l’infrastructure de base des produits et services. Voici 15 applications éprouvées qui transforment actuellement les industries :

1. Automatisation du service client

Industrie : Commerce de détail, SaaS, Finance

Les chatbots d’entreprise traitent désormais 40 à 60 % des demandes des clients sans intervention humaine, analysant les tickets d’assistance pour identifier les modèles et formant des réponses de qualité. Les entreprises signalent une amélioration de 30 à 50 % des taux de résolution au premier appel et une disponibilité 24h/24 et 7j/7. Une grande institution financière traite quotidiennement plus de 10 000 interactions clients avec des systèmes d’assistance basés sur LLM.

2. Génération de contenu et amp; Conservation

Industrie : Marketing, édition, médias

Les LLM génèrent des articles de blog, du contenu sur les réseaux sociaux, des campagnes par e-mail et des descriptions de produits à grande échelle. Des outils comme Jasper, Copy.ai et Claude sont devenus la norme dans les équipes marketing. Une agence de marketing de contenu peut désormais produire 5 fois plus de contenu pour 1/3 du coût en utilisant l’assistance LLM avec évaluation humaine.

3. Génération de code et amp; Débogage

Industrie : Développement de logiciels

GitHub Copilot utilise des LLM pour suggérer des complétions de code, générer des tests et expliquer le code. Des études montrent que les développeurs utilisant des assistants de codage IA accomplissent leurs tâches 35 à 55 % plus rapidement. De l’écriture de modèles passe-partout à la refactorisation de systèmes entiers, les LLM sont devenus des outils de développement indispensables.

4. Automatisation des dossiers médicaux

Industrie : Santé

Les LLM écoutent les conversations médecin-patient et les transcrivent automatiquement dans des dossiers médicaux structurés, en extrayant les symptômes, les diagnostics, les médicaments et les plans de traitement. Cela élimine 20 à 30 minutes de documentation par patient, améliorant ainsi la productivité du médecin.

5. Recherche juridique et amp; Analyse du contrat

Industrie : Droit

Les grands cabinets d’avocats utilisant des outils de recherche juridique basés sur LLM réduisent le temps de recherche de 60 %. Les LLM analysent les décisions de justice pour suggérer des précédents pertinents, examinent les contrats pour détecter les clauses à risque et identifient les problèmes de conformité réglementaire. Des outils tels que LexisNexis+ et Westlaw Edge AI incluent désormais des fonctionnalités LLM.

6. Intelligence commerciale – Notation des leads

Industrie : Ventes B2B

Les LLM analysent le comportement des prospects, les e-mails et les données de l’entreprise pour évaluer automatiquement la qualité des prospects. Les équipes commerciales utilisant des systèmes de notation des leads basés sur l’IA améliorent les taux de conversion de 20 à 30 % en se concentrant sur les opportunités les plus probables.

7. Éducation personnalisée – Tutorat

Industrie : EdTech

Les LLM adaptent le contenu éducatif aux styles d’apprentissage individuels, génèrent des questions pratiques personnalisées, fournissent des explications adaptées au niveau de compréhension et proposent un tutorat 24h/24 et 7j/7. Cela démocratise l’accès à l’éducation et est particulièrement efficace pour les apprenants ayant besoin d’un soutien supplémentaire.

8. Description du produit et description du produit. Optimisation du commerce électronique

Industrie : Vente au détail, Marketplace

Les plates-formes de commerce électronique utilisent les LLM pour générer des descriptions de produits, comparer les fonctionnalités des concurrents, optimiser les titres pour la recherche et analyser les avis des clients afin d’améliorer les listes de produits. Les détaillants signalent une augmentation de 15 à 25 % des taux de conversion.

9. Reprendre la sélection et l’évaluation Recrutement

Industrie : RH, recrutement

Les LLM examinent des milliers de CV, extraient les qualifications, identifient les meilleurs candidats et sélectionnent les compétences requises, réduisant ainsi de 80 % le temps consacré par les recruteurs à la sélection initiale. Cela accélère le processus d’embauche tout en améliorant l’adéquation des candidats.

10. Analyse financière et amp; Récapitulatif des appels sur les revenus

Industrie : Finance, investissement

Les LLM analysent les relevés de notes, les rapports trimestriels et les états financiers pour extraire des informations clés, prédire les tendances et résumer les performances. Les sociétés d’investissement utilisent l’analyse basée sur LLM pour identifier les signaux plus rapidement que leurs concurrents.

11. Traitement des réclamations d’assurance

Industrie : Assurance

Les LLM extraient les informations des documents de réclamation, vérifient la couverture des polices, calculent les montants des paiements et génèrent des communications de réponse. Les systèmes agents traitent les réclamations de routine sans intervention humaine, réduisant ainsi le temps de traitement de quelques jours à quelques minutes.

12. Optimisation des annonces immobilières

Secteur : Immobilier

Les LLM analysent les tendances du marché, génèrent des descriptions de propriétés, comparent les annonces des concurrents et identifient automatiquement les propriétés comparables pour la tarification. Les agents consacrent moins de temps au travail administratif et plus de temps aux interactions clients à forte valeur ajoutée.

13. Traduction linguistique – Localisation

Industrie : Activités mondiales, localisation

Les LLM modernes traduisent le contenu dans plusieurs langues tout en préservant mieux les nuances, les expressions idiomatiques et le contexte culturel que les approches précédentes. Les entreprises qui localisent leurs produits sur de nouveaux marchés peuvent le faire plus rapidement et à moindre coût.

14. Analyse des sentiments et analyse des sentiments Surveillance des médias sociaux

Industrie : Gestion de marque, intelligence client

Les LLM analysent les mentions sur les réseaux sociaux, les avis des clients et les commentaires pour comprendre l’opinion de la marque en temps réel. Les entreprises détectent les problèmes émergents, suivent la perception de la marque et identifient les problèmes des clients à grande échelle.

15. Documentation technique et Documentation de l’API

Industrie : Logiciels, DevTools

Les LLM génèrent de la documentation logicielle, des guides API et des exemples de mise en œuvre. Cela réduit le temps que les développeurs consacrent à la documentation et permet de maintenir la précision à mesure que le code évolue.

Statistiques d’adoption par l’industrie

Selon McKinsey Technology Trends Outlook 2025, l’utilisation de systèmes d’IA générative alimentés par LLM dans les entreprises est passée de 33 % en 2024 à 67 % en 2025, soit un doublement en un an seulement. D’ici 2026, l’adoption dépassera 80 % dans les secteurs de la technologie, de la finance et des services professionnels.

Point clé à retenir : les LLM ne sont plus expérimentaux : ce sont des infrastructures de production. Presque tous les secteurs trouvent des applications, les gains de productivité les plus importants étant réalisés dans le travail fondé sur la connaissance : rédaction, analyse, codage, interaction client et recherche.

Ce que les LLM ne peuvent pas faire : limitations et hallucinations

Malgré leurs capacités impressionnantes, les LLM ont de fortes contraintes. Comprendre ces limitations est essentiel pour les utiliser efficacement.

1. Hallucinations (le plus gros problème)

Les LLM génèrent de fausses informations apparemment confiantes appelées « hallucinations ». Le modèle prédit des jetons qui semblent plausibles mais qui sont factuellement incorrects.

Pourquoi cela se produit :

– L’objectif de formation du modèle est la prédiction du prochain jeton, et non la prédiction de la vérité

– Les LLM optimisent les modèles de langage, pas la précision

– Une fois qu’un LLM s’engage sur une fausse voie, il continue d’élaborer le mensonge

Exemple réel :

Invite : « Quel est le numéro de téléphone de la Maison Blanche ? »

Un LLM typique pourrait répondre : « Le numéro de téléphone de la Maison Blanche est le (202) 456-1111 » – ce qui est correct – mais il hallucine parfois des variantes ou ajoute de fausses extensions.

Plus problématique :

Invite : « Répertoriez tous les articles scientifiques publiés par le Dr Jane Smith sur l’informatique quantique en 2024. »

Un LLM peut fabriquer des articles entiers avec des titres plausibles qui n’existent pas réellement.

Stratégies d’atténuation :

– Vérifier toute affirmation factuelle dans des contextes à enjeux élevés

– Utilisez la génération de récupération augmentée (RAG) pour permettre aux LLM d’accéder aux données actuelles

– Demander des sources et des citations

– Utilisez des modèles spécifiquement optimisés pour la précision (Claude excelle ici)

2. Aucune connaissance en temps réel

Les données de formation LLM ont une date limite de connaissances. Les modèles formés en 2024 ne connaissent pas les événements de 2026 à moins de recevoir explicitement cette information.

Exemple :

Un modèle formé jusqu’en avril 2024 ne sait pas :

– Qui a remporté les élections américaines de 2024

– Mouvements boursiers récents

– Lancements de nouveaux produits

– Dernières nouvelles

Solution : utilisez des LLM avec accès à la recherche sur le Web (comme Gemini ou Claude avec des outils externes) ou implémentez des systèmes RAG qui alimentent les informations actuelles.

3. Limitations de la fenêtre contextuelle (partiellement résolues)

Bien que les modèles 2026 disposent de fenêtres contextuelles d’un million de jetons, ils ont encore des limites. Les informations au milieu de contextes très longs sont parfois « oubliées » (le phénomène « perdu au milieu »).

Limite pratique : même si un modèle peut accepter 1 million de jetons, les applications pratiques fonctionnent généralement mieux avec 50 000 à 200 000 jetons en raison de la dégradation des coûts et de l’attention.

4. Aucune véritable compréhension

Les LLM sont des systèmes sophistiqués de correspondance de modèles, et non des entités conscientes dotées de compréhension. Ils :

– Je ne peux pas vraiment « comprendre » les concepts, je ne reconnais que les modèles

– Ne pas avoir de mémoire persistante entre les conversations

– Impossible de vérifier les faits de manière indépendante

– Je ne peux pas vraiment apprendre (les modèles sont statiques après la formation)

Note philosophique : Les philosophes se demandent si ce que font les LLM constitue une « compréhension ». D’un point de vue pratique, les LLM se comportent d’une manière impossible à distinguer de la compréhension pour de nombreuses tâches, mais cette limitation est importante pour les tâches de raisonnement critique.

5. Luttes avec des chaînes de raisonnement extrêmement longues

Bien que les LLM excellent dans le raisonnement en plusieurs étapes, les chaînes de raisonnement extrêmement longues (plus de 50 étapes) deviennent moins fiables. Les erreurs s’aggravent au fil des étapes.

Exemple :

Un problème de géométrie nécessitant 30 étapes de raisonnement séquentielles peut être résolu correctement dans 70 % des cas, tandis qu’un problème en 10 étapes peut être résolu correctement dans 95 % des cas.

6. Mauvais pour les tâches nécessitant une entrée sensorielle en temps réel

Les LLM ne peuvent pas :

– Traiter les flux vidéo en direct (uniquement les images statiques)

– Écoutez l’audio en temps réel (uniquement texte transcrit ou audio préenregistré)

– Odeur, goût ou sensation

– Interagissez directement avec les environnements physiques

Les modèles multimodaux modernes peuvent traiter des images, mais ne peuvent toujours pas gérer une véritable perception en temps réel.

7. Capacité limitée à apprendre de nouvelles données sans recyclage

Chaque conversation avec un LLM recommence. Le modèle ne peut pas apprendre de vos commentaires au cours d’une conversation comme le font les humains. Il ne « se souviendra » pas des corrections que vous apportez, sauf si cela vous est explicitement rappelé au cours de la même conversation.

8. Luttes avec des domaines inhabituels ou hautement spécialisés

Les LLM sont les plus faibles dans les domaines suivants :

– Extrêmement rare dans les données de formation (domaines académiques obscurs)

– Exiger des connaissances de pointe (articles de recherche publiés le mois dernier)

– Utiliser un jargon hautement spécialisé qui n’est pas bien représenté dans les données d’entraînement

– Exiger une expérience pratique pratique

9. Je ne peux pas compter de manière fiable ou faire des calculs précis

C’est surprenant étant donné les capacités en mathématiques des LLM, mais ils ont du mal à :

– Comptage de grandes quantités

– Arithmétique à plusieurs chiffres (notamment avec report)

– Preuves mathématiques précises

Exemple :

Invite : « Comptez le nombre de « R » dans le mot « fraise » »

De nombreux LLM répondent incorrectement « 2 » au lieu du « 3 » correct.

10. Raisonnement de bon sens limité

Bien que les LLM aient absorbé des modèles issus des données d’entraînement, ils échouent parfois dans les tâches de raisonnement qui s’appuient sur une profonde intuition physique ou sociale que possèdent naturellement les enfants.

Exemple :

« Une baignoire est remplie d’eau. Quelqu’un enlève un bouchon du drain de la baignoire. Que se passe-t-il ? »

Les LLM répondent généralement correctement, mais des variations inhabituelles les confondent parfois.

Résumé des limitations

Principaux points à retenir : les LLM excellent dans le langage, la correspondance de modèles et la génération de texte plausible, mais ils hallucinent les faits, manquent de connaissances en temps réel et échouent parfois dans des tâches de raisonnement qui semblent simples aux humains. Utilisez-les comme des outils puissants, pas comme des oracles.

LLM, IA traditionnelle et moteurs de recherche : quelle est la différence ?

Si vous débutez dans l’IA, les LLM peuvent ressembler à d’autres systèmes d’IA dont vous avez entendu parler. Ce n’est pas le cas. Voici comment ils se comparent :

LLM vs modèles d’apprentissage automatique traditionnels

ML traditionnel (régression logistique, arbres de décision, SVM, forêts aléatoires) :

– Formés pour prédire une seule variable (par exemple : « Ce prêt sera-t-il en défaut ? » Oui/Non)

– Exiger des fonctionnalités conçues à la main (les humains créent manuellement des variables d’entrée)

– Fonctionne mieux avec des ensembles de données petits à moyens (des milliers à des millions d’exemples)

– Interprétable : vous pouvez souvent comprendre pourquoi un modèle a pris une décision

– Rapide et peu coûteux à former

– Utilisé pour la classification, la régression, le clustering

Exemple : Une banque entraîne une forêt aléatoire pour prédire les défauts de paiement à l’aide de 20 caractéristiques (pointage de crédit, revenu, ratio dette/revenu, antécédents professionnels, etc.). Il prédit : 85 % de chances de remboursement.

LLM :

– Formé à prédire le prochain jeton dans une séquence (ouverte)

– Apprenez automatiquement les fonctionnalités à partir de données textuelles brutes

– Nécessitent des ensembles de données massifs (des milliards à des milliards de jetons)

– Non interprétable – boîte noire sur la prise de décision

– Coûteux à former (plus de 500 millions de dollars) mais peu coûteux à utiliser une fois formé

– Générez des résultats créatifs et ouverts

Exemple :Vous demandez à Claude : « Dois-je contracter un emprunt ? et il analyse votre situation de manière globale, en tenant compte du contexte financier, des alternatives et des circonstances personnelles, en fournissant des conseils nuancés.

LLM par rapport à d’autres modèles d’IA/ML

Modèles de vision par ordinateur (détection d’objets, segmentation d’images) :

– Spécialisé pour les tâches visuelles

– Impossible de traiter le texte

– Les versions modernes intègrent des capacités multimodales

Systèmes de recommandation :

– Optimiser pour prédire les préférences des utilisateurs

– Non conçu pour la génération de texte ouverte

– Utilisé dans Netflix, Spotify, Amazon

Graphiques de connaissances et amp; Recherche sémantique :

– Stocker des relations factuelles structurées

– Peut répondre à des questions factuelles précises

– Ne générez pas de nouveau contenu

LLM et moteurs de recherche : les principales différences

Cette comparaison est importante, car de nombreuses personnes confondent les LLM avec la recherche Google.

Différences pratiques :

Question du moteur de recherche :

« Quelle est la capitale de la France ? »

→ Renvoie un article Wikipédia sur Paris, des sites gouvernementaux, des cartes

Question LLM :

« Expliquez pourquoi Paris est située sur la Seine et comment cela a affecté son développement en tant que capitale »

→ Génère une synthèse réfléchie de 2 à 3 paragraphes expliquant la géographie, l’histoire et l’importance stratégique

Les LLM peuvent-ils effectuer des recherches ?

Les LLM modernes intègrent de plus en plus la recherche sur le Web :

– Gemini (Google) intègre la recherche en temps réel

– Claude peut bénéficier d’outils de navigation web

– OpenAI ajoute la recherche Web à GPT

Cela crée un système hybride qui combine le raisonnement des LLM avec la fraîcheur des moteurs de recherche.

LLM vs assistants spécialisés en IA

Assistants spécialisés comme :

– Siri, Alexa : interfaces vocales aux capacités limitées, appelant généralement des fonctions spécifiques

– ChatBot pour le service client : systèmes basés sur des règles ou à LLM restreint répondant à des questions prédéfinies

– Vérificateurs de grammaire : spécialisés pour une tâche précise

Différence clé : les LLM sont à usage général. Ils s’adaptent à n’importe quelle tâche que vous leur demandez sans recyclage.

À retenir : les LLM sont fondamentalement différents du ML traditionnel (génération ouverte ou prédiction spécifique), des moteurs de recherche (synthétiser ou récupérer) et des assistants spécialisés (généraux ou étroits). Ils occupent une position unique en tant que systèmes de compréhension du langage à usage général.

Comment utiliser efficacement les LLM : conseils pratiques

Maintenant que vous comprenez ce que sont les LLM et leurs limites, voici comment les utiliser pour maximiser leur valeur.

1. Rédiger des invites détaillées et spécifiques

Invite faible :

« Écrire sur le changement climatique »

Invite forte :

« Écrivez un article de blog de 500 mots sur les impacts du changement climatique sur la production alimentaire mondiale. Concentrez-vous sur la façon dont la hausse des températures affecte les rendements des cultures et la disponibilité de l’eau en Afrique subsaharienne. Incluez des données spécifiques pour 2024 et des prévisions pour 2030. Utilisez un ton professionnel mais accessible pour les lecteurs sans formation en science du climat. «

Pourquoi c’est important : les LLM sont excellents pour suivre des instructions détaillées. Plus votre demande est précise, meilleur est le résultat.

2. Utilisez l’état d’esprit « Ingénierie rapide »

Traitez les invites comme du code : itérez et affinez.

Approche itérative :

1. Écrivez l’invite initiale

2. Examiner le résultat

3. Identifiez ce qui manque ou ce qui ne va pas

4. Affinez l’invite avec plus de contexte ou d’instructions

5. Répétez jusqu’à ce que vous soyez satisfait

Techniques :

– Quelques exemples : fournissez 2 à 3 exemples du format de sortie souhaité

– Jeu de rôle : « Vous êtes un conseiller financier expert… »

– Pas à pas : « Réfléchissez étape par étape… »

– Contraintes : « Garder la réponse en dessous de 200 mots … »

3. Vérifier les allégations factuelles

N’utilisez jamais les résultats du LLM comme vérité terrain sans vérification dans des contextes à enjeux élevés.

Cas d’utilisation sécurisé : Brainstorming, idéation, rédaction, explication de concepts

Cas d’utilisation risqués : Citation de statistiques sans vérification, prise de décisions médicales, conseils juridiques

4. Utiliser les LLM comme accélérateurs de recherche

Les LLM sont exceptionnels dans la synthèse rapide des informations.

Flux de travail :

1. Demandez à LLM d’expliquer un sujet

2. Demandez-lui d’identifier les lacunes

3. Demandez-lui de fournir des points de vue opposés

4. Utilisez cette base pour effectuer des recherches plus approfondies

Exemple : « Résumez les trois arguments les plus forts pour et contre le revenu de base universel, avec les citations clés »

5. Tirer parti des capacités multimodales

Les LLM modernes (2026) acceptent les images, et certains acceptent les documents et les vidéos.

Approches utiles :

– Téléchargez une capture d’écran et demandez « Que se passe-t-il dans cette image ? »

– Fournissez un document PDF et demandez « Résumer les principales conclusions »

– Demandez « Analysez ce graphique et identifiez les tendances »

– Téléchargez une photo d’un problème manuscrit et demandez une solution

6. Utiliser les LLM pour la génération de code et le débogage

Les LLM sont des assistants de programmation exceptionnels.

Utilisations efficaces :

– « Écrivez une fonction Python qui… »

– « Déboguer ce code : [coller le code] »

– « Expliquez ce que fait ce code en termes simples »

– « Refactoriser ce code pour de meilleures performances »

– « Écrire des tests unitaires pour cette fonction »

7. Mettre en œuvre l’invite de chaîne de pensée

Pour un raisonnement complexe, demandez explicitement au modèle de raisonner étape par étape.

Faible : « Cet investissement est-il une bonne idée ? »

Strong : « Analysez cette opportunité d’investissement étape par étape, en tenant compte : (1) des rendements potentiels, (2) des facteurs de risque, (3) de ma tolérance au risque, (4) des alternatives. Ensuite, fournissez votre recommandation en la justifiant. »

8. Utiliser des outils et des API externes

Améliorez les LLM avec les fonctionnalités qui leur manquent :

- Calculatrices pour l’arithmétique

- API de recherche sur le Web pour les informations actuelles

- Requêtes de base de données pour obtenir des faits à jour

- Exécution de code pour vérifier que le code fonctionne

- Génération d’images pour le contenu visuel

Cela crée un « moteur de raisonnement » bien plus performant que le LLM seul.

9. Comprendre les différences entre les modèles et faire le bon choix

- GPT-5 : Capacité maximale, codage, raisonnement complexe

- Claude : Précision, analyse, rédaction longue, sécurité

- Gemini : Productivité, intégration avec les outils Google

- Lama : Rentabilité, auto-hébergement, contrôle

Faites correspondre la tâche au modèle.

10. Implémentez le contrôle de version pour vos invites

Si vous utilisez les LLM à plusieurs reprises pour des tâches importantes :

– Enregistrez des invites efficaces

– Documentez ce qui fonctionne et ce qui ne fonctionne pas

– Itérer sur vos modèles

– Partagez les invites réussies avec les équipes

11. Définir des attentes appropriées

Les LLM sont :

– ✓ Idéal pour rédiger, réfléchir, expliquer

– ✓ Utile pour rédiger les premières ébauches

– ✓ Excellent pour apprendre de nouveaux sujets

– ✓ Idéal pour analyser du texte et des données

– ✗ Non fiable en tant que source unique de faits critiques

– ✗ Ne remplace pas l’expertise du domaine

– ✗ Pas infaillible lors de raisonnements complexes

12. Apprenez la personnalité de votre LLM

Chaque modèle majeur possède des atouts différents :

Claude :

– Des réponses réfléchies et approfondies

– Excellent pour admettre l’incertitude

– Estimations conservatrices

– Idéal pour une écriture nuancée

GPT-5 :

– Style plus agressif/utile

– Plus rapide en mathématiques et en logique

– Mieux dans des contextes très longs

– Ton plus décontracté

Gémeaux :

– Des réponses concises et directes

– Bon pour les informations en temps réel

– Excellente intégration de la recherche

– Les atouts multimodaux

Testez quel modèle fonctionne le mieux pour votre cas d’utilisation spécifique.

Point clé à retenir : L’efficacité des LLM dépend de la manière dont vous les utilisez. Rédigez des invites détaillées, vérifiez les faits importants, utilisez-les comme outils d’accélération et choisissez le modèle adapté à votre tâche spécifique.

L’avenir des LLM : ce qui s’en vient en 2026 et au-delà

Qu’est-ce qui arrive en 2026

Véritable intégration multimodale

– Tous les principaux LLM traiteront de manière transparente le texte, les images, la vidéo et l’audio dans des invites uniques

– Compréhension vidéo en temps réel (pas seulement les images statiques)

– Conversation avec entrée et sortie audio (ne nécessitant pas de transcription)

– Compréhension et manipulation de modèles 3D

IA agentique par défaut

– LLM avec mémoire persistante au fil des sessions

– Exécution autonome des tâches (planification, recherche, automatisation)

– L’utilisation des outils devient standard (chaque LLM intègre des API par défaut)

– Flux de travail autonomes en plusieurs étapes sans intervention humaine

Précision améliorée

– Les taux d’hallucinations chutent de 50 à 70 % grâce à des techniques d’entraînement améliorées

– Calcul au moment du test (les modèles raisonnent plus fort sur des problèmes difficiles)

– Meilleure intégration avec les systèmes de récupération

– Les modèles affinés spécifiques à un domaine prolifèrent

Réductions des coûts

– Les coûts d’inférence passent de 0,01 à 0,15 $/mtok actuels à 0,001 à 0,01 $/mtok

– Les modèles open source auto-hébergés deviennent prêts pour la production

– Les modèles plus petits (paramètres 50B-100B) correspondent aux modèles frontières sur de nombreuses tâches

– Le déploiement Edge devient pratique

2027 et au-delà : l’horizon à plus long terme

Modèles axés sur le raisonnement

– Nouveau paradigme d’architecture allant au-delà des transformateurs

– Modèles optimisés pour les longues chaînes de raisonnement

– Preuves mathématiques avec vérification formelle

– Génération et tests d’hypothèses scientifiques

Apprentissage multimodal à grande échelle

– Modèles formés simultanément sur tous les types de connaissances humaines

– Compréhension vidéo au niveau photographique

– Compréhension des causes et effets physiques de la vidéo

– Compréhension du monde 3D à partir d’observations 2D

Mémoire persistante et apprentissage

– Des modèles qui accumulent des connaissances au cours des conversations

– L’apprentissage en quelques étapes devient un apprentissage en une seule fois

– Des modèles personnalisés qui apprennent vos préférences

– Apprentissage continu à partir des interactions des utilisateurs (éthiquement)

Modèles fédérés et préservant la confidentialité

– Des modèles qui s’exécutent localement tout en apprenant à l’échelle mondiale

– Formation axée sur la confidentialité où aucune donnée brute ne quitte votre appareil

– L’apprentissage fédéré devient la norme

– Apprentissage automatique compatible avec le chiffrement

Compromis spécialisés ou généraux

– Passer d’un modèle géant à divers modèles spécialisés

– Le mélange d’experts devient une architecture universelle

– Des modèles plus petits et plus rapides pour des tâches simples

– Modèles extrêmement grands pour des raisonnements complexes

– Sélection dynamique des modèles à utiliser

Efficacité énergétique

– Amélioration de plusieurs ordres de grandeur de l’efficacité de calcul

– Approches informatiques neuromorphiques

– Le matériel d’IA spécialisé devient une marchandise

– Les besoins énergétiques de formation et d’inférence diminuent considérablement

Défis et questions émergents

Alignement et sécurité

– À mesure que les modèles deviennent plus performants, l’alignement devient plus difficile

– Comment pouvons-nous garantir que les systèmes d’IA avancés restent bénéfiques ?

– Qui contrôle les modèles les plus puissants ?

Désinformation et authenticité

– Les LLM rendent triviale la création de fausses informations convaincantes

– Comment maintenir la confiance dans l’information ?

– L’authentification et la provenance deviennent critiques

Travail et société

– Les flux de travail des travailleurs du savoir se transforment fondamentalement

– Certains emplois disparaissent ; de nouveaux emplois émergent

– La société doit faire face aux perturbations de manière réfléchie

– L’éducation et la formation deviennent continues

Interprétabilité

– Les LLM actuels restent des boîtes noires

– Comment comprendre le fonctionnement des modèles les plus puissants ?

– Pouvons-nous construire des modèles interprétables qui sont encore performants ?

Ce que vous devriez faire maintenant

- Commencez à expérimenter : la meilleure façon de comprendre l’avenir est d’utiliser ces outils dès aujourd’hui.

- Développer les compétences : se concentrer sur les compétences que les LLM ne peuvent pas remplacer (créativité, jugement, intelligence émotionnelle, expertise spécialisée)

- Apprendre l’ingénierie rapide : cela devient une compétence professionnelle précieuse

- Comprenez les limites : ne surestimez pas ce qui s’en vient ; certains défis sont plus difficiles que prévu

- Restez informé : suivez les développements des communautés OpenAI, Anthropic, Google, Meta et open source

Point clé à retenir : 2026-2027 verra une évolution rapide et continue : une meilleure précision, des coûts réduits, un raisonnement amélioré et des capacités autonomes. Le paysage LLM évolue vers des modèles spécialisés, une efficacité améliorée et des systèmes agents. L’avenir des LLM n’est pas un modèle superintelligent unique : c’est un écosystème de divers systèmes d’IA travaillant ensemble.

FAQ : réponses à vos questions sur les LLM

Q1 : Les LLM sont-ils conscients ou intelligents ?

R : C’est philosophiquement complexe. Les LLM présentent des comportements qui ressemblent à la compréhension et au raisonnement, mais ils n’ont pas :

– Conscience ou expérience subjective (à notre connaissance)

– Véritable compréhension (ils reconnaissent les modèles, pas le sens)

– Objectifs ou désirs persistants

– Agence au sens philosophique

Réponse pratique : Les LLM sont des outils extrêmement puissants de mise en correspondance de modèles et de génération de texte qui produisent des résultats ressemblant à une conversation intelligente. Que cela constitue ou non une « intelligence » dépend de la façon dont vous définissez le terme.

Q2 : Les LLM peuvent-ils remplacer les humains dans mon travail ?

R : Cela dépend de votre travail. Les LLM sont susceptibles de :

Augmentation (pas de remplacement) :

– Développeurs de logiciels (développement plus rapide)

– Écrivains (rédaction plus rapide)

– Analystes (recherche plus rapide)

– Enseignants (outils d’apprentissage personnalisés)

– Médecins (meilleure aide au diagnostic)

Peut éventuellement remplacer :

– Représentants du service client (pour l’assistance de base)

– Parajuristes juniors (recherche juridique)

– Opérateurs de saisie de données

– Rédacteurs de contenu (certains types)

– Assistants traducteurs

Réalité : La plupart des emplois seront augmentés par les LLM plutôt que supprimés. Les personnes qui apprendront à travailler efficacement avec les LLM seront les plus précieuses. Votre avantage concurrentiel consiste à apprendre à mieux utiliser ces outils que les alternatives.

Q3 : Quelle est la précision réelle des LLM ?

R : La précision varie énormément selon la tâche :

- Questions factuelles simples : 75 à 90 % de précision

- Raisonnement mathématique :Précision de 60 à 85 % (pire en arithmétique)

- Génération de code : précision de 70 à 95 % (en fonction de la complexité)

- Tâches créatives : aucune mesure de précision ne s’applique

- Domaines spécialisés : 50 à 70 % (si données de formation extérieures)

Point clé : Vous devez vérifier les revendications dans les domaines à enjeux élevés. Les LLM sont confiants même lorsqu’ils se trompent.

Q4 : À quoi servent mes données d’entraînement ?

R : Cela varie selon le fournisseur :

OpenAI : les données d’entraînement de GPT Plus et de l’API seront intégrées à l’entraînement futur du modèle (sauf si vous vous désabonnez)

Anthropique : les conversations Claude.ai peuvent être revues pour améliorer la formation, mais un désabonnement explicite est disponible

Google : les conversations Gemini peuvent améliorer Gemini, mais sont séparées des autres services Google (avec des contrôles de confidentialité)

Règle générale : Vérifiez les politiques de confidentialité. Supposons que les conversations peuvent être utilisées à des fins d’amélioration, sauf indication contraire explicite.

Q5 : Comment savoir si le contenu a été écrit par un LLM ?

R : Honnêtement ? Cela devient de plus en plus difficile. Indicateurs clés :

Contenu généré souvent par LLM :

– A une structure légèrement formelle

– Évite les opinions fortes

– Comprend des clichés et des expressions galvaudées

– A une grammaire parfaite (parfois trop parfaite)

– Manque d’exemples personnels précis

– Suit des modèles de contour évidents

Tests :

– Posez des questions de suivi nécessitant des connaissances spécifiques

– Rechercher des erreurs factuelles (hallucinations)

– Vérifiez les cas extrêmes inhabituels : les LLM les manquent souvent

– Des outils de détection d’IA existent mais ne sont pas fiables

Réalité : la détection de l’IA est une course aux armements. À mesure que les modèles s’améliorent, la détection devient plus difficile.

Q6 : L’utilisation des LLM est-elle une « triche » à l’école ?

R : La société est encore en train de comprendre cela.

Considérations :

– Rédiger des articles : Utiliser des LLM sans divulgation est du plagiat (malhonnêteté académique)

– Outil d’apprentissage : Utiliser des LLM pour expliquer les concepts que vous synthétisez ensuite, c’est apprendre

– Devoirs : S’appuyer entièrement sur les réponses LLM empêche l’apprentissage

– Brainstorming : Utiliser les LLM comme partenaires créatifs est légitime

Bonne pratique : vérifiez la politique en matière d’IA de votre établissement. De nombreuses écoles disposent désormais de directives explicites. Apprendre à utiliser l’IA de manière éthique est en soi une compétence précieuse.

Q7 : Les modèles plus grands sont-ils toujours plus performants ?

R : Pas toujours.

Les modèles plus grands sont meilleurs pour :

– Raisonnement complexe

– Gérer des tâches diverses

– Comprendre les nuances

– Documents longs

Les modèles plus petits peuvent être meilleurs :

– Vitesse (inférence en millisecondes par rapport aux secondes)

– Coût (1/100ème du prix)

– Confidentialité (peut s’exécuter localement)

– Fiabilité sur des domaines spécifiques (si affiné)

Tendance 2026 : L’ère du « plus grand, c’est mieux » touche à sa fin. Les petits modèles spécialisés et perfectionnés sont de plus en plus compétitifs. Vous devez choisir en fonction de votre tâche spécifique, et non de la taille maximale.

Q8 : Comment dois-je penser aux droits d’auteur et aux licences d’IA ?

R : Ceci est encore incertain sur le plan juridique, mais voici les conseils pratiques :

Lors de la génération de contenu avec les LLM :

– Le contenu que vous générez vous appartient généralement.

– L’attribution n’est pas toujours légalement requise

– Mais la divulgation de l’utilisation de l’IA est de plus en plus attendue

Lors de l’utilisation de code généré par LLM :

– Soyez conscient de la licence utilisée par votre modèle

– Les modèles open source ont des exigences spécifiques

– Des avis de droits d’auteur peuvent s’appliquer

Bonne pratique : incluez une déclaration lorsque cela est possible. « Cet article a été rédigé avec l’aide de l’IA » devient la norme.

Q9 : Quelle est la différence entre les LLM et les GPT ?

R : Idée fausse courante : GPT est une famille de modèles spécifique (par OpenAI), pas tous les LLM.

Relations :

– GPT = Série de modèles spécifiques par OpenAI (GPT-4, GPT-5, etc.)

– LLM = Catégorie incluant GPT, Claude, Gémeaux, Lama, etc.

– ChatGPT = Interface consommateur vers les modèles GPT

Comme « Comment sont les Kleenex par rapport aux mouchoirs ? » — Kleenex est une marque, les mouchoirs en papier sont la catégorie.

Q10 : Comment commencer à utiliser les LLM si je suis débutant ?

R :

Étape 1 : Démarrez gratuitement

– Niveau gratuit ChatGPT (openai.com)

– Claude (claude.ai) — gratuit

– Gémeaux (gemini.google.com) — gratuit

– Essayez chacun pendant une semaine

Étape 2 : Comprendre votre cas d’utilisation

– Que souhaitez-vous accomplir ?

– Précision ou vitesse plus importante ?

– Budget ?

Étape 3 : Mettre à niveau si nécessaire

– ChatGPT Plus (20 $/mois) pour les fonctionnalités utilisateur avancées

– Claude.ai Plus (20$/mois) pour un travail sérieux

– Accès API pour les applications

Étape 4 : Découvrez l’ingénierie des invites

– Suivre un cours gratuit (deeplearning.ai)

– Expérimentez avec différents styles d’invite

– Rejoignez les communautés (r/ChatGPT, forums Anthropic)

Étape 5 : Comprendre les limites

– Vérifier les faits de manière indépendante

– Ne faites pas trop confiance aux résultats

– Apprenez quand NE PAS utiliser les LLM

Ressource : commencez sur learnai.sk/goto/skool/learnai pour des cours complets sur les bases de l’IA.

Conclusion

Les grands modèles linguistiques sont passés du statut de curiosité de recherche à celui d’infrastructure essentielle. Des milliards de personnes interagissent quotidiennement avec eux, souvent sans s’en rendre compte. Comprendre leur fonctionnement (et, surtout, leurs limites) devient aussi important que comprendre comment utiliser les moteurs de recherche.

Ce que nous avons couvert :

– Les LLM prédisent les jetons de texte à l’aide d’architectures de transformateur avec auto-attention

– Ils sont formés via une pré-formation sur des corpus de textes massifs, puis affinés et optimisés grâce aux retours humains

– Les modèles phares de 2026 (GPT-5, Claude Opus, Gemini 1.5, Llama 4) servent différents cas d’utilisation

– Les applications concrètes couvrent les soins de santé, le droit, les ventes, le contenu, l’éducation et le service client

– Les limitations critiques incluent les hallucinations, les connaissances obsolètes et le manque de réelle compréhension

– L’efficacité dépend de la manière dont vous les utilisez via des invites détaillées et une vérification appropriée

– L’avenir s’oriente vers des systèmes multimodaux, des capacités agents et une précision améliorée

L’essentiel : les LLM sont des outils de transformation et ne remplacent pas le jugement humain. Il est préférable de les utiliser comme outils d’accélération par des personnes qui comprennent leurs forces et leurs limites.

Que vous soyez un étudiant qui découvre l’IA, un professionnel évaluant des LLM pour votre lieu de travail ou une personne curieuse de connaître la technologie qui remodèle le travail de l’information, les principes de ce guide s’appliquent. Commencez à expérimenter, restez sceptique quant aux résultats et concentrez-vous sur l’augmentation de vos capacités plutôt que de renoncer à la prise de décision au profit de l’IA.

Prêt à approfondir ? Découvrez les cours d’IA structurés sur learnai.sk/goto/skool/learnai pour développer votre expertise en matière d’apprentissage automatique, d’ingénierie rapide et d’applications d’IA.

Ressources supplémentaires

- Documentation OpenAI GPT

- Documentation de l’API Anthropic Claude

- Documentation Google sur l’IA

- Documentation Meta Llama

- Documentation Mistral IA

- Cours LLM sur les câlins

- Cours de courte durée DeepLearning.AI

Nombre de mots : 4 847 mots