Outils de stratégie d’IA pour les développeurs

Si vous êtes un développeur et que vous essayez de déterminer la place de l’IA dans votre flux de travail, votre carrière ou votre entreprise, le grand nombre d’outils et de frameworks peut sembler paralysant. Chaque semaine, il y a un nouveau modèle, un nouveau SDK, un nouveau mot à la mode. Le véritable défi n’est pas d’accéder à l’IA : il s’agit de savoir comment l’utiliser de manière stratégique pour créer des choses qui comptent et gagner de l’argent en le faisant.

Ce guide élimine le bruit. Nous avons examiné et comparé les principaux outils de stratégie d’IA destinés aux développeurs, couvrant tout, depuis les modèles d’API et les frameworks d’agents jusqu’aux créateurs sans code et aux plateformes de surveillance. Que vous développiez des produits basés sur l’IA, que vous automatisiez vos propres flux de travail ou que vous vous positionniez en tant qu’expert en IA, vous trouverez ici les outils et la stratégie.

Qu’est-ce que la « Stratégie d’IA » ? Cela signifie-t-il pour les développeurs ?

Avant de plonger dans les outils, clarifions ce que nous entendons par stratégie IA dans un contexte de développeur.

La stratégie d’IA ne consiste pas simplement à choisir le modèle le plus populaire ou à copier un didacticiel. Cela signifie :

- Connaître les fonctionnalités de l’IA qui s’appliquent à votre problème spécifique

- Choisir des outils qui équilibrent le coût, la rapidité et la qualité pour votre cas d’utilisation

- Créer des systèmes évolutifs, et non des expériences ponctuelles

- Comprendre comment l’IA s’intègre dans un produit ou un modèle commercial plus vaste

- Rester au courant sans suivre toutes les tendances

Les développeurs qui traitent l’IA de manière stratégique sont ceux qui décrochent des contrats mieux rémunérés, expédient les produits plus rapidement et créent des flux de revenus passifs. Les outils ci-dessous sont organisés en fonction du rôle qu’ils jouent dans une stratégie pratique d’IA.

Catégorie 1 : API du modèle de base

Le point de départ de toute stratégie d’IA consiste à accéder à un modèle de langage performant. Voici comment se comparent les principaux fournisseurs.

OpenAI (GPT-5, GPT-5.3 instantané, o3)

Idéal pour : Texte à usage général, génération de code, appels de fonctions, sorties structurées

Le produit phare actuel d’OpenAI est GPT-5 : un progrès significatif par rapport à GPT-4o, avec des performances de pointe dans les tâches de codage, de mathématiques et multimodales, et environ 80 % d’hallucinations en moins que o3 lorsque la réflexion est activée. Pour les tâches quotidiennes sensibles à la vitesse, GPT-5.3 Instant est le modèle par défaut. o3 et o3-pro restent les références pour un raisonnement approfondi, commettant 20 % d’erreurs en moins que o1 sur des tâches complexes du monde réel. La variante GPT-5.3-Codex est le modèle de codage agent le plus performant disponible aujourd’hui.

- Tarifs : les tarifs GPT-5 varient selon le niveau ; GPT-5.3 Instant est le modèle quotidien optimisé en termes de coûts

- Atouts : Fiabilité, écosystème massif, appels d’outils/fonctions, codage agent avec Codex

- Faiblesses : la gestion rapide des versions rend difficile l’identification d’un modèle stable à long terme

- Adéquation stratégique : idéal pour les applications de production nécessitant une fiabilité maximale et des fonctionnalités étendues

Anthropique (Claude Opus 4.6, Sonnet 4.6, Haiku 4.5)

Idéal pour : Contexte long, raisonnement, applications sensibles à la sécurité, traitement de documents

La gamme actuelle d’Anthropic est dirigée par Claude Opus 4.6 (publié en février 2026), qui surpasse GPT-5.2 d’environ 144 points Elo sur GDPval-AA et propose une fenêtre contextuelle de 1 million de jetons en version bêta. Claude Sonnet 4.6est la nouvelle solution par défaut pour la plupart des utilisateurs, réduisant considérablement l’écart avec Opus tout en restant très rentable. Claude Haiku 4.5 reste l’un des modèles les plus rapides et les moins chers disponibles partout. Tous les modèles présentent des spécifications d’utilisation d’outils claires et un excellent suivi des instructions.

- Prix : Claude Haiku 4.5 à 0,25 $/1 million de jetons d’entrée est extrêmement compétitif

- Atouts : Contexte de 1 million de jetons (Opus), analyse de documents exceptionnelle, suivi d’instructions nuancées

- Faiblesses : écosystème tiers plus petit qu’OpenAI

- Ajustement stratégique : idéal pour les pipelines contenant beaucoup de documents, les systèmes RAG ou les flux de travail complexes en plusieurs étapes

Google Gemini (3.1 Pro, 3.1 Flash Lite)

Idéal pour : les tâches multimodales, l’intégration de Google Workspace et le traitement de gros volumes

Le produit phare actuel de Google est Gemini 3.1 Pro (sorti en février 2026), avec un raisonnement multimodal puissant pour le texte, les images, l’audio et la vidéo. Pour les charges de travail sensibles aux coûts, Gemini 3.1 Flash Lite (sorti en mars 2026) est remarquablement performant : au prix de seulement 0,25 $/1 million de jetons d’entrée, il est 2,5 fois plus rapide que son prédécesseur et surpasse GPT-5 mini et Claude Haiku 4.5 sur plusieurs tests tout en prenant en charge une fenêtre contextuelle de 1 million de jetons.

- Tarif : Gemini 3.1 Flash Lite à 0,25 $/1 million de jetons d’entrée et 1,50 $/1 million de jetons de sortie

- Atouts : fenêtre contextuelle massive, niveau Flash Lite multimodal et ultra-rapide, écosystème Google

- Faiblesses : l’écosystème d’API continue de rattraper OpenAI

- Adéquation stratégique : excellent pour les pipelines riches en médias, à haut débit ou sensibles aux coûts

Meta Llama 4 (via Groq, Together AI, Ollama)

Idéal pour : Applications sensibles aux coûts, déploiement sur site, réglage fin

Llama 4 est la gamme actuelle de poids ouverts de Meta. Llama 4 Scout (17 B de paramètres actifs, 16 experts) s’adapte à un seul GPU H100 et offre une fenêtre contextuelle de 10 millions de jetons, leader du secteur. Llama 4 Maverick (17 B paramètres actifs, 128 experts) bat GPT-4o et Gemini 2.0 Flash sur les principaux benchmarks tout en restant totalement ouvert. Les deux sont nativement multimodaux. Les exécuter via Groq donne une inférence quasi instantanée ; l’exécution locale via Ollama signifie un coût d’API nul.

- Tarifs : gratuit pour une exécution locale ; Les tarifs cloud Groq/Together AI sont très compétitifs

- Atouts : pondérations ouvertes, nativement multimodal, contexte 10 M (Scout), entièrement paramétrable, zéro fuite de données

- Faiblesses : nécessite une infrastructure GPU pour s’auto-héberger à grande échelle

- Adéquation stratégique : idéal pour les applications axées sur la confidentialité, les tâches à volume élevé où le coût est primordial et les équipes souhaitant un contrôle total du modèle.

Catégorie 2 : Frameworks d’agents IA

Si un seul appel LLM est un marteau, un framework d’agent IA est une boîte à outils complète. Il s’agit des plates-formes et des bibliothèques qui vous permettent de créer des flux de travail d’IA autonomes et en plusieurs étapes.

LangChaîne

Le framework open source le plus largement adopté pour créer des applications LLM. LangChain fournit des abstractions pour les chaînes, les agents, la mémoire et l’utilisation des outils. Il s’intègre à pratiquement toutes les principales bases de données de modèles et de vecteurs.

- Langue : Python & JavaScript

- Idéal pour : le prototypage rapide, l’apprentissage et les pipelines RAG

- Attention : à la complexité de l’abstraction ; peut devenir lourd en production ; changements fréquents de rupture

- Utilisation stratégique : utilisez LangChain pour créer rapidement un prototype ; migrez vers un code plus léger une fois que votre architecture est claire

LangGraph

Construit sur LangChain, LangGraph ajoute un modèle d’exécution basé sur des graphes pour les agents complexes avec des cycles, des branchements et une persistance d’état. C’est la référence en matière de systèmes multi-agents de production.

- Idéal pour : workflows multi-agents, systèmes human-in-the-loop, agents avec état

- Pourquoi c’est important :La plupart des vrais produits d’IA ont besoin de plus qu’une chaîne linéaire : ils ont besoin d’une logique de branchement et de la capacité de revenir en arrière.

- Utilisation stratégique : si votre agent a besoin de « réfléchir » ; en plusieurs étapes ou en collaboration avec d’autres agents, LangGraph est votre framework

AutoGen (Microsoft)

AutoGen permet à plusieurs agents IA de converser entre eux pour effectuer des tâches complexes. Un agent peut écrire du code ; un autre le passe en revue ; un troisième exécute des tests. C’est particulièrement utile pour les assistants de codage et les outils de recherche.

- Idéal pour : Collaboration multi-agents, génération et révision automatisées de code

- Atouts : outils puissants pour les cas d’utilisation des développeurs ; bon pour décomposer des tâches complexes

- Utilisation stratégique : excellent pour les outils de développement internes ou les produits où la génération de code est la valeur fondamentale

CrewAI

CrewAI est un framework de niveau supérieur pour les systèmes multi-agents, mettant l’accent sur les agents basés sur des rôles organisés en « équipages ». Il est plus avisé que LangGraph et plus rapide à mettre en œuvre.

- Idéal pour : créer des produits rapidement ; orchestration d’agents non conviviale

- Atouts : Rapide à prototyper ; structure de code lisible ; communauté active

- Utilisation stratégique : à utiliser lorsque vous souhaitez expédier rapidement ; pensez à LangGraph si vous avez besoin de plus de contrôle

SDK Vercel IA

Pour les développeurs JavaScript/TypeScript créant des applications Web, le SDK Vercel AI est le moyen le plus propre de diffuser des réponses, de gérer les appels d’outils et d’intégrer l’IA dans Next.js et d’autres frameworks frontaux.

- Idéal pour : les développeurs d’applications Web ; interfaces utilisateur de diffusion en continu ; Intégration Next.js

- Utilisation stratégique : si votre produit dispose d’une interface de chat ou d’une interface utilisateur basée sur l’IA, il s’agit de l’option la plus ergonomique de l’écosystème JS.

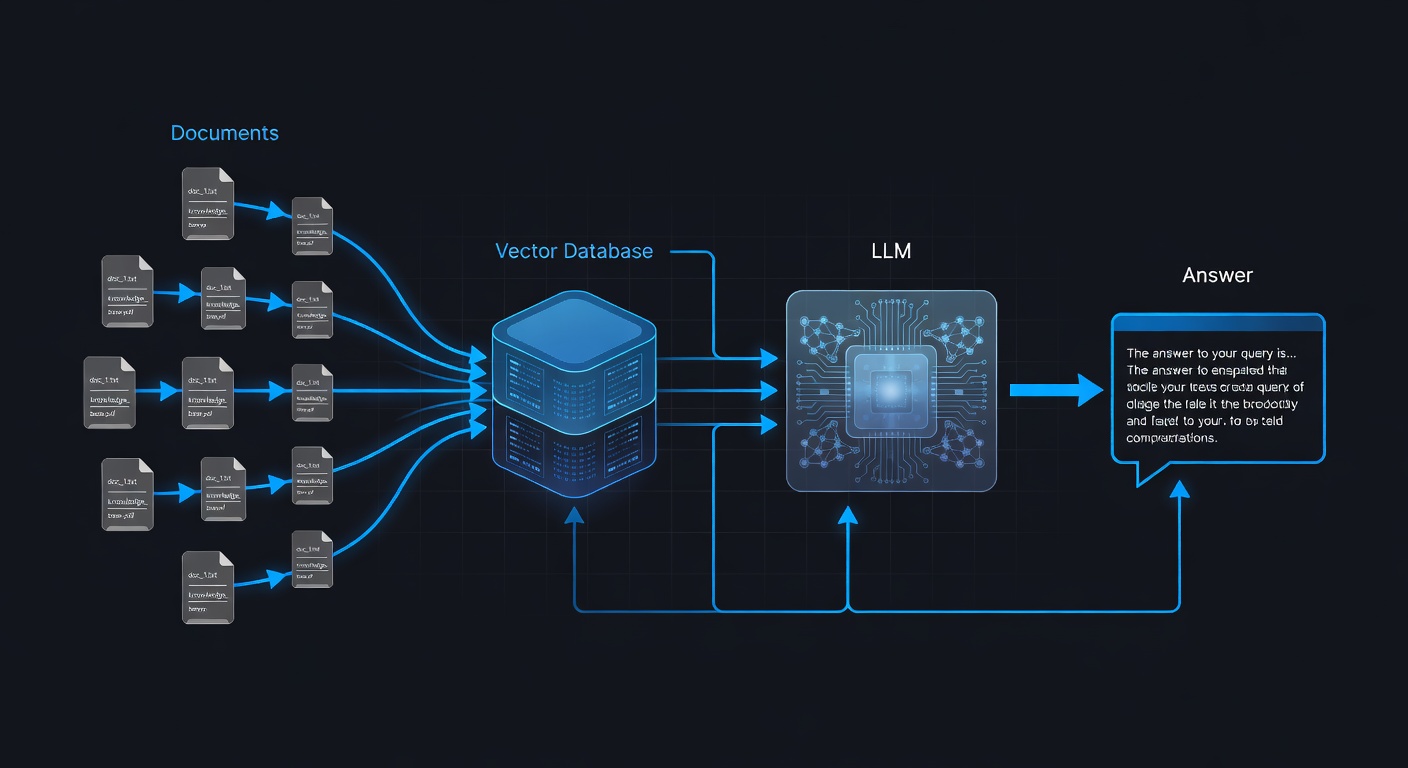

Catégorie 3 : bases de données vectorielles et infrastructure RAG

La génération augmentée par récupération (RAG) est l’architecture qui permet à l’IA de répondre à des questions basées sur vos propres données. Une base de données vectorielles est l’épine dorsale de tout système RAG.

Pomme de pin

La base de données vectorielles gérée la plus mature. Pinecone gère l’indexation, les requêtes et la mise à l’échelle sans que vous ayez à gérer l’infrastructure. Il s’intègre parfaitement à LangChain, LlamaIndex et à la plupart des frameworks d’agents.

- Tarifs : niveau gratuit disponible ; commence à évoluer à 70 $/mois pour la production

- Idéal pour : les systèmes RAG de production pour lesquels vous ne souhaitez pas gérer l’infrastructure

- Utilisation stratégique : si vous créez un produit avec RAG au cœur, Pinecone vous permet de vous concentrer sur la couche d’application.

Tisser

Une base de données vectorielles open source avec une excellente recherche hybride intégrée (combinant recherche sémantique et recherche par mots clés). Peut être auto-hébergé ou utilisé comme service cloud géré.

- Idéal pour : la recherche hybride, l’architecture mutualisée et le filtrage complexe

- Utilisation stratégique : bon choix lorsque vous avez besoin d’une recherche à la fois sémantique et par mot clé, ou lorsque l’auto-hébergement est important

Chrome

L’option la plus simple pour commencer. Chroma est une base de données vectorielles légère et open source qui s’exécute en mémoire ou persiste sur le disque. Idéal pour le développement et la production à petite échelle.

- Idéal pour : l’apprentissage, le prototypage et les applications à petite échelle

- Utilisation stratégique : commencez ici ; migrez vers Pinecone ou Weaviate à mesure que vos données évoluent

Pgvecteur Supabase

Si vous êtes déjà sur Postgres (par exemple via Supabase), pgvector vous propose une recherche vectorielle sans ajouter un autre service. Assez bien pour la plupart des applications qui ne disposent pas de millions de vecteurs.

- Idéal pour : les utilisateurs Postgres existants ; garder la pile simple

- Utilisation stratégique : si vous utilisez Supabase ou Postgres, il s’agit du chemin le plus simple vers RAG.

Catégorie 4 : Observabilité et évaluation de l’IA

L’un des aspects les plus négligés de la stratégie d’IA est de savoir si votre système fonctionne réellement. Les outils d’observabilité vous aident à surveiller, déboguer et améliorer vos produits d’IA au fil du temps.

LangSmith

Plateforme d’observabilité de LangChain. LangSmith trace chaque étape de votre chaîne ou de votre agent, affiche l’utilisation des jetons, la latence et les erreurs, et vous permet d’exécuter des évaluations sur des ensembles de données de test.

- Idéal pour : les équipes utilisant LangChain/LangGraph

- Pourquoi c’est important : le débogage d’un agent multi-étapes sans trace n’est qu’une hypothèse.

- Utilisation stratégique : Indispensable si vous expédiez un produit basé sur LangChain

Braintrust

Une plateforme d’évaluation indépendante du modèle. Braintrust vous permet d’exécuter des expériences, de comparer des modèles et de suivre les performances au fil du temps à l’aide de marqueurs personnalisés et d’évaluations notées par l’IA.

- Idéal pour : les équipes itérant sur des invites et comparant des modèles

- Utilisation stratégique : si vous êtes sérieux en matière d’ingénierie rapide et souhaitez que les données soutiennent vos décisions

Hélicone

Une couche d’observabilité basée sur un proxy qui fonctionne avec n’importe quelle API compatible OpenAI. Ajoutez une ligne de code et bénéficiez d’une journalisation complète des demandes, du suivi des coûts, de la mise en cache et de la limitation du débit.

- Idéal pour : Installation rapide ; fonctionne avec n’importe quel modèle

- Utilisation stratégique : le moyen le plus simple d’obtenir une visibilité sur l’utilisation et les coûts de votre API sans modifier votre architecture

Catégorie 5 : Constructeurs d’IA sans code et low-code

Tous les éléments de votre stratégie d’IA ne nécessitent pas l’écriture de code. Ces outils vous permettent de créer et de tester des workflows d’IA plus rapidement.

n8n

Un outil d’automatisation de workflow open source avec une prise en charge croissante des nœuds IA. Connectez les modèles d’IA aux bases de données, aux API, aux plates-formes de messagerie et bien plus encore, grâce à un générateur de flux de travail visuel.

- Idéal pour : l’automatisation des processus métier ; intégrer l’IA aux outils existants

- Utilisation stratégique : excellent pour créer des outils internes ou des automatisations client sans code personnalisé

Flowise

Un générateur LangChain visuel open source. Glissez-déposez des chaînes, des agents et des composants de mémoire pour prototyper des applications d’IA sans écrire de code.

- Idéal pour : le prototypage ; non-développeurs qui comprennent les concepts de l’IA

- Utilisation stratégique : idéal pour tester rapidement une architecture avant de l’implémenter dans le code

Difier

Un outil de création d’applications d’IA plus perfectionné et axé sur les produits. Dify prend en charge RAG, les flux de travail des agents et la gestion des modèles avec une interface utilisateur claire. Il peut être auto-hébergé ou utilisé comme service cloud.

- Idéal pour : créer rapidement des outils internes basés sur l’IA ; équipes sans ressources d’ingénierie approfondies

- Utilisation stratégique : si vous créez des produits pour des clients non techniques, Dify peut réduire considérablement votre temps de développement.

Catégorie 6 : Productivité des développeurs et outils de codage de l’IA

Votre propre productivité fait partie de votre stratégie d’IA. Ces outils vous aident à créer plus rapidement.

Copilote GitHub

Toujours l’assistant de codage IA le plus largement adopté. Copilot complète automatiquement le code, explique les fonctions, écrit des tests et s’intègre dans VS Code, JetBrains et d’autres éditeurs.

- Tarifs : 10 $/mois individuel ; 19 $/mois Entreprise

- Utilisation stratégique : si vous n’utilisez pas d’assistant de codage IA, vous êtes plus lent que vos concurrents

Curseur

Un fork de VS Code avec une IA profondément intégrée. Le curseur vous permet de discuter avec votre base de code, d’appliquer des modifications multi-fichiers et d’utiliser des modèles comme Claude et GPT-4o directement dans l’éditeur. De nombreux développeurs le considèrent comme un cran au-dessus de Copilot.

- Tarif : 20 $/mois pour Pro

- Utilisation stratégique : si vous envisagez sérieusement le développement assisté par l’IA, la connaissance contextuelle de Cursor est un multiplicateur de productivité.

Aide

Un assistant de codage en ligne de commande open source qui fonctionne directement avec votre dépôt Git. Aider envoie des différences au modèle et applique automatiquement les modifications, ce qui est utile pour la refactorisation automatisée et les modifications de code scriptées.

- Idéal pour : les utilisateurs expérimentés ; refactoring automatisé à grande échelle ; Intégration CI/CD

- Utilisation stratégique :Associez-vous à LLaMA sur Ollama pour un développement assisté par IA sans coût

Construire votre stratégie d’IA : un cadre pour les développeurs

Avec autant d’outils disponibles, la question n’est pas de savoir quels sont les meilleurs outils ; dans l’abstrait, il s’agit de « quelle combinaison sert mes objectifs spécifiques ».

Voici un cadre pratique :

Étape 1 : Définissez votre objectif

Voulez-vous créer un produit, automatiser un service ou améliorer vos compétences ? Votre objectif détermine votre sélection d’outils. Un freelance qui automatise les flux de travail des clients a besoin d’outils différents de ceux d’un développeur qui crée un produit SaaS.

Étape 2 : Commencer simplement

Ne construisez pas trop. Un seul appel API OpenAI et une bonne invite peuvent résoudre un nombre surprenant de problèmes. Recherchez des frameworks et des bases de données lorsque votre cas d’utilisation les nécessite réellement.

Étape 3 : Tout mesurer

Sans observabilité, vous volez à l’aveugle. Ajoutez LangSmith, Helicone ou Braintrust dès le premier jour. Connaissez les coûts de vos jetons, la latence et les taux d’échec.

Étape 4 : itérer sur les invites avant l’architecture

La plupart des problèmes de qualité de l’IA sont des problèmes rapides. Avant de refactoriser votre architecture, investissez dans une ingénierie rapide. De petites modifications rapides peuvent doubler la qualité sans aucun coût supplémentaire.

Étape 5 : Monétiser rapidement

La meilleure stratégie d’IA inclut un chemin vers des revenus. Que vous proposiez un service d’IA à vos clients, que vous construisiez un outil produit ou que vous créiez du contenu autour de votre expertise en IA, commencez à penser à la monétisation dès la première semaine. La page pilier Comment gagner de l’argent avec l’IA sur learnAI couvre ce sujet en profondeur.

Étape 6 : Restez modulaire

Le paysage de l’IA change chaque mois. Construisez votre système de manière à pouvoir échanger des modèles et des fournisseurs sans réécrire votre logique de base. Cela signifie utiliser des abstractions (comme l’interface de modèle de LangChain) et ne jamais coder en dur le code spécifique au fournisseur dans votre logique métier.

Tableau récapitulatif de comparaison

Modèles de stratégie d’IA du monde réel pour les développeurs

Comprendre les outils est une chose, savoir comment ils se combinent dans la pratique en est une autre. Voici trois modèles que les développeurs expérimentés utilisent régulièrement.

Le modèle de produit RAG

Créez une base de connaissances à partir des documents d’un client (PDF, wikis, bases de données), regroupez-les et intégrez-les dans un magasin de vecteurs (Chroma pour le prototypage, Pinecone pour la production) et servez une interface de discussion optimisée par Claude ou GPT-4o. Ce modèle à lui seul alimente des dizaines de produits d’IA rentables, des robots de support client aux assistants de connaissances internes. Pile : Claude + Pinecone + LangChain + Vercel AI SDK.

Le modèle d’agence d’automatisation

Utilisez n8n ou Make.com pour relier les appels de modèles d’IA aux outils existants du client (CRM, e-mail, Slack, feuilles de calcul). Le développeur écrit une logique d’invite légère et connecte les tuyaux. Le client bénéficie de flux de travail automatisés ; vous obtenez une provision récurrente. Il s’agit de l’un des moyens les plus rapides de générer des revenus pour les développeurs qualifiés en IA. Pile : n8n + API OpenAI + outils existants du client.

Le modèle SaaS augmenté par l’IA

Prenez une catégorie SaaS existante (gestion de projet, outils d’écriture, CRM) et ajoutez une couche d’intelligence artificielle qui rend le produit considérablement plus utile. Vous n’êtes pas en compétition sur les fonctionnalités, vous êtes en compétition sur l’intelligence. Utilisez Cursor pour créer rapidement, LangGraph pour la logique de l’agent et LangSmith pour surveiller la qualité. Pile : Curseur + LangGraph + LangSmith + n'importe quel modèle de fondation.

Questions fréquemment posées

Dois-je choisir un modèle de fondation et m’y tenir ?

Pas du tout. La plupart des systèmes d’IA matures utilisent stratégiquement plusieurs modèles : un modèle moins cher et plus rapide pour les tâches simples et un modèle plus performant pour le raisonnement complexe. L’abstraction de vos appels de modèle via une interface unifiée facilite la gestion.

LangChain vaut-il encore la peine d’être appris en 2026 ?

Oui, mais avec nuance. LangChain est utile pour apprendre des concepts et construire rapidement. Pour les systèmes de production, de nombreux développeurs migrent vers des implémentations plus légères ou vers LangGraph pour l’orchestration des agents. Comprendre LangChain vous aide à comprendre l’écosystème.

Comment puis-je garder le contrôle de mes coûts d’API IA ?

Utilisez l’observabilité dès le premier jour (Helicone est le plus simple à ajouter). Mettez en cache les requêtes identiques ou presque identiques. Utilisez des modèles plus petits et moins chers pour les tâches de routine et réservez les modèles coûteux pour un raisonnement véritablement complexe. Ajoutez une limitation de débit pour éviter des coûts incontrôlables.

Dois-je héberger moi-même mes modèles ou utiliser des API ?

Pour la plupart des développeurs, les API gérées constituent le bon point de départ : une surcharge opérationnelle réduite, aucun coût GPU et une itération plus rapide. L’auto-hébergement est judicieux lorsque vous avez un volume élevé (pour réduire les coûts par appel), des exigences strictes en matière de confidentialité des données ou que vous avez besoin d’affiner des données propriétaires.

Conclusion

La stratégie d’IA pour les développeurs ne consiste pas à disposer du plus grand nombre d’outils : il s’agit plutôt de choisir les bons outils, de les combiner intelligemment et de proposer des éléments qui créent une réelle valeur. Les développeurs qui gagnent actuellement sont ceux qui ont dépassé le stade de l’expérimentation avec l’IA. dans la création de systèmes et de produits reproductibles.

Commencez avec un objectif clair. Choisissez un modèle de fondation. Ajoutez de l’observabilité avant d’en avoir besoin. Construisez de manière modulaire. Et n’arrêtez jamais d’apprendre : le paysage continuera de changer, mais les fondamentaux solides s’accumulent.

Prêt à apprendre l’IA ? Rejoignez la communauté learnAI → communauté learnAI Skool