¿Qué son los modelos de lenguajes grandes (LLM)? Explicación completa

Tiempo de lectura: 22 minutos

Actualizado: marzo de 2026

Introducción

Miles de millones de personas utilizan modelos de lenguaje grandes todos los días, desde ChatGPT y Claude hasta Gemini de Google y Llama de Meta. Probablemente hayas interactuado con uno sin siquiera darte cuenta. Sin embargo, la mayoría de los usuarios no tienen idea de cómo funcionan realmente estos sistemas o qué los diferencia de los motores de búsqueda tradicionales y la IA.

¿El problema? Los LLM se han integrado tan perfectamente en nuestra vida digital que su poder, limitaciones y capacidades siguen siendo un misterio para la persona promedio. Esta brecha de conocimiento genera expectativas poco realistas y oportunidades perdidas.

La promesa de esta guía es simple: explicar los modelos de lenguajes grandes desde sus primeros principios, cubriendo todo, desde cómo se entrenan hasta lo que pueden y no pueden hacer, completo con ejemplos del mundo real y puntos de referencia actuales a partir de 2026.

Al final de este artículo, comprenderá:

– Qué es realmente un LLM y en qué se diferencia de otras IA

– La arquitectura transformadora que impulsa los LLM modernos

– Cómo las empresas entrenan estos modelos a escalas de miles de millones de dólares

– Los modelos más grandes disponibles hoy en día y sus especificaciones

– Más de 15 aplicaciones del mundo real que transforman industrias

– Las duras limitaciones de los LLM actuales

– Mejores prácticas para utilizarlos de forma eficaz

Vamos a sumergirnos.

Tabla de contenidos

- ¿Qué es un LLM? La definición simple

- Cómo funcionan los LLM: la arquitectura de transformadores explicada de forma sencilla

- Cómo se capacitan los LLM: capacitación previa, ajuste y RLHF

- Los mayores LLM en 2026: GPT-4o, Claude 3.5, Gemini 1.5, Llama 3, Mistral

- Qué pueden hacer los LLM: 15 aplicaciones del mundo real

- Lo que los LLM no pueden hacer: limitaciones y alucinaciones

- LLM frente a IA tradicional frente a motores de búsqueda

- Cómo utilizar los LLM de forma eficaz: consejos prácticos

- El futuro de los LLM: lo que vendrá en 2026 y más allá

- Preguntas frecuentes: respuestas a sus preguntas sobre los LLM

¿Qué es un LLM? La definición simple

Un modelo de lenguaje grande (LLM) es un sistema de inteligencia artificial entrenado con grandes cantidades de datos de texto para comprender y generar el lenguaje humano.

Esto es lo que eso significa en la práctica:

El concepto central

Un LLM funciona prediciendo la siguiente palabra (o «token», una pequeña parte del lenguaje) en una secuencia. Cuando escribe un mensaje como «Explique la computación cuántica en términos simples», el LLM lee su entrada y luego genera una respuesta adecuada, un token a la vez, prediciendo siempre lo que sucederá a continuación en función de los patrones que aprendió durante el entrenamiento.

Considérelo como una función de autocompletar extremadamente sofisticada, similar a cómo su teléfono sugiere la siguiente palabra a medida que escribe. Pero en lugar de hacer predicciones basadas en unos pocos miles de documentos, los LLM se capacitan en billones de tokens extraídos de libros, sitios web, artículos académicos, repositorios de códigos y otras fuentes de texto.

Características clave

Grande: Los LLM modernos contienen miles de millones o incluso billones de parámetros (valores matemáticos que codifican patrones del lenguaje). GPT-5 tiene más de 10 billones de parámetros. Los modelos más grandes generalmente funcionan mejor pero requieren más potencia computacional.

Idioma: los LLM se especializan en comprender y generar lenguaje basado en texto. Los modelos más nuevos (2026) también pueden procesar imágenes, audio y vídeo junto con texto, haciéndolos multimodales.

Modelo:Un LLM es una red neuronal, una estructura matemática inspirada en cómo se conectan las neuronas biológicas. Estas redes aprenden ajustando millones de parámetros mediante el entrenamiento, de forma similar a cómo el cerebro fortalece las conexiones neuronales mediante el aprendizaje.

Ejemplo rápido

Pregunta: “¿Qué es la fotosíntesis?”

Qué hace el LLM:

1. Tokeniza tu entrada (la divide en pedazos)

2. Procesa cada token a través de capas transformadoras (se explica a continuación)

3. Predice el siguiente token más probable: “Fotosíntesis”

4. Luego predice lo siguiente: “es”

5. Entonces: “el”

6. Y así sucesivamente hasta completar una respuesta coherente

Conclusión clave: Un LLM es una red neuronal entrenada en cantidades masivas de texto para predecir patrones lingüísticos y generar respuestas similares a las humanas.

Cómo funcionan los LLM: la arquitectura de transformadores explicada de forma sencilla

El avance que hizo posibles los LLM modernos fue la arquitectura Transformer, introducida en 2017 en un artículo titulado «La atención es todo lo que necesitas».

Comprender los transformadores es clave para comprender por qué los LLM son tan poderosos.

El problema de los transformadores resueltos

Antes de los transformadores, los investigadores de IA utilizaban arquitecturas llamadas RNN (redes neuronales recurrentes) que procesaban texto palabra por palabra, de forma secuencial. Este enfoque tenía una debilidad crítica: les costaba recordar palabras distantes en pasajes largos. Si tuviera una oración con 50 palabras, el modelo tendría dificultades para recordar cuál era la primera palabra cuando procesó la palabra número 50.

Los transformadores resolvieron esto con un mecanismo inteligente llamado autoatención.

Autoatención: la innovación central

La autoatención permite que el modelo observe todas las palabras de una oración simultáneamente y comprenda qué palabras son más importantes para comprender otras palabras.

Aquí tienes un ejemplo concreto:

Frase: “El ejecutivo del banco se sentó a la orilla del río.”

Al procesar la palabra “banco” (primera aparición), el modelo utiliza la atención propia para preguntar: “¿Qué otras palabras de esta oración son más relevantes para comprender esta palabra?” Descubre que «executive» y «sat» son pistas de contexto importantes que sugieren que se trata de una institución financiera.

Al procesar el segundo «banco», la autoatención del modelo se da cuenta de que «río» es la pista clave del contexto, lo que indica que estamos hablando de una ubicación geográfica.

Este procesamiento paralelo de todos los tokens a la vez, más la capacidad de sopesar la importancia de los tokens distantes, es lo que hace que los transformadores sean tan efectivos.

La tubería completa de transformadores

Así es como fluye el texto a través de un modelo transformador:

El texto ingresado se divide en tokens: pequeños fragmentos que representan palabras o subpalabras. La frase “Hola mundo” podría convertirse en tokens [101, 7592, 2088] (números que representan cada pieza).

Cada token se convierte en un vector (una lista de números) que capta el significado. El token de «hola» se convierte en algo así como [0.2, -0.5, 0.8, 1.2,…] con cientos o miles de dimensiones.

Dado que los transformadores procesan todos los tokens a la vez, necesitan conocer el orden de las palabras. Se agregan codificaciones posicionales especiales a cada incorporación para indicarle al modelo en qué parte de la secuencia aparece cada token.

La incrustación pasa a través de múltiples capas de transformador (los modelos modernos usan entre 40 y 100 capas). Cada capa contiene:

– Atención multicabezal: múltiples mecanismos de autoatención que se ejecutan en paralelo, cada uno de los cuales se centra en diferentes aspectos del lenguaje

– Red de retroalimentación: una red neuronal simple que procesa cada token de forma independiente

– Normalización de capas y conexiones residuales: Técnicas que estabilizan el entrenamiento

Después de pasar por todas las capas, la incrustación final se vuelve a convertir en una distribución de probabilidad sobre todos los tokens posibles. El modelo selecciona el siguiente token más probable (o muestra uno usando varias estrategias) y lo agrega a la salida.

El token recién generado se retroalimenta como entrada y el proceso se repite. Este enfoque «autoregresivo», donde la salida se convierte en la nueva entrada, continúa hasta que el modelo genera un token de parada o alcanza un límite de longitud.

Por qué funciona esta arquitectura

Los transformadores son poderosos porque pueden:

– Secuencias de procesos en paralelo en lugar de secuencialmente, lo que hace que el entrenamiento sea más rápido

– Aprender dependencias de largo alcance a través de la atención propia, recordando el contexto relevante en documentos largos

– Transferir el aprendizaje de forma eficaz para que un modelo previamente entrenado en una tarea pueda funcionar bien en diferentes tareas

– Escale de manera efectiva con más parámetros, más datos y más potencia computacional, lo que generalmente mejora el rendimiento

Conclusión clave: La arquitectura del transformador utiliza la autoatención para permitir que los modelos sopesen la importancia de diferentes palabras simultáneamente, lo que les permite comprender el contexto y generar texto coherente de formato largo.

Cómo se forman los LLM: formación previa, ajuste y RLHF

La creación de un LLM requiere tres fases de formación distintas. Comprender este proceso revela por qué los LLM son tan caros y por qué tienen ciertas fortalezas y debilidades.

Fase 1: Preformación (La Fundación)

El preentrenamiento es donde se produce la potencia computacional bruta. Esto es lo que ocurre:

El proceso:

1. Las empresas recopilan billones de tokens de diversas fuentes: libros, sitios web, artículos académicos, repositorios de códigos, artículos de noticias y otros textos públicos

2. El modelo se entrena con un objetivo simple: dados N tokens, predecir el (N+1)ésimo token

3. La capacitación utiliza clústeres informáticos masivos (a menudo, más de 10 000 GPU) que se ejecutan durante semanas o meses

4. Miles de millones de pasos de entrenamiento ajustan gradualmente los parámetros del modelo

El costo:

– La formación de GPT-5 costó aproximadamente entre 500 millones y más de mil millones de dólares en recursos computacionales (estimaciones para 2026)

– Consumo de energía: entrenar modelos grandes consume suficiente electricidad para alimentar ciudades pequeñas

– Tiempo de entrenamiento: semanas a meses de cálculo continuo

Lo que aprende el modelo:

Durante el preentrenamiento, el modelo absorbe:

– Patrones de lenguaje y gramática

– Conocimiento fáctico (lo que se lee en los datos de entrenamiento)

– Patrones de razonamiento y enfoques de resolución de problemas

– Código, matemáticas y conocimientos especializados

– Sesgos presentes en sus datos de entrenamiento

Limitaciones del entrenamiento previo solo:

Un modelo previamente entrenado, si bien es capaz, aún no está optimizado para ser útil para los usuarios. Podría:

– Completar texto de forma poco natural (imitando patrones de datos de entrenamiento)

– Generar contenido dañino si apareció en los datos de entrenamiento

– No seguir bien las instrucciones del usuario

– Alucinar o inventar hechos

Por eso es necesaria la Fase 2.

Fase 2: Ajuste (hacerlo útil)

El ajuste fino adapta el modelo previamente entrenado para que sea más útil, inofensivo y honesto.

Ajuste fino supervisado (SFT):

1. Las empresas contratan anotadores (evaluadores humanos) para crear ejemplos de capacitación de alta calidad

2. Cada ejemplo muestra una respuesta rápida y de alta calidad

3. El modelo aprende a imitar estas respuestas de alta calidad

4. Esta fase normalmente utiliza millones de ejemplos de capacitación (más pequeños que los previos a la capacitación)

5. Tiempo de formación: días o semanas en grupos computacionales más pequeños

Ejemplo de pareja de entrenamiento:

– Entrada: «¿Cuál es la mejor manera de aprender el aprendizaje automático?»

– Resultado ideal: «Comience con los fundamentos de álgebra lineal y estadística. Luego aprenda Python. Progrese al aprendizaje supervisado (regresión, clasificación), luego al aprendizaje no supervisado. Practique con conjuntos de datos de Kaggle…»

A través de un ajuste fino supervisado, el modelo aprende:

– Cómo estructurar las respuestas de forma profesional

– Rechazar solicitudes perjudiciales

– Seguir instrucciones de varios pasos

– Cómo desglosar temas complejos con claridad

Fase 3: Aprendizaje por refuerzo a partir de la retroalimentación humana (RLHF)

RLHF es el ingrediente secreto que hace que los LLM modernos sientan que realmente están tratando de ayudarlo.

Cómo funciona RLHF:

- Generar respuestas de candidatos: Para una pregunta, el modelo genera entre 4 y 8 respuestas posibles diferentes

- Clasificación humana: los anotadores clasifican estas respuestas de mejor a peor, considerando:

- Precisión

- Atención

- Seguridad

- Claridad

- Concisión

- Entrenar un modelo de recompensa: una red neuronal independiente aprende a predecir las preferencias humanas. Dada una respuesta, asigna una puntuación (más alta = más parecida a lo que prefieren los humanos)

- Optimizar el LLM: el LLM original se ajusta para maximizar su puntuación de recompensa, aprendiendo a generar respuestas que los humanos prefieren

- Iterar: las empresas ejecutan múltiples rondas de RLHF, mejorando continuamente la alineación

Por qué esto es importante:

RLHF explica por qué Claude se siente diferente de GPT, que a su vez se siente diferente de Géminis. Cada empresa ejecuta RLHF con preferencias, anotadores y señales de recompensa ligeramente diferentes, lo que da como resultado modelos con «personalidades» distintas.

Resumen del cronograma de capacitación

Conclusión clave: la formación LLM es un proceso de tres fases: la formación previa desarrolla la comprensión fundamental del lenguaje, el ajuste supervisado enseña a que el modelo sea útil y RLHF optimiza las preferencias humanas.

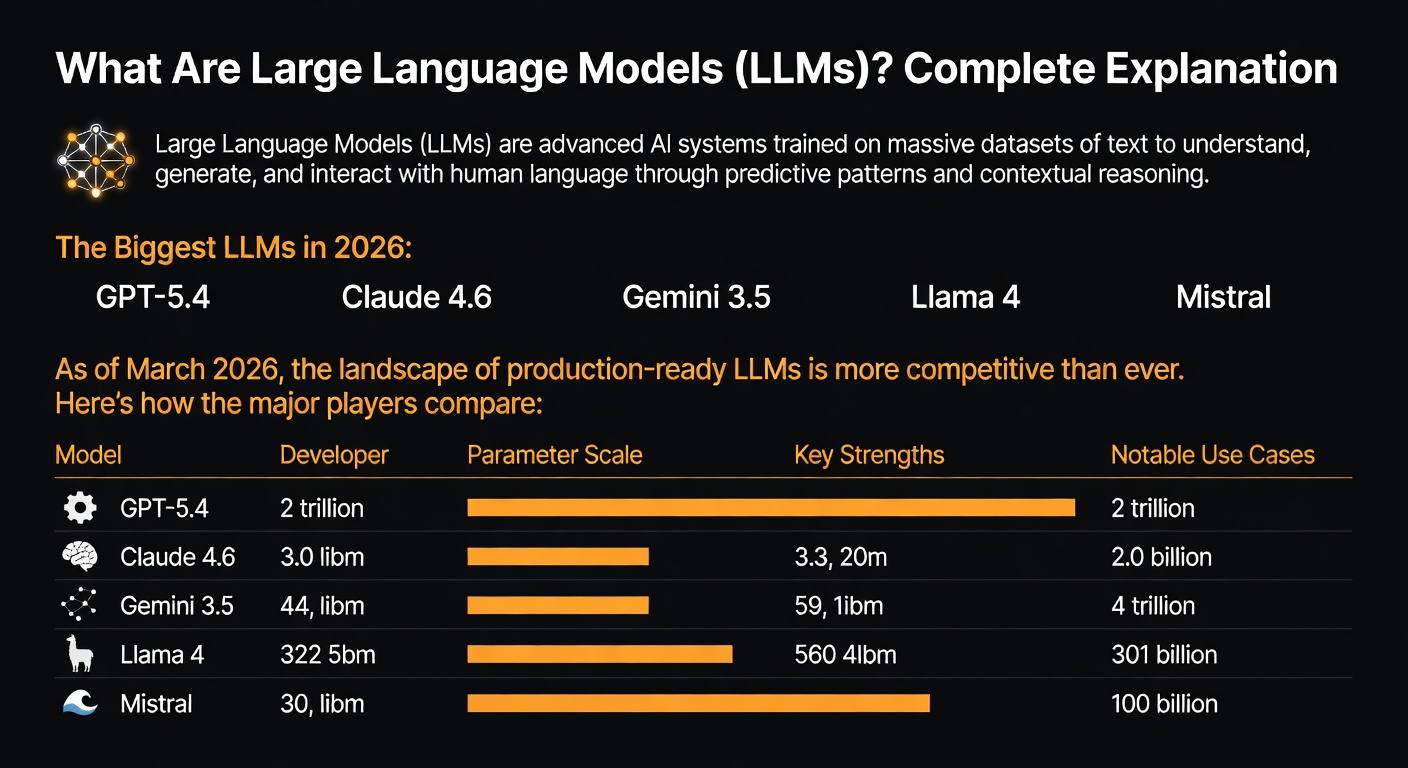

Los mayores LLM en 2026: GPT-4o, Claude 3.5, Gemini 1.5, Llama 3, Mistral

A partir de marzo de 2026, el panorama de los LLM listos para producción es más competitivo que nunca. Así es como se comparan los principales actores:

OpenAI GPT-5.4

Lanzamiento: marzo de 2026

Parámetros: más de 10 billones (estimado)

Ventana de contexto: 1.000.000 tokens (~750.000 palabras)

Características principales:

– Modelos unificados de codificación y de uso general en un único buque insignia

– Capacidad de uso nativo de la computadora (puede controlar su computadora)

– Esfuerzo de razonamiento configurable (elija velocidad versus precisión)

– Entrada multimodal nativa (texto, imágenes, vídeo en un solo mensaje)

– Rendimiento de referencia líder en la industria

Ideal para: usuarios que desean el modelo más capaz; empresas que necesitan automatización del uso de computadoras

Precio: $20/mes (Plus), $200/mes (Pro) o API de pago por uso

Documentos oficiales: Documentación de OpenAI GPT

Fortalezas:

– Puntajes de referencia más altos en la mayoría de las pruebas

– Razonamiento más sofisticado

– Más rápido en la mayoría de las tareas

– Comunidad y ecosistema más grande

Debilidades:

– Más caro de usar

– Menos transparente sobre la formación

– Requiere confianza en el sistema de código cerrado

Claude antrópico Opus 4.1

Lanzamiento: agosto de 2025

Parámetros: 2+ billones (estimado)

Ventana de contexto: 1.000.000 tokens (~750.000 palabras)

Características principales:

– IA constitucional (entrenada para ser útil, inofensiva y honesta)

– Tasas de alucinaciones extremadamente bajas entre todos los modelos

– Fuerte en análisis y razonamiento

– Excelente para seguir instrucciones detalladas

– Procesamiento nativo de PDF, imágenes y vídeos

Ideal para: Investigación, redacción detallada, análisis; los usuarios priorizan la precisión sobre la potencia bruta; trabajo creativo

Precio: $20/mes (Claude.ai Plus), $1000/mes (Claude.ai Teams) o pago por uso de API

Documentos oficiales: Documentación de Anthropic Claude

Fortalezas:

– Más confiable por su precisión

– Mejor en análisis de formato largo

– Enfoque constitucional de IA más sólido

– Ideal para tareas creativas y con matices

Debilidades:

– Ligeramente más lento que GPT en algunas tareas

– Ecosistema más pequeño que OpenAI

– Menos conocido en el mercado principal

Google Gemini 3.1 Pro

Lanzamiento: marzo de 2026

Parámetros: 1,2+ billones (estimado)

Ventana de contexto: 1.000.000 de tokens (puede procesar películas enteras en contexto)

Características principales:

– La ventana de contexto más grande de cualquier modelo comercial

– Integración perfecta con el ecosistema de Google (Workspace, Search, Android)

– Funciona como asistente de productividad y motor de investigación simultáneamente

– Multimodal con comprensión de imagen excepcional

– Acceso en tiempo real a los resultados de la Búsqueda de Google

Ideal para: usuarios habituales de Google Workspace; automatización de la productividad; necesidades de información en tiempo real

Precio: Nivel gratuito con limitaciones, $20/mes (Gemini Advanced) o pago por uso de API

Documentos oficiales: Documentación de IA de Google

Fortalezas:

– Ventana contextual masiva para el procesamiento de documentos

– Integración perfecta con Google

– Acceso a búsqueda en tiempo real

– Excelente para multimedia

– Gran comprensión de la imagen

Debilidades:

– La API puede ser más lenta que la de la competencia

– Preocupaciones de privacidad con la integración de Google

– Menos probado para algunas tareas especializadas

Meta Llama 4 (código abierto)

Lanzamiento: abril de 2025

Parámetros: 400B (Scout), 1.4T (Maverick) (versiones estándar; variantes MoE más grandes)

Ventana de contexto: 10 000 000 de tokens (Scout): la más grande de cualquier modelo

Características principales:

– Arquitectura de mezcla de expertos (MoE): solo utiliza partes relevantes del modelo por consulta

– Nativamente multimodal (texto, imágenes, vídeo)

– Código abierto: se puede ejecutar localmente o ser autohospedado

– Puntos de referencia competitivos con GPT y Gemini a 1/10 del costo

– Fuertes habilidades de codificación y razonamiento

Ideal para: desarrolladores que quieran autohospedarse; empresas que necesitan rentabilidad; organizaciones que desean un control total sobre los datos

Precio: Gratis (código abierto) o inferencia a través de proveedores como Together, Replicate ($0,50-$2 por millón de tokens)

Documentos oficiales: Documentación de Meta Llama

Fortalezas:

– Ventana contextual masiva

– Extremadamente rentable

– Sin restricciones de uso

– Puede ser autohospedado

– Fuerte relación rendimiento/coste

Debilidades:

– Requiere configuración técnica para su uso

– Menos pulido que los modelos comerciales

– Comunidad de usuarios más pequeña

– Tasas de alucinaciones ligeramente superiores a las de Claude

Mistral AI Mixtral 8x22B

Lanzamiento: abril de 2025

Parámetros: 141B (mezcla de expertos, utiliza 39B activo)

Ventana de contexto: 65.000 tokens

Características principales:

– Combinación eficiente de expertos (envía las consultas a expertos especializados)

– Código abierto y fácil de implementar

– Razonamiento excepcional para su tamaño

– Codificación y matemáticas sólidas

– Inferencia de baja latencia

Ideal para: desarrolladores que desean modelos eficientes de código abierto; aplicaciones sensibles a los costos; tareas especializadas

Precios: Inferencia gratuita (de código abierto) o económica a través de proveedores ($0,10-$0,50 por millón de tokens)

Documentos oficiales: Documentación de Mistral AI

– La mejor relación rendimiento-coste

– Lo suficientemente pequeño para dispositivos periféricos

– Código abierto y modificable

– Inferencia rápida

– Fuerte en tareas especializadas

Debilidades:

– Ventana de contexto más pequeña que los líderes

– No es tan capaz para tareas abiertas

– Tasas de alucinaciones superiores a las de los modelos fronterizos

Tabla de comparación de modelos

Conclusión clave: El mercado LLM de 2026 ofrece opciones para cada caso de uso: potencia máxima (GPT-5), máxima precisión (Claude), mejor productividad (Gemini), rentabilidad (Llama) y eficiencia ajustada (Mistral). Su elección depende de sus necesidades específicas, presupuesto e infraestructura.

Qué pueden hacer los LLM: 15 aplicaciones del mundo real

Los LLM han pasado de los laboratorios de investigación a la infraestructura central de productos y servicios. Aquí hay 15 aplicaciones probadas que están transformando industrias en este momento:

1. Automatización del servicio al cliente

Industria: Comercio minorista, SaaS, Finanzas

Los chatbots empresariales ahora manejan entre el 40% y el 60% de las consultas de los clientes sin intervención humana, analizando tickets de soporte para identificar patrones y capacitándolos sobre respuestas de calidad. Las empresas informan de una mejora del 30 al 50 % en las tasas de resolución de primera llamada y la disponibilidad 24 horas al día, 7 días a la semana. Una gran institución financiera procesa más de 10 000 interacciones con clientes diariamente con sistemas de soporte basados en LLM.

2. Generación de contenido y Curación

Industria: Marketing, Publicaciones, Medios

Los LLM generan publicaciones de blog, contenido de redes sociales, campañas de correo electrónico y descripciones de productos a escala. Herramientas como Jasper, Copy.ai y Claude se han convertido en estándar en los equipos de marketing. Una agencia de marketing de contenidos ahora puede producir 5 veces más contenido a 1/3 del costo utilizando la asistencia de un LLM con revisión humana.

3. Generación de código y Depuración

Industria: Desarrollo de software

GitHub Copilot utiliza LLM para sugerir finalización de código, generar pruebas y explicar el código. Los estudios muestran que los desarrolladores que utilizan asistentes de codificación de IA completan las tareas entre un 35 y un 55 % más rápido. Desde escribir texto estándar hasta refactorizar sistemas completos, los LLM se han convertido en herramientas de desarrollo indispensables.

4. Automatización de registros médicos

Industria: Salud

Los LLM escuchan las conversaciones entre médico y paciente y las transcriben automáticamente en registros médicos estructurados, extrayendo síntomas, diagnósticos, medicamentos y planes de tratamiento. Esto elimina entre 20 y 30 minutos de documentación por paciente, lo que mejora la productividad del médico.

5. Investigación jurídica y Análisis de contratos

Industria: Derecho

Las principales firmas de abogados que utilizan herramientas de investigación jurídica basadas en LLM reducen el tiempo de investigación en un 60 %. Los LLM analizan decisiones judiciales para sugerir precedentes relevantes, revisar contratos en busca de cláusulas riesgosas e identificar problemas de cumplimiento normativo. Herramientas como LexisNexis+ y Westlaw Edge AI ahora incluyen capacidades LLM.

6. Inteligencia de ventas y Puntuación de clientes potenciales

Sector: Ventas B2B

Los LLM analizan el comportamiento de los clientes potenciales, los correos electrónicos y los datos de la empresa para calificar la calidad de los clientes potenciales automáticamente. Los equipos de ventas que utilizan sistemas de puntuación de clientes potenciales basados en IA mejoran las tasas de conversión entre un 20 y un 30 % al centrarse en las oportunidades de mayor probabilidad.

7. Educación personalizada y Tutoría

Industria: EdTech

Los LLM adaptan el contenido educativo a los estilos de aprendizaje individuales, generan preguntas de práctica personalizadas, brindan explicaciones adaptadas al nivel de comprensión y ofrecen tutoría las 24 horas, los 7 días de la semana. Esto democratiza el acceso a la educación y es particularmente eficaz para los estudiantes que necesitan apoyo adicional.

8. Descripción del producto y Optimización del comercio electrónico

Industria: Comercio minorista, Marketplace

Las plataformas de comercio electrónico utilizan LLM para generar descripciones de productos, comparar características entre competidores, optimizar títulos para búsqueda y analizar opiniones de clientes para mejorar las listas de productos. Los minoristas informan aumentos del 15 al 25 % en las tasas de conversión.

9. Reanudar la evaluación y la evaluación Reclutamiento

Industria: Recursos Humanos, Reclutamiento

Los LLM revisan miles de currículums, extraen calificaciones, identifican a los mejores candidatos y seleccionan las habilidades requeridas, lo que reduce el tiempo que el reclutador dedica a la selección inicial en un 80 %. Esto acelera el proceso de contratación y mejora la coincidencia de candidatos.

10. Análisis financiero y Resumen de llamadas de ganancias

Industria: Finanzas, Inversiones

Los LLM analizan transcripciones de ganancias, informes trimestrales y estados financieros para extraer información clave, predecir tendencias y resumir el desempeño. Las empresas de inversión utilizan análisis basados en LLM para identificar señales más rápido que sus competidores.

11. Procesamiento de reclamaciones de seguros

Sector: Seguros

Los LLM extraen información de los documentos de reclamo, verifican la cobertura de la póliza, calculan los montos de los pagos y generan comunicaciones de respuesta. Los sistemas agentes manejan reclamos de rutina sin intervención humana, lo que reduce el tiempo de procesamiento de días a minutos.

12. Optimización del listado de bienes raíces

Sector: Bienes Raíces

Los LLM analizan las tendencias del mercado, generan descripciones de propiedades, comparan listados de la competencia e identifican automáticamente propiedades comparables en cuanto a precios. Los agentes dedican menos tiempo al trabajo administrativo y más tiempo a interacciones de alto valor con los clientes.

13. Traducción y traducción de idiomas Localización

Industria: Negocios globales, Localización

Los LLM modernos traducen contenido en varios idiomas y al mismo tiempo preservan los matices, el lenguaje y el contexto cultural mejor que los enfoques anteriores. Las empresas que localizan productos en nuevos mercados pueden hacerlo de forma más rápida y asequible.

14. Análisis de sentimiento y Monitoreo de redes sociales

Industria: Gestión de marca, Inteligencia de clientes

Los LLM analizan las menciones en las redes sociales, las opiniones de los clientes y los comentarios para comprender el sentimiento de la marca en tiempo real. Las empresas detectan problemas emergentes, realizan un seguimiento de la percepción de la marca e identifican los puntos débiles de los clientes a escala.

15. Documentación técnica y Documentación API

Industria: Software, DevTools

Los LLM generan documentación de software, guías API y ejemplos de implementación. Esto reduce el tiempo que los desarrolladores dedican a la documentación y ayuda a mantener la precisión a medida que evoluciona el código.

Estadísticas de adopción de la industria

Según McKinsey Technology Trends Outlook 2025, el uso de sistemas de IA generativa impulsados por LLM en todas las empresas aumentó del 33 % en 2024 al 67 % en 2025, duplicándose en solo un año. Para 2026, la adopción superará el 80 % en los sectores de tecnología, finanzas y servicios profesionales.

Conclusión clave: Los LLM ya no son experimentales: son infraestructura de producción. Casi todas las industrias están encontrando aplicaciones, con las mayores ganancias de productividad en el trabajo del conocimiento: redacción, análisis, codificación, interacción con el cliente e investigación.

Lo que los LLM no pueden hacer: limitaciones y alucinaciones

A pesar de sus impresionantes capacidades, los LLM tienen duras limitaciones. Comprender estas limitaciones es fundamental para utilizarlas de forma eficaz.

1. Alucinaciones (el mayor problema)

Los LLM generan información falsa que suena segura llamada «alucinaciones». El modelo predice tokens que parecen plausibles pero que en realidad son incorrectos.

Por qué sucede:

– El objetivo de entrenamiento del modelo es la predicción del siguiente token, no la predicción de la verdad

– Los LLM optimizan los patrones del lenguaje, no la precisión

– Una vez que un LLM comienza por un camino falso, continúa elaborando la falsedad

Ejemplo real:

Pregunta: «¿Cuál es el número de teléfono de la Casa Blanca?»

Un LLM típico podría responder: «El número de teléfono de la Casa Blanca es (202) 456-1111», lo cual es correcto, pero a veces alucina variantes o agrega extensiones falsas.

Más problemático:

Mensaje: “Enumere todos los artículos científicos publicados por la Dra. Jane Smith sobre computación cuántica en 2024”.

Un LLM podría fabricar artículos completos con títulos que parezcan plausibles y que en realidad no existen.

Estrategias de mitigación:

– Verificar cualquier afirmación fáctica en contextos de alto riesgo

– Utilice la generación aumentada de recuperación (RAG) para permitir que los LLM accedan a los datos actuales

– Solicitar fuentes y citas

– Utilice modelos específicamente ajustados para mayor precisión (Claude sobresale aquí)

2. Sin conocimiento en tiempo real

Los datos de formación de LLM tienen una fecha límite de conocimientos. Los modelos entrenados en 2024 no conocen los eventos de 2026 a menos que se les proporcione esa información explícitamente.

Ejemplo:

Un modelo entrenado hasta abril de 2024 no sabe:

– Quién ganó las elecciones estadounidenses de 2024

– Movimientos recientes del mercado de valores

– Lanzamientos de nuevos productos

– Noticias de última hora

Solución: utilice LLM con acceso a búsqueda web (como Gemini o Claude con herramientas externas) o implemente sistemas RAG que proporcionen información actual.

3. Limitaciones de la ventana de contexto (parcialmente resuelta)

Si bien los modelos 2026 tienen ventanas de contexto de millones de tokens, todavía tienen límites. La información que se encuentra en medio de contextos muy largos a veces se “olvida” (el fenómeno de “perderse en el medio”).

Límite práctico: si bien un modelo puede aceptar 1 millón de tokens, las aplicaciones prácticas suelen funcionar mejor con entre 50.000 y 200.000 tokens debido al costo y la degradación de la atención.

4. Sin comprensión genuina

Los LLM son sistemas sofisticados de coincidencia de patrones, no entidades conscientes con comprensión. Ellos:

– No puedo realmente “comprender” conceptos, sólo reconocer patrones

– No tener memoria persistente entre conversaciones

– No puedo verificar los hechos de forma independiente

– No puedo aprender realmente (los modelos quedan estáticos después del entrenamiento)

Nota filosófica: Los filósofos debaten si lo que hacen los LLM constituye «comprensión». Desde un punto de vista práctico, los LLM se comportan de manera indistinguible de la comprensión para muchas tareas, pero esta limitación es importante para las tareas de razonamiento crítico.

5. Luchas con cadenas de razonamiento extremadamente largas

Si bien los LLM se destacan en el razonamiento de varios pasos, las cadenas de razonamiento extremadamente largas (más de 50 pasos) se vuelven menos confiables. Los errores se acumulan en los distintos pasos.

Ejemplo:

Un problema de geometría que requiera 30 pasos de razonamiento secuencial podría resolverse correctamente el 70 % de las veces, mientras que un problema de 10 pasos podría resolverse correctamente el 95 % de las veces.

6. Deficiente en tareas que requieren información sensorial en tiempo real

Los LLM no pueden:

– Procesar transmisiones de video en vivo (solo imágenes estáticas)

– Escuche audio en tiempo real (solo texto transcrito o audio pregrabado)

– Oler, saborear o sentir

– Interactuar con entornos físicos directamente

Los modelos multimodales modernos pueden procesar imágenes, pero aún no pueden manejar la percepción real en tiempo real.

7. Capacidad limitada para aprender de nuevos datos sin volver a capacitarse

Cada conversación con un LLM comienza de nuevo. El modelo no puede aprender de sus comentarios dentro de una conversación como lo hacen los humanos. No “recordará” las correcciones que usted haga a menos que se las recuerde explícitamente en la misma conversación.

8. Problemas con dominios inusuales o altamente especializados

Los LLM son más débiles en dominios que son:

– Extremadamente raro en datos de entrenamiento (campos académicos oscuros)

– Requieren conocimientos de vanguardia (artículos de investigación publicados el mes pasado)

– Utilice jerga altamente especializada que no esté bien representada en los datos de entrenamiento

– Requiere experiencia práctica práctica

9. No puedo contar de manera confiable ni hacer aritmética precisa

Esto es sorprendente dadas las habilidades matemáticas de los LLM, pero tienen dificultades con:

– Contar grandes cantidades

– Aritmética de varios dígitos (especialmente con arrastre)

– Pruebas matemáticas precisas

Ejemplo:

Mensaje: «Cuente el número de ‘R’ en la palabra ‘fresa'»

Muchos LLM responden incorrectamente «2» en lugar del «3» correcto

10. Razonamiento de sentido común limitado

Si bien los LLM han absorbido patrones de los datos de entrenamiento, a veces fallan en tareas de razonamiento que se basan en una profunda intuición física o social que los niños poseen de forma natural.

Ejemplo:

«Una bañera se llena de agua. Alguien quita un corcho del desagüe de la bañera. ¿Qué pasa?»

Los LLM suelen responder correctamente, pero a veces las variaciones inusuales los confunden.

Resumen de limitaciones

Conclusión clave: Los LLM se destacan en el lenguaje, la coincidencia de patrones y la generación de texto plausible, pero alucinan hechos, carecen de conocimiento en tiempo real y, a veces, fallan en tareas de razonamiento que parecen simples para los humanos. Úselos como herramientas poderosas, no como oráculos.

LLM, IA tradicional y motores de búsqueda: ¿cuál es la diferencia?

Si es nuevo en la IA, los LLM pueden parecer similares a otros sistemas de IA de los que haya oído hablar. No lo son. Así es como se comparan:

LLM versus modelos tradicionales de aprendizaje automático

ML tradicional (regresión logística, árboles de decisión, SVM, bosques aleatorios):

– Capacitado para predecir una sola variable (por ejemplo, “¿Este préstamo no cumplirá con sus obligaciones?” Sí/No)

– Requerir funciones diseñadas manualmente (los humanos crean variables de entrada manualmente)

– Trabaje mejor con conjuntos de datos pequeños y medianos (de miles a millones de ejemplos)

– Interpretable: a menudo se puede entender por qué un modelo tomó una decisión

– Rápido y barato para entrenar

– Utilizado para clasificación, regresión, agrupación

Ejemplo: un banco entrena un Random Forest para predecir incumplimientos de préstamos utilizando 20 características (puntaje crediticio, ingresos, relación deuda-ingresos, historial laboral, etc.). Predice: 85% de posibilidades de pago.

LLM:

– Entrenado para predecir el siguiente token en una secuencia (abierto)

– Aprenda funciones automáticamente a partir de datos de texto sin formato

– Requieren conjuntos de datos masivos (de miles de millones a billones de tokens)

– No interpretable: cuadro negro sobre la toma de decisiones

– Caro de entrenar ($500 millones+) pero barato de usar una vez capacitado

– Genere resultados creativos y abiertos

Ejemplo:Le preguntas a Claude: «¿Debería pedir un préstamo?» y analiza su situación de manera integral, considerando el contexto financiero, las alternativas y las circunstancias personales, brindando consejos matizados.

LLM frente a otros modelos de IA/ML

Modelos de visión por ordenador (detección de objetos, segmentación de imágenes):

– Especializado para tareas visuales

– No se puede procesar el texto

– Las versiones modernas incorporan capacidades multimodales

Sistemas de recomendación:

– Optimizar para predecir las preferencias del usuario

– No diseñado para la generación de texto abierto

– Utilizado en Netflix, Spotify, Amazon

Gráficos y métodos de conocimiento Búsqueda Semántica:

– Almacenar relaciones fácticas estructuradas

– Puede responder preguntas objetivas precisas

– No generar contenido nuevo

LLM frente a motores de búsqueda: las diferencias clave

Esta comparación es importante porque muchas personas confunden los LLM con la Búsqueda de Google.

Diferencias prácticas:

Pregunta sobre el motor de búsqueda:

“¿Cuál es la capital de Francia?”

→ Devuelve un artículo de Wikipedia sobre París, sitios web gubernamentales, mapas

Pregunta del LLM:

“Explique por qué París está ubicada junto al río Sena y cómo eso afectó su desarrollo como capital”

→ Genera una síntesis reflexiva de 2 a 3 párrafos que explica la geografía, la historia y la importancia estratégica

¿Pueden los LLM realizar búsquedas?

Los LLM modernos incorporan cada vez más la búsqueda web:

– Gemini (Google) tiene integración de búsqueda en tiempo real

– A Claude se le pueden proporcionar herramientas de navegación web

– OpenAI está agregando búsqueda web a GPT

Esto crea un sistema híbrido que combina el razonamiento de los LLM con la frescura de los motores de búsqueda.

LLM versus asistentes especializados en IA

Asistentes especializados como:

– Siri, Alexa: interfaces de voz con capacidades limitadas, que normalmente llaman a funciones específicas

– ChatBot para servicio al cliente: sistemas LLM basados en reglas o restringidos que responden a preguntas predefinidas

– Revisores gramaticales: especializados para una tarea concreta

Diferencia clave: Los LLM son de propósito general. Se adaptan a cualquier tarea que les pidas sin necesidad de reentrenamiento.

Conclusión clave: Los LLM son fundamentalmente diferentes del ML tradicional (generación abierta versus predicción específica), los motores de búsqueda (sintetizar versus recuperar) y los asistentes especializados (general versus limitados). Ocupan una posición única como sistemas de comprensión de lenguajes de propósito general.

Cómo utilizar los LLM de forma eficaz: consejos prácticos

Ahora que comprende qué son los LLM y sus limitaciones, aquí le mostramos cómo utilizarlos para obtener el máximo valor.

1. Escriba indicaciones detalladas y específicas

Mensaje débil:

“Escribir sobre el cambio climático”

Mensaje fuerte:

«Escriba una publicación de blog de 500 palabras sobre los impactos del cambio climático en la producción mundial de alimentos. Céntrese en cómo el aumento de las temperaturas afecta el rendimiento de los cultivos y la disponibilidad de agua en el África subsahariana. Incluya datos específicos de 2024 y predicciones para 2030. Utilice un tono profesional pero accesible para lectores sin experiencia en ciencias climáticas».

Por qué es importante: Los LLM son excelentes para seguir instrucciones detalladas. Cuanto más específica sea tu pregunta, mejor será el resultado.

2. Utilice la mentalidad de «ingeniería rápida»

Trate las indicaciones como código: itere y perfeccione.

Enfoque iterativo:

1. Escribe el mensaje inicial

2. Revisar el resultado

3. Identifique lo que falta o lo que está mal

4. Refinar el mensaje con más contexto o instrucciones

5. Repetir hasta quedar satisfecho

Técnicas:

– Ejemplos breves: proporcione 2 o 3 ejemplos del formato de salida deseado

– Juego de roles: “Eres un asesor financiero experto…”

– Paso a paso: “Piensa paso a paso…”

– Restricciones: “Mantener la respuesta en menos de 200 palabras…”

3. Verificar afirmaciones fácticas

Nunca utilice los resultados de LLM como verdad sobre el terreno sin verificación en contextos de alto riesgo.

Casos de uso seguros: Lluvia de ideas, ideación, redacción, explicación de conceptos

Casos de uso riesgosos: Citar estadísticas sin verificación, tomar decisiones médicas, asesoramiento legal

4. Utilice los LLM como aceleradores de la investigación

Los LLM son excepcionales a la hora de sintetizar información rápidamente.

Flujo de trabajo:

1. Pídale a LLM que explique un tema

2. Pídale que identifique las lagunas

3. Pídale que proporcione puntos de vista opuestos

4. Utiliza esa base para investigar más profundamente

Ejemplo: “Resuma los tres argumentos más sólidos a favor y en contra de la renta básica universal, con citas clave”

5. Aproveche las capacidades multimodales

Los LLM modernos (2026) aceptan imágenes y algunos aceptan documentos y videos.

Enfoques útiles:

– Sube una captura de pantalla y pregunta «¿Qué está pasando en esta imagen?»

– Proporcione un documento PDF y pregunte “Resumir los hallazgos clave”

– Pregunte “Analice este gráfico e identifique tendencias”

– Sube una foto de un problema escrito a mano y pide una solución

6. Utilice LLM para generación y depuración de código

Los LLM son asistentes de programación excepcionales.

Usos efectivos:

– “Escribe una función de Python que…”

– “Depurar este código: [pegar código]”

– “Explica qué hace este código en términos simples”

– “Refactorice este código para un mejor rendimiento”

– “Escribir pruebas unitarias para esta función”

7. Implementar indicaciones de cadena de pensamiento

Para razonamientos complejos, pida explícitamente al modelo que razone paso a paso.

Débil: «¿Es esta inversión una buena idea?»

Fuerte: «Analice esta oportunidad de inversión paso a paso, considerando: (1) rendimientos potenciales, (2) factores de riesgo, (3) mi tolerancia al riesgo, (4) alternativas. Luego proporcione su recomendación con un razonamiento».

8. Utilice herramientas y API externas

Mejore los LLM con capacidades de las que carecen:

- Calculadoras para aritmética

- API de búsqueda web para obtener información actual

- Consultas a bases de datos para obtener datos actualizados

- Ejecución de código para verificar que el código funcione

- Generación de imágenes para contenido visual

Esto crea un «motor de razonamiento» que es mucho más capaz que el LLM por sí solo.

9. Comprenda las diferencias entre modelos y elija correctamente

- GPT-5: Máxima capacidad, codificación, razonamiento complejo

- Claude: Precisión, análisis, redacción extensa, seguridad

- Gemini: Productividad, integración con herramientas de Google

- Llama: Rentabilidad, autohospedaje, control

Empareja la tarea con el modelo.

10. Implemente el control de versiones para sus mensajes

Si utiliza LLM repetidamente para tareas importantes:

– Guardar indicaciones efectivas

– Documentar lo que funciona y lo que no

– Iterar en sus plantillas

– Comparte indicaciones exitosas con los equipos

11. Establezca expectativas adecuadas

Los LLM son:

– ✓ Excelente para redactar, generar ideas y explicar

– ✓ Útil para escribir primeros borradores

– ✓ Excelente para aprender nuevos temas

– ✓ Bueno para analizar texto y datos

– ✗ No es confiable como única fuente de datos críticos

– ✗ No reemplaza la experiencia en el dominio

– ✗ No infalible en razonamientos complejos

12. Conozca la personalidad de su LLM

Cada modelo principal tiene diferentes puntos fuertes:

Claude:

– Respuestas reflexivas y exhaustivas

– Excelente para admitir incertidumbre

– Estimaciones conservadoras

– Ideal para escritura matizada

GPT-5:

– Más agresivo/útil en estilo

– Más rápido en matemáticas y lógica

– Mejor en contextos muy largos

– Tono más casual

Géminis:

– Respuestas concisas y directas

– Bueno en información en tiempo real

– Excelente integración de búsqueda

– Fortalezas multimodales

Pruebe qué modelo funciona mejor para su caso de uso específico.

Conclusión clave: La eficacia de los LLM depende de cómo los utilices. Escriba indicaciones detalladas, verifique hechos importantes, utilícelas como herramientas de aceleración y elija el modelo adecuado para su tarea específica.

El futuro de los LLM: lo que vendrá en 2026 y más allá

Qué llegará en 2026

Verdadera integración multimodal

– Todos los principales LLM procesarán sin problemas texto, imágenes, videos y audio en indicaciones únicas

– Comprensión de vídeo en tiempo real (no solo fotogramas estáticos)

– Conversación con entrada y salida de audio (no requiere transcripción)

– Comprensión y manipulación de modelos 3D

IA agencia por defecto

– LLM con memoria persistente entre sesiones

– Ejecución autónoma de tareas (programación, investigación, automatización)

– El uso de herramientas se vuelve estándar (cada LLM integra API de forma predeterminada)

– Flujos de trabajo autónomos de varios pasos sin intervención humana

Precisión mejorada

– Las tasas de alucinaciones disminuyen entre un 50 y un 70 % gracias a técnicas de entrenamiento mejoradas

– Cálculo en el momento de la prueba (los modelos razonan más en problemas difíciles)

– Mejor integración con los sistemas de recuperación

– Proliferan los modelos optimizados para dominios específicos

Reducciones de costes

– Los costos de inferencia caen de $0,01-0,15/mtok actuales a $0,001-0,01/mtok

– Los modelos de código abierto autohospedados están listos para producción

– Los modelos más pequeños (parámetros 50B-100B) coinciden con los modelos de vanguardia en muchas tareas

– La implementación perimetral se vuelve práctica

2027 y más allá: el horizonte más largo

Modelos de razonamiento primero

– Nuevo paradigma de arquitectura que va más allá de los transformadores

– Modelos optimizados para largas cadenas de razonamiento

– Pruebas matemáticas con verificación formal

– Generación y prueba de hipótesis científicas

Aprendizaje multimodal a escala

– Modelos entrenados en todos los tipos de conocimiento humano simultáneamente

– Comprensión del vídeo a nivel fotográfico

– Comprensión de la causa y efecto físico a partir del vídeo

– Comprensión del mundo 3D a partir de observaciones 2D

Memoria persistente y aprendizaje

– Modelos que acumulan conocimiento durante las conversaciones

– El aprendizaje de pocas oportunidades se convierte en aprendizaje de una sola vez

– Modelos personalizados que aprenden tus preferencias

– Aprendizaje continuo de las interacciones del usuario (éticamente)

Modelos federados y que preservan la privacidad

– Modelos que se ejecutan localmente mientras aprenden globalmente

– Capacitación centrada en la privacidad, donde no salen datos sin procesar de su dispositivo

– El aprendizaje federado se convierte en estándar

– Aprendizaje automático compatible con cifrado

Compensaciones especializadas versus generales

– Pasar de un modelo gigante a diversos modelos especializados

– La mezcla de expertos se convierte en arquitectura universal

– Modelos más pequeños y rápidos para tareas sencillas

– Modelos extremadamente grandes para razonamientos complejos

– Selección dinámica de qué modelos usar

Eficiencia Energética

– Mejora de órdenes de magnitud en la eficiencia informática

– Enfoques de computación neuromórfica

– El hardware de IA especializado se convierte en un bien de consumo

– Los requisitos de energía de entrenamiento e inferencia caen drásticamente

Desafíos y preguntas emergentes

Alineación y seguridad

– A medida que los modelos se vuelven más capaces, la alineación se vuelve más difícil

– ¿Cómo garantizamos que los sistemas avanzados de IA sigan siendo beneficiosos?

– ¿Quién controla los modelos más poderosos?

Desinformación y autenticidad

– Los LLM hacen que la creación de información falsa convincente sea trivial

– ¿Cómo mantenemos la confianza en la información?

– La autenticación y la procedencia se vuelven críticas

Trabajo y sociedad

– Los flujos de trabajo de los trabajadores del conocimiento se transforman fundamentalmente

– Algunos puestos de trabajo desaparecen; surgen nuevos empleos

– La sociedad debe afrontar la disrupción con prudencia

– La educación y la formación se vuelven continuas

Interpretabilidad

– Los LLM actuales siguen siendo cajas negras

– ¿Cómo entendemos cómo funcionan los modelos más potentes?

– ¿Podemos construir modelos interpretables que aún sean capaces?

Qué debes hacer ahora

- Empiece a experimentar: la mejor manera de comprender el futuro es utilizar estas herramientas hoy

- Desarrollar habilidades: centrarse en habilidades que los LLM no pueden reemplazar (creatividad, juicio, inteligencia emocional, experiencia especializada)

- Aprende ingeniería rápida: esto se convierte en una habilidad profesional valiosa

- Comprenda las limitaciones: No sobreestime lo que está por venir; algunos desafíos son más difíciles de lo esperado

- Manténgase informado: siga los desarrollos de OpenAI, Anthropic, Google, Meta y las comunidades de código abierto

Conclusión clave: 2026-2027 verá una evolución rápida y continua: mayor precisión, menores costos, mejor razonamiento y capacidades autónomas. El panorama de los LLM está evolucionando hacia modelos especializados, eficiencia mejorada y sistemas agentes. El futuro de los LLM no es un único modelo superinteligente: es un ecosistema de diversos sistemas de IA que trabajan juntos.

Preguntas frecuentes: respuestas a sus preguntas sobre los LLM

P1: ¿Los LLM son conscientes o inteligentes?

R: Esto es filosóficamente complejo. Los LLM exhiben comportamientos que se asemejan a la comprensión y el razonamiento, pero no tienen:

– Conciencia o experiencia subjetiva (hasta donde sabemos)

– Verdadera comprensión (reconocen patrones, no significados)

– Metas o deseos persistentes

– Agencia en el sentido filosófico

Respuesta práctica: Los LLM son herramientas extremadamente poderosas para la coincidencia de patrones y la generación de texto que producen resultados que se asemejan a una conversación inteligente. Si eso constituye “inteligencia” depende de cómo se defina el término.

P2: ¿Pueden los LLM reemplazar a los humanos en mi trabajo?

R: Depende de tu trabajo. Es probable que los LLM:

Aumentar (no reemplazar):

– Desarrolladores de software (desarrollo más rápido)

– Escritores (redacción más rápida)

– Analistas (investigación más rápida)

– Profesores (herramientas de aprendizaje personalizadas)

– Médicos (mejor asistencia al diagnóstico)

Puede eventualmente reemplazar:

– Representantes de servicio al cliente (para soporte básico)

– Asistentes legales junior (investigación jurídica)

– Operadores de entrada de datos

– Redactores de contenido (algunos tipos)

– Asistentes de traducción

Realidad: La mayoría de los trabajos aumentarán con los LLM en lugar de eliminarse. Las personas que aprendan a trabajar eficazmente con los LLM serán las más valiosas. Su ventaja competitiva es aprender a utilizar estas herramientas mejor que las alternativas.

P3: ¿Qué tan precisos son realmente los LLM?

R: La precisión varía enormemente según la tarea:

- Preguntas objetivas sencillas: entre un 75 % y un 90 % de precisión

- Razonamiento matemático:60-85 % de precisión (peor en aritmética)

- Generación de código: 70-95 % de precisión (dependiendo de la complejidad)

- Tareas creativas: No se aplica ninguna métrica de precisión

- Dominios especializados: 50-70 % (si se trata de datos de entrenamiento externos)

Punto clave: Debes verificar las afirmaciones en dominios de alto riesgo. Los LLM tienen confianza incluso cuando se equivocan.

P4: ¿Para qué se utilizan mis datos de entrenamiento?

R: Esto varía según el proveedor:

OpenAI: los datos de entrenamiento de GPT Plus y API se incluirán en el entrenamiento de modelos futuros (a menos que usted opte por no participar)

Antrópico: las conversaciones de Claude.ai pueden revisarse para mejorar la capacitación, pero está disponible la exclusión voluntaria explícita.

Google: las conversaciones de Gemini pueden mejorar Gemini, pero se mantienen separadas de otros servicios de Google (con controles de privacidad)

Regla general: Consulta las políticas de privacidad. Suponga que las conversaciones pueden usarse para mejorar a menos que se indique explícitamente lo contrario.

P5: ¿Cómo sé si el contenido fue escrito por un LLM?

R: ¿Honestamente? Cada vez es más difícil. Indicadores clave:

Contenido generado por LLM a menudo:

– Tiene una estructura ligeramente formulada

– Evita opiniones fuertes

– Incluye clichés y frases usadas en exceso

– Tiene una gramática perfecta (a veces demasiado perfecta)

– Carece de ejemplos personales específicos

– Sigue patrones de contorno obvios

Pruebas:

– Hacer preguntas de seguimiento que requieran conocimientos específicos

– Busque errores fácticos (alucinaciones)

– Verifique casos extremos inusuales: los LLM a menudo los pasan por alto

– Existen herramientas de detección de IA, pero no son fiables

Realidad: La detección de IA es una carrera armamentista. A medida que los modelos mejoran, la detección se vuelve más difícil.

P6: ¿El uso de LLM es una “trampa” en la escuela?

R: La sociedad todavía se está dando cuenta de esto.

Consideraciones:

– Escribir artículos: Usar LLM sin revelarlo es plagio (deshonestidad académica)

– Herramienta de aprendizaje: Usar LLM para explicar conceptos que luego sintetizas es aprender

– Tarea: Depender completamente de las respuestas del LLM impide el aprendizaje

– Lluvia de ideas: utilizar LLM como socios creativos es legítimo

Prácticas recomendadas: consulte la política de IA de su institución. Muchas escuelas tienen ahora directrices explícitas. Aprender a utilizar la IA de forma ética es en sí mismo una habilidad valiosa.

P7: ¿Los modelos más grandes siempre funcionan mejor?

R: No siempre.

Los modelos más grandes son mejores en:

– Razonamiento complejo

– Manejo de diversas tareas

– Comprender los matices

– Documentos largos

Los modelos más pequeños pueden ser mejores en:

– Velocidad (inferencia en milisegundos vs. segundos)

– Costo (1/100 del precio)

– Privacidad (puede ejecutarse localmente)

– Fiabilidad en dominios específicos (si se ajusta)

Tendencia 2026: La era de “cuanto más grande, mejor” está llegando a su fin. Los modelos más pequeños, especializados y perfeccionados, son cada vez más competitivos. Debes elegir en función de tu tarea específica, no del tamaño máximo.

P8: ¿Cómo debería pensar en los derechos de autor y las licencias de IA?

R: Esto todavía es legalmente incierto, pero aquí tienes una guía práctica:

Al generar contenido con LLM:

– El contenido que generas normalmente es tuyo para usarlo

– La atribución no siempre es un requisito legal

– Pero cada vez se espera más la divulgación del uso de la IA

Cuando se utiliza código generado por LLM:

– Tenga en cuenta qué licencia utiliza su modelo

– Los modelos de código abierto tienen requisitos específicos

– Pueden aplicarse avisos de derechos de autor

Práctica recomendada: Incluya una declaración de divulgación cuando sea posible. «Este artículo fue redactado con ayuda de IA» se está convirtiendo en un estándar.

P9: ¿Cuál es la diferencia entre LLM y GPT?

R: Concepto erróneo común: GPT es una familia de modelos específica (de OpenAI), no todos los LLM.

– GPT = Serie de modelo específica de OpenAI (GPT-4, GPT-5, etc.)

– LLM = Categoría que incluye GPT, Claude, Gemini, Llama, etc.

– ChatGPT = Interfaz de consumidor para modelos GPT

Como «¿Cómo es Kleenex vs. pañuelos de papel?» — Kleenex es una marca, los pañuelos son la categoría.

P10: ¿Cómo empiezo a utilizar LLM si soy principiante?

R:

Paso 1: Empieza gratis

– Nivel gratuito de ChatGPT (openai.com)

– Claude (claude.ai) — gratis

– Géminis (gemini.google.com) — gratis

– Pruebe cada uno durante una semana

Paso 2: comprenda su caso de uso

– ¿Qué quieres lograr?

– ¿Precisión o velocidad más importante?

– ¿Presupuesto?

Paso 3: actualice si es necesario

– ChatGPT Plus ($20/mes) para funciones de usuario avanzado

– Claude.ai Plus ($20/mes) para trabajo serio

– Acceso API para aplicaciones

Paso 4: aprender ingeniería rápida

– Realice un curso gratuito (deeplearning.ai)

– Experimente con diferentes estilos de indicaciones

– Únete a comunidades (r/ChatGPT, foros Anthropic)

Paso 5: comprender las limitaciones

– Verificar los hechos de forma independiente

– No confíes demasiado en los resultados

– Aprenda cuándo NO utilizar LLM

Recurso: Comience en learnai.sk/goto/skool/learnai para obtener cursos completos sobre los fundamentos de la IA.

Conclusión

Los grandes modelos lingüísticos han pasado de ser curiosidades de investigación a infraestructura esencial. Miles de millones de personas interactúan con ellos a diario, a menudo sin darse cuenta. Comprender cómo funcionan (y, sobre todo, sus limitaciones) se está volviendo tan importante como entender cómo utilizar los motores de búsqueda.

Lo que hemos cubierto:

– Los LLM predicen tokens de texto utilizando arquitecturas transformadoras con atención propia

– Se les capacita mediante capacitación previa en corpus de texto masivos, luego se afinan y optimizan utilizando comentarios humanos

– Los principales modelos 2026 (GPT-5, Claude Opus, Gemini 1.5, Llama 4) sirven para diferentes casos de uso

– Las aplicaciones del mundo real abarcan atención médica, derecho, ventas, contenido, educación y servicio al cliente

– Las limitaciones críticas incluyen alucinaciones, conocimientos obsoletos y falta de comprensión real

– La eficacia depende de cómo los utilice mediante indicaciones detalladas y una verificación adecuada

– El futuro apunta hacia sistemas multimodales, capacidades de agencia y precisión mejorada

Conclusión: Los LLM son herramientas transformadoras, no sustitutos del juicio humano. Lo mejor es utilizarlos como herramientas de aceleración por parte de personas que entienden sus fortalezas y limitaciones.

Ya sea que sea un estudiante que aprende sobre IA, un profesional que evalúa programas de maestría para su lugar de trabajo o alguien curioso acerca de la tecnología que está remodelando el trabajo de la información, se aplican los principios de esta guía. Empiece a experimentar, sea escéptico respecto de los resultados y concéntrese en aumentar sus capacidades en lugar de ceder la toma de decisiones a la IA.

¿Listo para profundizar más? Explore los cursos estructurados de IA en learnai.sk/goto/skool/learnai para desarrollar experiencia en aprendizaje automático, ingeniería rápida y aplicaciones de IA.

Más recursos

- Documentación de OpenAI GPT

- Documentación de la API de Anthropic Claude

- Documentación de IA de Google

- Documentación de Meta Llama

- Documentación de Mistral AI

- Curso LLM de Hugging Face

- Cursos cortos de DeepLearning.AI

Recuento de palabras: 4847 palabras