Herramientas de estrategia de IA para desarrolladores

Si eres un desarrollador que intenta descubrir dónde encaja la IA en tu flujo de trabajo, tu carrera o tu negocio, la gran cantidad de herramientas y marcos puede resultar paralizante. Cada semana hay un nuevo modelo, un nuevo SDK, una nueva palabra de moda. El verdadero desafío no es acceder a la IA, sino saber cómo utilizarla estratégicamente para crear cosas importantes y ganar dinero con ello.

Esta guía elimina el ruido. Hemos revisado y comparado las principales herramientas de estrategia de IA para desarrolladores, que abarcan todo, desde API modelo y marcos de agentes hasta creadores sin código y plataformas de monitoreo. Ya sea que esté creando productos basados en IA, automatizando sus propios flujos de trabajo o posicionándose como un experto en IA, aquí encontrará las herramientas y la estrategia.

¿Qué significa la “Estrategia de IA”? ¿Qué significa para los desarrolladores?

Antes de profundizar en las herramientas, aclaremos qué entendemos por estrategia de IA en el contexto del desarrollador.

La estrategia de IA no consiste solo en elegir el modelo más popular o copiar un tutorial. Significa:

- Saber qué capacidades de IA se aplican a su problema específico

- Elegir herramientas que equilibren coste, velocidad y calidad para su caso de uso

- Construir sistemas que escalan, no experimentos únicos

- Comprender cómo encaja la IA en un producto o modelo de negocio más amplio

- Mantenerse actualizado sin seguir todas las tendencias

Los desarrolladores que tratan la IA de manera estratégica son los que consiguen contratos mejor pagados, envían productos más rápido y generan flujos de ingresos pasivos. Las herramientas siguientes están organizadas según el papel que desempeñan en una estrategia práctica de IA.

Categoría 1: API del modelo básico

El punto de partida de cualquier estrategia de IA es acceder a un modelo de lenguaje capaz. Aquí se comparan los principales proveedores.

OpenAI (GPT-5, GPT-5.3 instantáneo, o3)

Ideal para: Texto de uso general, generación de código, llamada de funciones, resultados estructurados

El buque insignia actual de OpenAI es GPT-5: un salto significativo con respecto a GPT-4o, con un rendimiento de última generación en tareas de codificación, matemáticas y multimodales, y aproximadamente un 80 % menos de alucinaciones que o3 cuando el pensamiento está habilitado. Para las tareas cotidianas en las que la velocidad es importante, GPT-5.3 Instant es el modelo predeterminado. o3 y o3-pro siguen siendo la opción preferida para el razonamiento profundo, cometiendo un 20 % menos de errores que o1 en tareas complejas del mundo real. La variante GPT-5.3-Codex es el modelo de codificación agente más capaz disponible en la actualidad.

- Precios: los precios de GPT-5 varían según el nivel; GPT-5.3 Instant es el modelo cotidiano con costes optimizados

- Fortalezas: Fiabilidad, ecosistema masivo, llamada de herramientas/funciones, codificación agente con Codex

- Debilidades: El rápido control de versiones dificulta la fijación de un modelo estable a largo plazo

- Ajuste estratégico: ideal para aplicaciones de producción que requieren máxima confiabilidad y amplia capacidad

Antrópico (Claude Opus 4.6, Soneto 4.6, Haiku 4.5)

Ideal para: contexto extenso, razonamiento, aplicaciones sensibles a la seguridad, procesamiento de documentos

La línea actual de Anthropic está liderada por Claude Opus 4.6 (lanzado en febrero de 2026), que supera a GPT-5.2 en ~144 puntos Elo en GDPval-AA y presenta una ventana de contexto de token de 1 millón en versión beta. Soneto de Claude 4.6es el nuevo valor predeterminado para la mayoría de los usuarios, cerrando significativamente la brecha con Opus sin dejar de ser altamente rentable. Claude Haiku 4.5 sigue siendo uno de los modelos más rápidos y baratos disponibles en el mercado. Todos los modelos cuentan con especificaciones claras de uso de herramientas y excelente seguimiento de instrucciones.

- Precio: Claude Haiku 4.5 a $0,25/1 millón de tokens de entrada es extremadamente competitivo

- Fortalezas: 1 millón de contexto de token (Opus), excelente análisis de documentos, seguimiento de instrucciones matizadas

- Debilidades: Ecosistema de terceros más pequeño que OpenAI

- Ajuste estratégico: ideal para procesos con muchos documentos, sistemas RAG o flujos de trabajo complejos de varios pasos

Google Gemini (3.1 Pro, 3.1 Flash Lite)

Ideal para: tareas multimodales, integración de Google Workspace y procesamiento de gran volumen

El buque insignia actual de Google es Gemini 3.1 Pro (lanzado en febrero de 2026), con un sólido razonamiento multimodal en texto, imágenes, audio y vídeo. Para cargas de trabajo sensibles a los costos, Gemini 3.1 Flash Lite (lanzado en marzo de 2026) es notablemente capaz: con un precio de solo $0,25/1 millón de tokens de entrada, es 2,5 veces más rápido que su predecesor y supera a GPT-5 mini y Claude Haiku 4.5 en varios puntos de referencia y, al mismo tiempo, admite una ventana de contexto de token de 1 millón.

- Precio: Gemini 3.1 Flash Lite a 0,25 USD/1 millón de entrada y 1,50 USD/1 millón de tokens de salida

- Fortalezas: Ventana de contexto masiva, multimodal, nivel Flash Lite ultrarrápido, ecosistema de Google

- Debilidades: El ecosistema de API aún se está poniendo al día con OpenAI

- Ajuste estratégico: excelente para canales ricos en medios, de alto rendimiento o sensibles a los costos

Meta Llama 4 (a través de Groq, Together AI, Ollama)

Ideal para: aplicaciones sensibles a los costos, implementación local y ajuste

Llama 4 es la alineación actual de peso abierto de Meta. Llama 4 Scout (17 mil millones de parámetros activos, 16 expertos) cabe en una sola GPU H100 y ofrece una ventana de contexto de token de 10 millones líder en la industria. Llama 4 Maverick (17 mil millones de parámetros activos, 128 expertos) supera a GPT-4o y Gemini 2.0 Flash en los principales puntos de referencia sin dejar de ser completamente abierto. Ambos son nativamente multimodales. Ejecutarlos a través de Groq proporciona una inferencia casi instantánea; ejecutarlo localmente a través de Ollama significa cero costo de API.

- Precios: Gratis para ejecutar localmente; Las tarifas de nube de Groq/Together AI son muy competitivas

- Fortalezas: Pesos abiertos, multimodal nativo, contexto de 10 M (Scout), totalmente ajustable, cero fugas de datos

- Debilidades: Requiere infraestructura de GPU para autohospedarse a escala

- Ajuste estratégico: ideal para aplicaciones que priorizan la privacidad, trabajos de gran volumen donde el costo es primordial y equipos que desean un control total del modelo.

Categoría 2: Marcos de agentes de IA

Si una sola convocatoria de LLM es un martillo, un marco de agente de IA es un conjunto de herramientas completo. Estas son las plataformas y bibliotecas que le permiten crear flujos de trabajo de IA autónomos y de varios pasos.

LangChain

El marco de código abierto más adoptado para crear aplicaciones LLM. LangChain proporciona abstracciones para cadenas, agentes, memoria y uso de herramientas. Se integra con prácticamente todos los principales modelos y bases de datos vectoriales.

- Idioma: Python & JavaScript

- Ideal para: creación rápida de prototipos, aprendizaje y procesos RAG

- Cuidado con: complejidad de la abstracción; puede volverse difícil de manejar en la producción; cambios de última hora frecuentes

- Uso estratégico: utilice LangChain para crear prototipos rápidamente; migre a un código más ligero una vez que su arquitectura esté clara

LangGraph

Construido sobre LangChain, LangGraph agrega un modelo de ejecución basado en gráficos para agentes complejos con ciclos, ramificaciones y persistencia de estado. Es la opción ideal para sistemas multiagente de producción.

- Ideal para: flujos de trabajo de múltiples agentes, sistemas humanos en el circuito, agentes con estado

- Por qué es importante:La mayoría de los productos de IA reales necesitan más que una cadena lineal: necesitan lógica de ramificación y la capacidad de retroceder

- Uso estratégico: Si su agente necesita “pensar” a través de múltiples pasos o colabore con otros agentes, LangGraph es su marco

AutoGen (Microsoft)

AutoGen permite que varios agentes de IA conversen entre sí para completar tareas complejas. Un agente podría escribir código; otro lo revisa; un tercero realiza pruebas. Es particularmente bueno para asistentes de codificación y herramientas de investigación.

- Ideal para: Colaboración entre múltiples agentes, generación y revisión automatizadas de código

- Fortalezas: Herramientas sólidas para casos de uso de desarrolladores; bueno para descomponer tareas complejas

- Uso estratégico: excelente para herramientas o productos de desarrollo interno donde la generación de código es el valor principal

TripulaciónAI

CrewAI es un marco de trabajo de nivel superior para sistemas multiagente, con énfasis en agentes basados en roles organizados en «equipos». Es más obstinado que LangGraph y más rápido de ejecutar.

- Ideal para: crear productos rápidamente; Orquestación de agentes no amigable para ingenieros

- Fortalezas: Rápido para crear prototipos; estructura de código legible; comunidad activa

- Uso estratégico: Úselo cuando desee realizar envíos rápidos; considere LangGraph si necesita más control

SDK de IA de Vercel

Para los desarrolladores de JavaScript/TypeScript que crean aplicaciones web, Vercel AI SDK es la forma más limpia de transmitir respuestas, manejar llamadas de herramientas e integrar IA en Next.js y otros marcos de interfaz.

- Ideal para: desarrolladores de aplicaciones web; UI de transmisión; Integración con Next.js

- Uso estratégico: si su producto tiene una interfaz de chat o una interfaz de usuario basada en IA, esta es la opción más ergonómica en el ecosistema JS

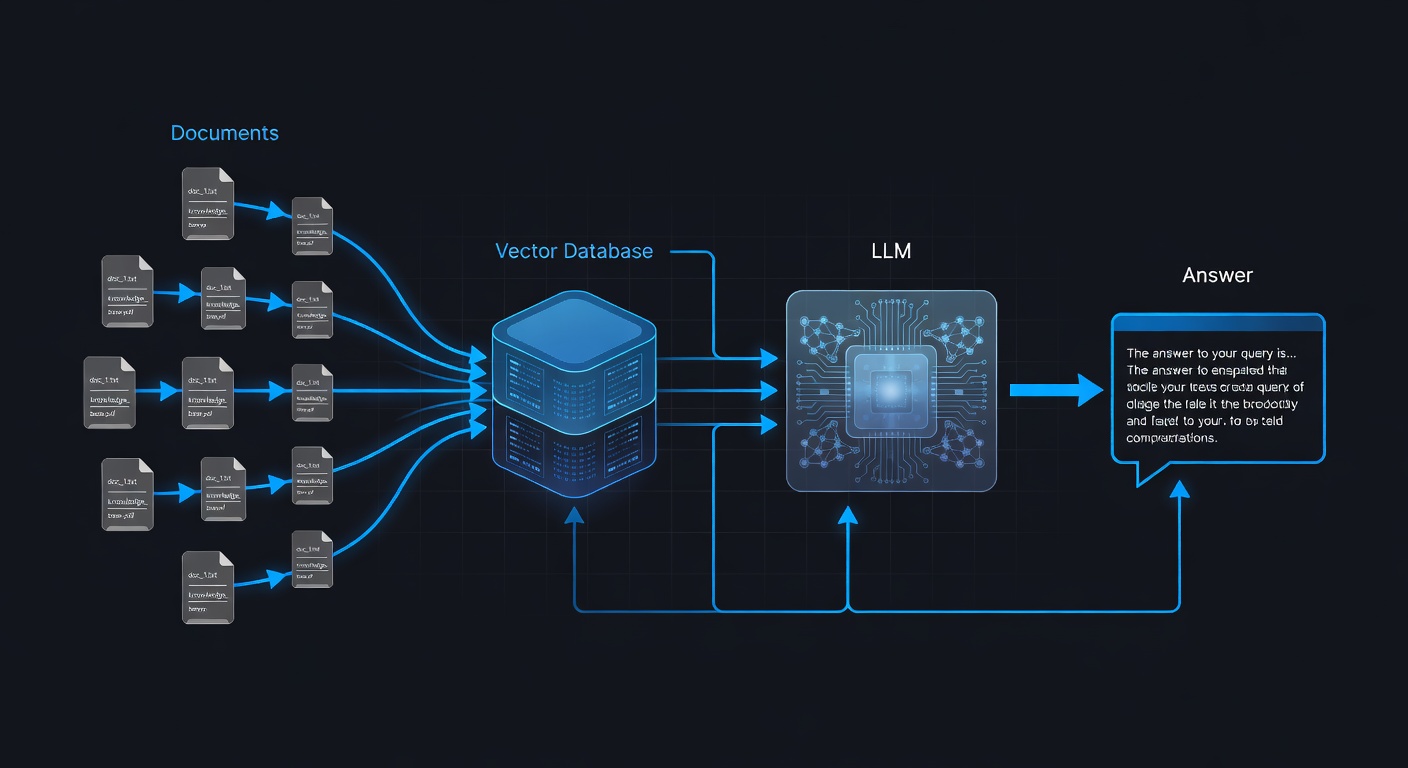

Categoría 3: Bases de datos vectoriales e infraestructura RAG

La generación aumentada de recuperación (RAG) es la arquitectura que permite a la IA responder preguntas basadas en sus propios datos. Una base de datos vectorial es la columna vertebral de cualquier sistema RAG.

Piña

La base de datos vectorial administrada más madura. Pinecone maneja la indexación, las consultas y el escalado sin necesidad de administrar la infraestructura. Se integra perfectamente con LangChain, LlamaIndex y la mayoría de los marcos de agentes.

- Precios: Nivel gratuito disponible; comienza a escalar a $70/mes para la producción

- Ideal para: sistemas RAG de producción en los que no se desea gestionar la infraestructura

- Uso estratégico: si estás creando un producto con RAG como núcleo, Pinecone te permite centrarte en la capa de aplicación

Weaviate

Una base de datos vectorial de código abierto con una excelente búsqueda híbrida integrada (que combina búsqueda semántica y de palabras clave). Puede ser autohospedado o utilizarse como un servicio de nube administrado.

- Ideal para: búsqueda híbrida, multiinquilino y filtrado complejo

- Uso estratégico: buena opción cuando necesitas búsqueda tanto semántica como de palabras clave, o cuando el autohospedaje es importante

Croma

La opción más sencilla para empezar. Chroma es una base de datos vectorial liviana de código abierto que se ejecuta en memoria o persiste en el disco. Ideal para desarrollo y producción a pequeña escala.

- Ideal para: aprendizaje, creación de prototipos y aplicaciones a pequeña escala

- Uso estratégico: Empiece aquí; migre a Pinecone o Weaviate a medida que sus datos crezcan

Pgvector de Supabase

Si ya estás en Postgres (por ejemplo, a través de Supabase), pgvector te ofrece búsqueda de vectores sin agregar otro servicio. Suficientemente bueno para la mayoría de las aplicaciones que no tienen millones de vectores.

- Mejor para: usuarios existentes de Postgres; manteniendo la pila simple

- Uso estratégico: si estás en Supabase o Postgres, este es el camino de menor fricción hacia RAG

Categoría 4: Observabilidad y evaluación de la IA

Una de las partes de la estrategia de IA que más se pasa por alto es saber si su sistema realmente está funcionando. Las herramientas de observabilidad lo ayudan a monitorear, depurar y mejorar sus productos de IA con el tiempo.

LangSmith

Plataforma de observabilidad de LangChain. LangSmith rastrea cada paso de su cadena o agente, muestra el uso de tokens, la latencia y los errores, y le permite ejecutar evaluaciones en conjuntos de datos de prueba.

- Ideal para: equipos que utilizan LangChain/LangGraph

- Por qué es importante: Depurar un agente de varios pasos sin realizar seguimiento es una conjetura

- Uso estratégico: esencial si envía un producto basado en LangChain

Confianza intelectual

Una plataforma de evaluación independiente del modelo. Braintrust le permite realizar experimentos, comparar modelos y realizar un seguimiento del rendimiento a lo largo del tiempo mediante puntuaciones personalizadas y evaluaciones calificadas por IA.

- Ideal para: equipos que iteran solicitudes y comparan modelos

- Uso estratégico: si se toma en serio la ingeniería rápida y desea que los datos respalden sus decisiones

Helicón

Una capa de observabilidad basada en proxy que funciona con cualquier API compatible con OpenAI. Agregue una línea de código y obtenga registro completo de solicitudes, seguimiento de costos, almacenamiento en caché y limitación de velocidad.

- Ideal para: Configuración rápida; funciona con cualquier modelo

- Uso estratégico: la forma más sencilla de obtener visibilidad del uso y los costos de su API sin cambiar su arquitectura

Categoría 5: Constructores de IA sin código y con poco código

No todas las partes de su estrategia de IA requieren escribir código. Estas herramientas te permiten crear y probar flujos de trabajo de IA más rápido.

n8n

Una herramienta de automatización del flujo de trabajo de código abierto con creciente compatibilidad con nodos de IA. Conecte modelos de IA a bases de datos, API, plataformas de mensajería y más, con un generador de flujo de trabajo visual.

- Ideal para: Automatizar procesos comerciales; integrar la IA con las herramientas existentes

- Uso estratégico: excelente para crear herramientas internas o automatizaciones de clientes sin código personalizado

Flujo

Un constructor LangChain visual de código abierto. Arrastre y suelte cadenas, agentes y componentes de memoria para crear prototipos de aplicaciones de IA sin escribir código.

- Ideal para: creación de prototipos; no desarrolladores que comprendan los conceptos de IA

- Uso estratégico: excelente para probar rápidamente una arquitectura antes de implementarla en el código

Dificar

Un creador de aplicaciones de IA más pulido y centrado en el producto. Dify admite RAG, flujos de trabajo de agentes y gestión de modelos con una interfaz de usuario limpia. Puede ser autohospedado o utilizarse como un servicio en la nube.

- Ideal para: crear rápidamente herramientas internas basadas en IA; equipos sin recursos de ingeniería profundos

- Uso estratégico: si estás creando productos para clientes no técnicos, Dify puede reducir drásticamente tu tiempo de desarrollo

Categoría 6: Productividad del desarrollador y herramientas de codificación de IA

Tu propia productividad es parte de tu estrategia de IA. Estas herramientas te ayudan a construir más rápido.

Copiloto de GitHub

Sigue siendo el asistente de codificación de IA más adoptado. Copilot autocompleta código, explica funciones, escribe pruebas y lo integra en VS Code, JetBrains y otros editores.

- Precio: $10/mes individual; $19/mes Empresa

- Uso estratégico: si no utilizas un asistente de codificación con IA, eres más lento que la competencia

Cursor

Una bifurcación de VS Code con IA profundamente integrada. Cursor te permite chatear con tu código base, aplicar ediciones de varios archivos y usar modelos como Claude y GPT-4o directamente en el editor. Muchos desarrolladores lo consideran un paso por encima de Copilot.

- Precio: $20/mes para Pro

- Uso estratégico: si te tomas en serio el desarrollo mejorado con IA, la conciencia contextual de Cursor es un multiplicador de productividad

Ayudante

Un asistente de codificación de línea de comandos de código abierto que funciona directamente con su repositorio de Git. Aider envía diferencias al modelo y aplica los cambios automáticamente, lo que resulta útil para la refactorización automatizada y los cambios de código programados.

- Ideal para: usuarios avanzados; refactorización automatizada a gran escala; Integración CI/CD

- Uso estratégico:Únase a LLaMA en Ollama para un desarrollo asistido por IA sin coste

Construyendo su estrategia de IA: un marco para desarrolladores

Con tantas herramientas disponibles, la pregunta no es «cuáles son las mejores» sino «cuáles son las mejores». en abstracto, se trata de «qué combinación sirve a mis objetivos específicos».

Aquí tienes un marco práctico:

Paso 1: define tu objetivo

¿Está creando un producto, automatizando un servicio o mejorando sus habilidades? Su objetivo determina su selección de herramientas. Un profesional independiente que automatiza los flujos de trabajo de los clientes necesita herramientas diferentes a las de un desarrollador que crea un producto SaaS.

Paso 2: Comience de manera simple

No construyas demasiado. Una sola llamada a la API de OpenAI y un buen mensaje pueden resolver una sorprendente cantidad de problemas. Utilice marcos y bases de datos cuando su caso de uso realmente los requiera.

Paso 3: Mide todo

Sin observabilidad, estás volando a ciegas. Agregue LangSmith, Helicone o Braintrust desde el primer día. Conozca los costos de sus tokens, la latencia y las tasas de falla.

Paso 4: Iterar las indicaciones antes de la arquitectura

La mayoría de los problemas de calidad de la IA son problemas inmediatos. Antes de refactorizar su arquitectura, invierta en ingeniería rápida. Pequeños cambios rápidos pueden duplicar la calidad sin costo adicional.

Paso 5: Monetizar temprano

La mejor estrategia de IA incluye un camino hacia los ingresos. Ya sea que esté ofreciendo un servicio de IA a sus clientes, creando una herramienta productiva o creando contenido en torno a su experiencia en IA, comience a pensar en la monetización desde la primera semana. La página principal Cómo ganar dinero con IA en learnAI cubre esto en profundidad.

Paso 6: Manténgase modular

El panorama de la IA cambia mensualmente. Construya su sistema para que pueda intercambiar modelos y proveedores sin reescribir su lógica central. Esto significa utilizar abstracciones (como la interfaz del modelo de LangChain) y nunca codificar código específico del proveedor en su lógica empresarial.

Tabla resumen comparativa

Patrones de estrategia de IA del mundo real para desarrolladores

Comprender las herramientas es una cosa y saber cómo se combinan en la práctica es otra. Aquí hay tres patrones que los desarrolladores experimentados utilizan regularmente.

El patrón del producto RAG

Cree una base de conocimientos a partir de los documentos de un cliente (PDF, wikis, bases de datos), fragmente e incruste en un almacén de vectores (Chroma para creación de prototipos, Pinecone para producción) y proporcione una interfaz de chat impulsada por Claude o GPT-4o. Este patrón por sí solo impulsa docenas de productos de inteligencia artificial rentables, desde robots de atención al cliente hasta asistentes de conocimiento internos. Pila: Claude + Pinecone + LangChain + Vercel AI SDK.

El patrón de la agencia de automatización

Utilice n8n o Make.com para conectar llamadas de modelos de IA con las herramientas existentes del cliente (CRM, correo electrónico, Slack, hojas de cálculo). El desarrollador escribe una lógica de aviso ligera y conecta las tuberías. El cliente obtiene flujos de trabajo automatizados; obtienes un anticipo recurrente. Este es uno de los caminos más rápidos hacia la obtención de ingresos para los desarrolladores con habilidades en IA. Pila: n8n + OpenAI API + herramientas existentes del cliente.

El patrón SaaS mejorado por IA

Tome una categoría existente de SaaS (gestión de proyectos, herramientas de escritura, CRM) y agregue una capa de inteligencia artificial que haga que el producto sea mucho más útil. No estás compitiendo por funciones, estás compitiendo por inteligencia. Utilice Cursor para crear rápidamente, LangGraph para la lógica del agente y LangSmith para supervisar la calidad. Pila: Cursor + LangGraph + LangSmith + cualquier modelo de base.

Preguntas frecuentes

¿Necesito elegir un modelo de base y seguir con él?

En absoluto. La mayoría de los sistemas de IA maduros utilizan estratégicamente múltiples modelos: un modelo más barato y más rápido para tareas simples y un modelo más capaz para razonamientos complejos. Resumir las llamadas de tu modelo a través de una interfaz unificada hace que esto sea fácil de administrar.

¿Vale la pena aprender LangChain en 2026?

Sí, pero con matices. LangChain es útil para aprender conceptos y construir rápidamente. Para los sistemas de producción, muchos desarrolladores migran a implementaciones más sencillas o LangGraph para la orquestación de agentes. Comprender LangChain le ayuda a comprender el ecosistema.

¿Cómo mantengo bajo control los costos de mi API de IA?

Utilice la observabilidad desde el primer día (Helicone es el más fácil de agregar). Caché de solicitudes idénticas o casi idénticas. Utilice modelos más pequeños y económicos para tareas rutinarias y reserve modelos costosos para razonamientos genuinamente complejos. Agregue un límite de tarifas para evitar costos descontrolados.

¿Debo autohospedar modelos o utilizar API?

Para la mayoría de los desarrolladores, las API administradas son el punto de partida adecuado: menor sobrecarga operativa, sin costos de GPU e iteración más rápida. El autohospedaje tiene sentido cuando tienes un gran volumen (para reducir los costos por llamada), requisitos estrictos de privacidad de datos o necesitas ajustar datos de propiedad exclusiva.

Conclusión

La estrategia de IA para desarrolladores no se trata de tener la mayor cantidad de herramientas, sino de elegir las herramientas adecuadas, combinarlas de manera inteligente y ofrecer cosas que creen valor real. Los desarrolladores que ganan en este momento son aquellos que han dejado atrás la “experimentación con IA” y han dejado de serlo. en la construcción de sistemas y productos repetibles.

Empiece con un objetivo claro. Elija un modelo de base. Agregue observabilidad antes de que la necesite. Construir modulares. Y nunca dejes de aprender: el panorama seguirá cambiando, pero los fundamentos sólidos se agravan.

¿Listo para aprender IA? Únase a la comunidad learnAI → Comunidad learnAI Skool