Cosa sono i modelli linguistici di grandi dimensioni (LLM)? Spiegazione completa

Tempo di lettura: 22 minuti

Aggiornato: marzo 2026

Introduzione

Miliardi di persone ora utilizzano modelli linguistici di grandi dimensioni ogni giorno, da ChatGPT e Claude a Gemini di Google e Llama di Meta. Probabilmente hai interagito con uno senza nemmeno rendertene conto. Tuttavia, la maggior parte degli utenti non ha idea di come funzionino effettivamente questi sistemi o di cosa li renda diversi dai motori di ricerca tradizionali e dall’intelligenza artificiale.

Il problema? Gli LLM sono diventati così perfettamente integrati nelle nostre vite digitali che il loro potere, i limiti e le capacità rimangono misteriosi per la persona media. Questo divario di conoscenze porta sia ad aspettative irrealistiche che a opportunità mancate.

La promessa di questa guida è semplice: spiegare i modelli linguistici di grandi dimensioni partendo dai principi fondamentali, coprendo tutto, dal modo in cui vengono formati a ciò che possono e non possono fare, completi di esempi reali e benchmark attuali del 2026.

Entro la fine di questo articolo capirai:

– Che cos’è effettivamente un LLM e in cosa differisce dagli altri AI

– L’architettura del trasformatore che alimenta i moderni LLM

– Come le aziende addestrano questi modelli su scala miliardaria

– I modelli più grandi disponibili oggi e le loro specifiche

– Oltre 15 applicazioni reali che trasformano i settori

– Le dure limitazioni degli attuali LLM

– Migliori pratiche per utilizzarli in modo efficace

Immergiamoci.

Sommario

- Che cos’è un LLM? La definizione semplice

- Come funzionano i LLM: l’architettura del trasformatore spiegata in modo semplice

- Come vengono formati i LLM: pre-formazione, perfezionamento e RLHF

- I più grandi LLM nel 2026: GPT-4o, Claude 3.5, Gemini 1.5, Llama 3, Mistral

- Cosa possono fare gli LLM: 15 applicazioni nel mondo reale

- Cosa non possono fare i LLM: limitazioni e allucinazioni

- LLM vs AI tradizionale vs Motori di ricerca

- Come utilizzare i LLM in modo efficace: suggerimenti pratici

- Il futuro dei LLM: cosa accadrà nel 2026 e oltre

- FAQ: risposte alle tue domande sui LLM

Che cos’è un LLM? La definizione semplice

Un Large Language Model (LLM) è un sistema di intelligenza artificiale addestrato su grandi quantità di dati di testo per comprendere e generare il linguaggio umano.

Ecco cosa significa in pratica:

Il concetto fondamentale

Un LLM funziona prevedendo la parola successiva (o “token”, un piccolo pezzo di linguaggio) in una sequenza. Quando scrivi un messaggio come “Spiega l’informatica quantistica in termini semplici”, LLM legge il tuo input e quindi genera una risposta appropriata, un token alla volta, prevedendo sempre cosa dovrebbe accadere dopo in base ai modelli appresi durante la formazione.

Considerala come una funzionalità di completamento automatico estremamente sofisticata, simile a come il tuo telefono suggerisce la parola successiva durante la digitazione. Ma invece di fare previsioni basate su poche migliaia di documenti, gli LLM vengono addestrati su trilioni di token estratti da libri, siti web, documenti accademici, archivi di codici e altre fonti di testo.

Caratteristiche chiave

Grande: i moderni LLM contengono miliardi o addirittura trilioni di parametri (valori matematici che codificano modelli linguistici). GPT-5 ha oltre 10 trilioni di parametri. I modelli più grandi generalmente funzionano meglio ma richiedono una maggiore potenza di calcolo.

Lingua: i LLM sono specializzati nella comprensione e nella generazione di linguaggio basato su testo. I modelli più recenti (2026) possono anche elaborare immagini, audio e video insieme al testo, rendendoli multimodali.

Modello:Un LLM è una rete neurale, una struttura matematica ispirata al modo in cui si connettono i neuroni biologici. Queste reti imparano regolando milioni di parametri attraverso l’allenamento, in modo simile a come il tuo cervello rafforza le connessioni neurali attraverso l’apprendimento.

Esempio rapido

Richiesta: “Cos’è la fotosintesi?”

Cosa fa il LLM:

1. Tokenizza il tuo input (lo spezza in pezzi)

2. Elabora ciascun token attraverso i livelli del trasformatore (spiegato di seguito)

3. Prevede il token successivo più probabile: “Fotosintesi”

4. Quindi predice il successivo: “è”

5. Quindi: “il”

6. E così via fino a completare una risposta coerente

Conclusione chiave: un LLM è una rete neurale addestrata su enormi quantità di testo per prevedere modelli linguistici e generare risposte di tipo umano.

Come funzionano i LLM: l’architettura Transformer spiegata in modo semplice

La svolta che ha reso possibili i moderni LLM è stata l’architettura Transformer, introdotta nel 2017 in un documento intitolato “L’attenzione è tutto ciò di cui hai bisogno”.

Comprendere i trasformatori è la chiave per capire perché i LLM sono così potenti.

Il problema Transformers risolto

Prima dei trasformatori, i ricercatori dell’intelligenza artificiale utilizzavano architetture chiamate RNN (Recurrent Neural Networks) che elaboravano il testo una parola alla volta, in sequenza. Questo approccio aveva un punto debole critico: avevano difficoltà a ricordare parole lontane in passaggi lunghi. Se avessi una frase con 50 parole, il modello avrebbe difficoltà a ricordare quale fosse la prima parola nel momento in cui elabora la cinquantesima parola.

Transformers ha risolto questo problema con un meccanismo intelligente chiamato autoattenzione.

Autoattenzione: l’innovazione fondamentale

L’autoattenzione consente al modello di guardare simultaneamente tutte le parole in una frase e di capire quali parole sono più importanti per comprendere altre parole.

Ecco un esempio concreto:

Frase: “Il direttore della banca sedeva sulla riva del fiume.”

Durante l’elaborazione della parola “banca” (prima occorrenza), il modello utilizza l’autoattenzione per chiedere: “Quali altre parole in questa frase sono più rilevanti per comprendere questa parola?” Si scopre che “executive” e “sat” sono importanti indizi di contesto che suggeriscono che si tratta di un istituto finanziario.

Quando si elabora la seconda “riva”, l’autoattenzione del modello si rende conto che “fiume” è l’indizio chiave del contesto, indicando che stiamo parlando di una posizione geografica.

Questa elaborazione parallela di tutti i token contemporaneamente, oltre alla capacità di valutare l’importanza dei token distanti, è ciò che rende i trasformatori così efficaci.

La pipeline completa del trasformatore

Ecco come il testo scorre attraverso un modello di trasformatore:

1. Tokenizzazione

Il testo immesso è suddiviso in token: piccoli pezzi che rappresentano parole o sottoparole. La frase “Hello world” potrebbe diventare token [101, 7592, 2088] (numeri che rappresentano ogni pezzo).

2. Incorporamento

Ogni token viene convertito in un vettore (un elenco di numeri) che cattura il significato. Il token per “ciao” diventa qualcosa come [0.2, -0.5, 0.8, 1.2, …] con centinaia o migliaia di dimensioni.

3. Codifica posizionale

Poiché i trasformatori elaborano tutti i token contemporaneamente, devono conoscere l’ordine delle parole. Codifiche posizionali speciali vengono aggiunte a ciascun incorporamento per indicare al modello dove appare ciascun token nella sequenza.

4. Livelli trasformatore (Attenzione + Feed-Forward)

L’incorporamento passa attraverso più strati del trasformatore (i modelli moderni utilizzano più di 40-100 strati). Ogni livello contiene:

– Attenzione multi-testa: molteplici meccanismi di autoattenzione che funzionano in parallelo, ciascuno focalizzato su aspetti diversi del linguaggio

– Rete feed-forward: una semplice rete neurale che elabora ciascun token in modo indipendente

– Normalizzazione dei livelli e connessioni residue:Tecniche che stabilizzano la formazione

5. Generazione di output

Dopo aver attraversato tutti gli strati, l’incorporamento finale viene riconvertito in una distribuzione di probabilità su tutti i possibili token. Il modello seleziona il token successivo più probabile (o ne campiona uno utilizzando varie strategie) e lo aggiunge all’output.

6. Generazione autoregressiva

Il token appena generato viene restituito come input e il processo si ripete. Questo approccio “autoregressivo”, in cui l’output diventa il nuovo input, continua finché il modello non genera un token di stop o raggiunge un limite di lunghezza.

Perché questa architettura funziona

I Transformer sono potenti perché possono:

– Elabora le sequenze in parallelo anziché in sequenza, rendendo la formazione più veloce

– Imparare le dipendenze a lungo termine attraverso l’attenzione verso se stessi, ricordando il contesto rilevante in documenti lunghi

– Trasferire l’apprendimento in modo efficace in modo che un modello pre-addestrato su un compito possa funzionare bene su compiti diversi

– Scala in modo efficace con più parametri, più dati e più potenza di calcolo, in genere migliorando le prestazioni

Conclusione chiave: l’architettura del trasformatore utilizza l’autoattenzione per consentire ai modelli di valutare l’importanza di parole diverse simultaneamente, consentendo loro di comprendere il contesto e generare testo coerente di lunga durata.

Come vengono formati i LLM: pre-formazione, perfezionamento e RLHF

La creazione di un LLM richiede tre fasi di formazione distinte. Comprendere questo processo rivela perché i LLM sono così costosi e perché presentano determinati punti di forza e di debolezza.

Fase 1: pre-formazione (The Foundation)

La pre-formazione è il momento in cui si sviluppa la potenza computazionale grezza. Ecco cosa succede:

Il processo:

1. Le aziende raccolgono trilioni di token da diverse fonti: libri, siti Web, documenti accademici, archivi di codici, articoli di notizie e altri testi pubblici

2. Il modello è addestrato su un obiettivo semplice: dati N token, prevedere il (N+1)esimo token

3. La formazione utilizza enormi cluster di elaborazione (spesso più di 10.000 GPU) in esecuzione per settimane o mesi

4. Miliardi di passaggi di formazione modificano gradualmente i parametri del modello

Il costo:

– La formazione GPT-5 è costata da circa 500 milioni di dollari a oltre 1 miliardo di dollari in risorse computazionali (stime 2026)

– Consumo energetico: addestrare modelli di grandi dimensioni consuma abbastanza elettricità per alimentare piccole città

– Tempo di formazione: settimane o mesi di calcolo continuo

Cosa apprende il modello:

Durante il pre-allenamento, il modello assorbe:

– Modelli linguistici e grammatica

– Conoscenza fattuale (cosa letto nei dati di addestramento)

– Modelli di ragionamento e approcci alla risoluzione dei problemi

– Codice, matematica e conoscenze specialistiche

– Distorsioni presenti nei dati di addestramento

Limiti del solo pre-formazione:

Un modello pre-addestrato, sebbene capace, non è ancora ottimizzato per essere utile agli utenti. Potrebbe:

– Completare il testo in modi innaturali (imitando modelli di dati di addestramento)

– Genera contenuti dannosi se apparivano nei dati di addestramento

– Non seguire bene le istruzioni per l’utente

– Allucinazioni o inventare fatti

Ecco perché è necessaria la Fase 2.

Fase 2: perfezionamento (renderlo utile)

L’ottimizzazione adatta il modello preaddestrato per renderlo più utile, innocuo e onesto.

Perfezionamento supervisionato (SFT):

1. Le aziende assumono annotatori (valutatori umani) per creare esempi di formazione di alta qualità

2. Ogni esempio mostra un prompt e una risposta di alta qualità

3. Il modello impara a imitare queste risposte di alta qualità

4. Questa fase utilizza in genere milioni di esempi di formazione (più piccoli della pre-formazione)

5. Tempo di formazione: giorni o settimane su cluster computazionali più piccoli

Esempio di coppia di allenamento:

– Input: “Qual è il modo migliore per apprendere il machine learning?”

– Risultato ideale: “Inizia con i fondamenti di algebra lineare e statistica. Quindi impara Python. Passa all’apprendimento supervisionato (regressione, classificazione), quindi all’apprendimento non supervisionato. Fai pratica con i set di dati Kaggle…”

Attraverso la messa a punto supervisionata, il modello apprende:

– Come strutturare le risposte in modo professionale

– Rifiutare richieste dannose

– Seguire le istruzioni in più passaggi

– Come suddividere chiaramente argomenti complessi

Fase 3: apprendimento per rinforzo dal feedback umano (RLHF)

RLHF è l’ingrediente segreto che fa sentire i moderni LLM come se stessero davvero cercando di aiutarti.

Come funziona RLHF:

- Genera risposte del candidato: per un prompt, il modello genera 4-8 diverse risposte possibili

- Classifica umana: gli annotatori classificano queste risposte dalla migliore alla peggiore, considerando:

- Precisione

- Utilità

- Sicurezza

- Chiarezza

- Concisione

- Addestra un modello di ricompensa: una rete neurale separata impara a prevedere le preferenze umane. Data una risposta, assegna un punteggio (più alto = più simile a quello che preferiscono gli umani)

- Ottimizza il LLM: il LLM originale viene adattato per massimizzare il suo punteggio di ricompensa, imparando a generare risposte che gli umani preferiscono

- Iterazione: le aziende eseguono più cicli di RLHF, migliorando continuamente l’allineamento

Perché è importante:

RLHF spiega perché Claude si sente diverso da GPT, che a sua volta si sente diverso da Gemini. Ogni azienda gestisce RLHF con preferenze, annotatori e segnali di ricompensa leggermente diversi, dando vita a modelli con “personalità” distinte.

Riepilogo della sequenza temporale della formazione

Concetti chiave: la formazione LLM è un processo in tre fasi: la pre-formazione sviluppa la comprensione fondamentale del linguaggio, la messa a punto supervisionata insegna al modello a essere utile e RLHF ottimizza per le preferenze umane.

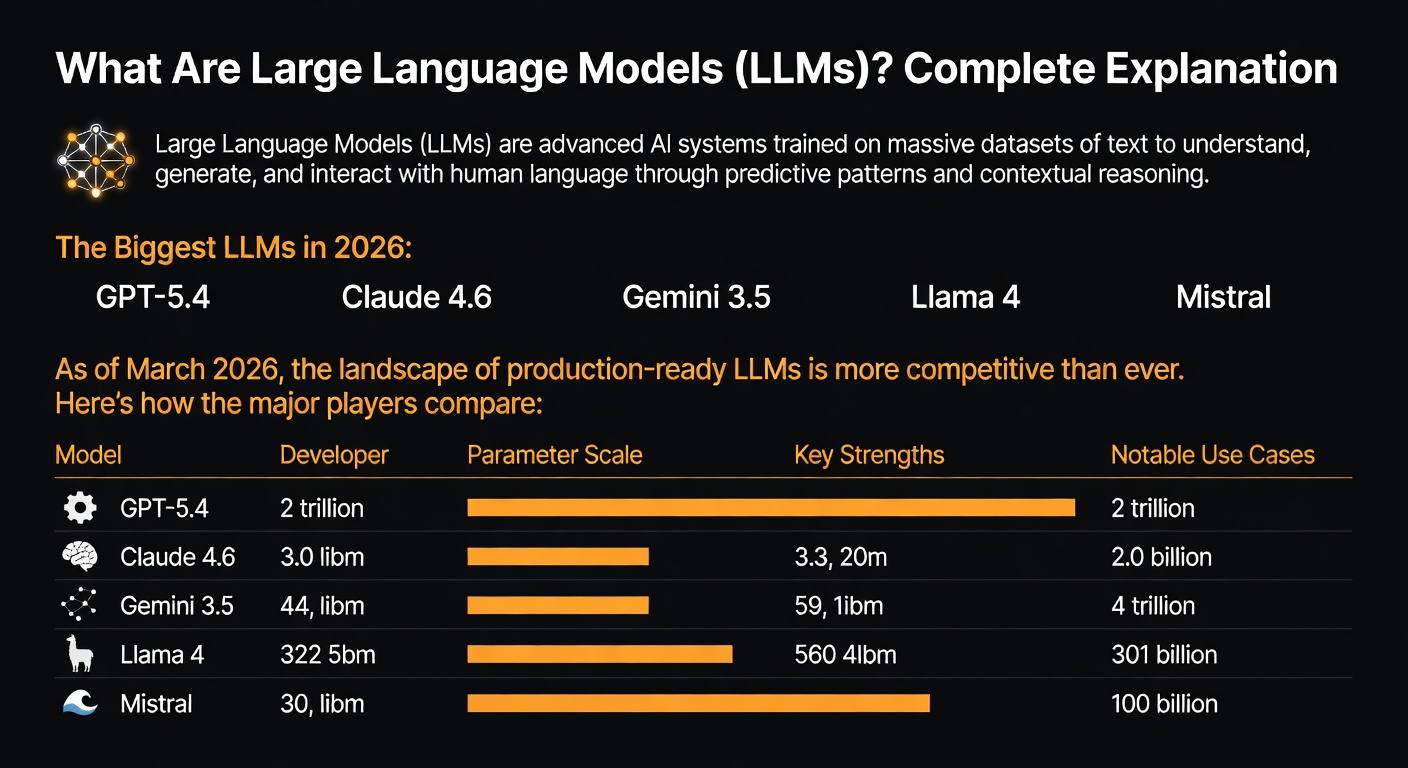

I più grandi LLM nel 2026: GPT-4o, Claude 3.5, Gemini 1.5, Llama 3, Mistral

A partire da marzo 2026, il panorama dei LLM pronti per la produzione è più competitivo che mai. Ecco come si confrontano i principali attori:

OpenAI GPT-5.4

Pubblicazione: marzo 2026

Parametri: oltre 10 trilioni (stimati)

Finestra di contesto: 1.000.000 di token (~750.000 parole)

Caratteristiche principali:

– Modelli unificati per uso generale e di codifica in un unico fiore all’occhiello

– Funzionalità di utilizzo nativa del computer (può controllare il tuo computer)

– Sforzo di ragionamento configurabile (scegliere velocità vs precisione)

– Input multimodale nativo (testo, immagini, video in un unico prompt)

– Prestazioni di riferimento leader del settore

Ideale per: utenti che desiderano il modello più potente in assoluto; le imprese che necessitano di automazione dell’uso del computer

Prezzi: $ 20/mese (Plus), $ 200/mese (Pro) o API con pagamento in base all’uso

Documenti ufficiali: Documentazione OpenAI GPT

Punti di forza:

– Punteggi benchmark più alti nella maggior parte dei test

– Ragionamento più sofisticato

– Più veloce nella maggior parte delle attività

– Comunità ed ecosistema più grandi

Punti deboli:

– Il più costoso da usare

– Meno trasparenza sulla formazione

– Richiede fiducia nel sistema closed-source

Antropico Claude Opus 4.1

Pubblicazione: agosto 2025

Parametri: oltre 2 trilioni (stimati)

Finestra di contesto: 1.000.000 di token (~750.000 parole)

Caratteristiche principali:

– IA costituzionale (addestrata per essere utile, innocua, onesta)

– Tassi di allucinazioni estremamente bassi tra tutti i modelli

– Forte nell’analisi e nel ragionamento

– Eccellente nel seguire istruzioni dettagliate

– Elaborazione nativa di PDF, immagini e video

Ideale per: ricerca, scrittura dettagliata, analisi; gli utenti danno priorità alla precisione rispetto alla potenza pura; lavoro creativo

Prezzo: $ 20/mese (Claude.ai Plus), $ 1.000/mese (Claude.ai Teams) o API pay-per-use

Documenti ufficiali: Documentazione antropica di Claude

Punti di forza:

– Il più affidabile per la precisione

– Migliore nell’analisi di lunga durata

– Approccio costituzionale più forte all’IA

– Ottimo per attività creative e ricche di sfumature

Punti deboli:

– Leggermente più lento di GPT in alcune attività

– Ecosistema più piccolo di OpenAI

– Meno conosciuto nel mercato tradizionale

Google Gemini 3.1 Pro

Pubblicazione: marzo 2026

Parametri: oltre 1,2 trilioni (stimati)

Finestra di contesto: 1.000.000 di token (può elaborare interi film nel contesto)

Caratteristiche principali:

– Finestra di contesto più grande di qualsiasi modello commerciale

– Integrazione perfetta con l’ecosistema Google (Workspace, Ricerca, Android)

– Funziona contemporaneamente come assistente alla produttività e motore di ricerca

– Multimodale con eccezionale comprensione delle immagini

– Accesso in tempo reale ai risultati di ricerca di Google

Ideale per: utenti abituali di Google Workspace; automazione della produttività; esigenze di informazioni in tempo reale

Prezzi: Livello gratuito con limitazioni, $ 20 al mese (Gemini Advanced) o API a pagamento

Documenti ufficiali: Documentazione di Google AI

Punti di forza:

– Ampia finestra di contesto per l’elaborazione dei documenti

– Integrazione perfetta con Google

– Accesso alla ricerca in tempo reale

– Eccellente per contenuti multimediali

– Forte comprensione delle immagini

Punti deboli:

– L’API può essere più lenta rispetto alla concorrenza

– Problemi di privacy legati all’integrazione di Google

– Meno testato per alcune attività specializzate

Meta Llama 4 (open source)

Pubblicazione: aprile 2025

Parametri: 400B (Scout), 1.4T (Maverick) (versioni standard; varianti MoE più grandi)

Finestra di contesto: 10.000.000 di token (Scout): il più grande di qualsiasi modello

Caratteristiche principali:

– Architettura Mixture-of-Experts (MoE): utilizza solo le parti rilevanti del modello per query

– Nativamente multimodale (testo, immagini, video)

– Open source: può essere eseguito localmente o ospitato autonomamente

– Benchmark competitivi con GPT e Gemini a 1/10 del costo

– Forti capacità di codifica e ragionamento

Ideale per: sviluppatori che desiderano ospitare autonomamente; imprese che necessitano di efficienza dei costi; organizzazioni che desiderano il controllo completo sui dati

Prezzi: gratuiti (open source) o inferenza tramite fornitori come Together, Replicate ($ 0,50-$ 2 per milione di token)

Documenti ufficiali: Documentazione Meta Llama

Punti di forza:

– Ampia finestra di contesto

– Estremamente conveniente

– Nessuna restrizione di utilizzo

– Può essere ospitato autonomamente

– Ottimo rapporto prestazioni/costi

Punti deboli:

– Richiede una configurazione tecnica per l’utilizzo

– Meno lucido rispetto ai modelli commerciali

– Comunità di utenti più piccola

– Tassi di allucinazioni leggermente superiori a quelli di Claude

Mistral AI Mixtral 8x22B

Pubblicazione: aprile 2025

Parametri: 141B (mix di esperti, utilizza 39B attivi)

Finestra di contesto: 65.000 token

Caratteristiche principali:

– Miscela efficiente di esperti (indirizza le domande a esperti specializzati)

– Open source e facile da implementare

– Ragionamento eccezionale per le sue dimensioni

– Codificazione e matematica forti

– Inferenza a bassa latenza

Ideale per: sviluppatori che desiderano modelli open source efficienti; applicazioni sensibili ai costi; compiti specializzati

Prezzi: inferenza gratuita (open source) o economica tramite fornitori ($ 0,10-$ 0,50 per milione di token)

Documenti ufficiali: Documentazione Mistral AI

Punti di forza:

– Miglior rapporto prestazioni/costi

– Abbastanza piccolo per i dispositivi edge

– Open source e modificabile

– Inferenza veloce

– Forte in compiti specializzati

Punti deboli:

– Finestra di contesto più piccola rispetto ai leader

– Non altrettanto capace per compiti a tempo indeterminato

– Tassi di allucinazioni più alti rispetto ai modelli di frontiera

Tabella di confronto dei modelli

Conclusione chiave: il mercato LLM del 2026 offre opzioni per ogni caso d’uso: massima potenza (GPT-5), massima precisione (Claude), migliore produttività (Gemini), efficienza in termini di costi (Llama) ed efficienza snella (Mistral). La tua scelta dipende dalle tue esigenze specifiche, dal tuo budget e dalla tua infrastruttura.

Cosa possono fare gli LLM: 15 applicazioni del mondo reale

I LLM si sono spostati dai laboratori di ricerca all’infrastruttura centrale di prodotti e servizi. Ecco 15 applicazioni collaudate che stanno trasformando le industrie in questo momento:

1. Automazione del servizio clienti

Settore: vendita al dettaglio, SaaS, finanza

I chatbot aziendali ora gestiscono il 40-60% delle richieste dei clienti senza intervento umano, analizzando i ticket di supporto per identificare modelli e formando risposte di qualità. Le aziende segnalano un miglioramento del 30-50% nei tassi di risoluzione alla prima chiamata e nella disponibilità 24 ore su 24, 7 giorni su 7. Un grande istituto finanziario elabora quotidianamente oltre 10.000 interazioni con i clienti con sistemi di supporto basati su LLM.

2. Generazione di contenuti e ottimizzazione Cura

Settore: marketing, editoria, media

I LLM generano post di blog, contenuti sui social media, campagne e-mail e descrizioni di prodotti su larga scala. Strumenti come Jasper, Copy.ai e Claude sono diventati standard nei team di marketing. Un’agenzia di content marketing può ora produrre contenuti 5 volte superiori a 1/3 del costo utilizzando l’assistenza LLM con revisione umana.

3. Generazione di codice e amp; Debug

Settore: sviluppo software

GitHub Copilot utilizza LLM per suggerire completamenti di codice, generare test e spiegare il codice. Gli studi dimostrano che gli sviluppatori che utilizzano gli assistenti di codifica AI completano le attività il 35-55% più velocemente. Dalla scrittura di boilerplate al refactoring di interi sistemi, i LLM sono diventati strumenti di sviluppo indispensabili.

4. Automazione delle cartelle cliniche

Settore: sanità

I LLM ascoltano le conversazioni medico-paziente e le trascrivono automaticamente in cartelle cliniche strutturate, estraendo sintomi, diagnosi, farmaci e piani di trattamento. Ciò elimina 20-30 minuti di documentazione per paziente, migliorando la produttività del medico.

5. Ricerca legale Analisi del contratto

Settore: diritto

I migliori studi legali che utilizzano strumenti di ricerca legale basati su LLM riducono i tempi di ricerca del 60%. I LLM analizzano le decisioni dei tribunali per suggerire precedenti rilevanti, rivedere i contratti per clausole rischiose e identificare i problemi di conformità normativa. Strumenti come LexisNexis+ e Westlaw Edge AI ora includono funzionalità LLM.

6. Intelligenza sulle vendite e Punteggio principale

Settore: vendite B2B

Gli LLM analizzano il comportamento dei potenziali clienti, le e-mail e i dati aziendali per valutare automaticamente la qualità dei lead. I team di vendita che utilizzano sistemi di lead scoring basati sull’intelligenza artificiale migliorano i tassi di conversione del 20-30% concentrandosi sulle opportunità con la più alta probabilità.

7. Educazione personalizzata e Tutoraggio

Settore: EdTech

I LLM adattano i contenuti educativi agli stili di apprendimento individuali, generano domande pratiche personalizzate, forniscono spiegazioni su misura per il livello di comprensione e offrono tutoraggio 24 ore su 24, 7 giorni su 7. Ciò democratizza l’accesso all’istruzione ed è particolarmente efficace per gli studenti che necessitano di ulteriore supporto.

8. Descrizione del prodotto e; Ottimizzazione dell’e-commerce

Settore: vendita al dettaglio, mercato

Le piattaforme di e-commerce utilizzano LLM per generare descrizioni di prodotti, confrontare le funzionalità della concorrenza, ottimizzare i titoli per la ricerca e analizzare le recensioni dei clienti per migliorare le schede dei prodotti. I rivenditori segnalano aumenti del 15-25% nei tassi di conversione.

9. Screening e curriculum del curriculum Reclutamento

Settore: risorse umane, reclutamento

I LLM esaminano migliaia di curriculum, estraggono qualifiche, identificano i candidati migliori e selezionano le competenze richieste, riducendo dell’80% il tempo impiegato dai reclutatori per lo screening iniziale. Ciò accelera il processo di assunzione migliorando al contempo l’abbinamento dei candidati.

10. Analisi finanziaria e Riepilogo chiamate guadagni

Settore: finanza, investimenti

I LLM analizzano le trascrizioni degli utili, i rapporti trimestrali e i rendiconti finanziari per estrarre informazioni chiave, prevedere tendenze e riepilogare le prestazioni. Le società di investimento utilizzano l’analisi basata su LLM per identificare i segnali più velocemente rispetto ai concorrenti.

11. Elaborazione delle richieste di risarcimento assicurativo

Settore: assicurazioni

I LLM estraggono informazioni dai documenti di richiesta, effettuano controlli incrociati sulla copertura delle polizze, calcolano gli importi dei pagamenti e generano comunicazioni di risposta. I sistemi agenti gestiscono le richieste di risarcimento di routine senza intervento umano, riducendo i tempi di elaborazione da giorni a minuti.

12. Ottimizzazione degli elenchi immobiliari

Settore: settore immobiliare

I LLM analizzano le tendenze del mercato, generano descrizioni di proprietà, confrontano gli elenchi della concorrenza e identificano automaticamente proprietà comparabili per i prezzi. Gli agenti dedicano meno tempo al lavoro amministrativo e più tempo alle interazioni di alto valore con i clienti.

13. Traduzione linguistica e Localizzazione

Settore: affari globali, localizzazione

I LLM moderni traducono i contenuti in più lingue preservando le sfumature, il linguaggio e il contesto culturale meglio degli approcci precedenti. Le aziende che localizzano prodotti in nuovi mercati possono farlo in modo più rapido e conveniente.

14. Analisi del sentiment e analisi del sentiment Monitoraggio dei social media

Settore: gestione del marchio, customer intelligence

I LLM analizzano le menzioni sui social media, le recensioni dei clienti e i feedback per comprendere il sentiment del marchio in tempo reale. Le aziende rilevano i problemi emergenti, monitorano la percezione del marchio e identificano i punti critici dei clienti su larga scala.

15. Documentazione tecnica Documentazione API

Settore: software, strumenti di sviluppo

I LLM generano documentazione software, guide API ed esempi di implementazione. Ciò riduce il tempo che gli sviluppatori dedicano alla documentazione e aiuta a mantenere la precisione man mano che il codice si evolve.

Statistiche sull’adozione del settore

Secondo McKinsey Technology Trends Outlook 2025, l’uso di sistemi di intelligenza artificiale generativa basati su LLM nelle aziende è passato dal 33% nel 2024 al 67% nel 2025, raddoppiando in un solo anno. Entro il 2026, l’adozione supererà l’80% nei settori della tecnologia, della finanza e dei servizi professionali.

Conclusione chiave: gli LLM non sono più sperimentali: sono infrastrutture di produzione. Quasi tutti i settori stanno trovando applicazioni, con i maggiori guadagni di produttività nel lavoro basato sulla conoscenza: scrittura, analisi, codifica, interazione con i clienti e ricerca.

Cosa non possono fare gli LLM: limitazioni e allucinazioni

Nonostante le loro straordinarie capacità, gli LLM presentano vincoli rigidi. Comprendere queste limitazioni è fondamentale per utilizzarle in modo efficace.

1. Allucinazioni (il problema più grande)

I LLM generano informazioni false apparentemente sicure chiamate “allucinazioni”. Il modello prevede token che sembrano plausibili ma che in realtà sono errati.

Perché succede:

– L’obiettivo dell’addestramento del modello è la previsione del token successivo, non la previsione della verità

– Gli LLM ottimizzano i modelli linguistici, non l’accuratezza

– Una volta che un LLM inizia un percorso falso, continua a elaborare la falsità

Esempio reale:

Suggerimento: “Qual è il numero di telefono della Casa Bianca?”

Un tipico LLM potrebbe rispondere: “Il numero di telefono della Casa Bianca è (202) 456-1111” (il che è corretto), ma a volte presenta varianti allucinanti o aggiunge false estensioni.

Più problematico:

Suggerimento: “Elenca tutti gli articoli scientifici pubblicati dalla Dott.ssa Jane Smith sull’informatica quantistica nel 2024.”

Un LLM potrebbe fabbricare interi articoli con titoli dal suono plausibile che in realtà non esistono.

Strategie di mitigazione:

– Verificare eventuali affermazioni fattuali in contesti ad alto rischio

– Utilizza la Retrieval-Augmented Generation (RAG) per consentire ai LLM di accedere ai dati correnti

– Richiedi fonti e citazioni

– Utilizza modelli appositamente ottimizzati per la precisione (Claude eccelle qui)

2. Nessuna conoscenza in tempo reale

I dati di formazione LLM hanno una data limite di conoscenza. I modelli addestrati nel 2024 non conoscono gli eventi del 2026 a meno che non forniscano esplicitamente tali informazioni.

Esempio:

Un modello formato fino ad aprile 2024 non sa:

– Chi ha vinto le elezioni americane del 2024

– Recenti movimenti del mercato azionario

– Lancio di nuovi prodotti

– Ultime notizie

Soluzione: utilizza LLM con accesso alla ricerca Web (come Gemini o Claude con strumenti esterni) o implementa sistemi RAG che alimentano informazioni attuali.

3. Limitazioni della finestra di contesto (parzialmente risolte)

Sebbene i modelli 2026 dispongano di finestre di contesto di milioni di token, presentano comunque dei limiti. Le informazioni nel mezzo di contesti molto lunghi a volte vengono “dimenticate” (il fenomeno del “perso nel mezzo”).

Limite pratico: sebbene un modello possa accettare 1 milione di token, le applicazioni pratiche di solito funzionano meglio con token da 50.000 a 200.000 a causa del calo dei costi e dell’attenzione.

4. Nessuna comprensione genuina

I LLM sono sofisticati sistemi di corrispondenza dei modelli, non entità coscienti con comprensione. Loro:

– Non riesco a “comprendere” veramente i concetti, riconosco solo i modelli

– Non avere memoria persistente tra le conversazioni

– Non è possibile verificare in modo indipendente i fatti

– Impossibile imparare davvero (i modelli sono statici dopo l’addestramento)

Nota filosofica: i filosofi discutono se ciò che fanno i LLM costituisca “comprensione”. Da un punto di vista pratico, gli LLM si comportano in modi indistinguibili dalla comprensione per molti compiti, ma questa limitazione è importante per i compiti di ragionamento critico.

5. Lotta con catene di ragionamento estremamente lunghe

Mentre gli LLM eccellono nel ragionamento in più fasi, le catene di ragionamento estremamente lunghe (oltre 50 passaggi) diventano meno affidabili. Gli errori si accumulano durante i passaggi.

Esempio:

Un problema di geometria che richiede 30 passaggi di ragionamento sequenziale potrebbe essere risolto correttamente il 70% delle volte, mentre un problema da 10 passaggi potrebbe essere risolto correttamente il 95% delle volte.

6. Scarso nelle attività che richiedono input sensoriali in tempo reale

I LLM non possono:

– Elabora feed video in diretta (solo immagini statiche)

– Ascolta l’audio in tempo reale (solo testo trascritto o audio preregistrato)

– Odorare, gustare o sentire

– Interagisci direttamente con gli ambienti fisici

I moderni modelli multimodali possono elaborare le immagini, ma non sono ancora in grado di gestire la vera percezione in tempo reale.

7. Capacità limitata di apprendere dai nuovi dati senza riqualificazione

Ogni conversazione con un LLM ricomincia da capo. Il modello non può imparare dal tuo feedback all’interno di una conversazione come fanno gli umani. Non “ricorderà” le correzioni apportate a meno che non vengano ricordate esplicitamente nella stessa conversazione.

8. Lotta con domini insoliti o altamente specializzati

I LLM sono più deboli nei domini che sono:

– Estremamente raro nei dati di formazione (campi accademici oscuri)

– Richiedere conoscenze all’avanguardia (documenti di ricerca pubblicati il mese scorso)

– Utilizzare un gergo altamente specializzato non ben rappresentato nei dati di addestramento

– Richiede esperienza pratica pratica

9. Non riesco a contare in modo affidabile o a fare calcoli aritmetici precisi

Ciò è sorprendente date le capacità matematiche degli LLM, ma hanno difficoltà con:

– Conteggio di grandi quantità

– Aritmetica a più cifre (soprattutto con riporto)

– Dimostrazioni matematiche precise

Esempio:

Suggerimento: “Conta il numero di ‘R’ nella parola ‘fragola’”

Molti LLM rispondono erroneamente “2” invece del “3” corretto

10. Ragionamento basato sul buon senso limitato

Sebbene gli LLM abbiano assorbito modelli dai dati di formazione, a volte non riescono a svolgere compiti di ragionamento che si basano su una profonda intuizione fisica o sociale che i bambini possiedono naturalmente.

Esempio:

“Una vasca da bagno è piena d’acqua. Qualcuno toglie un tappo dallo scarico della vasca. Cosa succede?”

I LLM di solito rispondono correttamente, ma variazioni insolite a volte li confondono.

Riepilogo delle limitazioni

Punto chiave: gli LLM eccellono nel linguaggio, nella corrispondenza di modelli e nella generazione di testi plausibili, ma hanno allucinazioni sui fatti, mancano di conoscenza in tempo reale e talvolta non riescono a svolgere compiti di ragionamento che sembrano semplici per gli esseri umani. Usali come strumenti potenti, non come oracoli.

LLM vs IA tradizionale vs motori di ricerca: qual è la differenza?

Se sei nuovo nel mondo dell’intelligenza artificiale, i LLM potrebbero sembrare simili ad altri sistemi di intelligenza artificiale di cui hai sentito parlare. Non lo sono. Ecco come si confrontano:

LLM rispetto ai modelli tradizionali di machine learning

ML tradizionale (regressione logistica, alberi decisionali, SVM, foreste casuali):

– Addestrato a prevedere una singola variabile (ad esempio, “Questo prestito andrà in default?” Sì/No)

– Richiedono funzionalità progettate manualmente (gli esseri umani creano manualmente variabili di input)

– Funziona meglio con set di dati di piccole e medie dimensioni (da migliaia a milioni di esempi)

– Interpretabile: spesso puoi capire perché un modello ha preso una decisione

– Allenarsi velocemente ed economicamente

– Utilizzato per classificazione, regressione, clustering

Esempio: una banca addestra una foresta casuale per prevedere i default dei prestiti utilizzando 20 caratteristiche (punteggio di credito, reddito, rapporto debito/reddito, storia lavorativa, ecc.). Prevede: 85% di possibilità di rimborso.

LLM:

– Addestrato a prevedere il token successivo in una sequenza (a durata aperta)

– Apprendi automaticamente le funzionalità dai dati di testo non elaborati

– Richiedono enormi set di dati (da miliardi a trilioni di token)

– Non interpretabile: scatola nera sul processo decisionale

– Costoso da addestrare (oltre 500 milioni di dollari) ma economico da utilizzare una volta addestrato

– Genera risultati creativi e aperti

Esempio:Chiedi a Claude: “Devo chiedere un prestito?” e analizza la tua situazione in modo olistico, considerando il contesto finanziario, le alternative e le circostanze personali, fornendo consigli sfumati.

LLM rispetto ad altri modelli AI/ML

Modelli di visione artificiale (rilevamento di oggetti, segmentazione di immagini):

– Specializzato per compiti visivi

– Impossibile elaborare il testo

– Le versioni moderne incorporano funzionalità multimodali

Sistemi di raccomandazione:

– Ottimizza per prevedere le preferenze dell’utente

– Non progettato per la generazione di testo con risposta aperta

– Utilizzato in Netflix, Spotify, Amazon

Grafici e informazioni sulla conoscenza Ricerca semantica:

– Memorizzare relazioni fattuali strutturate

– Sa rispondere a domande concrete e precise

– Non generare nuovi contenuti

LLM e motori di ricerca: le differenze chiave

Questo confronto è importante perché molte persone confondono i LLM con la Ricerca Google.

Differenze pratiche:

Domanda sul motore di ricerca:

“Qual è la capitale della Francia?”

→ Restituisce articoli di Wikipedia su Parigi, siti web governativi, mappe

Domanda LLM:

“Spiega perché Parigi si trova sulla Senna e come ciò ha influenzato il suo sviluppo come capitale”

→ Genera una sintesi approfondita di 2-3 paragrafi che spiega geografia, storia e importanza strategica

I LLM possono eseguire ricerche?

I LLM moderni incorporano sempre più la ricerca sul web:

– Gemini (Google) ha l’integrazione della ricerca in tempo reale

– A Claude possono essere forniti strumenti per la navigazione web

– OpenAI aggiunge la ricerca web a GPT

Questo crea un sistema ibrido che combina il ragionamento dei LLM con la freschezza dei motori di ricerca.

LLM vs Assistenti IA specializzati

Assistenti specializzati come:

– Siri, Alexa: interfacce vocali con capacità limitate, che in genere richiamano funzioni specifiche

– ChatBot per il servizio clienti: sistemi basati su regole o LLM ristretto che rispondono a domande predefinite

– Correttori grammaticali: specializzati per un compito ristretto

Differenza fondamentale: gli LLM sono di uso generale. Si adattano a qualsiasi compito tu chieda senza riqualificazione.

In sintesi: i LLM sono fondamentalmente diversi dal tradizionale ML (generazione aperta rispetto a previsione specifica), dai motori di ricerca (sintesi rispetto a recupero) e dagli assistenti specializzati (generale rispetto a ristretto). Occupano una posizione unica come sistemi di comprensione del linguaggio per scopi generali.

Come utilizzare gli LLM in modo efficace: suggerimenti pratici

Ora che hai capito cosa sono i LLM e i loro limiti, ecco come utilizzarli per ottenere il massimo valore.

1. Scrivi suggerimenti dettagliati e specifici

Prompt debole:

“Scrivere sul cambiamento climatico”

Suggerimento forte:

“Scrivi un post sul blog di 500 parole sugli impatti dei cambiamenti climatici sulla produzione alimentare globale. Concentrati su come l’aumento delle temperature influisce sui raccolti e sulla disponibilità di acqua nell’Africa subsahariana. Includi dati specifici per il 2024 e previsioni per il 2030. Usa un tono professionale ma accessibile per i lettori senza esperienza in scienze climatiche.”

Perché è importante: i LLM sono eccellenti nel seguire istruzioni dettagliate. Più specifica è la tua richiesta, migliore sarà il risultato.

2. Utilizza la mentalità “Prompt Engineering”

Tratta le richieste come codice: itera e perfeziona.

Approccio iterativo:

1. Scrivi il prompt iniziale

2. Esamina l’output

3. Identifica cosa manca o cosa è sbagliato

4. Perfeziona il prompt con più contesto o istruzioni

5. Ripeti finché non sei soddisfatto

Tecniche:

– Esempi di pochi scatti: fornisci 2-3 esempi del formato di output desiderato

– Gioco di ruolo: “Sei un consulente finanziario esperto…”

– Passo dopo passo: “Pensa passo dopo passo…”

– Vincoli: “Mantieni la risposta sotto le 200 parole…”

3. Verifica affermazioni fattuali

Non utilizzare mai l’output LLM come verità fondamentale senza verifica in contesti ad alto rischio.

Casi d’uso sicuri: Brainstorming, ideazione, stesura, spiegazione di concetti

Casi d’uso rischiosi: citare statistiche senza verifica, prendere decisioni mediche, consulenza legale

4. Utilizza i LLM come acceleratori di ricerca

I LLM sono eccezionali nel sintetizzare rapidamente le informazioni.

Flusso di lavoro:

1. Chiedi a LLM di spiegare un argomento

2. Chiedigli di identificare le lacune

3. Chiedigli di fornire punti di vista opposti

4. Utilizza queste basi per effettuare ricerche più approfondite

Esempio: “Riassumere i tre argomenti più forti a favore e contro il reddito di base universale, con citazioni chiave”

5. Sfruttare le capacità multimodali

I LLM moderni (2026) accettano immagini e alcuni accettano documenti e video.

Approcci utili:

– Carica uno screenshot e chiedi “Cosa sta succedendo in questa immagine?”

– Fornire un documento PDF e chiedere “Riassumi i risultati principali”

– Chiedi “Analizza questo grafico e identifica le tendenze”

– Carica una foto di un problema scritto a mano e chiedi una soluzione

6. Utilizza LLM per la generazione di codice e il debug

I LLM sono assistenti di programmazione eccezionali.

Usi efficaci:

– “Scrivi una funzione Python che…”

– “Esegui il debug di questo codice: [incolla codice]”

– “Spiega cosa fa questo codice in termini semplici”

– “Refactoring questo codice per prestazioni migliori”

– “Scrivi unit test per questa funzione”

7. Implementa la guida della catena di pensiero

Per ragionamenti complessi, chiedi esplicitamente al modello di ragionare passo dopo passo.

Debole: “Questo investimento è una buona idea?”

Forte: “Analizza questa opportunità di investimento passo dopo passo, considerando: (1) rendimenti potenziali, (2) fattori di rischio, (3) la mia tolleranza al rischio, (4) alternative. Quindi fornisci la tua raccomandazione con il ragionamento.”

8. Utilizza strumenti e API esterni

Migliora i LLM con le capacità che mancano:

- Calcolatrici per l’aritmetica

- API di ricerca Web per informazioni attuali

- Query nel database per fatti aggiornati

- Esecuzione del codice per verificare il funzionamento del codice

- Generazione di immagini per contenuti visivi

Ciò crea un “motore di ragionamento” molto più capace del solo LLM.

9. Comprendi le differenze dei modelli e scegli quello giusto

- GPT-5: Massima capacità, codifica, ragionamento complesso

- Claude: Precisione, analisi, scrittura lunga, sicurezza

- Gemelli: Produttività, integrazione con gli strumenti Google

- Llama: efficienza in termini di costi, self-hosting, controllo

Abbina l’attività al modello.

10. Implementa il controllo della versione per i tuoi prompt

Se utilizzi LLM ripetutamente per attività importanti:

– Salva istruzioni efficaci

– Documenta cosa funziona e cosa no

– Itera sui tuoi modelli

– Condividi i suggerimenti di successo con i team

11. Stabilisci aspettative adeguate

I LLM sono:

– ✓ Ottimo per redigere, fare brainstorming, spiegare

– ✓ Utile per scrivere le prime bozze

– ✓ Eccellente per apprendere nuovi argomenti

– ✓ Ottimo per analizzare testo e dati

– ✗ Non affidabile come unica fonte di fatti critici

– ✗ Non sostituisce la competenza nel settore

– ✗ Non infallibile nel ragionamento complesso

12. Scopri la personalità del tuo LLM

Ogni modello principale ha punti di forza diversi:

Claude:

– Risposte ponderate e approfondite

– Eccellente nell’ammettere l’incertezza

– Stime prudenti

– Ottimo per la scrittura sfumata

GPT-5:

– Più aggressivo/utile nello stile

– Più veloce in matematica e logica

– Meglio in contesti molto lunghi

– Tono più casual

Gemelli:

– Risposte concise e dirette

– Buono nelle informazioni in tempo reale

– Eccellente integrazione della ricerca

– Punti di forza multimodali

Verifica quale modello funziona meglio per il tuo caso d’uso specifico.

Conclusione chiave: l’efficacia dei LLM dipende da come li utilizzi. Scrivi suggerimenti dettagliati, verifica fatti importanti, usali come strumenti di accelerazione e scegli il modello giusto per la tua attività specifica.

Il futuro dei LLM: cosa accadrà nel 2026 e oltre

Cosa arriverà nel 2026

Vera integrazione multimodale

– Tutti i principali LLM elaboreranno senza problemi testo, immagini, video e audio in singoli prompt

– Comprensione del video in tempo reale (non solo fotogrammi statici)

– Conversazione audio in ingresso e in uscita (non richiede trascrizione)

– Comprensione e manipolazione del modello 3D

AI agente come predefinita

– LLM con memoria persistente tra sessioni

– Esecuzione autonoma delle attività (programmazione, ricerca, automazione)

– L’utilizzo degli strumenti diventa standard (ogni LLM integra le API per impostazione predefinita)

– Flussi di lavoro autonomi in più fasi senza intervento umano

Precisione migliorata

– I tassi di allucinazioni diminuiscono del 50-70% grazie a tecniche di allenamento migliorate

– Calcolo in fase di test (i modelli ragionano più duramente su problemi difficili)

– Migliore integrazione con i sistemi di recupero

– Proliferano modelli ottimizzati specifici per dominio

Riduzione dei costi

– I costi di inferenza scendono dagli attuali $ 0,01-0,15/mtok a $ 0,001-0,01/mtok

– I modelli open source self-hosted diventano pronti per la produzione

– I modelli più piccoli (parametri 50B-100B) corrispondono ai modelli di frontiera in molte attività

– L’implementazione Edge diventa pratica

2027 e oltre: The Longer Horizon

Modelli basati sul ragionamento

– Nuovo paradigma architettonico che va oltre i trasformatori

– Modelli ottimizzati per lunghe catene di ragionamento

– Dimostrazioni matematiche con verifica formale

– Generazione e verifica di ipotesi scientifiche

Apprendimento multimodale su larga scala

– Modelli addestrati su tutti i tipi di conoscenza umana contemporaneamente

– Comprensione del video a livello fotografico

– Comprensione di causa-effetto fisico dal video

– Comprensione del mondo 3D da osservazioni 2D

Memoria e apprendimento persistenti

– Modelli che accumulano conoscenza durante le conversazioni

– L’apprendimento “few-shot” diventa apprendimento “one-shot”

– Modelli personalizzati che apprendono le tue preferenze

– Apprendimento continuo dalle interazioni degli utenti (eticamente)

Modelli federati e di tutela della privacy

– Modelli che vengono eseguiti localmente mentre apprendono a livello globale

– Formazione incentrata sulla privacy in cui nessun dato grezzo lascia il tuo dispositivo

– L’apprendimento federato diventa standard

– Apprendimento automatico compatibile con la crittografia

Compromessi specializzati e generali

– Passaggio da un modello gigante a diversi modelli specializzati

– Il mix di esperti diventa un’architettura universale

– Modelli più piccoli e più veloci per compiti semplici

– Modelli estremamente grandi per ragionamenti complessi

– Selezione dinamica di quali modelli utilizzare

Efficienza energetica

– Miglioramenti di ordini di grandezza nell’efficienza di elaborazione

– Approcci al calcolo neuromorfico

– L’hardware AI specializzato diventa una merce

– I requisiti energetici per formazione e inferenza diminuiscono drasticamente

Sfide e domande emergenti

Allineamento e sicurezza

– Man mano che i modelli diventano più capaci, l’allineamento diventa più difficile

– Come possiamo garantire che i sistemi avanzati di intelligenza artificiale continuino ad essere utili?

– Chi controlla i modelli più potenti?

Disinformazione e autenticità

– Gli LLM rendono banale la creazione di informazioni false convincenti

– Come manteniamo la fiducia nelle informazioni?

– L’autenticazione e la provenienza diventano fondamentali

Lavoro e società

– I flussi di lavoro dei lavoratori della conoscenza si trasformano radicalmente

– Alcuni posti di lavoro scompaiono; emergono nuovi posti di lavoro

– La società deve affrontare la crisi con attenzione

– L’istruzione e la formazione diventano continue

Interpretabilità

– Gli attuali LLM rimangono scatole nere

– Come facciamo a capire come funzionano i modelli più potenti?

– Possiamo costruire modelli interpretabili che siano ancora capaci?

Cosa dovresti fare adesso

- Inizia a sperimentare: il modo migliore per comprendere il futuro è utilizzare questi strumenti oggi

- Sviluppare competenze: concentrarsi sulle competenze che i LLM non possono sostituire (creatività, giudizio, intelligenza emotiva, competenze specializzate)

- Impara il prompt engineering: questa diventa una preziosa competenza professionale

- Comprendi i limiti: non sopravvalutare ciò che accadrà; alcune sfide sono più difficili del previsto

- Rimani informato: segui gli sviluppi di OpenAI, Anthropic, Google, Meta e delle comunità open source

Principianti: il periodo 2026-2027 vedrà una continua e rapida evoluzione: migliore precisione, costi inferiori, ragionamento migliorato e capacità autonome. Il panorama LLM si sta evolvendo verso modelli specializzati, maggiore efficienza e sistemi di agenti. Il futuro dei LLM non è un unico modello superintelligente: è un ecosistema di diversi sistemi di intelligenza artificiale che lavorano insieme.

FAQ: risposte alle tue domande sui LLM

Q1: i LLM sono coscienti o intelligenti?

R: Questo è filosoficamente complesso. Gli LLM mostrano comportamenti che assomigliano alla comprensione e al ragionamento, ma non hanno:

– Coscienza o esperienza soggettiva (per quanto ne sappiamo)

– Vera comprensione (riconoscono schemi, non significati)

– Obiettivi o desideri persistenti

– Agenzia in senso filosofico

Risposta pratica: i LLM sono strumenti estremamente potenti per la corrispondenza di modelli e la generazione di testo che producono risultati simili a conversazioni intelligenti. Se ciò costituisca “intelligenza” dipende da come definisci il termine.

Q2: I LLM possono sostituire gli esseri umani nel mio lavoro?

R: Dipende dal tuo lavoro. È probabile che i LLM:

Aumenta (non sostituisce):

– Sviluppatori di software (sviluppo più rapido)

– Scrittori (redazione più rapida)

– Analisti (ricerca più rapida)

– Insegnanti (strumenti di apprendimento personalizzati)

– Medici (migliore assistenza diagnostica)

Può eventualmente sostituire:

– Rappresentanti del servizio clienti (per supporto di base)

– Assistenti legali junior (ricerca legale)

– Operatori di data entry

– Autori di contenuti (alcuni tipi)

– Assistenti traduttori

Realtà: la maggior parte dei posti di lavoro verrà aumentata dai LLM anziché eliminati. Le persone che imparano a lavorare in modo efficace con i LLM saranno più preziose. Il tuo vantaggio competitivo sta nell’imparare a utilizzare questi strumenti meglio delle alternative.

Q3: Quanto sono davvero accurati i LLM?

R: La precisione varia notevolmente in base all’attività:

- Domande semplici basate sui fatti: accurate al 75-90%

- Ragionamento matematico:Preciso al 60-85% (peggiore in aritmetica)

- Generazione del codice: accurata al 70-95% (a seconda della complessità)

- Attività creative: non si applica alcuna metrica di precisione

- Domini specializzati: 50-70% (se dati di addestramento esterni)

Punto chiave: devi verificare le rivendicazioni nei domini ad alto rischio. I LLM sono fiduciosi anche quando sbagliano.

Q4: Per cosa vengono utilizzati i miei dati di allenamento?

R: Questo varia in base al fornitore:

OpenAI: i dati di addestramento di GPT Plus e API verranno inseriti nell’addestramento futuro del modello (a meno che tu non decida di disattivarli)

Antropico: le conversazioni di Claude.ai possono essere riviste per migliorare la formazione, ma è disponibile la disattivazione esplicita

Google: le conversazioni di Gemini possono migliorare Gemini ma sono tenute separate dagli altri servizi Google (con controlli sulla privacy)

Regola generale: controlla le norme sulla privacy. Supponiamo che le conversazioni possano essere utilizzate per migliorare se non diversamente specificato.

Q5: Come faccio a sapere se il contenuto è stato scritto da un LLM?

R: Onestamente? Sta diventando più difficile. Indicatori chiave:

Contenuti generati da LLM spesso:

– Ha una struttura leggermente stereotipata

– Evita opinioni forti

– Include cliché e frasi abusate

– Ha una grammatica perfetta (a volte troppo perfetta)

– Manca di esempi personali specifici

– Segue schemi di contorno evidenti

Test:

– Porre domande di follow-up che richiedono conoscenze specifiche

– Cerca errori fattuali (allucinazioni)

– Controlla i casi limite insoliti: i LLM spesso non li vedono

– Esistono strumenti di rilevamento dell’intelligenza artificiale ma non sono affidabili

Realtà: il rilevamento dell’IA è una corsa agli armamenti. Man mano che i modelli migliorano, il rilevamento diventa più difficile.

D6: Usare gli LLM è “imbrogliare” a scuola?

R: La società sta ancora cercando di capirlo.

Considerazioni:

– Scrittura di documenti: utilizzare LLM senza divulgazione è plagio (disonestà accademica)

– Strumento di apprendimento: utilizzare LLM per spiegare i concetti che poi sintetizzi è apprendimento

– Compiti a casa: affidarsi completamente alle risposte LLM impedisce l’apprendimento

– Brainstorming: utilizzare LLM come partner creativo è legittimo

Best practice: controlla la politica sull’intelligenza artificiale del tuo istituto. Molte scuole ora hanno linee guida esplicite. Imparare a utilizzare l’intelligenza artificiale in modo etico è di per sé un’abilità preziosa.

Q7: I modelli più grandi hanno sempre prestazioni migliori?

R: Non sempre.

I modelli più grandi sono migliori in:

– Ragionamento complesso

– Gestire compiti diversi

– Comprendere le sfumature

– Documenti lunghi

I modelli più piccoli possono essere migliori in:

– Velocità (inferenza in millisecondi rispetto a secondi)

– Costo (1/100 del prezzo)

– Privacy (può essere eseguito localmente)

– Affidabilità su domini specifici (se ottimizzati)

Tendenza 2026: l’era del “più grande è meglio” sta finendo. I modelli più piccoli specializzati e perfezionati sono sempre più competitivi. Dovresti scegliere in base alla tua attività specifica, non alla dimensione massima.

Q8: Come dovrei pensare al copyright e alle licenze dell’IA?

R: Ciò è ancora giuridicamente incerto, ma ecco la guida pratica:

Quando si generano contenuti con LLM:

– Il contenuto che generi è in genere tuo da utilizzare

– L’attribuzione non è sempre richiesta dalla legge

– Ma ci si aspetta sempre più che venga reso noto l’utilizzo dell’IA

Quando si utilizza il codice generato da LLM:

– Sii consapevole della licenza utilizzata dal tuo modello

– I modelli open source hanno requisiti specifici

– Potrebbero essere applicati avvisi sul copyright

Best practice: includi una dichiarazione di divulgazione quando possibile. “Questo articolo è stato redatto con l’assistenza dell’intelligenza artificiale” sta diventando uno standard.

D9: Qual è la differenza tra LLM e GPT?

R: Idea sbagliata comune: GPT è una famiglia di modelli specifica (di OpenAI), non tutti i LLM.

Relazioni:

– GPT = serie di modelli specifici di OpenAI (GPT-4, GPT-5, ecc.)

– LLM = Categoria che include GPT, Claude, Gemini, Llama, ecc.

– ChatGPT = Interfaccia consumatore per modelli GPT

Ad esempio “com’è Kleenex rispetto ai fazzoletti?” — Kleenex è un marchio, i fazzoletti sono la categoria.

Q10: Come posso iniziare a utilizzare gli LLM se sono un principiante?

R:

Passaggio 1: inizia gratuitamente

– Livello gratuito ChatGPT (openai.com)

– Claude (claude.ai) — gratuito

– Gemini (gemini.google.com) – gratuito

– Provali ciascuno per una settimana

Passaggio 2: comprendi il tuo caso d’uso

– Cosa vuoi realizzare?

– È più importante la precisione o la velocità?

– Budget?

Passaggio 3: aggiorna se necessario

– ChatGPT Plus ($20/mese) per funzionalità per utenti esperti

– Claude.ai Plus ($20/mese) per lavori seri

– Accesso API per le applicazioni

Passaggio 4: apprendi il prompt engineering

– Partecipa a un corso gratuito (deeplearning.ai)

– Sperimenta diversi stili di suggerimento

– Unisciti alle community (r/ChatGPT, forum antropici)

Passaggio 5: comprendi i limiti

– Verificare i fatti in modo indipendente

– Non fidarti eccessivamente degli output

– Scopri quando NON utilizzare i LLM

Risorsa: inizia da learnai.sk/goto/skool/learnai per corsi completi sui fondamenti dell’IA.

Conclusione

I modelli linguistici di grandi dimensioni sono passati da curiosità di ricerca a infrastrutture essenziali. Miliardi di persone interagiscono quotidianamente con loro, spesso senza rendersene conto. Comprendere come funzionano e, soprattutto, i loro limiti sta diventando importante quanto capire come utilizzare i motori di ricerca.

Di cosa abbiamo parlato:

– Gli LLM prevedono token di testo utilizzando architetture di trasformazione con auto-attenzione

– Vengono formati attraverso una pre-formazione su enormi corpora di testo, quindi perfezionati e ottimizzati utilizzando il feedback umano

– I principali modelli 2026 (GPT-5, Claude Opus, Gemini 1.5, Llama 4) servono diversi casi d’uso

– Le applicazioni del mondo reale spaziano dall’assistenza sanitaria, al diritto, alle vendite, ai contenuti, all’istruzione e al servizio clienti

– Le limitazioni critiche includono allucinazioni, conoscenze obsolete e mancanza di reale comprensione

– L’efficacia dipende da come li usi attraverso istruzioni dettagliate e verifiche appropriate

– Il futuro punta verso sistemi multimodali, capacità di agenti e maggiore precisione

Il punto è: i LLM sono strumenti di trasformazione, non sostituti del giudizio umano. Sono utilizzati al meglio come strumenti di accelerazione da persone che comprendono i propri punti di forza e i propri limiti.

Che tu sia uno studente che sta imparando l’intelligenza artificiale, un professionista che valuta gli LLM per il tuo posto di lavoro o qualcuno curioso di conoscere la tecnologia che rimodella il lavoro informativo, si applicano i principi di questa guida. Inizia a sperimentare, rimani scettico riguardo ai risultati e concentrati sull’aumento delle tue capacità anziché abdicare il processo decisionale all’intelligenza artificiale.

Pronto per approfondire? Esplora corsi strutturati sull’intelligenza artificiale su learnai.sk/goto/skool/learnai per sviluppare competenze nell’apprendimento automatico, nel prompt engineering e nelle applicazioni IA.

Ulteriori risorse

- Documentazione OpenAI GPT

- Documentazione API Anthropic Claude

- Documentazione sull’intelligenza artificiale di Google

- Documentazione Meta Llama

- Documentazione Mistral AI

- Corso LLM di Hugging Face

- Corsi brevi di DeepLearning.AI

Conteggio parole: 4.847 parole