Prompte Engineering-Tools für Produktivität: Der vollständige Leitfaden für 2026

⏱ 25 Minuten Lesezeit · Kategorie: KI-Tools

Prompt Engineering hat sich vom experimentellen Können zur Kerngeschäftskompetenz entwickelt. Im Jahr 2026 betrachten 75 % der Unternehmen, die generative KI einsetzen, das Prompt-Management als kritische Produktionsinfrastruktur – genauso wichtig wie die Codeversionskontrolle oder die Datenbankverwaltung.

Der Qualitätsunterschied zwischen einer schlecht geschriebenen Eingabeaufforderung und einer ausgereiften Eingabeaufforderung bedeutet nicht, dass das Ergebnis um 10 % besser ist. Es ist eine drei- bis fünfmal bessere Leistung bei gleichen Kosten. Teams, die in schnelle Engineering-Tools und -Praktiken investieren, erzielen mit denselben KI-Abonnements einen deutlich höheren Nutzen.

Dieser Leitfaden behandelt die besten Prompt-Engineering-Tools für die Produktivität im Jahr 2026: von einzelnen Tools, die Ihnen helfen, bessere Prompts zu schreiben, bis hin zu Unternehmensplattformen, die Prompts in großem Maßstab verwalten, versionieren und auswerten.

Inhaltsverzeichnis

- Warum schnelle Engineering-Tools wichtig sind

- Kategorie 1: Prompt-Management und Versionierung

- Kategorie 2: Schnelles Testen und Bewerten

- Kategorie 3: Vorlagen und Bibliotheken für Eingabeaufforderungen

- Kategorie 4: Visual Prompt Builder

- Kategorie 5: LLM-Spielplätze und Tests

- Kategorie 6: Prompt Engineering für Entwickler

- Prompte technische Best Practices für Produktivität

- Fortgeschrittene Aufforderungstechniken, die im Jahr 2026 funktionieren

- Vergleichstabelle

- Aufbau eines Team-Prompt-Engineering-Workflows

- FAQ

Warum schnelle Engineering-Tools wichtig sind

Eine Eingabeaufforderung ist nicht nur Text, den Sie in eine KI eingeben. Es ist die primäre Schnittstelle zwischen Ihrer Absicht und der Ausgabe des Modells. Der Unterschied zwischen einer gut strukturierten Aufforderung und einer lockeren Anfrage kann Folgendes bedeuten:

- 3–5-fache Verbesserung der Ausgabequalität und Relevanz

- Reduzierung der Bearbeitungszeit um 50–80 %

- Konsistente, wiederholbare Ergebnisse für alle Teammitglieder

- Erhebliche Kostenreduzierung durch effiziente Token-Nutzung

Ohne schnelle Engineering-Tools erleben die meisten Teams Folgendes:

- “KI-Lotterie” – inkonsistente Ausgaben von denselben Anforderungstypen

- Wissenssilos – die besten Eingabeaufforderungen befinden sich im Kopf einer Person oder sind im Chatverlauf verstreut

- Keine Messung – keine Möglichkeit zu wissen, ob sofortige Änderungen tatsächlich die Ergebnisse verbessern

Prompt-Engineering-Tools lösen diese Probleme, indem sie Prompts als verwaltete Assets behandeln: versioniert, testbar, messbar und gemeinsam nutzbar.

Wichtige Erkenntnis: Prompt-Engineering-Tools sind für die KI das, was IDEs für die Programmierung sind – sie verändern nicht das, was grundsätzlich möglich ist, aber sie steigern die Effizienz und Zuverlässigkeit, die Sie erreichen, erheblich.

Kategorie 1: Prompt-Management und Versionierung

Diese Tools behandeln Eingabeaufforderungen als Code: versioniert, kollaborativ und auf bestimmte Ausgaben zurückführbar.

PromptLayer – Beste Prompt-Observability-Plattform

PromptLayer ist die führende LLMOps-Plattform für Teams, die einen vollständigen Einblick in die Leistung ihrer Eingabeaufforderungen in der Produktion wünschen. Es protokolliert jede API-Anfrage und -Antwort, verfolgt, welche Eingabeaufforderungsversion welche Ausgabe erzeugt hat, und ermöglicht A/B-Tests zwischen Eingabeaufforderungsvarianten.

Hauptfunktionen:

- Anfrageprotokollierung: Jede Eingabeaufforderung, Antwort, Modellversion und Latenz wird automatisch verfolgt

- Prompte Versionierung: Prompt-Versionen kennzeichnen, Leistung vergleichen, Rollback durchführen, wenn die Qualität nachlässt

- Team collaboration: Share prompts across teams, leave comments, and track who changed what

- Analysen: Identifizieren Sie, welche Eingabeaufforderungen die höchsten Tokenkosten, die schlechteste Latenz oder die meisten Fehler aufweisen.

from promptlayer import openai

Antwort = openai.ChatCompletion.create(

model="gpt-5",

message=[{"role": "user", "content": "Produktbeschreibung schreiben..."}],

pl_tags=["product-descriptions", "v2"]

)

- Preise: Kostenlos für Einzelpersonen; Teams 20 $/Benutzer/Monat

- Am besten geeignet für: Entwicklungsteams, die LLM-basierte Produkte liefern

Langfuse – Bestes Open-Source-Prompt-Management

Langfuse ist eine vollständig Open-Source-LLM-Beobachtbarkeits- und Prompt-Management-Plattform. Selbstgehostetes Langfuse bietet die gleichen Kernfunktionen wie PromptLayer ohne laufende Kosten: Nachverfolgung, schnelle Versionierung, Auswertung und Teamzusammenarbeit.

Mit der Langfuse-API für die Eingabeaufforderungsverwaltung können Sie Eingabeaufforderungen in der Produktion aktualisieren, ohne neuen Code bereitzustellen – entscheidend für Teams, die die Qualität der Eingabeaufforderungen ohne einen vollständigen Release-Zyklus verbessern müssen.

- Preise: Kostenlos (selbst gehostet); Cloud ab 49 $/Monat

- Am besten geeignet für: Entwicklerteams, die bei minimalen Kosten vollständige Kontrolle über die schnelle Infrastruktur wünschen

Microsoft PromptFlow (Azure) – Am besten für Unternehmen

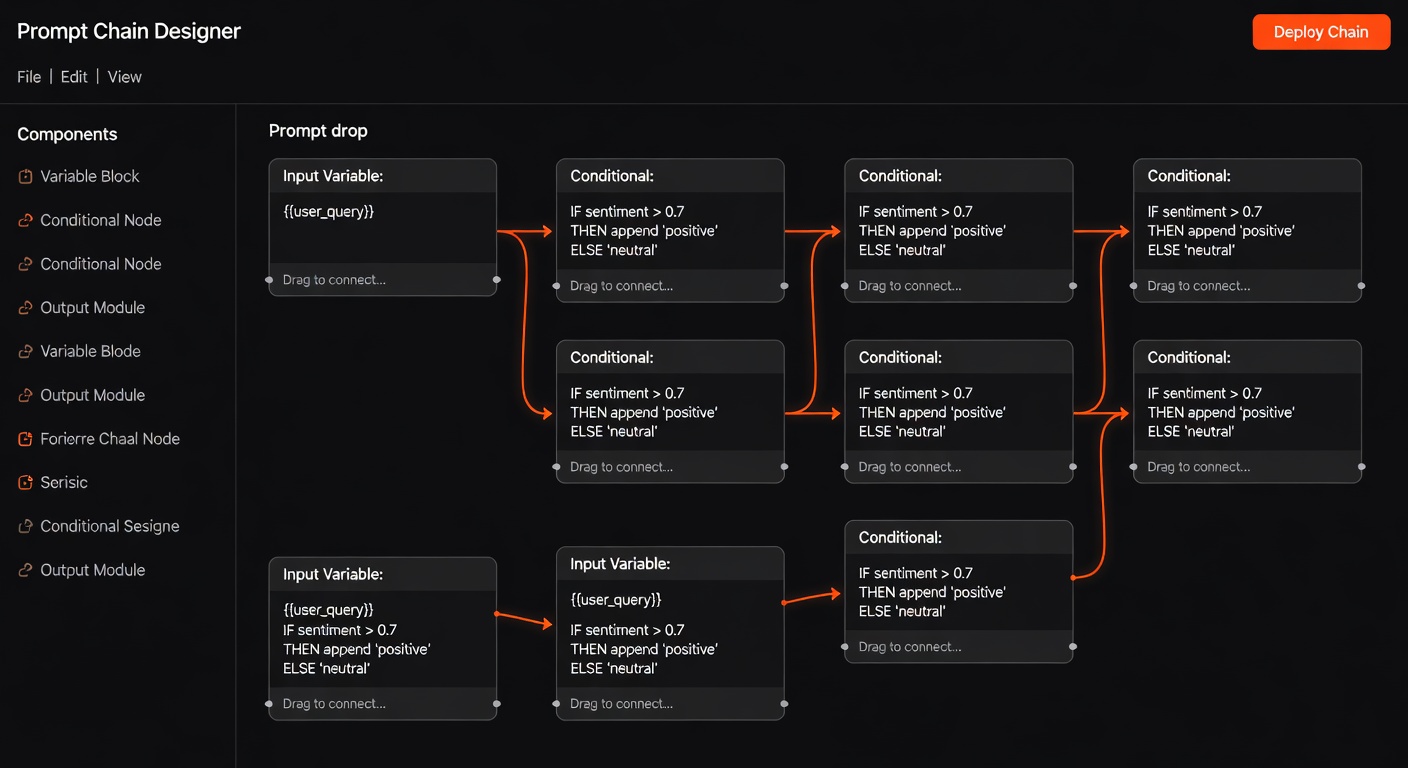

PromptFlow ist das kostenlose Open-Source-Low-Code-Tool von Microsoft für die LLM-Anwendungsentwicklung. Es bietet flussbasierte Eingabeaufforderungsverkettung, Bewertungspipelines und die Bereitstellung in Azure – was es zur natürlichen Wahl für Unternehmen macht, die bereits im Microsoft-Ökosystem vertreten sind.

Der Visual Flow Builder ermöglicht es Produktmanagern und Nicht-Ingenieuren, gemeinsam mit Entwicklern am prompten Design teilzunehmen, wodurch Engpässe bei den technischen Ressourcen reduziert werden.

- Preise: Kostenlos (Open-Source); Von Azure gehostete Optionen verfügbar

- Am besten geeignet für: Unternehmensteams auf Azure; mehrstufiges Prompt-Workflow-Management

Kategorie 2: Schnelles Testen und Bewerten

Prompte Qualität ohne Messung ist nur eine Vermutung. Diese Tools sorgen für eine zügige Verbesserung.

Braintrust – Beste Prompt-Evaluierungsplattform

Braintrust ist eine speziell entwickelte KI-Bewertungsplattform. Sie können damit Bewertungskriterien definieren (mithilfe von KI-Bewertern, menschlichen Bewertern oder benutzerdefiniertem Code), Experimente mit verschiedenen Eingabeaufforderungsversionen und -modellen durchführen und verfolgen, welche Kombination die besten Ergebnisse liefert.

Die wichtigsten Erkenntnisse, die Braintrust ermöglicht: „Hat meine sofortige Änderung tatsächlich die Ausgabe verbessert?“ wird zu einer empirisch beantwortbaren Frage mit Daten und nicht zu einer subjektiven Beurteilung.

- Preise: Kostenlos für die individuelle Nutzung; Teams-Pläne verfügbar

- Am besten geeignet für: Teams, die Wert auf schnelle Qualität legen und datengesteuerte Entscheidungen wünschen

Bewertungen (OpenAI) – Am besten für OpenAI-First-Teams

Das Evals-Framework von OpenAI ist eine Open-Source-Bibliothek zur Auswertung von LLM-Ausgaben. Schreiben Sie benutzerdefinierte Evaluatoren für Ihre spezifischen Qualitätskriterien, führen Sie sie anhand von Vervollständigungsstapeln aus und vergleichen Sie die Leistung über Eingabeaufforderungsversionen oder Modellversionen hinweg.

- Preise: Kostenlos (Open-Source)

- Am besten geeignet für: OpenAI-Benutzer, die eine strukturierte Evaluierung ohne verwaltete Plattform wünschen

LangSmith-Bewertung – Am besten für LangChain-Benutzer

Mit den Auswertungsfunktionen von LangSmith können Sie Testdatensätze erstellen, Auswertungen automatisch ausführen und die Leistung verschiedener Läufe vergleichen. Die kostenlose Stufe ist für kleine Teams und die Evaluierung in der Entwicklungsphase ausreichend.

- Preise: Kostenloses Kontingent; Entwickler 39 $/Monat; Plus 299 $/Monat

- Am besten geeignet für: Teams, die LangChain nutzen und eine integrierte Auswertung wünschen

Kategorie 3: Vorlagen und Bibliotheken für Eingabeaufforderungen

Anstatt Eingabeaufforderungen jedes Mal von Grund auf neu zu schreiben, erstellen intelligente Teams wiederverwendbare Eingabeaufforderungsbibliotheken.

PromptHub – Prompt-Sharing-Community

PromptHub ist eine Community-Plattform zum Entdecken, Teilen und Bewerten von Eingabeaufforderungen. Finden Sie hochwertige Eingabeaufforderungen für häufige Aufgaben (Inhaltserstellung, Codegenerierung, Kundenservice, Datenanalyse), passen Sie sie an Ihren Anwendungsfall an und tragen Sie Ihre eigenen bei.

- Preise: Kostenloser Community-Zugang

- Am besten geeignet für: Entdecken bewährter Eingabeaufforderungen; Erstellen Sie Ihre erste Bibliothek

Tolle ChatGPT-Eingabeaufforderungen (GitHub) – Kostenlose Eingabeaufforderungsbibliothek

Eines der am meisten ausgezeichneten Repositories auf GitHub: eine kuratierte Sammlung rollenbasierter Eingabeaufforderungen, die die Ausgaben für bestimmte Anwendungsfälle erheblich verbessern. Handeln Sie als SEO-Spezialist, Anwalt, Finanzberater, Linux-Terminal – jede Rollenaufforderung wird von Tausenden von Benutzern kampferprobt.

- Preise: Kostenlos (Open-Source)

- Best für: Aufbau einer Startbibliothek mit rollenbasierten Eingabeaufforderungen

FlowGPT – Prompt Discovery-Plattform

FlowGPT ist eine Community-Plattform speziell für KI-Eingabeaufforderungen mit Kategorien für Unternehmen, kreatives Schreiben, Codierung, Bildung und mehr. Upvote-Eingabeaufforderungen zeigen die hochwertigsten Community-Beiträge an.

- Preise: Kostenlos

- Am besten geeignet für: Aufforderungen für bestimmte Aufgaben finden; Community-Feedback zu Ihren Eingabeaufforderungen

Kategorie 4: Visual Prompt Builder

Für Nicht-Entwickler, die anspruchsvolle Eingabeaufforderungen entwerfen möchten, ohne sie von Grund auf neu zu schreiben.

Dust.tt – Bester Visual LLM App Builder

Dust bietet eine visuelle Schnittstelle zum Erstellen von LLM-Anwendungen: Verbinden Sie Datenquellen, definieren Sie Eingabeaufforderungsketten und stellen Sie Ihrem Team KI-Tools zur Verfügung – ohne Code. Mit der Komponente „Prompt Engineering“ können Sie Eingabeaufforderungen visuell entwerfen und testen, bevor Sie sie bereitstellen.

- Preise: Kostenloses Kontingent; Teams ab 29 $/Monat

- Am besten geeignet für: Produktteams, die interne KI-Tools ohne Entwicklerengpässe entwickeln

Dify – Am besten für RAG + Prompt-Workflows

Der Workflow-Builder von Dify umfasst eine ausgefeilte Eingabeaufforderungskonfiguration: Variableninjektion, bedingte Logik und A/B-Tests innerhalb einer visuellen Oberfläche. Für Teams, die RAG-basierte Anwendungen mit komplexen Eingabeaufforderungsketten erstellen, bietet Dify eine visuelle Umgebung zur Bewältigung dieser Komplexität.

- Preise: Kostenlos (selbst gehostet); Cloud-Pläne verfügbar

- Am besten geeignet für: Teams, die RAG-Anwendungen mit komplexer Prompt-Orchestrierung erstellen

Flowise – Bester visueller LangChain Builder

Flowise übersetzt die codebasierten Eingabeaufforderungsketten von LangChain in eine visuelle Drag-and-Drop-Oberfläche. Entwerfen Sie Eingabeaufforderungsketten, Speichersysteme und Tool-erweiterte Agenten visuell – und testen Sie sie dann sofort in der integrierten Chat-Oberfläche.

- Preise: Kostenlos (selbst gehostet)

- Am besten geeignet für: Visuelles Prototyping von LangChain-Prompt-Architekturen

Kategorie 5: LLM-Spielplätze und Tests

Bevor Sie Eingabeaufforderungen in der Produktion bereitstellen, müssen Sie sie unbedingt auf einem Spielplatz testen.

Anthropic Console (Claude) – Bester Modellspielplatz

Die Anthropic Console bietet eine ausgefeilte Entwicklungsumgebung für die Entwicklung mit Claude: Konfiguration der Systemeingabeaufforderungen, Temperatur- und Probenahmekontrollen sowie Vergleich verschiedener Systemeingabeaufforderungen nebeneinander. Für Teams, die Claude-basierte Anwendungen erstellen, ist die Konsole die schnellste Möglichkeit, das Prompt-Design zu iterieren.

- Zugriff: console.anthropic.com – kostenloses Konto mit API-Credits

OpenAI Playground – Am häufigsten verwendete LLM-Testumgebung

Der OpenAI Playground bleibt die am weitesten verbreitete Umgebung zum Testen von GPT-Modellen. It supports full system prompt configuration, function definitions, and side-by-side prompt comparison. Der strukturierte Ausgabemodus im Jahr 2026 erleichtert das Testen von Eingabeaufforderungen, die konsistente JSON-Ausgaben erzeugen müssen.

- Zugriff: platform.openai.com/playground – kostenlos mit API-Konto

Google AI Studio (Gemini) – Beste multimodale Tests

Google AI Studio bietet eine kostenlose Testumgebung für Gemini-Modelle mit starker Unterstützung für multimodale Eingabeaufforderungen (Text + Bilder + Dokumente). Die “Systemanweisungen” Mit dieser Funktion können Sie dauerhafte Systemaufforderungen entwerfen, die für eine Konversation gelten.

- Zugriff: aistudio.google.com – kostenlos mit Google-Konto

TypingMind – Bester Spielplatz für mehrere Modelle

TypingMind bietet eine einheitliche Schnittstelle zum Testen von Eingabeaufforderungen über mehrere Modelle hinweg (GPT-5, Claude, Gemini) mit Ihren eigenen API-Schlüsseln. Durch den direkten Vergleich der Modellausgaben für dieselbe Eingabeaufforderung können Sie leicht ermitteln, welches Modell für Ihren spezifischen Anwendungsfall die beste Leistung erbringt.

- Preise: 29 $ einmalig; 9 $/Monat für Cloud-Synchronisierung

- Am besten geeignet für: Teams, die Eingabeaufforderungen über mehrere Modelle hinweg in einer Schnittstelle testen möchten

Kategorie 6: Prompt Engineering für Entwickler

Entwicklerorientierte Tools, die das Prompt-Management in bestehende Arbeitsabläufe integrieren.

LangChain PromptTemplate – Am besten für Python-Entwickler

Die PromptTemplate-Klasse von LangChain ist die Standardmethode zum Erstellen wiederverwendbarer, parametrisierter Eingabeaufforderungen in Python. Variablen werden zur Laufzeit eingefügt, wodurch Eingabeaufforderungen flexibel und testbar werden:

aus dem Langchain-Import PromptTemplate

template = PromptTemplate(

input_variables=["Produkt", "Zielgruppe", "Ton"],

template="Schreiben Sie eine {tone}-Produktbeschreibung für {product}, die auf {audience} ausgerichtet ist."

)

prompt = template.format(product="KI-Schreibtool", Audience="Marketingmanager", Tone="Professional")

Dieser Ansatz macht Eingabeaufforderungen zu erstklassigen Bürgern in Ihrer Codebasis – testbar, mit Git versioniert und in Ihrer Anwendung wiederverwendbar.

Semantischer Kernel (Microsoft) – Am besten für .NET/Enterprise

Das Eingabeaufforderungsvorlagensystem von Semantic Kernel unterstützt parametrisierte Eingabeaufforderungen in Python, C# und Java. Das Konzept der semantischen Funktionen behandelt Eingabeaufforderungen als aufrufbare Funktionen mit Ein- und Ausgaben – wodurch sie genauso verwaltbar sind wie herkömmliche Codefunktionen.

Mirascope – Beste typisierte Python-Eingabeaufforderungsbibliothek

Mirascope ist eine typisierte Python-Bibliothek, die Eingabeaufforderungen typsicher, IDE-freundlich und testbar macht. Eingabeaufforderungen werden als Python-Klassen mit typisierten Eingaben definiert, was statische Analysen, automatische Vervollständigung und Tests unkompliziert macht.

aus mirascope.core import openai, prompt_template

@openai.call("gpt-5")

@prompt_template("Empfehlen Sie ein {genre}-Buch für {audience}")

def Recommend_book(Genre: str, Zielgruppe: str): ...

result = Recommend_book("Sci-Fi", "Young Adults")

- Preise: Kostenlos (Open-Source)

- Am besten geeignet für: Python-Entwickler, die eine typisierte, testbare Eingabeaufforderungsverwaltung wünschen

Prompte technische Best Practices für Produktivität

Werkzeuge sind nur so gut wie die Techniken, die ihnen zugrunde liegen. Hier sind die Praktiken, die die größten Produktivitätssteigerungen erzielen:

1. Rollenbasierte Eingabeaufforderung

Wenn Sie der KI eine Rolle zuweisen, bevor Sie eine Aufgabe erteilen, verbessert sich die Ausgabequalität und -konsistenz erheblich:

Anstelle von: “Schreiben Sie einen Blogbeitrag über KI-Tools”

Verwendung:„Sie sind ein leitender Technologieautor für eine B2B-SaaS-Publikation mit 10 Jahren Erfahrung. Ihr Schreibstil ist klar, direkt und evidenzbasiert. Schreiben Sie einen Blogbeitrag mit 1.000 Wörtern über …”

Der Rollenkontext aktiviert relevante Wissensmuster im Modell und schränkt den Ausgabestil effektiver ein als explizite Anweisungen allein.

2. Aufforderung zur Gedankenkette

Bei komplexen Aufgaben wird die Genauigkeit erheblich verbessert, wenn das Modell Schritt für Schritt aufgefordert wird, Überlegungen anzustellen, bevor es zu einer Antwort kommt:

Fügen Sie zu jeder komplexen Aufforderung hinzu: „Überdenken Sie dies Schritt für Schritt, bevor Sie Ihre endgültige Antwort geben.“

Oder verwenden Sie explizite Argumentationsketten: „Analysieren Sie zunächst das Problem.“ Betrachten Sie dann zwei bis drei Ansätze. Empfehlen Sie dann mit Begründung den besten Ansatz.”

3. Geben Sie Beispiele an (Few-Shot-Prompt)

Fügen Sie zwei bis drei Beispiele für die gewünschten Eingabe-Ausgabe-Paare bei:

“Hier sind Beispiele für das Format, das ich möchte:

Eingabe: [Beispiel 1 Eingabe]

Ausgabe: [Ausgabe von Beispiel 1]

Eingabe: [Beispiel 2 Eingabe]

Ausgabe: [Beispiel 2-Ausgabe]

Machen Sie nun dasselbe für: [Ihre tatsächliche Eingabe]”

Few-Shot-Prompting ist eine der Techniken mit dem höchsten ROI – sie kommuniziert Absichten präziser als jede Menge beschreibender Anweisungen.

4. Strukturierte Ausgabespezifikation

Für KI-Ausgaben, die programmgesteuert verarbeitet werden, geben Sie das genaue Format an:

“Geben Sie Ihre Antwort als JSON-Objekt mit genau diesen Feldern zurück:

{

„title“: „string“,

„Zusammenfassung“: „Zeichenfolge (max. 100 Wörter)“,

„tags“: [„array“, „of“, „strings“],

„Vertrauen“: „hoch|mittel|niedrig“

}

Durch die Verwendung des strukturierten Ausgabemodus von OpenAI oder des JSON-Modus von Anthropic wird dieses Format auf API-Ebene erzwungen.

5. Negative Anweisungen (Was NICHT zu tun ist)

Die explizite Angabe, was vermieden werden sollte, ist oft genauso wichtig wie die Angabe, was zu tun ist:

“Fügen Sie KEINE generischen Einleitungen wie „In der heutigen Welt“ hinzu. Verwenden Sie KEINE Aufzählungspunkte. Fügen Sie KEINE Schlussfolgerung hinzu, es sei denn, sie fügt neue Informationen hinzu.”

Negative Anweisungen sind besonders wirksam bei Stil- und Formatbeschränkungen.

6. Temperatur- und Parameterabstimmung

Niedrigere Temperatur (0,0–0,3) für sachliche, konsistente Ergebnisse (Datenextraktion, Klassifizierung, Codegenerierung). Höhere Temperatur (0,7–1,0) für kreative, abwechslungsreiche Ergebnisse (Brainstorming, kreatives Schreiben, Ideengenerierung).

Die meisten Produktivitätsanwendungsfälle profitieren von niedrigeren Temperaturen – Konsistenz ist für Geschäftsanwendungen wichtiger als Vielfalt.

Fortgeschrittene Aufforderungstechniken, die im Jahr 2026 funktionieren

Verfassungsrechtliche Aufforderung

Definieren Sie Regeln, die die KI während ihrer gesamten Reaktion befolgen muss – eine „Verfassung“. in die Systemaufforderung eingebettet. Nützlich für Markenstimme, Compliance-Anforderungen und ethische Einschränkungen.

Beispiel für eine Systemeingabeaufforderung: „Sie müssen immer diese Regeln befolgen: [1] Machen Sie niemals spezifische Finanzprognosen.“ [2] Geben Sie für Tatsachenbehauptungen immer Quellen an. [3] Behalten Sie einen professionellen, aber warmen Ton bei.”

Abruf-erweiterte Eingabeaufforderung

Fügen Sie relevanten Kontext aus Ihrer Wissensdatenbank dynamisch zur Laufzeit in Eingabeaufforderungen ein. Die Eingabeaufforderung lautet: Systemanweisungen + abgerufener Kontext + Benutzerabfrage. Dieses Muster verbessert die sachliche Genauigkeit für domänenspezifische Fragen ohne Feinabstimmung erheblich.

Rekursive Verfeinerung

Verwenden Sie KI, um die KI-Ausgabe zu verbessern: Erstellen Sie zunächst einen Entwurf und fordern Sie dann das Modell auf, ihn zu kritisieren und zu verbessern. „Sehen Sie sich den folgenden Text an und identifizieren Sie drei Möglichkeiten, ihn zu verbessern: [Text]. Schreiben Sie es dann unter Einbeziehung dieser Verbesserungen neu.”

Dieses Muster erzeugt durchweg eine Ausgabe mit höherer Qualität als die Generierung in einem Durchgang.

Parallel Generation + Selection

Generieren Sie mehrere Ausgaben gleichzeitig (über parallele API-Aufrufe) und verwenden Sie eine zweite Eingabeaufforderung, um die beste auszuwählen. Besonders nützlich für kreative Aufgaben, bei denen die Abweichung zwischen den Ergebnissen groß ist und einer davon wahrscheinlich ausgezeichnet ist.

Vergleichstabelle

| Werkzeug | Kategorie | Am besten für | Preise |

|---|---|---|---|

| PromptLayer | Management | Prompte Protokollierung und Versionierung | Kostenlos / 20 $/Benutzer/Monat |

| Langfuse | Management | Open-Source-Eingabeaufforderungsoperationen | Kostenlos (selbst gehostet) |

| PromptFlow | Management | Azure Enterprise Prompt Management | Kostenlos (Open-Source) |

| Braintrust | Bewertung | Datengesteuerte sofortige Verbesserung | Freie Einzelperson |

| LangSmith | Bewertung | LangChain-Eingabeauswertung | Kostenloses Kontingent |

| Anthropic Console | Spielplatz | Claude-Eingabeaufforderungstest | Kostenlos mit API |

| OpenAI-Spielplatz | Spielplatz | GPT-Eingabeaufforderungstest | Kostenlos mit API |

| PromptHub | Bibliothek | Bewährte Eingabeaufforderungen entdecken | Kostenlos |

| Verändern | Visual Builder | Visuelles Design des RAG + Prompt-Workflows | Kostenlos (selbst gehostet) |

| Mirascope | Entwickler | Typisierte Python-Eingabeaufforderungsverwaltung | Kostenlos |

Aufbau eines Team-Prompt-Engineering-Workflows

Schritt 1: Richten Sie eine Prompt-Bibliothek ein

Erstellen Sie ein gemeinsames Repository Ihrer leistungsstärksten Eingabeaufforderungen. Beginnen Sie mit 10–15 Eingabeaufforderungen, die Ihre häufigsten KI-Aufgaben abdecken. Verwenden Sie Langfuse oder PromptLayer, um sie zu hosten, oder ein einfaches Notion-Datenbank für nicht-technische Teams.

Schritt 2: Standardisieren Sie Ihr Eingabeaufforderungsformat

Definieren Sie eine einheitliche Struktur für alle Teamaufforderungen:

[ROLLE]: Sie sind eine [Beschreibung]

[CONTEXT]: [Relevanter Hintergrund]

[AUFGABE]: [Spezifische Anweisung]

[FORMAT]: [Ausgabestruktur]

[EINSCHRÄNKUNGEN]: [Was Sie vermeiden sollten]

[BEISPIELE]: [1-2 Eingabe-Ausgabe-Beispiele]

Dieses Format macht Eingabeaufforderungen scanbar, debuggbar und verbesserungsfähig.

Schritt 3: Versionskontrolle und Tests

Jede Eingabeaufforderungsänderung sollte versioniert und anhand eines Benchmark-Eingabesatzes getestet werden, bevor die vorherige Version ersetzt wird. Dies verhindert „schnelle Regressionen“; wo eine gut gemeinte Änderung tatsächlich die Ausgabequalität verringert.

Schritt 4: Teilen und verbessern

Eingabeaufforderungen sollten gemeinsame Vermögenswerte und kein individuelles Wissen sein. Planen Sie monatliche, zeitnahe Überprüfungssitzungen ein, in denen die Teammitglieder mitteilen, was funktioniert, was fehlschlägt, und Verbesserungen vorschlagen. Die besten Eingabeaufforderungen werden durch gemeinsame Iteration verbessert.

Schritt 5: Qualität konsequent messen

Definieren Sie Qualitätsmetriken für jeden Aufforderungstyp (Genauigkeit, Formatkonformität, Ton, Länge) und bewerten Sie neue Aufforderungsversionen anhand dieser Metriken. Sogar ein einfaches menschliches Bewertungssystem (1–5 Sterne bei einer Stichprobe von Ergebnissen) ist besser als keine Messung.

FAQ

Was ist der Unterschied zwischen Prompt Engineering und Prompt Management?

Prompt Engineering ist die Praxis, effektive Eingabeaufforderungen zu erstellen – das Schreiben, Testen und Verbessern des Textes, der mit KI-Modellen die besten Ergebnisse erzielt. Prompt Management ist die betriebliche Infrastruktur, um dies im großen Maßstab zu tun: Versionierung, A/B-Tests, Überwachung und Zusammenarbeit. Beides ist wichtig; Die meisten Diskussionen vermischen sie.

Werden schnelle technische Fähigkeiten obsolet, wenn sich die KI-Modelle verbessern?

Prompt engineering evolves but doesn’t become obsolete. Leistungsfähigere Modelle reagieren auf bessere Aufforderungen – die Obergrenze steigt, aber die Fähigkeiten bleiben wertvoll. Was veraltet ist, sind spezifische Techniken, die auf Modellbeschränkungen basieren (z. B. wurde die Gedankenkette weniger notwendig, da o1/o3 natives Denken hinzufügte). Es entstehen neue Techniken. Die Metakompetenz, präzise mit KI-Systemen kommunizieren zu können, bleibt dauerhaft wertvoll.

Wie lange dauert es, Prompt Engineering zu erlernen?

Grundkenntnisse erfordern ein bis zwei Wochen bewusstes Üben. Es dauert 1–3 Monate, um bei einer Reihe von Aufforderungstypen zuverlässig wirksam zu werden. Die Beherrschung fortgeschrittener Techniken (Bewertung, systematische Verbesserung, komplexe Ketten) dauert 6–12 Monate. Die learnAI-Plattform verfügt über strukturierte Lernpfade für jedes Niveau.

Was ist die zeitnahe technische Investition mit dem höchsten ROI für einen Nicht-Entwickler?

Erstellen Sie eine persönliche Eingabeaufforderungsbibliothek für Ihre 5–10 häufigsten KI-Aufgaben. Verbringen Sie 2 Stunden damit, Eingabeaufforderungen für das Verfassen von E-Mails, Recherchen, Berichtserstellung und Besprechungsvorbereitung zu erstellen und zu verfeinern. Durch gut gestaltete Eingabeaufforderungen für diese Aufgaben sparen Sie täglich 30–60 Minuten ein – was sich auf Hunderte von Stunden pro Jahr summiert.

Kann ich dieselben Eingabeaufforderungen mit verschiedenen KI-Modellen verwenden?

Meistens ja, aber jedes Modell hat unterschiedliche Stärken und optimale Aufforderungsstile. Claude reagiert gut auf detaillierte Anweisungen und den rollenbasierten Kontext. GPT-5 profitiert von spezifischen Formatanforderungen. Zwillinge kommen besonders gut mit multimodalen Kontexten zurecht. Das Testen Ihrer wichtigsten Eingabeaufforderungen über mehrere Modelle hinweg zeigt, welches Modell für welche Aufgabe am besten geeignet ist.

Welche Tools verwenden professionelle Prompt-Ingenieure?

Die meisten Fachleute verwenden eine Kombination aus: LLM Playgrounds (Anthropic Console, OpenAI Playground) für die Erstentwicklung, PromptLayer oder Langfuse für das Produktionsmanagement, Braintrust oder LangSmith für die Evaluierung und eine Kombination aus Notion/GitHub für Team-Prompt-Bibliotheken. Python + LangChain oder Mirascope für Code-integriertes Eingabeaufforderungsmanagement.

Schlussfolgerung

Prompt-Engineering-Tools haben sich von experimentellen Kuriositäten zu einer produktionstauglichen Infrastruktur entwickelt. Teams, die Eingabeaufforderungen als verwaltete, versionierte Assets behandeln, erhalten deutlich konsistentere und qualitativ hochwertigere KI-Ausgaben als diejenigen, die jede Eingabeaufforderung als einmalige Textfeldinteraktion behandeln.

Die Tools in diesem Leitfaden decken das gesamte Spektrum ab: von kostenlosen Spielplätzen für individuelle Experimente bis hin zu Managementplattformen der Enterprise-Klasse für Teams, die KI-Produkte bereitstellen. Beginnen Sie mit den Spielplätzen, um Ihre Aufforderungsintuition zu entwickeln, fügen Sie eine Aufforderungsbibliothek hinzu, wenn sich Ihre besten Aufforderungen ansammeln, und wechseln Sie zu Managementplattformen, wenn Ihr Team Konsistenz und Beobachtbarkeit benötigt.

Einen vollständigen Lehrplan zum Thema Prompt Engineering vom Anfänger bis zum Fortgeschrittenen finden Sie in der learnAI-Community – wo Prompt Engineering eines der aktivsten Themen ist.

Den technischen Kontext zur Integration von Prompt Management in Ihren KI-Entwicklungsworkflow finden Sie im Leitfaden AI Strategy Tools for Developers.

Bereit, KI zu lernen? Treten Sie der learnAI-Community bei → learnAI Skool-Community

Promptes Engineering für spezifische Geschäftsanwendungsfälle

Verschiedene Geschäftsfunktionen haben unterschiedliche Anforderungen an die Eingabeaufforderung. Hier finden Sie optimierte Ansätze für die häufigsten Aufgaben zur Geschäftsansprache:

E-Mail- und Kommunikationsaufforderung

E-Mail ist für die meisten Wissensarbeiter der Prompt-Anwendungsfall mit dem höchsten Volumen. Ein optimierter E-Mail-Aufforderungs-Workflow:

Systemaufforderung: “Sie sind ein erfahrener Geschäftskommunikator. Schreiben Sie E-Mails, die direkt, professionell und handlungsorientiert sind. Verwenden Sie niemals unnötige Füllphrasen. Jede E-Mail sollte einen klaren Betreff, eine klare Absichtserklärung, einen relevanten Kontext, eine spezifische Anfrage oder Aktion und einen klaren nächsten Schritt enthalten.”

Vorlage für Aufgabenaufforderungen: “Schreiben Sie eine E-Mail an [Empfänger/Rolle] über [Thema]. Mein Hauptpunkt ist [Kernbotschaft]. Die Aktion, die ich von ihnen brauche, ist [konkrete Frage]. Der Ton sollte [formell/freundlich/dringend] sein. Geben Sie [alle spezifischen Details] an.”

Mit dieser zweiteiligen Struktur erfordern E-Mail-Entwürfe 2–3 Minuten Bearbeitung statt 15–20 Minuten Schreiben.

Inhaltsrecherche und Aufforderung zur Zusammenfassung

Für Wissensarbeiter, die Informationen aus mehreren Quellen zusammenfassen müssen:

Aufforderung zur Forschungszusammenfassung: „Ich werde Ihnen [Anzahl] Quellen zu [Thema] nennen.“ Fassen Sie die wichtigsten Punkte in einer strukturierten Zusammenfassung zusammen. Format: 1) Wichtigste Konsensergebnisse, 2) Wichtigste Meinungsverschiedenheiten oder Spannungen, 3) Lücken im aktuellen Wissen, 4) Umsetzbarste Erkenntnisse für [Ihre Rolle/Ihren Kontext]. Hier sind die Quellen: [Quellen einfügen]”

Diese Eingabeaufforderung erzeugt durchweg eine Synthese, deren manuelles Schreiben Stunden dauern würde.

Datenanalyse und Berichtserstellung

Für Geschäftsanwender, die Daten ohne tiefe SQL- oder Python-Kenntnisse analysieren:

Eingabeaufforderung zur Datenanalyse: „Ich habe einen Datensatz mit diesen Spalten: [Spaltennamen und Beschreibungen]. I want to understand [business question]. Suchen Sie nach: [bestimmten Mustern, Trends oder Anomalien]. Formatieren Sie Ihre Analyse wie folgt: 1) Hauptbefund in einem Satz, 2) Unterstützende Datenpunkte, 3) Mögliche Erklärungen, 4) Empfohlene Maßnahmen.”

Hinweis: Überprüfen Sie immer die von der KI generierte Datenanalyse anhand der tatsächlichen Daten, bevor Sie darauf reagieren.

Vorlagen für die Kundenkommunikation

Für kundenorientierte Teams, die personalisierte Kommunikation in großem Maßstab generieren:

Eingabeaufforderung für Kunden-E-Mail-Vorlage: “Schreiben Sie eine [Typ: Willkommens-/Folge-/Wiedereingliederungs-E-Mail] für einen Kunden, der [Kundenkontext] ist. Sie haben [Produkt/Dienstleistung]. Ihr Hauptziel ist [Ziel]. Anzusprechendes Anliegen: [Anliegen, falls vorhanden]. Ton: [warm/professionell]. Länge: [kurz/mittel]. Einschließen: [spezifische Elemente wie Angebot, Link oder CTA].”

Aufbau einer Bibliothek mit Kundenkommunikationsaufforderungen und deren Ausführung mit kundenspezifischen Variablen über Zapier oder n8n schafft personalisierte Reichweite in großem Maßstab.

Prompt-Engineering-Tools für bestimmte Rollen

Für Vermarkter

Beste Tools: Claude.ai + PromptHub (zum Entdecken von Marketing-Prompts) + Jasper (für markenkonsistente Ausführung)

Wichtige Anregungen für die Entwicklung:

- Aufforderung zur kurzen Erweiterung der Kampagne

- Generator für Anzeigentextvariationen

- Ersteller sozialer Beiträge (für jede Plattform)

- SEO-Briefgenerator aus Schlüsselwort

- E-Mail-Betreffzeilentester

Für Entwickler

Beste Tools: Cursor + GitHub Copilot + Anthropic Console + Mirascope

Wichtige Anregungen für die Entwicklung:

- Eingabeaufforderung für die Codeüberprüfungs-Checkliste

- Generator für technische Dokumentation

- Fehlererklärung und Aufforderung zur Behebung

- Unit-Test-Generator

- Aufforderung zur Architekturüberprüfung

Für Vertriebsteams

Beste Tools: Clay + Apollo + ChatGPT Team + PromptLayer für Sequenzansagen

Wichtige Anregungen für die Entwicklung:

- Prospect Research Synthesizer

- Personalisierter Eröffnungszeilengenerator

- Framework zur Reaktion auf Einwände

- Aufforderung zur Vorbereitung eines Discovery-Anrufs

- Angebotsabschnittsgenerator

Für HR und Operations

Beste Tools: Claude + Notion AI + Zapier AI

Wichtige Anregungen für die Entwicklung:

- Verfasser von Stellenbeschreibungen

- Interviewfragengenerator pro Rolle

- Vorlage für Leistungsbeurteilung

- Verfasser von Richtliniendokumenten

- Meeting-Agenda-Generator aus Zielen

Prompt-Metriken: So messen Sie die Prompt-Qualität

Die meisten Teams messen ihre Aufforderungen nie. Die Teams, denen dies gelingt, übertreffen stets diejenigen, denen dies nicht gelingt. Hier ist ein praktischer Messrahmen:

Qualitätsfaktor (1–5 pro Dimension):

- Genauigkeit: Enthält die Ausgabe korrekte Informationen?

- Relevanz: Geht es auf die eigentliche Anfrage ein?

- Formatkonformität: Folgt es der angegebenen Struktur?

- Klangkonsistenz: Entspricht sie der beabsichtigten Stimme?

- Vollständigkeit: Deckt es alle erforderlichen Elemente ab?

Effizienzmetriken:

- Durchschnittliche Bearbeitungszeit pro Ausgabe (vor vs. nach sofortiger Verbesserung)

- Token-Anzahl vs. Ausgabequalitätsverhältnis (erhalten Sie einen Wert pro Token?)

- Erstversuchs-Akzeptanzrate (% der Ausgaben, die ohne nennenswerte Bearbeitung verwendet wurden)

Verfolgen Sie diese für Ihre 5 am häufigsten verwendeten Eingabeaufforderungen. Verbessern Sie zuerst die Dimensionen mit der niedrigsten Bewertung. Schon 5 Minuten Messung pro Woche sorgen für eine kontinuierliche Verbesserung.

Für Teams, die PromptLayer oder Langfuse verwenden, können diese Metriken automatisch mit benutzerdefinierten Scorern verfolgt werden – wodurch der manuelle Messaufwand vollständig entfällt.

Aufbau einer unternehmensweiten Kultur der schnellen Entwicklung

Individuelle Schnelligkeitskompetenzen vervielfachen sich, wenn sie zu organisatorischen Fähigkeiten werden. So können Sie Prompt Engineering über einzelne Praktiker hinaus skalieren:

Das Prompt-Champion-Modell

Ernennen Sie pro Abteilung einen Prompt-Champion: jemanden, der sich intensiv mit Prompting auskennt und Kollegen schult. Geben Sie ihnen 2 Stunden pro Woche Zeit, um die Pünktlichkeitsbibliothek des Teams zu verbessern. Die meisten Abteilungen verzeichnen mit diesem Modell eine Produktivitätssteigerung von 20–30 % innerhalb von 60 Tagen.

Schnelle Governance für sensible Funktionen

Für Funktionen, bei denen KI-Ausgaben ein Compliance-Risiko darstellen könnten (Recht, Finanzen, Personalkommunikation), richten Sie Überprüfungsprozesse ein:

- Alle Eingabeaufforderungen für sensible Funktionen werden vom Abteilungsleiter überprüft

- KI-Ausgaben für Kommunikation mit hohem Risiko, die vor dem Senden von einem Menschen überprüft werden

- Regelmäßige Prüfungen der pünktlichen Leistung auf Genauigkeit und Compliance

Schnelles Onboarding für neue Mitarbeiter

Beziehen Sie Prompt Engineering in die Einarbeitung Ihrer Mitarbeiter ein. Neue Mitarbeiter, die sich vom ersten Tag an mit der Eingabeaufforderungsbibliothek Ihres Unternehmens vertraut machen, sind mit KI-Tools sofort produktiv – anstatt Wochen damit zu verbringen, bereits vorhandene Eingabeaufforderungen zu entwickeln.

Erstellen Sie ein “Prompt Engineering 101” Leitfaden speziell für Ihr Unternehmen: die 20 wichtigsten Eingabeaufforderungen, die Ihr Team verwendet, die von Ihnen befolgten Formatierungsstandards und die Modelle, die für jeden Aufgabentyp am besten geeignet sind.

Messung der KI-Produktivität von Abteilungen

Mit den vorhandenen Prompt-Management-Tools können Sie die KI-Produktivität auf Teamebene messen:

- Gesamtzahl der KI-gestützten Ausgaben pro Woche (verfolgt über PromptLayer oder Langfuse)

- Durchschnittliche Reduzierung der Bearbeitungszeit im Vergleich zum Ausgangswert vor der KI

- Eingabeaufforderungen mit der besten Leistung nach Akzeptanzrate

Anhand dieser Daten können Sie die KI-Anwendungsfälle mit dem höchsten Wert im gesamten Unternehmen identifizieren und entsprechende Investitionen tätigen.

Die Unternehmen, die auf das Jahr 2026 als das Jahr zurückblicken, in dem sie sich einen dauerhaften Wettbewerbsvorteil verschafft haben, sind diejenigen, die jetzt in diese systematischen Prompt-Engineering-Fähigkeiten investieren – nicht nur in die Tools, sondern auch in die sie umgebende Kultur und Arbeitsabläufe.

Die Ökonomie zeitnaher technischer Investitionen

Promptes Engineering ist eine der Investitionen mit dem höchsten ROI, die Wissensarbeitern und Unternehmen zur Verfügung stehen. Die Mathematik ist überzeugend:

Individueller ROI: Ein Wissensarbeiter, der zwei Stunden damit verbringt, seine Kernaufforderungen zu verbessern, spart täglich 30–60 Minuten. Bei durchschnittlichen Volllastkosten von 50 US-Dollar pro Stunde bedeutet das eine Ersparnis von 25 bis 50 US-Dollar pro Tag – oder 6.250 bis 12.500 US-Dollar pro Jahr bei einer 2-Stunden-Investition.

Team-ROI: Ein 10-köpfiges Team, das gemeinsam 10 Stunden in eine gemeinsame Prompt-Bibliothek investiert und von einem Champion geschult wird, spart jedem Mitglied täglich 20 Minuten. Bei einem Gesamtpreis von 75 $/Stunde bei 10 Personen: 125 $ Einsparung pro Tag – 31.250 $ pro Jahr bei einer einmaligen 10-Stunden-Investition.

Produkt-ROI: Für ein Team, das ein LLM-basiertes Produkt ausliefert, wirkt sich die schnelle Qualität direkt auf die Benutzerbindung aus. Eine dreifache Verbesserung der Ausgabequalität (erreichbar durch systematisches Prompt-Engineering) kann die Kundenbindung verdoppeln – eine deutliche Verbesserung gegenüber ein paar hundert Stunden Prompt-Engineering-Arbeit.

Die Herausforderung liegt nicht im ROI – sondern darin, dass die Investition im Vergleich zu Einstellungen oder Infrastruktur immateriell erscheint. Aber die Gesamtrendite einer gut verwalteten Prompt-Bibliothek übersteigt fast alle anderen im Jahr 2026 verfügbaren Investitionen in Wissensarbeit.

Sofortige Aktion: Wählen Sie Ihre 5 am häufigsten verwendeten KI-Eingabeaufforderungen aus. Verbringen Sie eine Stunde damit, jeden einzelnen Schritt mithilfe der Techniken in diesem Leitfaden zu verbessern. Messen Sie die Zeitersparnis in der nächsten Woche. Die Daten werden die Argumente für systematisches Prompt Engineering besser belegen als jedes andere Argument.