Python für die KI-Entwicklung: Vollständiger Einsteigerleitfaden 2026

⏱ 25 Minuten Lesezeit · Kategorie: KI-Entwicklung

Einführung

Python ist die Sprache der KI. Von Forschungslaboren bei OpenAI bis hin zu Produktionssystemen bei Google – Python treibt die KI-Revolution voran. Wenn Sie KI-Anwendungen erstellen möchten, ist Python nicht verhandelbar.

Aber das Erlernen von Python für KI ist nicht dasselbe wie das Erlernen von Python für die Webentwicklung. Sie benötigen spezifische Bibliotheken, Frameworks und mentale Modelle. Die meisten Anfänger beginnen mit theoretischen Kursen und verlieren sich in der Mathematik, bevor sie eine einzige Codezeile schreiben, die echte Ergebnisse liefert.

Dieser Leitfaden verfolgt einen anderen Ansatz. Sie lernen Python für KI so, wie Profis tatsächlich Systeme erstellen: praktisch, projektorientiert und mit gerade genug Theorie, um zu verstehen, was unter der Haube passiert.

Am Ende werden Sie das KI-Ökosystem von Python verstehen, funktionierenden Code schreiben, der maschinelles Lernen und KI-APIs nutzt, und über einen realistischen Fahrplan zur KI-Kompetenz verfügen.

Wichtige Statistik: Entwickler, die durch Aufbauen lernen, brauchen 6–12 Monate, um professionelle Kompetenz zu erreichen. Wer sich zunächst auf Kurse konzentriert, nimmt sich 18-24 Monate Zeit. Der Unterschied? Sofortige Bewerbung.

Inhaltsverzeichnis

- Warum Python für KI: Der Ökosystemvorteil

- Einrichten Ihrer Python-KI-Entwicklungsumgebung

- Kernpython-Konzepte für KI

- Unverzichtbare Python-Bibliotheken für KI

- Deep-Learning-Frameworks: PyTorch vs. TensorFlow

- Arbeiten mit vortrainierten Modellen

- Erstellen Sie Ihre erste KI-Anwendung

- LangChain: Intelligente Agenten erstellen

- Datenvorbereitung und Vorverarbeitung

- Vom Prototyp zur Produktion

- Häufige Fallstricke und wie man sie vermeidet

- FAQ

Warum Python für KI: Der Ökosystemvorteil

Python ist nicht die schnellste Sprache. Es ist nicht das eleganteste. Aber es dominiert die KI aus einem Grund: dem Ökosystem.

Das Ökosystem

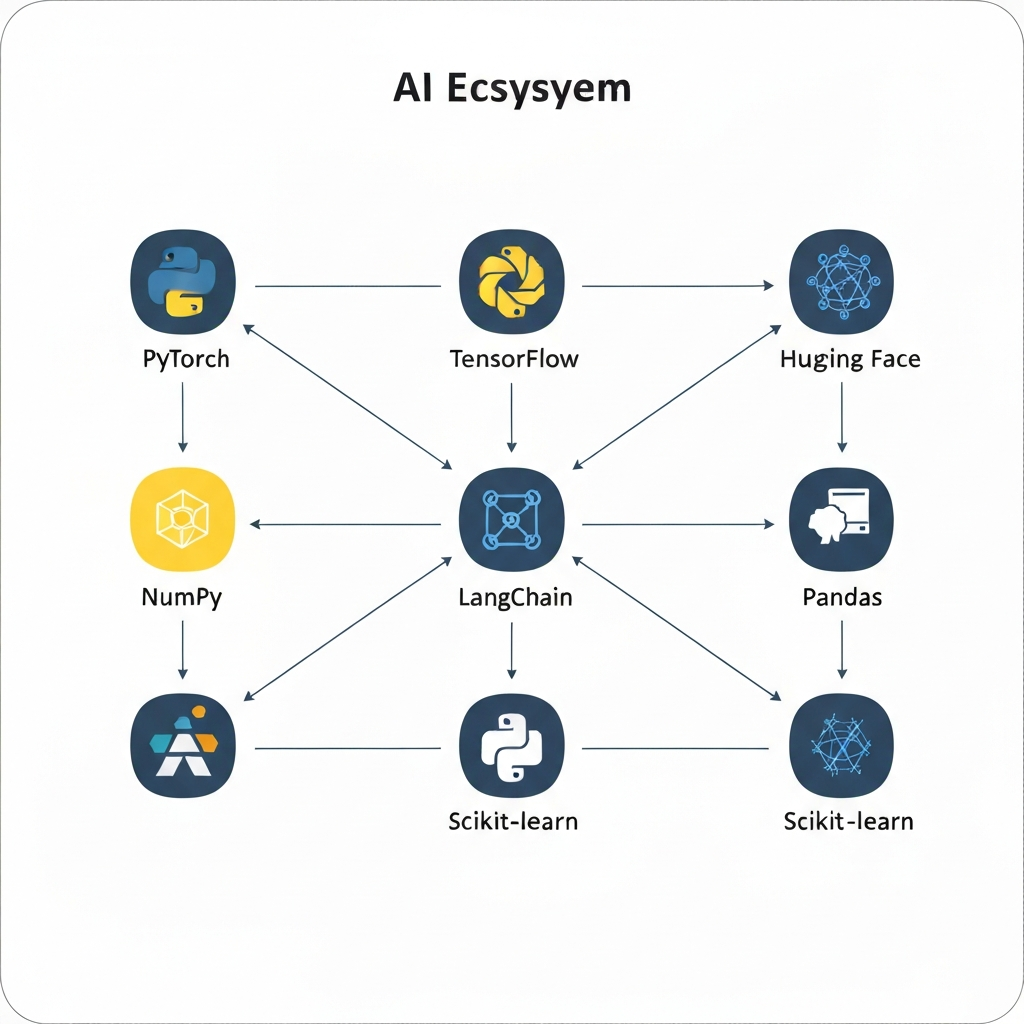

Alle wichtigen KI-Frameworks priorisieren Python:

- PyTorch: Deep-Learning-Forschung und -Produktion

- TensorFlow: Skalierbares maschinelles Lernen auf Unternehmensebene

- Hugging Face: Über 1 Million vortrainierte Modelle für Text, Bild und Audio

- LangChain: Aufbau intelligenter Agenten mit LLMs

- OpenAI Python SDK: Offizielle APIs für GPT-4, Einbettungen und mehr

Wenn ein neuer Durchbruch in der KI stattfindet – eine neue Modellarchitektur, eine neue Trainingstechnik – erfolgt die erste Implementierung immer in Python.

Die Gemeinschaft

Die KI-Community ist Python-first. Stack Overflow-Antworten, GitHub-Projekte, Forschungsarbeiten mit Code – sie alle sind Python. Wenn Sie nicht weiterkommen, gibt es jede Menge Hilfe.

Die Geschwindigkeits-zu-Prototyp-Kurve

Python opfert die Ausführungsgeschwindigkeit zugunsten der Entwicklungsgeschwindigkeit. Eine Aufgabe, die in Java Wochen dauert, dauert in Python Tage. Für die KI lohnt sich dieser Kompromiss. Sie verbringen 90 % Ihrer Zeit mit Algorithmen und Architektur, 10 % mit der Leistungsoptimierung.

Einrichten Ihrer Python-KI-Entwicklungsumgebung

Sie benötigen keine teure Hardware, um zu starten. Ein MacBook oder ein Windows-Laptop ist in Ordnung. Wenn Sie über eine GPU verfügen (bevorzugt NVIDIA), sogar noch besser – aber zum Lernen nicht erforderlich.

Schritt 1: Python installieren

Laden Sie Python 3.12 oder 3.13, 3.14 von python.org herunter. Vermeiden Sie 3.15+ (zu neu, einige Pakete sind verzögert).

# Installation überprüfen

Python --version

# Sollte ausgeben: Python 3.12.x oder 3.14.xSchritt 2: Erstellen Sie eine virtuelle Umgebung

Installieren Sie Pakete niemals global. Verwenden Sie immer virtuelle Umgebungen.

# Umgebung erstellen

python -m venv myai_env

# Aktivieren (Mac/Linux)

Quelle myai_env/bin/activate

# Aktivieren (Windows)

myai_env\Scripts\activate

# Ihr Terminal sollte jetzt (myai_env)anzeigen

Schritt 3: Wesentliche Pakete installieren

pip install numpy pandas matplotlib scikit-learn jupyterSchritt 4: AI Frameworks installieren

Zum Lernen beginnen Sie mit PyTorch (einfacher für Anfänger):

# CPU-Version (empfohlen für Anfänger)

Pip-Install Torch Torchvision Torchaudio

# GPU-Version (wenn Sie über eine NVIDIA-GPU verfügen)

pip install Torch Torchvision Torchaudio --index-url https://download.pytorch.org/whl/cu118Schritt 5: Richten Sie Ihre IDE ein

Verwenden Sie entweder:

- VS Code + Python-Erweiterung (kostenlos, empfohlen)

- PyCharm Community (kostenlose, KI-spezifische Funktionen)

- Cursor (KI-unterstützte Codierung, 20 $/Monat)

Schritt 6: Einrichtung überprüfen

python -c "import Torch; print(torch.__version__)"Sie sollten eine Versionsnummer aufgedruckt sehen.

Das Wichtigste: Die Einrichtung der Umgebung dauert 30 Minuten. Investieren Sie diese Zeit einmal – es spart später Stunden.

Kernpython-Konzepte für KI

Sie müssen kein Python-Experte sein. Sie müssen diese fünf Konzepte verstehen:

Konzept 1: Variablen und Typen

# Zahlen

Alter = 25 # Ganzzahl

Höhe = 5,9 # Float

Punktzahl = 98,5

# Zeichenfolgen

Name = „Alice“

message = f"Hallo, {name}" # F-Strings zur Formatierung

# Listen (geordnet, veränderbar)

Zahlen = [1, 2, 3, 4, 5]

zahlen.append(6)

# Wörterbücher (Schlüssel-Wert-Paare)

person = {"name": "Alice", "age": 25, "city": "NYC"}

print(person["name"]) # Zugriff: AliceKonzept 2: Funktionen

defgreet(name):

return f"Hallo, {Name}!"

result = meet("Alice") # Funktionen nehmen Eingaben entgegen und geben Ausgaben zurückKonzept 3: Bibliotheken und Importe

# Gesamte Bibliothek importieren

numpy als np importieren

# Spezifische Funktion importieren

from datetime import datetime

# Verwenden Sie, was Sie importiert haben

array = np.array([1, 2, 3, 4, 5])

now = datetime.now()Konzept 4: Listenverständnis (Pythonic-Kurzschrift)

# Traditionelle Schleife

quadriert = []

für Zahl in [1, 2, 3, 4, 5]:

quadrat.append(Zahl ** 2)

# Pythonischer Weg

quadriert = [Zahl ** 2 für Zahl in [1, 2, 3, 4, 5]]

# Beide erzeugen: [1, 4, 9, 16, 25]Konzept 5: Fehlerbehandlung

versuchen Sie:

result = 10 / 0 # Dies wird fehlschlagen

außer ZeroDivisionError:

print("Kann nicht durch Null dividieren!")

schließlich:

print("Bereinigungscode wird trotzdem ausgeführt")Das Wichtigste: Wenn Sie diese fünf Konzepte beherrschen, können Sie 80 % des KI-Codes schreiben, auf den Sie stoßen werden.

Grundlegende Python-Bibliotheken für KI

NumPy: Die Stiftung

NumPy erstellt Arrays und Matrizen – die Datenstruktur aller KI.

numpy als np importieren

# Arrays erstellen

array = np.array([1, 2, 3, 4, 5])

Matrix = np.array([[1, 2, 3], [4, 5, 6]])

# Operationen auf Arrays

mean = np.mean(array) # Durchschnitt

std = np.std(array) # Standardabweichung

normalized = (array - mean) / std # NormalizePandas: Datenmanipulation

Pandas kümmert sich um das Laden, Bereinigen und Erkunden von Daten.

Pandas als PD importieren

# CSV laden

df = pd.read_csv('data.csv')

# Entdecken

df.head() # Erste 5 Zeilen

df.describe() # Statistik

df.info() # Datentypen und fehlende Werte

# Sauber

df = df.dropna() # Fehlende Werte entfernen

df['age'] = df['age'].astype(int) # Typen konvertieren

# Filtern

young_people = df[df['age'] < 30]Matplotlib und Seaborn: Visualisierung

Sie können nicht debuggen, was Sie nicht sehen können.

matplotlib.pyplot als plt importieren

Seaborn als SNS importieren

# Liniendiagramm

plt.plot([1, 2, 3, 4], [1, 4, 9, 16])

plt.xlabel('X')

plt.ylabel('Y')

plt.show()

# Histogramm

sns.histplot(data=df, x='age', bins=20)

plt.show()Scikit-Learn: Klassisches ML

Für Aufgaben, die kein Deep Learning erfordern, ist Scikit-Learn am schnellsten.

aus sklearn.linear_model import LinearRegression

aus sklearn.model_selection import train_test_split

# Daten teilen

X_train, X_test, y_train, y_test = train_test_split(

Funktionen, Beschriftungen, test_size=0.2

)

# Zugmodell

model = LinearRegression()

model.fit(X_train, y_train)

# Bewerten

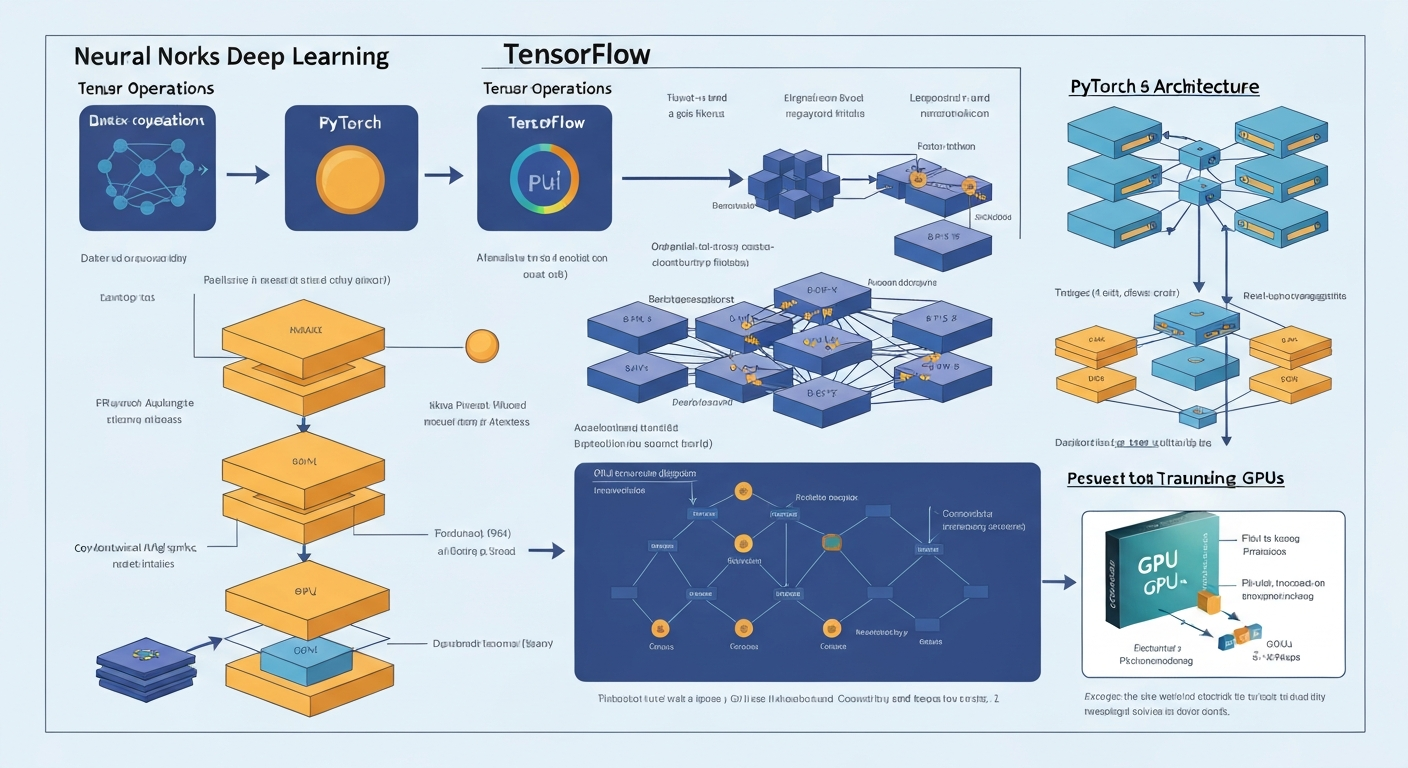

Score = model.score(X_test, y_test)Deep Learning Frameworks: PyTorch vs. TensorFlow

Beide sind ausgezeichnet. PyTorch ist für Anfänger benutzerfreundlicher. TensorFlow eignet sich besser für den Produktionsmaßstab.

PyTorch: Die Forschungswahl

PyTorch-Code liest sich wie normales Python. Fehler sind klar. Die Lernkurve ist sanft.

Fackel importieren

importiere Torch.nn als nn

# Erstellen Sie ein einfaches neuronales Netzwerk

Klasse SimpleNet(nn.Module):

def __init__(self):

super().__init__()

self.fc1 = nn.Linear(784, 128) # 784 Eingänge → 128 Neuronen

self.fc2 = nn.Linear(128, 10) # 128 Neuronen → 10 Ausgänge

def vorwärts(selbst, x):

x = Torch.relu(self.fc1(x))

x = self.fc2(x)

x zurückgeben

# Instanziieren

Modell = SimpleNet()

# Vorwärtspass

input_data = Torch.randn(32, 784) # 32 Beispiele, 784 Features

Ausgabe = Modell(Eingabedaten)TensorFlow: Die Produktionsauswahl

TensorFlow lässt sich auf riesige Datensätze und GPUs skalieren. Mehr Zeremonie, aber mehr Kontrolle.

tensorflow als tf importieren

# Modell erstellen

model = tf.keras.Sequential([

tf.keras.layers.Dense(128, Aktivierung='relu', input_shape=(784,)),

tf.keras.layers.Dense(10, Aktivierung='softmax')

])

# Kompilieren

model.compile(

optimierer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy']

)

# Zug

model.fit(X_train, y_train, epochs=10)Wichtige Erkenntnisse: Beginnen Sie mit PyTorch zum Lernen. Wechseln Sie zu TensorFlow, wenn Sie eine Bereitstellung auf Unternehmensebene benötigen.

Arbeiten mit vorab trainierten Modellen

Modelle von Grund auf zu trainieren ist langsam und teuer. Vorab trainierte Modelle sind viel schneller.

Umarmende Gesichtstransformatoren

Hugging Face hostet über 1 Million Open-Source-Modelle.

aus der Transformers-Importpipeline

# Textgenerierung

Generator = Pipeline('text-generation', model='gpt2')

Ergebnis = Generator('Es war einmal', max_length=50)

drucken(Ergebnis)

# Stimmungsanalyse

Klassifikator = Pipeline('sentiment-analysis')

result = classifier("Ich liebe diesen Film!")

# Ausgabe: [{'label': 'POSITIVE', 'score': 0,9999}]

# Erkennung benannter Entitäten

ner = Pipeline('ner')

result = ner("Apple Inc hat seinen Hauptsitz in Cupertino, Kalifornien")

# Extrahiert Organisationen, Standorte, PersonenOpenAI API (GPT-4, Einbettungen)

Auf die leistungsstärksten Modelle kann über die API zugegriffen werden.

von openai import OpenAI

client = OpenAI(api_key="your-api-key")

# Text generieren

Antwort = client.chat.completions.create(

model="gpt-4",

Nachrichten=[

{"role": "user", "content": "Quantencomputing in 2 Sätzen erklären"}

]

)

print(response.choices[0].message.content)Feinabstimmung vorab trainierter Modelle

Passen Sie Modelle an Ihre spezifische Domäne an.

from Transformers Import Trainer, TrainingArguments

training_args = TrainingArguments(

Output_dir='./results',

num_train_epochs=3,

per_device_train_batch_size=16,

)

Trainer = Trainer(

Modell=Modell,

args=training_args,

train_dataset=train_dataset,

)

trainer.train()Erstellen Sie Ihre erste KI-Anwendung

Lassen Sie uns einen Stimmungsanalysator erstellen, der Filmrezensionen klassifiziert.

Schritt 1: Daten abrufen

Pandas als PD importieren

# Beispieldaten laden

Daten = {

'Rezension': [

„Dieser Film ist großartig!“,

„Schreckliche Zeitverschwendung“,

„Nicht schlecht, sehenswert“

],

'Sentiment': ['positiv', 'negativ', 'positiv']

}

df = pd.DataFrame(data)Schritt 2: Vorab trainiertes Modell laden

aus der Transformers-Importpipeline

classifier = Pipeline('sentiment-analysis')Schritt 3: Vorhersagen treffen

reviews = df['review'].tolist()

Vorhersagen = Klassifikator (Bewertungen)

# Zum Datenrahmen hinzufügen

df['predicted_sentiment'] = [

pred['label'].lower() für pred in Vorhersagen

]

print(df)Schritt 4: Bewerten

# Vergleichen Sie vorhergesagt mit tatsächlich

Genauigkeit = (df['sentiment'] == df['predicted_sentiment']).mean()

print(f"Accuracy: {accuracy:.2%}")Das Wichtigste: Der gesamte Arbeitsablauf (Daten laden, Vorhersagen treffen, auswerten) erforderte 20 Codezeilen. Das ist die Stärke vorab trainierter Modelle.

LangChain: Intelligente Agenten erstellen

LangChain verbindet LLMs mit externen Tools. Dadurch können Agenten das Web durchsuchen, PDFs lesen und Code ausführen.

Basis-LLM-Kette

aus langchain.chat_models importiere ChatOpenAI

aus langchain.prompts ChatPromptTemplate importieren

llm = ChatOpenAI(model="gpt-4", Temperatur=0)

# Eingabeaufforderung erstellen

prompt = ChatPromptTemplate.from_messages([

(„Benutzer“, „Erklären Sie {Thema} in 2 Sätzen“)

])

# Kette erstellen

Kette = Eingabeaufforderung | llm

# Ausführen

result = chain.invoke({"topic": "machine learning"})

print(result.content)Agent mit Tools

aus langchain.agents import initialize_agent, Tool

vom langchain.tools-Importtool

aus langchain.chat_models ChatOpenAI importieren

@tool

Def-Rechner (Ausdruck: str) -> str:

„“„Wertet mathematische Ausdrücke aus““

return str(eval(expression))

@tool

def web_search(query: str) -> str:

„““Durchsucht das Web““

# Mit der Anforderungsbibliothek implementieren

return f"Ergebnisse für {query}"

tools = [Rechner, web_search]

llm = ChatOpenAI(model="gpt-4")

agent = initialize_agent(tools, llm, agent="zero-shot-react-description")

result = agent.run("Was ist 2+2? Dann suchen Sie nach der Hauptstadt Frankreichs")Dieser Agent wählt völlig autonom aus, welche Tools er in welcher Reihenfolge verwendet.

Datenvorbereitung und Vorverarbeitung

Die meisten KI-Projekte verbringen 70 % der Zeit mit der Datenvorbereitung. Erlernen Sie diese Fähigkeit frühzeitig.

Daten werden geladen

Pandas als PD importieren

# CSV

df = pd.read_csv('data.csv')

# JSON

df = pd.read_json('data.json')

# SQL-Datenbank

sqlite3 importieren

conn = sqlite3.connect('database.db')

df = pd.read_sql('SELECT * FROM table', conn)Daten bereinigen

# Fehlende Werte entfernen

df = df.dropna()

# Fehlende Werte ergänzen

df['age'].fillna(df['age'].mean(), inplace=True)

# Duplikate entfernen

df = df.drop_duplicates()

# Ausreißer entfernen (Werte über 3 Standardeinheiten)

df = df[

(df['age'] > df['age'].mean() - 3 * df['age'].std()) &

(df['age'] < df['age'].mean() + 3 * df['age'].std())

]Feature-Engineering

# Neue Funktionen erstellen

df['age_squared'] = df['age'] ** 2

df['age_category'] = pd.cut(df['age'], bins=[0, 18, 65, 100])

# Kodieren Sie kategoriale Variablen

df = pd.get_dummies(df, columns=['city'])

# Numerische Merkmale skalieren

aus sklearn.preprocessing importieren Sie StandardScaler

Scaler = StandardScaler()

df[['age', 'income']] = scaler.fit_transform(df[['age', 'income']])Vom Prototyp zur Produktion

Der Übergang von Jupyter-Notebooks zur Produktion erfordert Struktur.

Projektstruktur

my_ai_project/

├── Daten/

│ ├── roh/

│ └── verarbeitet/

├── Modelle/

│ └── trainiertes_modell.pkl

├── Notizbücher/

│ └── explore.ipynb

├── src/

│ ├── __init__.py

│ ├── data_loader.py

│ ├── model.py

│ └── Predict.py

├── Anforderungen.txt

└── README.mdBeispiel-Produktionsskript

# src/predict.py

Gurke importieren

Pandas als PD importieren

Klasse ModelPipeline:

def __init__(self, model_path):

mit open(model_path, 'rb') as f:

self.model = pickle.load(f)

def Predict(self, input_data):

„“input_data: pandas DataFrame““

Vorhersagen = self.model.predict(input_data)

Renditevorhersagen

if __name__ == '__main__':

Pipeline = ModelPipeline('models/trained_model.pkl')

test_data = pd.read_csv('data/processed/test.csv')

Vorhersagen = Pipeline.predict(test_data)

print(predictions)Bereitstellung mit FastAPI

aus Fastapi Import FastAPI

aus pydantic import BaseModel

Gurke importieren

app = FastAPI()

# Modell einmal beim Start laden

mit open('models/trained_model.pkl', 'rb') as f:

model = pickle.load(f)

Klasse PredictionRequest(BaseModel):

Alter: int

Einkommen: Float

@app.post("/predict")

def vorhersagen(Anfrage: PredictionRequest):

Vorhersage = model.predict([[request.age, request.income]])

return {"prediction": float(prediction[0])}

# Führen Sie Folgendes aus: uvicorn app:app --reloadHäufige Fallstricke und wie man sie vermeidet

Falle 1: Direkter Sprung zu Deep Learning

Deep Learning ist leistungsstark, aber für die meisten Probleme übertrieben. Versuchen Sie es zuerst mit scikit-learn.

Fix: Lineare Regression, Random Forests und Gradient Boosting lösen 80 % der Probleme ohne Deep Learning.

Falle 2: Arbeiten ohne Versionskontrolle

Sie werden ständig iterieren. Verfolgen Sie Ihre Arbeit.

Fix: Verwenden Sie Git vom ersten Tag an. Auf GitHub pushen.

git init

git add .

git commit -m „Erstes Commit“

git push origin mainFalle 3: Code wird nicht dokumentiert

Sie werden in zwei Wochen vergessen, was Sie geschrieben haben.

Fix: Dokumentzeichenfolgen zu Funktionen hinzufügen:

def Predict_sentiment(text):

„““

Klassifizieren Sie die Textstimmung als positiv oder negativ.

Argumente:

text (str): Der zu klassifizierende Text

Rückgaben:

str: 'positiv' oder 'negativ'

„““

# Implementierung

Ergebnis zurückgebenFalle 4: Training für alle Ihre Daten

Sie können die Daten, auf denen Sie trainiert haben, nicht auswerten. Testdaten immer reservieren.

Fix: Teilen Sie Ihre Daten auf:

aus sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test = train_test_split(

X, y, test_size=0,2, random_state=42

)Falle 5: Datenungleichgewicht ignorieren

Wenn Sie Betrug vorhersagen (0,1 % der Fälle), wird ein Modell verwendet, das „keinen Betrug“ vorhersagt. ist immer zu 99,9 % genau, aber nutzlos.

Fix: Verwenden Sie geeignete Metriken (F1-Score, AUC-ROC) und Resampling-Techniken.

FAQ

F: Wie lange dauert es, Python für KI zu lernen?

6–12 Monate konsequentes Üben, um berufliche Kompetenz zu erlangen. Schneller, wenn Sie Projekte sofort erstellen. Langsamer, wenn Sie Kurse ohne Codierung ansehen.

F: Benötige ich eine GPU?

Nein, ich fange nicht an. Eine moderne Laptop-CPU eignet sich gut zum Lernen. GPU beschleunigt das Training für große Modelle (von Vorteil, wenn Sie die Grundlagen verstanden haben).

F: Sollte ich zuerst Mathematik oder zuerst Programmieren lernen?

Zuerst codieren. Lernen Sie Mathematik, während Sie darauf stoßen. Theorie ohne Praxis vergisst man schnell.

F: Was ist die beste Reihenfolge, um Bibliotheken zu erlernen?

NumPy → Pandas → Matplotlib → Scikit-Learn → PyTorch (oder TensorFlow) → LangChain.

F: Woher weiß ich, ob ich für die Produktion bereit bin?

Sie sind bereit, wenn Sie können:

1. Laden und bereinigen Sie Daten unabhängig

2. Trainieren Sie ein Modell, ohne Code zu kopieren und einzufügen

3. Bewerten Sie die Leistung anhand geeigneter Kennzahlen

4. Bereitstellung über eine einfache API

F: Soll ich Jupyter oder VS Code verwenden?

Beides. Jupyter zum Erkunden und Lernen. VS-Code für Projekte, die für die Produktion bestimmt sind.

F: Wie bleibe ich mit der sich schnell verändernden KI auf dem Laufenden?

Folgen Sie: Papers with Code, Hugging Face Blog, fast.ai-Foren. Erstellen Sie Projekte mit neuen Tools – so lernen Sie am schnellsten.

Erweiterte Python-Bibliotheken für die KI-Entwicklung

PyTorch für Deep Learning

PyTorch ist das bevorzugte Framework für Forschungs- und Produktions-KI. Es ist pythonisch, flexibel und wird von großen KI-Teams bei Meta, Tesla und OpenAI weithin übernommen.

Fackel importieren

importiere Torch.nn als nn

aus Torch.utils.data DataLoader, TensorDataset importieren

Klasse SimpleNet(nn.Module):

def __init__(self, input_size, Hidden_size, Output_size):

super(SimpleNet, self).__init__()

self.fc1 = nn.Linear(input_size, versteckte_größe)

self.relu = nn.ReLU()

self.fc2 = nn.Linear(hidden_size, output_size)

def vorwärts(selbst, x):

x = self.fc1(x)

x = self.relu(x)

x = self.fc2(x)

x zurückgeben

Modell = SimpleNet(10, 64, 2)

loss_fn = nn.CrossEntropyLoss()

Optimizer = Torch.optim.Adam(model.parameters(), lr=0.001)

für Epoche im Bereich (100):

Ausgänge = Modell(X_train)

loss = loss_fn(outputs, y_train)

optimierer.zero_grad()

loss.backward()

optimierer.step()Das Wichtigste: PyTorch ermöglicht schnelles Experimentieren. Ändern Sie Architekturen und Verlustfunktionen mit nur wenigen Codezeilen.

LangChain für LLM-Anwendungen

LangChain vereinfacht die Erstellung von Anwendungen auf Basis von Sprachmodellen wie GPT-4. Es verarbeitet Eingabeaufforderungen, Ketten, Speicher und Integrationen.

aus Langchain-Import OpenAI, LLMChain, PromptTemplate

llm = OpenAI(api_key="sk-...", Temperatur=0,7)

template = „Sie sind ein hilfreicher KI-Assistent. Benutzerfrage: {question}. Hilfreiche Antwort:“

prompt = PromptTemplate(input_variables=["question"], template=template)

chain = LLMChain(llm=llm, prompt=prompt)

result = chain.run("Was ist maschinelles Lernen?")

print(result)Verwenden Sie LangChain für: Chatbots, Beantwortung von Fragen, Zusammenfassungen, mehrstufige Argumentationsketten.

Vektordatenbanken: Pinecone und Weaviate

Für KI-Anwendungen, die Einbettungen verwenden, speichern und fragen Vektordatenbanken Einbettungen effizient ab.

Tannenzapfen importieren

Pinecone.init(api_key="...", Environment="us-west1-gcp")

index = tannenzapfen.Index("Dokumente")

Einbettungen = [[0,1, 0,2, 0,3], [0,4, 0,5, 0,6]]

ids = ["doc1", "doc2"]

index.upsert(vectors=list(zip(ids, einbettungen)))

query_embedding = [0,15, 0,25, 0,35]

results = index.query(query_embedding, top_k=5)Vektordatenbanken unterstützen Empfehlungssysteme, semantische Suche und abrufgestützte Generierung.

Bereitstellung von KI-Modellen für die Produktion

Containerisierung mit Docker

Docker packt Ihren Code und Ihre Abhängigkeiten in einen konsistenten Container.

FROM python:3.11-slim

WORKDIR /app

KOPIEREN Sie „requirements.txt“.

FÜHREN Sie pip install -r require.txt aus

KOPIEREN. .

CMD ["python", "app.py"]Erstellen und ausführen:

docker build -t my-ai-app:1.0 .

docker run -p 8000:8000 my-ai-app:1.0Docker stellt sicher, dass Ihr Modell in Entwicklung, Test und Produktion identisch funktioniert.

API-Bereitstellung mit FastAPI

FastAPI ist schnell und modern für die Bereitstellung von KI-Modellen.

aus Fastapi Import FastAPI

aus pydantic import BaseModel

Joblib importieren

app = FastAPI()

model = joblib.load("model.pkl")

Klasse PredictionRequest(BaseModel):

Funktionen: Liste

@app.post("/predict")

def vorhersagen(Anfrage: PredictionRequest):

Vorhersage = model.predict([request.features])[0]

return {"prediction":vorhersageStarten Sie den Server:

pip install fastapi uvicorn

uvicorn app:app --host 0.0.0.0 --port 8000Jede Anwendung kann jetzt Ihr Modell aufrufen: POST http://localhost:8000/predict

Bereitstellungsplattformen (2026)

Hugging Face Spaces – Kostenlos für Open-Source-Modelle. Einfach zu teilen und zu demonstrieren.

AWS SageMaker – Enterprise-Qualität mit Skalierung, Überwachung und Versionierung.

Render oder Railway – Günstige, einfache Bereitstellung. Beginnen Sie bei 7 $/Monat.

Google Cloud Run – Pay-per-Request, keine Server. Ideal für variable Arbeitslasten.

Vercel – Am besten für Frontend + KI. Versenden Sie Full-Stack-Apps in wenigen Minuten.

KI-Code testen

Unit-Testmodelle

Testen Sie die Vorhersagen Ihres Modells mit bekannten Eingaben.

unittest importieren

numpy als np importieren

Klasse TestModel(unittest.TestCase):

def setUp(self):

self.model = load_model("path/to/model")

def test_prediction_shape(self):

X = np.array([[1, 2, 3], [4, 5, 6]])

y = self.model.predict(X)

self.assertEqual(y.shape, (2, 1))

def test_prediction_range(self):

X = np.array([[1, 2, 3]])

y = self.model.predict(X)[0]

self.assertTrue(0 <= y <= 1)

if __name__ == '__main__':

unittest.main()Modellleistung überwachen

Überwachen Sie Modellgenauigkeit, Latenz und Datenabweichung in der Produktion.

aus sklearn.metrics import precision_score

Protokollierung importieren

logger = logging.getLogger(__name__)

def monitor_predictions(true_labels, Vorhersagen):

Genauigkeit = Accuracy_score(true_labels, Vorhersagen)

logger.info(f"Modellgenauigkeit: {accuracy:.4f}")

wenn Genauigkeit < 0,85:

logger.warning("Modellgenauigkeit unter Schwellenwert!")

RückgabegenauigkeitHäufige Fehler bei der KI-Entwicklung

Fehler 1: Datenleck

Problem: Testdaten enthalten versehentlich Informationen aus Trainingsdaten.

# FALSCH

X_normalized = normalisieren(X)

X_train, X_test = train_test_split(X_normalized)

# RICHTIG

X_train, X_test, y_train, y_test = train_test_split(X, y)

X_train = normalize(X_train)

X_test = normalize(X_test)Fehler 2: Überanpassung an kleine Datensätze

Verwenden Sie Regularisierung und Kreuzvalidierung.

aus sklearn.model_selection import cross_val_score

aus sklearn.linear_model LogisticRegression importieren

scores = cross_val_score(LogisticRegression(C=1.0), X, y, cv=5)

print(f"CV Accuracy: {scores.mean():.4f} (+/- {scores.std():.4f})")Fehler 3: Verwendung der falschen Metrik

Verwenden Sie für unausgeglichene Datensätze F1 oder ausgeglichene Genauigkeit anstelle von Genauigkeit.

aus sklearn.metrics importieren f1_score,balanced_accuracy_score

f1 = f1_score(y_true, y_pred)

balanced_acc =balanced_accuracy_score(y_true, y_pred)Fehler 4: Fehlende Daten werden nicht verarbeitet

aus sklearn.impute importiere SimpleImputer

imputer = SimpleImputer(strategy="mean")

X_imputed = imputer.fit_transform(X)KI-Projektideen für das Lernen

Projekt 1: Sentiment Analysis Chatbot (Anfänger – 2 Wochen)

Erstellen Sie einen Chatbot, der Stimmungen klassifiziert und antwortet.

Tools: Transformers, FastAPI, Gradio

Schritte: (1) Hugging Face-Stimmungsmodell verwenden (2) FastAPI-Endpunkt erstellen (3) Gradio-Benutzeroberfläche erstellen (4) Auf Hugging Face Spaces bereitstellen

Fähigkeiten: Modell-APIs, Bereitstellung, UI-Integration

Projekt 2: Empfehlungsmaschine (Mittelstufe – 4 Wochen)

Erstellen Sie einen Film-Recommender mit kollaborativer Filterung.

Tools: LightFM, Pandas, PostgreSQL

Schritte: (1) Empfehlungsdatensatz abrufen (2) Kollaboratives Filtermodell erstellen (3) API erstellen (4) Auf AWS/Render bereitstellen

Fähigkeiten: Empfehlungssysteme, Datenbankabfragen, API-Design

Projekt 3: Dokumenten-Q&A-System (Fortgeschritten – 6 Wochen)

Erstellen Sie mit RAG ein System, das Fragen zu Ihren Dokumenten beantwortet.

Tools: LangChain, OpenAI, Pinecone, FastAPI

Schritte: (1) Dokumente laden und segmentieren (2) Einbettungen generieren, in Pinecone speichern (3) Blöcke für Benutzerfragen abrufen, LLM aufrufen (4) Als Web-App bereitstellen

Fähigkeiten: LLMs, Einbettungen, Vektorsuche, Produktionsbereitstellung

Karriereweg: Vom Anfänger zum KI-Ingenieur

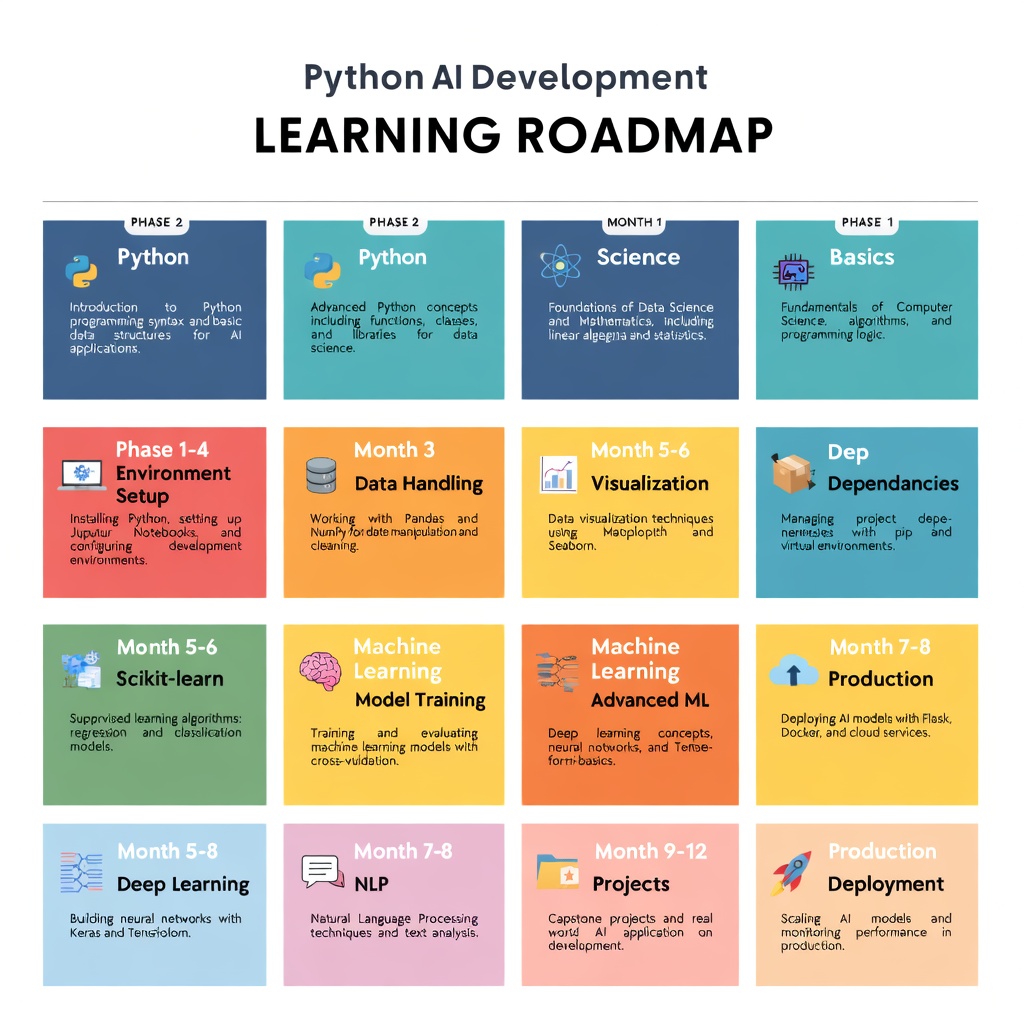

Monate 1–3: Grundlagen

Fokus: Python-Grundlagen, ML-Grundlagen, erste Modelle

Aktion: Python-Kurs (2–3 Wochen) → NumPy, Pandas (2 Wochen) → Scikit-Learn-Projekt (2 Wochen)

Ergebnis: Erstellen Sie einfache Klassifizierungs-/Regressionsmodelle

Berufsaussichten: Junior ML-Ingenieur, Datenanalyst (60–80.000 $)

Monate 4–6: Deep Learning

Schwerpunkt: Neuronale Netze, PyTorch, Bild-/NLP-Modelle

Aktion: Neuronale Netzwerktheorie (2 Wochen) → PyTorch CNN (3 Wochen) → NLP Transformers (2 Wochen)

Ergebnis: Deep-Learning-Modelle trainieren und bereitstellen

Berufsaussichten: ML-Ingenieur, KI-Ingenieur (120–160.000 $)

Monate 7–12: Produktion & Spezialisierung

Fokus: Bereitstellung, LLMs, Skalierung, Spezialisierung

Aktion: Spezialisierung auswählen (Lebenslauf/NLP/Empfehlungen) → 2–3 Portfolio-Projekte erstellen → In der Produktion bereitstellen → Zu Open-Source beitragen

Ergebnis: KI-Produkte in die Produktion schicken

Berufsaussichten: Leitender ML-Ingenieur, KI-Produktingenieur (150–250.000 $+)

Über Jahr 1 hinaus: Meisterschaft & Führung

Optionen:

– Forscher: PhD-Schwerpunkt, FAANG-Labore ($180–300.000+)

– Startup-Gründer: KI-Produkt entwickeln (0–10 Mio. $+, hohes Risiko)

– KI-Architekt: Leitet KI-Strategien für Unternehmen (200–400.000 $)

– KI-Wissenschaftler: Grenzmodelle (200–500.000 $+)

Schlüssel: Erstellen Sie echte Projekte, liefern Sie sie an die Produktion, verstehen Sie die geschäftlichen Auswirkungen.

KI-Anwendungen: Python-Beispiele aus der realen Welt

Beispiel 1: Erstellen eines einfachen Chatbots mit LangChain

Hier ist ein vollständiger Chatbot, der sich den Konversationskontext merkt:

aus langchain.llms OpenAI importieren

aus langchain.memory ConversationBufferMemory importieren

aus langchain.chains ConversationChain importieren

Speicher = ConversationBufferMemory()

llm = OpenAI(api_key="sk-...")

Konversation = ConversationChain(llm=llm, Speicher=Speicher)

während True:

user_input = input("Sie:")

Antwort = Konversation.run(input=user_input)

print(f"Bot: {response}")Dieser Chatbot verwaltet den Gesprächsverlauf automatisch. Der ConversationBufferMemory speichert die gesamte Konversation, sodass das Modell über Kontext für Folgefragen verfügt.

Beispiel 2: Bildklassifizierung mit Hugging Face

Bilder klassifizieren, ohne ein Modell zu trainieren:

aus der Transformers-Importpipeline

classifier = Pipeline("image-classification",

model="google/vit-base-patch16-224")

result = classifier("path/to/image.jpg")

print(result)Dadurch wird ein vorab trainiertes Sehmodell heruntergeladen und Bilder in drei Zeilen klassifiziert. Das ist die Kraft von Hugging Face.

Beispiel 3: Extrahieren von Daten aus Dokumenten

Verwenden Sie KI, um strukturierte Daten aus Dokumenten zu extrahieren:

aus langchain.llms OpenAI importieren

Importieren Sie PromptTemplate aus langchain.prompts

aus langchain.chains importieren Sie LLMChain

llm = OpenAI()

template = „Gesamtbetrag, Rechnungsdatum, Kundenname aus dieser Rechnung extrahieren. Ausgabe als JSON: {invoice_text}“

prompt = PromptTemplate(input_variables=["invoice_text"], template=template)

chain = LLMChain(llm=llm, prompt=prompt)

result = chain.run(invoice_text=invoice_content)

print(result)Dadurch werden strukturierte Daten aus unstrukturiertem Text ohne benutzerdefinierte Modelle extrahiert.

Leistungsoptimierung für KI-Modelle

Modellgröße reduzieren: Quantisierung

Große Modelle sind langsam. Die Quantisierung wandelt Gewichte von 32-Bit-Floats in 8-Bit-Ganzzahlen um und reduziert die Größe um das Vierfache.

Fackel importieren

aus Transformatoren importieren AutoModelForSequenceClassification

model = AutoModelForSequenceClassification.from_pretrained("bert-base")

quantized = Torch.quantization.quantize_dynamic(model, {torch.nn.Linear}, dtype=torch.qint8)Quantisierte Modelle laufen 2–4x schneller mit minimalem Genauigkeitsverlust.

Stapelverarbeitung für Geschwindigkeit

Mehrere Eingaben gleichzeitig verarbeiten:

# SLOW: Einer nach dem anderen

für Text in Texten:

Ergebnis = model.predict(text)

# SCHNELL: In Chargen

results = model.predict_batch(texts, batch_size=32)Batching nutzt die GPU effizient und beschleunigt Vorhersagen um das 10- bis 50-fache.

LLM-Antworten zwischenspeichern

API-Aufrufe durch Caching speichern:

aus langchain.cache importieren InMemoryCache

Langchain importieren

langchain.llm_cache = InMemoryCache()

llm = OpenAI()

result1 = llm("Was ist KI?") # API-Aufruf

result2 = llm("Was ist KI?") # Verwendet Cache, keinen API-AufrufVerwenden Sie für die Produktion Redis für dauerhaftes Caching.

LLMs lokal ausführen

Ollama: Lokale LLM-Inferenz

Modelle wie Llama 2 lokal ohne Cloud-APIs ausführen:

Importanfragen

json importieren

def query_local_llm(prompt):

Antwort = Anfragen.post("http://localhost:11434/api/generate",

json={"model": "llama2", "prompt": prompt, "stream": False})

return Response.json()["response"]

result = query_local_llm("Maschinelles Lernen erklären")

print(result)Vorteile: Datenschutz, keine API-Kosten, funktioniert offline.

Nachteil: Langsamer als die Cloud, benötigt GPU.

Leitfaden zur Modellauswahl

Fangen Sie klein an. Aktualisieren Sie nur, wenn die Qualität nicht ausreicht.

Debuggen von KI-Modellen

TensorBoard verwenden

Training in Echtzeit visualisieren:

aus Torch.utils.tensorboard import SummaryWriter

Writer = SummaryWriter()

für Epoche im Bereich (100):

Verlust = train_one_epoch()

write.add_scalar("Verlust/Zug", Verlust, Epoche)

val_loss = evaluieren()

write.add_scalar("Verlust/Wert", val_loss, Epoch)

write.close()Ansicht: tensorboard --logdir=runs

Modellerklärbarkeit

Verstehen Sie, warum Modelle Vorhersagen treffen:

aus Lime.lime_tabular Import LimeTabularExplainer

EXPLAINER = LimeTabularExplainer(X_train, mode="classification")

exp =explainer.explain_instance(X_test[0], model.predict_proba)

exp.show_in_notebook()LIME zeigt, welche Funktionen die Vorhersagen am meisten beeinflusst haben.

Code-Profilerstellung

Langsame Teile finden:

cProfile importieren

pstats importieren

Profiler = cProfile.Profile()

Profiler.enable()

my_ai_function()

Profiler.disable()

stats = pstats.Stats(profiler)

stats.sort_stats("cumulative").print_stats(10)Konzentrieren Sie sich bei der Optimierung auf Engpässe.

Sicherheit und Datenschutz

Schutz sensibler Daten

Senden Sie niemals sensible Rohdaten an APIs. Hash stattdessen:

Hashlib importieren

def anonymize_user_data(name, email):

hashed = hashlib.sha256(name.encode()).hexdigest()

gehasht zurückgebenRatenbegrenzung

Kontingentausschöpfung verhindern:

von Ratelimit-Importgrenzen, Sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60)

def call_api(prompt):

Gib llm.predict(prompt)zurück

API-Schlüssel sichern

Schlüssel nie fest codieren:

Betriebssystem importieren

aus dotenv import load_dotenv

load_dotenv()

api_key = os.getenv("OPENAI_API_KEY")

llm = OpenAI(api_key=api_key)In .env speichern (zu .gitignore hinzufügen).

Produktionsintegration

Datenbankabfragen

sqlite3 importieren

Pandas als PD importieren

conn = sqlite3.connect("database.db")

df = pd.read_sql_query("SELECT * FROM customer", conn)

Vorhersagen = model.predict(df)Protokollierung

Protokollierung importieren

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

Versuchen Sie:

Vorhersage = model.predict(data)

logger.info(f"Vorhersage: {Vorhersage}")

außer Ausnahme als e:

logger.error(f"Fehlgeschlagen: {e}")Webhooks für die Ereignisverarbeitung

from flask import Flask, request

app = Flask(__name__)

@app.route("/webhook", method=["POST"])

def handle_webhook():

data = request.json

Ergebnis = ai_model.process(data)

return {"status": "verarbeitet", "result": result}

if __name__ == "__main__":

app.run(port=5000)Externe Systeme können Ereignisse an Ihren KI-Dienst posten.

Empfohlene Lernressourcen

Top-Websites

- Hugging Face Hub (huggingface.co): Über 1 Mio. vorab trainierte Modelle

- Offizielle PyTorch-Tutorials (pytorch.org): Deep-Learning-Grundlagen

- Fast.ai (fast.ai): Praktische Deep-Learning-Kurse

- Papers with Code (paperswithcode.com): Forschung + Implementierungen

Communitys

- r/MachineLearning: Aktive Reddit-Community

- Kaggle: Wettbewerbe und Datensätze

- GitHub: Open-Source-Projekte

- Discord-Server: Treten Sie KI-Communitys bei

Projektideen für 2026

- Optimieren Sie Llama 2 an Ihren Domain-Daten

- Erstellen Sie einen RAG-Chatbot mit Pinecone + LangChain

- Stellen Sie ein Computer-Vision-Modell für AWS SageMaker bereit

- Erstellen Sie eine Stimmungsanalyse-API mit FastAPI

- Erstellen Sie eine Empfehlungsmaschine mit kollaborativer Filterung

Der Weg zur Meisterschaft führt über die Umsetzung echter Projekte.

FAQ

F1: Wie lange dauert es, Python für KI zu erlernen?

A: 4–8 Wochen für die Grundlagen. 3–6 Monate für Deep Learning. 1–2 Jahre bis zur Berufsreife (15–20 Stunden/Woche).

F2: Brauche ich einen Abschluss in Mathematik?

A: Nein. Praktische Fähigkeiten sind am wichtigsten. Bei Bedarf lernen Sie Mathematik berufsbegleitend.

F3: Was ist das beste erste Projekt?

A: Ein Modell anhand öffentlicher Daten trainieren, Vorhersagen treffen und Ergebnisse auswerten. Kaggle ist dafür perfekt.

F4: PyTorch oder TensorFlow?

A: PyTorch. Leichter zu erlernen, intuitiver, dominiert im Jahr 2026.

Aufbau produktionsbereiter KI-Systeme

Verwaltung technischer Schulden

Wenn Projekte wachsen, häufen sich technische Schulden. Verwalten Sie es proaktiv.

Gemeinsame Quellen:

– Code schnell und ohne Dokumentation geschrieben

– Schlecht getestete Randgehäuse

– Hartcodierte Werte und magische Zahlen

– Veraltete Abhängigkeiten

Verwaltung durch:

– Schreiben Sie Tests früh (nicht danach)

– Dokumentieren Sie beim Codieren (Kommentare, Dokumentzeichenfolgen)

– Refaktorieren Sie regelmäßig (10–20 % der Sprintzeit)

– Aktualisieren Sie Abhängigkeiten monatlich

– Codeüberprüfungen (Probleme erkennen, bevor sie sich vermehren)

Skalierung von KI-Diensten

Wenn Sie über einen einzelnen Server hinauswachsen:

docker build -t my-ai:1.0 .

Docker Push my-ai:1.0

kubectl apply -f distribution.yaml # Auf Kubernetes bereitstellenKubernetes orchestriert Container und übernimmt die Skalierung automatisch.

Erweiterte Option: Serverlos verwenden (AWS Lambda, Google Cloud Run). Zahlen Sie nur für die Rechenleistung, die Sie nutzen.

Überwachung von KI in der Produktion

Überwachen Sie über herkömmliche Metriken hinaus:

prometheus_client als prom importieren

model_accuracy = prom.Gauge('model_accuracy', 'Aktuelle Modellgenauigkeit')

inference_latency = prom.Histogram('inference_ms', 'Inference latency')

vorhersage_volume = prom.Counter('predictions_total', 'Gesamtvorhersagen')

# Metriken aktualisieren

model_accuracy.set(0.92)

inference_latency.observe(150)

vorhersage_volume.inc()Alarm am:

– Modellgenauigkeit < Schwelle

– Inferenzlatenz > Grundlinie

– API-Fehler > 1 %

– Datendrift (neue Daten ≠ Trainingsdaten)

Aufbau Ihrer KI-Grundlage

Die Pyramide der wesentlichen Fähigkeiten

[Fortgeschritten: KI auf Forschungsniveau]

/ [Production ML: Deploy & Überwachen]

/ [Core ML: Modelle & Algorithmen]

/ [Python-Grundlagen & Bibliotheken]

/ [Grundlagen der Informatik: Algorithmen & Datenstrukturen]Sie müssen keine KI auf Forschungsniveau beherrschen, um Produktionssysteme aufzubauen. Die meisten Jobs benötigen Layer 2–3.

Zeitaufwand für jedes Level

- Stufe 1 (CS-Grundlagen): 3–4 Wochen

- Level 2 (Python + Bibliotheken): 4–8 Wochen

- Stufe 3 (Core ML): 8–16 Wochen

- Stufe 4 (Produktion ML): 16–24 Wochen

- Stufe 5 (Forschungs-KI): 2+ Jahre Doktoratsstudium

Die meisten Fachkräfte arbeiten auf den Ebenen 2–4.

Fazit: Ihr Weg nach vorne

Sie verstehen jetzt Python für KI, das Ökosystem, wichtige Bibliotheken, praktische Beispiele, Tests, Bereitstellung und Karrierewege.

Nächste Schritte:

1. Diese Woche: Richten Sie eine Python-Umgebung ein und führen Sie ein einfaches Modell aus

2. Nächste Woche: Erstellen Sie ein kleines Projekt (Stimmungsanalyse, Empfehlung)

3. Nächsten Monat: Stellen Sie es in der Produktion bereit (AWS, Heroku oder serverlos)

4. Dieses Quartal: Schließen Sie ein Portfolioprojekt ab und erstellen Sie einen öffentlichen Arbeitsnachweis

5. Dieses Jahr: Tragen Sie zu Open Source bei, gewinnen Sie die erste KI-Rolle oder den ersten Kunden

Die Eintrittsbarriere ist niedrig. Der Vorteil ist enorm. Beginnen Sie noch heute.

F5: Wie bleibe ich auf dem Laufenden?

A: Lesen Sie arXiv-Artikel, folgen Sie Forschern, erstellen Sie Projekte, nehmen Sie an Kursen teil. Nehmen Sie sich 1–2 Stunden/Woche Zeit.

Schlussfolgerung

Python für KI ist nicht schwer. Es ist eine erlernbare Fähigkeit, die Türen zum Aufbau der Zukunft öffnet.

Die Roadmap ist einfach:

Monat 1–2: Beherrschen Sie die Python-Grundlagen und die Einrichtung der Umgebung. Erstellen Sie ein Datenexplorationsprojekt.

Monat 3–4: Lernen Sie NumPy, Pandas und Visualisierung. Erstellen Sie eine Datenpipeline.

Monat 5–6: Scikit-Learn lernen. Erstellen Sie ein Vorhersagemodell.

Monat 7–8: Lernen Sie PyTorch oder TensorFlow. Reproduzieren Sie Forschungsarbeiten.

Monat 9–12: Lernen Sie LangChain. Build-Agenten. In der Produktion bereitstellen.

Dieses Tempo ist ehrgeizig, aber erreichbar. Der Schlüssel liegt in der Konsistenz vor der Intensität. Eine Stunde täglich übertrifft jedes Mal einen Wochenend-Crashkurs.

Beginnen Sie noch heute. Wählen Sie ein kleines Projekt aus – automatisieren Sie etwas, analysieren Sie etwas, das Ihnen wichtig ist, bauen Sie etwas Nützliches. Dann skalieren Sie von dort aus.

Bereit, die KI-Entwicklung zu meistern? Treten Sie der learnAI-Community bei → learnAI Skool-Community