Was sind große Sprachmodelle (LLMs)? Vollständige Erklärung

Lesezeit: 22 Minuten

Aktualisiert: März 2026

Einführung

Milliarden Menschen nutzen mittlerweile jeden Tag große Sprachmodelle – von ChatGPT und Claude bis hin zu Googles Gemini und Metas Llama. Sie haben wahrscheinlich mit jemandem interagiert, ohne es zu merken. Dennoch haben die meisten Benutzer keine Ahnung, wie diese Systeme tatsächlich funktionieren oder was sie von herkömmlichen Suchmaschinen und KI unterscheidet.

Das Problem? LLMs sind so nahtlos in unser digitales Leben integriert, dass ihre Macht, Grenzen und Fähigkeiten für den Durchschnittsbürger ein Rätsel bleiben. Diese Wissenslücke führt sowohl zu unrealistischen Erwartungen als auch zu verpassten Chancen.

Das Versprechen dieses Leitfadens ist einfach: Er erklärt große Sprachmodelle von Grund auf und deckt alles ab, von der Art und Weise, wie sie trainiert werden, bis hin zu dem, was sie können und was nicht, komplett mit Beispielen aus der Praxis und aktuellen Benchmarks aus dem Jahr 2026.

Am Ende dieses Artikels werden Sie Folgendes verstehen:

– Was ein LLM eigentlich ist und wie er sich von anderen KI unterscheidet

– Die Transformatorarchitektur, die moderne LLMs antreibt

– Wie Unternehmen diese Modelle im Milliarden-Dollar-Maßstab trainieren

– Die größten heute erhältlichen Modelle und ihre Spezifikationen

– Über 15 reale Anwendungen, die Branchen verändern

– Die harten Einschränkungen aktueller LLMs

– Best Practices für deren effektive Nutzung

Lass uns eintauchen.

Inhaltsverzeichnis

- Was ist ein LLM? Die einfache Definition

- Wie LLMs funktionieren: Transformer-Architektur einfach erklärt

- Wie LLMs trainiert werden: Vortraining, Feinabstimmung und RLHF

- Die größten LLMs im Jahr 2026: GPT-4o, Claude 3.5, Gemini 1.5, Llama 3, Mistral

- Was LLMs können: 15 reale Anwendungen

- Was LLMs nicht können: Einschränkungen und Halluzinationen

- LLMs vs. traditionelle KI vs. Suchmaschinen

- Wie man LLMs effektiv nutzt: Praktische Tipps

- Die Zukunft von LLMs: Was im Jahr 2026 und darüber hinaus kommt

- FAQ: Ihre Fragen zu LLMs beantwortet

Was ist ein LLM? Die einfache Definition

Ein Large Language Model (LLM) ist ein künstliches Intelligenzsystem, das auf riesigen Textdatenmengen trainiert wird, um menschliche Sprache zu verstehen und zu generieren.

Das bedeutet in der Praxis Folgendes:

Das Kernkonzept

Ein LLM funktioniert, indem es das nächste Wort (oder „Token“, ein kleines Stück Sprache) in einer Sequenz vorhersagt. Wenn Sie eine Eingabeaufforderung wie „Erklären Sie Quantencomputing in einfachen Worten“ schreiben, liest das LLM Ihre Eingabe und generiert dann eine entsprechende Antwort, Token für Token, und sagt immer voraus, was als nächstes auf der Grundlage der während des Trainings gelernten Muster passieren sollte.

Stellen Sie sich das wie eine extrem ausgefeilte Funktion zur automatischen Vervollständigung vor – ähnlich wie Ihr Telefon beim Tippen das nächste Wort vorschlägt. Aber anstatt Vorhersagen auf der Grundlage einiger tausend Dokumente zu treffen, werden LLMs auf Billionen von Token trainiert, die aus Büchern, Websites, wissenschaftlichen Arbeiten, Code-Repositories und anderen Textquellen extrahiert werden.

Hauptmerkmale

Groß: Moderne LLMs enthalten Milliarden oder sogar Billionen von Parametern (mathematische Werte, die Sprachmuster kodieren). GPT-5 hat über 10 Billionen Parameter. Größere Modelle bieten im Allgemeinen eine bessere Leistung, erfordern jedoch mehr Rechenleistung.

Sprache: LLMs sind auf das Verstehen und Generieren textbasierter Sprache spezialisiert. Die neuesten Modelle (2026) können neben Text auch Bilder, Audio und Video verarbeiten und sind somit multimodal.

Modell:Ein LLM ist ein neuronales Netzwerk – eine mathematische Struktur, die von der Art und Weise inspiriert ist, wie biologische Neuronen miteinander verbunden sind. Diese Netzwerke lernen, indem sie Millionen von Parametern durch Training anpassen, ähnlich wie Ihr Gehirn neuronale Verbindungen durch Lernen stärkt.

Kurzes Beispiel

Eingabeaufforderung: „Was ist Photosynthese?“

Was das LLM macht:

1. Tokenisiert Ihre Eingabe (bricht sie in Stücke)

2. Verarbeitet jedes Token durch Transformatorschichten (wird als nächstes erklärt)

3. Sagt das wahrscheinlichste nächste Zeichen voraus: „Photosynthese“

4. Sagt dann das nächste voraus: „ist“

5. Dann: „das“

6. Und so weiter, bis eine kohärente Antwort vorliegt

Wichtige Erkenntnisse: Ein LLM ist ein neuronales Netzwerk, das auf riesigen Textmengen trainiert wird, um Sprachmuster vorherzusagen und menschenähnliche Antworten zu generieren.

Wie LLMs funktionieren: Transformer-Architektur einfach erklärt

Der Durchbruch, der moderne LLMs ermöglichte, war die Transformer-Architektur, die 2017 in einem Artikel mit dem Titel „Attention is All You Need“ vorgestellt wurde.

Das Verständnis von Transformatoren ist der Schlüssel zum Verständnis, warum LLMs so leistungsfähig sind.

Das von Transformers gelöste Problem

Vor Transformatoren verwendeten KI-Forscher Architekturen namens RNNs (Recurrent Neural Networks), die Text Wort für Wort nacheinander verarbeiteten. Dieser Ansatz hatte eine entscheidende Schwäche: Sie hatten Mühe, sich in langen Passagen an entfernte Wörter zu erinnern. Wenn Sie einen Satz mit 50 Wörtern hätten, hätte das Modell Schwierigkeiten, sich an das erste Wort zu erinnern, wenn es das 50. Wort verarbeitet.

Transformers lösten dieses Problem mit einem cleveren Mechanismus namens Selbstaufmerksamkeit.

Selbstaufmerksamkeit: Die Kerninnovation

Selbstaufmerksamkeit ermöglicht es dem Modell, alle Wörter in einem Satz gleichzeitig zu betrachten und zu verstehen, welche Wörter für das Verständnis anderer Wörter am wichtigsten sind.

Hier ist ein konkretes Beispiel:

Satz: „Der Bankdirektor saß am Flussufer.“

Bei der Verarbeitung des Wortes „Bank“ (erstes Vorkommen) nutzt das Modell die Selbstaufmerksamkeit, um zu fragen: „Welche anderen Wörter in diesem Satz sind für das Verständnis dieses Wortes am relevantesten?“ Es wird festgestellt, dass „executive“ und „sat“ wichtige Kontexthinweise sind, die darauf hindeuten, dass es sich um ein Finanzinstitut handelt.

Bei der Verarbeitung des zweiten „Ufers“ erkennt die Selbstaufmerksamkeit des Modells, dass „Fluss“ der wichtigste Kontexthinweis ist, was darauf hindeutet, dass es sich um einen geografischen Standort handelt.

Diese parallele Verarbeitung aller Token auf einmal sowie die Möglichkeit, die Bedeutung entfernter Token abzuwägen, machen Transformatoren so effektiv.

Die komplette Transformer-Pipeline

So fließt Text durch ein Transformatormodell:

1. Tokenisierung

Ihr Eingabetext wird in Token unterteilt – kleine Teile, die Wörter oder Unterwörter darstellen. Der Satz „Hallo Welt“ könnte zu Tokens [101, 7592, 2088] werden (Zahlen, die jedes Stück darstellen).

2. Einbetten

Jeder Token wird in einen Vektor (eine Liste von Zahlen) umgewandelt, der die Bedeutung erfasst. Das Token für „Hallo“ wird etwa zu [0,2, -0,5, 0,8, 1,2, …] mit Hunderten oder Tausenden von Dimensionen.

3. Positionskodierung

Da Transformatoren alle Token auf einmal verarbeiten, müssen sie die Reihenfolge der Wörter kennen. Jeder Einbettung werden spezielle Positionskodierungen hinzugefügt, um dem Modell mitzuteilen, wo in der Sequenz jedes Token erscheint.

4. Transformatorschichten (Aufmerksamkeit + Feed-Forward)

Die Einbettung erfolgt durch mehrere Transformatorschichten (moderne Modelle verwenden 40–100+ Schichten). Jede Ebene enthält:

– Mehrkopfaufmerksamkeit: Mehrere parallel laufende Selbstaufmerksamkeitsmechanismen, die sich jeweils auf unterschiedliche Aspekte der Sprache konzentrieren

– Feed-Forward-Netzwerk: Ein einfaches neuronales Netzwerk, das jedes Token unabhängig verarbeitet

– Ebenennormalisierung und Restverbindungen: Techniken, die das Training stabilisieren

5. Ausgabegenerierung

Nach Durchlaufen aller Schichten wird die endgültige Einbettung wieder in eine Wahrscheinlichkeitsverteilung über alle möglichen Token umgewandelt. Das Modell wählt den wahrscheinlichsten nächsten Token aus (oder tastet einen mit verschiedenen Strategien ab) und fügt ihn der Ausgabe hinzu.

6. Autoregressive Generierung

Der neu generierte Token wird als Eingabe zurückgemeldet und der Vorgang wiederholt sich. Dieser „autoregressive“ Ansatz – bei dem die Ausgabe zur neuen Eingabe wird – wird fortgesetzt, bis das Modell ein Stopp-Token generiert oder eine Längenbeschränkung erreicht.

Warum diese Architektur funktioniert

Transformatoren sind leistungsstark, weil sie:

– Verarbeiten Sie Abläufe parallel statt nacheinander, was das Training beschleunigt

– Lernen Sie langfristige Abhängigkeiten durch Selbstaufmerksamkeit und merken Sie sich relevanten Kontext über lange Dokumente hinweg

– Lernen effektiv übertragen, damit ein Modell, das für eine Aufgabe vorab trainiert wurde, bei verschiedenen Aufgaben gut funktionieren kann

– Effektive Skalierung mit mehr Parametern, mehr Daten und mehr Rechenleistung, was typischerweise die Leistung verbessert

Wichtige Erkenntnisse: Die Transformer-Architektur nutzt Selbstaufmerksamkeit, um es Modellen zu ermöglichen, die Bedeutung verschiedener Wörter gleichzeitig abzuwägen, sodass sie den Kontext verstehen und kohärenten Langtext generieren können.

Wie LLMs trainiert werden: Vortraining, Feinabstimmung und RLHF

Der Aufbau eines LLM erfordert drei verschiedene Trainingsphasen. Das Verständnis dieses Prozesses zeigt, warum LLMs so teuer sind und warum sie bestimmte Stärken und Schwächen haben.

Phase 1: Vorschulung (Die Stiftung)

Vor dem Training entsteht die reine Rechenleistung. Folgendes passiert:

Der Prozess:

1. Unternehmen sammeln Billionen von Token aus verschiedenen Quellen: Büchern, Websites, wissenschaftlichen Arbeiten, Code-Repositories, Nachrichtenartikeln und anderen öffentlichen Texten

2. Das Modell wird auf ein einfaches Ziel trainiert: Bei gegebenen N Token den (N+1)-ten Token vorhersagen

3. Beim Training werden riesige Rechencluster (oft mehr als 10.000 GPUs) verwendet, die wochen- oder monatelang laufen

4. Milliarden von Trainingsschritten passen die Parameter des Modells schrittweise an

Die Kosten:

– Das Training von GPT-5 kostete etwa 500 Millionen bis über 1 Milliarde US-Dollar an Rechenressourcen (Schätzungen für 2026)

– Energieverbrauch: Das Training großer Modelle verbraucht genug Strom, um kleine Städte mit Strom zu versorgen

– Trainingszeit: Wochen bis Monate kontinuierlicher Berechnung

Was das Modell lernt:

Während des Vortrainings absorbiert das Modell Folgendes:

– Sprachmuster und Grammatik

– Faktenwissen (was in Trainingsdaten gelesen wird)

– Denkmuster und Problemlösungsansätze

– Code, Mathematik und Fachwissen

– In den Trainingsdaten vorhandene Verzerrungen

Einschränkungen des alleinigen Vortrainings:

Ein vorab trainiertes Modell ist zwar leistungsfähig, aber noch nicht darauf optimiert, für Benutzer hilfreich zu sein. Es könnte:

– Vervollständigen Sie Text auf unnatürliche Weise (Nachahmung von Trainingsdatenmustern)

– Generieren Sie schädliche Inhalte, wenn diese in Trainingsdaten auftauchen

– Benutzeranweisungen nicht genau befolgen

– Halluzinieren oder Fakten erfinden

Deshalb ist Phase 2 notwendig.

Phase 2: Feinabstimmung (es nützlich machen)

Durch die Feinabstimmung wird das vorab trainierte Modell so angepasst, dass es hilfreicher, harmloser und ehrlicher ist.

Überwachte Feinabstimmung (SFT):

1. Unternehmen stellen Annotatoren (menschliche Bewerter) ein, um hochwertige Schulungsbeispiele zu erstellen

2. Jedes Beispiel zeigt eine Aufforderung und eine qualitativ hochwertige Antwort

3. Das Modell lernt, diese hochwertigen Antworten zu imitieren

4. In dieser Phase werden normalerweise Millionen von Trainingsbeispielen verwendet (kleiner als vor dem Training)

5. Trainingszeit: Tage bis Wochen auf kleineren Rechenclustern

Beispiel für ein Trainingspaar:

– Eingabe: „Wie lernt man maschinelles Lernen am besten?“

– Ideale Ausgabe: „Beginnen Sie mit den Grundlagen der linearen Algebra und Statistik. Lernen Sie dann Python. Fahren Sie mit überwachtem Lernen (Regression, Klassifizierung) und dann unüberwachtem Lernen fort. Üben Sie mit Kaggle-Datensätzen…“

Durch überwachte Feinabstimmung lernt das Modell:

– Wie man Antworten professionell strukturiert

– Schädliche Anfragen abzulehnen

– Um mehrstufige Anweisungen zu befolgen

– Wie Sie komplexe Themen klar aufschlüsseln

Phase 3: Reinforcement Learning from Human Feedback (RLHF)

RLHF ist die geheime Zutat, die modernen LLMs das Gefühl gibt, dass sie Ihnen tatsächlich helfen wollen.

So funktioniert RLHF:

- Kandidatenantworten generieren: Für eine Eingabeaufforderung generiert das Modell 4–8 verschiedene mögliche Antworten

- Menschliche Rangfolge: Annotatoren ordnen diese Antworten vom besten zum schlechtesten und berücksichtigen dabei Folgendes:

- Genauigkeit

- Hilfsbereitschaft

- Sicherheit

- Klarheit

- Prägnanz

- Trainieren Sie ein Belohnungsmodell: Ein separates neuronales Netzwerk lernt, menschliche Vorlieben vorherzusagen. Bei einer Antwort wird eine Punktzahl zugewiesen (höher = eher dem, was Menschen bevorzugen)

- Optimieren Sie das LLM: Das ursprüngliche LLM wird angepasst, um seinen Belohnungswert zu maximieren und lernt, Antworten zu generieren, die Menschen bevorzugen

- Iterieren: Unternehmen führen mehrere RLHF-Runden durch und verbessern so kontinuierlich die Ausrichtung

Warum das wichtig ist:

RLHF erklärt, warum Claude sich anders fühlt als GPT, der sich anders anfühlt als Gemini. Jedes Unternehmen betreibt RLHF mit leicht unterschiedlichen Präferenzen, Annotatoren und Belohnungssignalen, was zu Modellen mit unterschiedlichen „Persönlichkeiten“ führt.

Zusammenfassung des Trainingszeitplans

Wichtige Erkenntnisse: Das LLM-Training ist ein dreiphasiger Prozess: Vor dem Training wird ein grundlegendes Sprachverständnis aufgebaut, durch überwachte Feinabstimmung wird dem Modell beigebracht, dass es hilfreich ist, und RLHF optimiert es für menschliche Vorlieben.

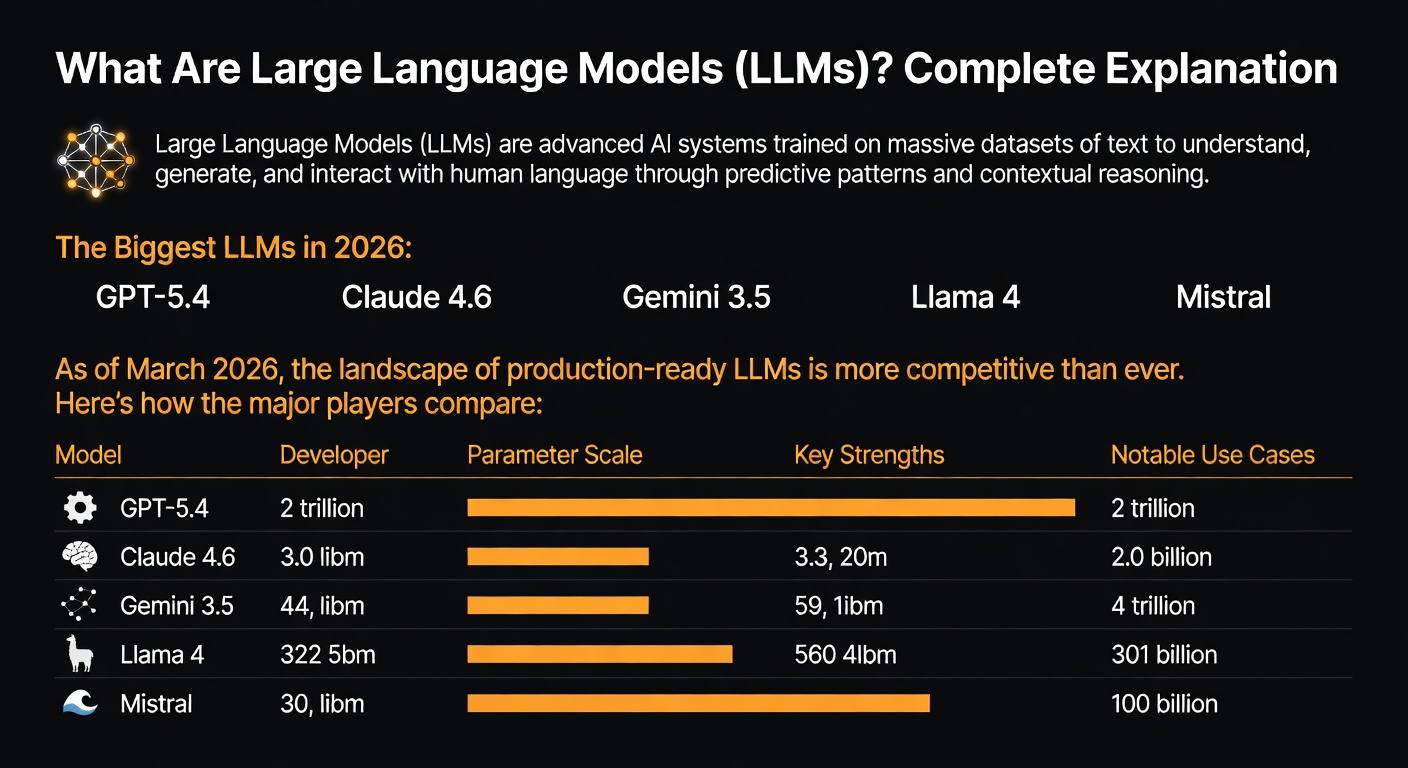

Die größten LLMs im Jahr 2026: GPT-4o, Claude 3.5, Gemini 1.5, Llama 3, Mistral

Seit März 2026 ist die Landschaft der produktionsbereiten LLMs wettbewerbsintensiver denn je. So vergleichen die Hauptakteure:

OpenAI GPT-5.4

Veröffentlicht: März 2026

Parameter: 10+ Billionen (geschätzt)

Kontextfenster: 1.000.000 Token (~750.000 Wörter)

Hauptmerkmale:

– Einheitliche Allzweck- und Codierungsmodelle in einem einzigen Flaggschiff

– Native Computer-Nutzungsfähigkeit (kann Ihren Computer steuern)

– Konfigurierbarer Argumentationsaufwand (wählen Sie Geschwindigkeit vs. Genauigkeit)

– Native multimodale Eingabe (Text, Bilder, Video in einer einzigen Eingabeaufforderung)

– Branchenführende Benchmark-Leistung

Am besten geeignet für: Benutzer, die das absolut leistungsfähigste Modell suchen; Unternehmen, die eine Automatisierung der Computernutzung benötigen

Preise: 20 $/Monat (Plus), 200 $/Monat (Pro) oder Pay-per-Use-API

Offizielle Dokumente: OpenAI GPT-Dokumentation

Stärken:

– Höchste Benchmark-Ergebnisse in den meisten Tests

– Ausgefeilteste Argumentation

– Bei den meisten Aufgaben am schnellsten

– Größte Community und größtes Ökosystem

Schwächen:

– Am teuersten in der Anwendung

– Weniger transparent in Bezug auf die Ausbildung

– Erfordert Vertrauen in ein Closed-Source-System

Anthropic Claude Opus 4.1

Veröffentlicht: August 2025

Parameter: 2+ Billionen (geschätzt)

Kontextfenster: 1.000.000 Token (~750.000 Wörter)

Hauptmerkmale:

– Konstitutionelle KI (trainiert, um hilfreich, harmlos und ehrlich zu sein)

– Extrem niedrige Halluzinationsraten bei allen Modellen

– Stark im Analysieren und Denken

– Hervorragend darin, detaillierte Anweisungen zu befolgen

– Native PDF-, Bild- und Videoverarbeitung

Am besten geeignet für: Recherche, detailliertes Schreiben, Analyse; Benutzer legen Wert auf Genauigkeit gegenüber reiner Leistung; kreative Arbeit

Preise: 20 $/Monat (Claude.ai Plus), 1.000 $/Monat (Claude.ai Teams) oder API-Pay-per-Use

Offizielle Dokumente: Anthropic Claude-Dokumentation

Stärken:

– Am zuverlässigsten hinsichtlich der Genauigkeit

– Am besten für Langzeitanalysen

– Stärkster verfassungsrechtlicher KI-Ansatz

– Ideal für kreative und nuancierte Aufgaben

Schwächen:

– Bei einigen Aufgaben etwas langsamer als GPT

– Kleineres Ökosystem als OpenAI

– Im Mainstream-Markt weniger bekannt

Google Gemini 3.1 Pro

Veröffentlicht: März 2026

Parameter: 1,2+ Billionen (geschätzt)

Kontextfenster: 1.000.000 Token (kann ganze Filme im Kontext verarbeiten)

Hauptmerkmale:

– Größtes Kontextfenster aller kommerziellen Modelle

– Nahtlose Integration mit dem Google-Ökosystem (Workspace, Suche, Android)

– Fungiert gleichzeitig als Produktivitätsassistent und Forschungsmotor

– Multimodal mit außergewöhnlichem Bildverständnis

– Echtzeitzugriff auf Google-Suchergebnisse

Am besten geeignet für: Viel Google Workspace-Nutzer; Produktivitätsautomatisierung; Echtzeit-Informationsbedarf

Preise: Kostenloses Kontingent mit Einschränkungen, 20 $/Monat (Gemini Advanced) oder API-Pay-per-Use

Offizielle Dokumente: Google AI-Dokumentation

Stärken:

– Riesiges Kontextfenster für die Dokumentenverarbeitung

– Nahtlose Google-Integration

– Suchzugriff in Echtzeit

– Hervorragend geeignet für Multimedia

– Starkes Bildverständnis

Schwächen:

– API kann langsamer sein als die Konkurrenz

– Datenschutzbedenken bei der Google-Integration

– Weniger getestet für einige spezielle Aufgaben

Meta Llama 4 (Open-Source)

Veröffentlicht: April 2025

Parameter: 400B (Scout), 1.4T (Maverick) (Standardversionen; MoE-Varianten größer)

Kontextfenster: 10.000.000 Token (Scout) – das größte aller Modelle

Hauptmerkmale:

– Mixture-of-Experts (MoE)-Architektur – verwendet pro Abfrage nur relevante Teile des Modells

– Native multimodal (Text, Bilder, Video)

– Open Source – kann lokal oder selbst gehostet ausgeführt werden

– Wettbewerbsfähige Benchmarks mit GPT und Gemini zu 1/10 der Kosten

– Starke Programmier- und Argumentationsfähigkeiten

Am besten geeignet für: Entwickler, die sich selbst hosten möchten; Unternehmen, die Kosteneffizienz benötigen; Organisationen, die vollständige Kontrolle über Daten wünschen

Preise: Kostenlos (Open-Source) oder Rückschluss über Anbieter wie Together, Replicate (0,50–2 US-Dollar pro Million Token)

Offizielle Dokumente: Meta Llama-Dokumentation

Stärken:

– Riesiges Kontextfenster

– Äußerst kostengünstig

– Keine Nutzungsbeschränkungen

– Kann selbst gehostet werden

– Starkes Leistungs-/Kostenverhältnis

Schwächen:

– Erfordert technische Einrichtung zur Verwendung

– Weniger poliert als kommerzielle Modelle

– Kleinere Benutzergemeinschaft

– Halluzinationsraten etwas höher als bei Claude

Mistral AI Mixtral 8x22B

Veröffentlicht: April 2025

Parameter: 141B (Expertenmischung, nutzt 39B aktiv)

Kontextfenster: 65.000 Token

Hauptmerkmale:

– Effizienter Expertenmix (leitet Anfragen an spezialisierte Experten weiter)

– Open Source und einfach bereitzustellen

– Außergewöhnlicher Grund für seine Größe

– Starke Programmierkenntnisse und Mathematik

– Inferenz mit geringer Latenz

Am besten geeignet für: Entwickler, die effiziente Open-Source-Modelle wünschen; kostensensible Anwendungen; Spezialaufgaben

Preise: Kostenlose (Open-Source) oder günstige Inferenz über Anbieter (0,10–0,50 $ pro Million Token)

Offizielle Dokumente: Mistral AI-Dokumentation

Stärken:

– Bestes Leistungs-Kosten-Verhältnis

– Klein genug für Edge-Geräte

– Open-Source und modifizierbar

– Schnelle Schlussfolgerung

– Stark bei Spezialaufgaben

Schwächen:

– Kleineres Kontextfenster als Anführer

– Nicht so geeignet für offene Aufgaben

– Halluzinationsraten höher als bei Grenzmodellen

Modellvergleichstabelle

Wichtige Erkenntnisse: Der LLM-Markt 2026 bietet Optionen für jeden Anwendungsfall: maximale Leistung (GPT-5), höchste Genauigkeit (Claude), beste Produktivität (Gemini), Kosteneffizienz (Llama) und schlanke Effizienz (Mistral). Ihre Wahl hängt von Ihren spezifischen Bedürfnissen, Ihrem Budget und Ihrer Infrastruktur ab.

Was LLMs können: 15 reale Anwendungen

LLMs haben sich von Forschungslaboren zur Kerninfrastruktur von Produkten und Dienstleistungen entwickelt. Hier sind 15 bewährte Anwendungen, die derzeit Branchen verändern:

1. Kundenservice-Automatisierung

Branche: Einzelhandel, SaaS, Finanzen

Unternehmens-Chatbots bearbeiten mittlerweile 40–60 % der Kundenanfragen ohne menschliches Eingreifen, analysieren Support-Tickets, um Muster zu erkennen und schulen zu qualitativ hochwertigen Antworten. Unternehmen berichten von einer Verbesserung der Lösungsraten beim ersten Anruf und der Verfügbarkeit rund um die Uhr um 30–50 %. Ein großes Finanzinstitut verarbeitet täglich mehr als 10.000 Kundeninteraktionen mit LLM-gestützten Supportsystemen.

2. Content-Generierung & Kuration

Branche: Marketing, Verlagswesen, Medien

LLMs generieren Blogbeiträge, Social-Media-Inhalte, E-Mail-Kampagnen und Produktbeschreibungen in großem Maßstab. Tools wie Jasper, Copy.ai und Claude sind in Marketingteams zum Standard geworden. Eine Content-Marketing-Agentur kann jetzt mithilfe von LLM-Unterstützung und menschlicher Überprüfung das Fünffache an Inhalten zu einem Drittel der Kosten produzieren.

3. Codegenerierung & Debuggen

Branche: Softwareentwicklung

GitHub Copilot verwendet LLMs, um Codevervollständigungen vorzuschlagen, Tests zu generieren und Code zu erklären. Studien zeigen, dass Entwickler, die KI-Codierungsassistenten verwenden, Aufgaben 35–55 % schneller erledigen. Vom Schreiben von Grundbausteinen bis zum Refactoring ganzer Systeme sind LLMs zu unverzichtbaren Entwicklungswerkzeugen geworden.

4. Automatisierung von Krankenakten

Branche: Gesundheitswesen

LLMs hören Arzt-Patienten-Gesprächen zu und übertragen sie automatisch in strukturierte Krankenakten, um Symptome, Diagnosen, Medikamente und Behandlungspläne zu extrahieren. Dadurch entfallen 20 bis 30 Minuten Dokumentation pro Patient, was die Produktivität des Arztes steigert.

5. Rechtsrecherche & Vertragsanalyse

Branche: Recht

Top-Anwaltskanzleien, die LLM-gestützte juristische Recherchetools nutzen, verkürzen die Recherchezeit um 60 %. LLMs analysieren Gerichtsentscheidungen, um relevante Präzedenzfälle vorzuschlagen, überprüfen Verträge auf riskante Klauseln und identifizieren Probleme bei der Einhaltung gesetzlicher Vorschriften. Tools wie LexisNexis+ und Westlaw Edge AI umfassen jetzt LLM-Funktionen.

6. Vertriebsintelligenz & Lead-Bewertung

Branche: B2B-Vertrieb

LLMs analysieren das Verhalten potenzieller Kunden, E-Mails und Unternehmensdaten, um die Lead-Qualität automatisch zu bewerten. Vertriebsteams, die KI-gestützte Lead-Scoring-Systeme verwenden, verbessern die Konversionsraten um 20–30 %, indem sie sich auf Chancen mit der höchsten Wahrscheinlichkeit konzentrieren.

7. Personalisierte Bildung & Nachhilfe

Branche: EdTech

LLMs passen Bildungsinhalte an individuelle Lernstile an, generieren personalisierte Übungsfragen, liefern auf das Verständnisniveau zugeschnittene Erklärungen und bieten Nachhilfe rund um die Uhr an. Dies demokratisiert den Zugang zu Bildung und ist besonders effektiv für Lernende, die zusätzliche Unterstützung benötigen.

8. Produktbeschreibung & E-Commerce-Optimierung

Branche: Einzelhandel, Marktplatz

E-Commerce-Plattformen nutzen LLMs, um Produktbeschreibungen zu erstellen, Funktionen von Mitbewerbern zu vergleichen, Titel für die Suche zu optimieren und Kundenrezensionen zu analysieren, um Produktlisten zu verbessern. Einzelhändler berichten von einer Steigerung der Konversionsraten um 15–25 %.

9. Lebenslauf-Screening & Rekrutierung

Branche: HR, Recruiting

LLMs prüfen Tausende von Lebensläufen, extrahieren Qualifikationen, identifizieren Top-Kandidaten und prüfen die erforderlichen Fähigkeiten, wodurch der Personalvermittler die für die Erstprüfung aufgewendete Zeit um 80 % reduziert. Dies beschleunigt den Einstellungsprozess und verbessert gleichzeitig die Kandidatenzuordnung.

10. Finanzanalyse & Zusammenfassung der Gewinnaufrufe

Branche: Finanzen, Investitionen

LLMs analysieren Gewinnabschriften, Quartalsberichte und Finanzberichte, um wichtige Erkenntnisse zu gewinnen, Trends vorherzusagen und die Leistung zusammenzufassen. Wertpapierfirmen nutzen LLM-gestützte Analysen, um Signale schneller als die Konkurrenz zu identifizieren.

11. Bearbeitung von Versicherungsansprüchen

Branche: Versicherungen

LLMs extrahieren Informationen aus Anspruchsdokumenten, prüfen den Versicherungsschutz, berechnen Auszahlungsbeträge und erstellen Antwortmitteilungen. Agentensysteme bearbeiten Routineansprüche ohne menschliches Eingreifen und verkürzen so die Bearbeitungszeit von Tagen auf Minuten.

12. Optimierung von Immobilieneinträgen

Branche: Immobilien

LLMs analysieren Markttrends, erstellen Immobilienbeschreibungen, vergleichen Angebote von Mitbewerbern und identifizieren automatisch vergleichbare Immobilien für die Preisgestaltung. Agenten verbringen weniger Zeit mit administrativer Arbeit und haben mehr Zeit für hochwertige Kundeninteraktionen.

13. Sprachübersetzung & Lokalisierung

Branche: Globales Geschäft, Lokalisierung

Moderne LLMs übersetzen Inhalte in verschiedene Sprachen und bewahren dabei Nuancen, Redewendungen und kulturellen Kontext besser als frühere Ansätze. Unternehmen, die Produkte auf neue Märkte lokalisieren, können dies schneller und kostengünstiger tun.

14. Stimmungsanalyse & Überwachung sozialer Medien

Branche: Markenmanagement, Customer Intelligence

LLMs analysieren Social-Media-Erwähnungen, Kundenrezensionen und Feedback, um die Markenstimmung in Echtzeit zu verstehen. Unternehmen erkennen aufkommende Probleme, verfolgen die Markenwahrnehmung und identifizieren Kundenprobleme in großem Maßstab.

15. Technische Dokumentation & API-Dokumentation

Branche: Software, DevTools

LLMs generieren Softwaredokumentation, API-Anleitungen und Implementierungsbeispiele. Dies reduziert den Zeitaufwand, den Entwickler für die Dokumentation aufwenden, und trägt dazu bei, die Genauigkeit bei der Weiterentwicklung des Codes aufrechtzuerhalten.

Statistiken zur Branchenakzeptanz

Laut McKinsey Technology Trends Outlook 2025 stieg der Einsatz von generativen KI-Systemen auf Basis von LLMs in allen Unternehmen von 33 % im Jahr 2024 auf 67 % im Jahr 2025 – eine Verdoppelung in nur einem Jahr. Bis 2026 wird die Akzeptanz in den Bereichen Technologie, Finanzen und professionelle Dienstleistungen über 80 % betragen.

Wichtige Erkenntnis: LLMs sind nicht mehr experimentell – sie sind Produktionsinfrastruktur. Nahezu jede Branche findet Anwendungen, wobei die größten Produktivitätssteigerungen in der Wissensarbeit zu verzeichnen sind: Schreiben, Analyse, Codierung, Kundeninteraktion und Forschung.

Was LLMs nicht können: Einschränkungen und Halluzinationen

Trotz ihrer beeindruckenden Fähigkeiten unterliegen LLMs harten Einschränkungen. Das Verständnis dieser Einschränkungen ist entscheidend, um sie effektiv nutzen zu können.

1. Halluzinationen (das größte Problem)

LLMs erzeugen selbstbewusst klingende falsche Informationen, die als „Halluzinationen“ bezeichnet werden. Das Modell sagt Token voraus, die plausibel klingen, aber sachlich falsch sind.

Warum es passiert:

– Das Trainingsziel des Modells ist die Vorhersage des nächsten Tokens, nicht die Vorhersage der Wahrheit

– LLMs optimieren auf Sprachmuster, nicht auf Genauigkeit

– Sobald ein LLM einen falschen Weg einschlägt, arbeitet er die Unwahrheit weiter aus

Echtes Beispiel:

Eingabeaufforderung: „Wie lautet die Telefonnummer des Weißen Hauses?“

Ein typischer LLM könnte antworten: „Die Telefonnummer des Weißen Hauses ist (202) 456-1111“ – was korrekt ist – aber manchmal halluziniert er Varianten oder fügt falsche Durchwahlen hinzu.

Problematischer:

Eingabeaufforderung: „Listen Sie alle wissenschaftlichen Arbeiten auf, die Dr. Jane Smith im Jahr 2024 zum Thema Quantencomputing veröffentlicht hat.“

Ein LLM könnte ganze Aufsätze mit plausibel klingenden Titeln fabrizieren, die es eigentlich gar nicht gibt.

Abwehrstrategien:

– Überprüfen Sie alle sachlichen Behauptungen in wichtigen Kontexten

– Verwenden Sie Retrieval-Augmented Generation (RAG), um LLMs den Zugriff auf aktuelle Daten zu ermöglichen

– Fordern Sie Quellen und Zitate an

– Verwenden Sie Modelle, die speziell auf Genauigkeit abgestimmt sind (Claude zeichnet sich hier aus)

2. Kein Echtzeitwissen

LLM-Schulungsdaten haben ein Wissensstichtag. Modelle, die im Jahr 2024 trainiert wurden, wissen nichts über Ereignisse im Jahr 2026, es sei denn, sie erhalten diese Informationen ausdrücklich.

Beispiel:

Ein Modell, das bis April 2024 trainiert wurde, weiß nicht:

– Wer hat die US-Wahl 2024 gewonnen

– Aktuelle Börsenbewegungen

– Neue Produkteinführungen

– Aktuelle Nachrichten

Lösung: Verwenden Sie LLMs mit Websuchzugriff (wie Gemini oder Claude mit externen Tools) oder implementieren Sie RAG-Systeme, die aktuelle Informationen einspeisen.

3. Einschränkungen des Kontextfensters (teilweise behoben)

Während 2026-Modelle über Millionen-Token-Kontextfenster verfügen, gibt es dennoch Einschränkungen. Informationen in sehr langen Kontexten werden manchmal „vergessen“ (das „Lost-in-the-Middle“-Phänomen).

Praktische Grenze: Während ein Modell möglicherweise 1 Mio. Token akzeptiert, funktionieren praktische Anwendungen aufgrund der Kosten und der Verschlechterung der Aufmerksamkeit in der Regel am besten mit 50.000–200.000 Token.

4. Kein echtes Verständnis

LLMs sind hochentwickelte Mustervergleichssysteme, keine bewussten Einheiten mit Verständnis. Sie:

– Kann Konzepte nicht wirklich „verstehen“, sondern nur Muster erkennen

– Sie müssen zwischen den Gesprächen kein dauerhaftes Gedächtnis haben

– Kann Fakten nicht unabhängig überprüfen

– Kann nicht wirklich lernen (Modelle sind nach dem Training statisch)

Philosophische Anmerkung: Philosophen diskutieren darüber, ob das, was LLMs tun, „Verstehen“ darstellt. Aus praktischer Sicht verhalten sich LLMs bei vielen Aufgaben auf eine Weise, die nicht vom Verstehen zu unterscheiden ist, diese Einschränkung ist jedoch bei Aufgaben zum kritischen Denken von Bedeutung.

5. Kämpfe mit extrem langen Argumentationsketten

Während LLMs sich durch mehrstufiges Denken auszeichnen, werden extrem lange Argumentationsketten (50+ Schritte) weniger zuverlässig. Fehler summieren sich über die einzelnen Schritte hinweg.

Beispiel:

Ein Geometrieproblem, das 30 aufeinanderfolgende Argumentationsschritte erfordert, könnte in 70 % der Fälle korrekt gelöst werden, während ein 10-Schritte-Problem in 95 % der Fälle korrekt gelöst werden könnte.

6. Schlecht bei Aufgaben, die sensorische Eingaben in Echtzeit erfordern.

LLMs können nicht:

– Live-Video-Feeds verarbeiten (nur statische Bilder)

– Hören Sie Audio in Echtzeit (nur transkribierter Text oder vorab aufgezeichnetes Audio)

– Riechen, schmecken oder fühlen

– Interagieren Sie direkt mit physischen Umgebungen

Moderne multimodale Modelle können Bilder verarbeiten, sind aber immer noch nicht in der Lage, echte Echtzeitwahrnehmung zu bewältigen.

7. Begrenzte Fähigkeit, ohne Umschulung aus neuen Daten zu lernen

Jedes Gespräch mit einem LLM beginnt neu. Das Modell kann nicht wie Menschen aus Ihrem Feedback innerhalb eines Gesprächs lernen. Von Ihnen vorgenommene Korrekturen werden nicht „erinnert“, es sei denn, Sie werden im selben Gespräch ausdrücklich daran erinnert.

8. Probleme mit ungewöhnlichen oder hochspezialisierten Domänen

LLMs sind in folgenden Domänen am schwächsten:

– Extrem selten in Trainingsdaten (unklare akademische Bereiche)

– Erfordern aktuelles Wissen (letzten Monat veröffentlichte Forschungsarbeiten)

– Verwenden Sie hochspezialisierten Fachjargon, der in Trainingsdaten nicht gut vertreten ist

– Erfordern praktische Erfahrung

9. Kann nicht zuverlässig zählen oder präzise rechnen

Das ist angesichts der mathematischen Fähigkeiten von LLMs überraschend, aber sie haben Probleme mit:

– Zählen großer Mengen

– Mehrstellige Arithmetik (insbesondere mit Übertrag)

– Präzise mathematische Beweise

Beispiel:

Eingabeaufforderung: „Zählen Sie die Anzahl der ‚R‘s im Wort ‚Erdbeere‘“

Viele LLMs antworten fälschlicherweise mit „2“ statt der richtigen „3“

10. Begrenztes Denken mit gesundem Menschenverstand

Während LLMs Muster aus Trainingsdaten absorbiert haben, versagen sie manchmal bei Denkaufgaben, die auf der tiefen körperlichen oder sozialen Intuition beruhen, die Kinder von Natur aus besitzen.

Beispiel:

„Eine Badewanne ist mit Wasser gefüllt. Jemand entfernt einen Korken aus dem Abfluss der Badewanne. Was passiert?“

LLMs antworten normalerweise richtig, aber ungewöhnliche Variationen verwirren sie manchmal.

Zusammenfassung der Einschränkungen

Das Wichtigste zum Mitnehmen: LLMs zeichnen sich durch Sprache, Mustervergleich und die Generierung plausiblen Textes aus, aber sie halluzinieren Fakten, es mangelt ihnen an Echtzeitwissen und sie versagen manchmal bei Denkaufgaben, die für Menschen einfach erscheinen. Nutzen Sie sie als mächtige Werkzeuge, nicht als Orakel.

LLMs vs. traditionelle KI vs. Suchmaschinen: Was ist der Unterschied?

Wenn Sie neu in der KI sind, scheinen LLMs möglicherweise anderen KI-Systemen zu ähneln, von denen Sie gehört haben. Das sind sie nicht. So vergleichen sie:

LLMs vs. traditionelle Modelle für maschinelles Lernen

Traditionelles ML (Logistische Regression, Entscheidungsbäume, SVMs, Random Forests):

– Geschult, um eine einzelne Variable vorherzusagen (z. B. „Wird dieser Kredit ausfallen?“ Ja/Nein)

– Erfordern handgefertigte Funktionen (Menschen erstellen manuell Eingabevariablen)

– Arbeiten Sie am besten mit kleinen bis mittleren Datensätzen (Tausende bis Millionen von Beispielen)

– Interpretierbar – oft kann man nachvollziehen, warum ein Model eine Entscheidung getroffen hat

– Schnell und günstig zu trainieren

– Wird für Klassifizierung, Regression und Clustering verwendet

Beispiel: Eine Bank trainiert einen Random Forest, um Kreditausfälle anhand von 20 Merkmalen (Kreditwürdigkeit, Einkommen, Schulden-Einkommens-Verhältnis, Beschäftigungsverlauf usw.) vorherzusagen. Es prognostiziert: 85 % Chance auf Rückzahlung.

LLMs:

– Trainiert, um das nächste Token in einer Sequenz vorherzusagen (offen)

– Lernen Sie Funktionen automatisch aus Rohtextdaten

– Erfordern riesige Datensätze (Milliarden bis Billionen Token)

– Nicht interpretierbar – Black Box zur Entscheidungsfindung

– Die Schulung ist teuer (über 500 Millionen US-Dollar), aber nach der Schulung ist die Nutzung günstig

– Erzeugen Sie kreative, ergebnisoffene Ergebnisse

Beispiel:Sie fragen Claude: „Soll ich einen Kredit aufnehmen?“ Und es analysiert Ihre Situation ganzheitlich, berücksichtigt den finanziellen Kontext, Alternativen und persönliche Umstände und bietet differenzierte Ratschläge.

LLMs vs. andere AI/ML-Modelle

Computer-Vision-Modelle (Objekterkennung, Bildsegmentierung):

– Spezialisiert auf visuelle Aufgaben

– Text kann nicht verarbeitet werden

– Moderne Versionen beinhalten multimodale Funktionen

Empfehlungssysteme:

– Optimierung für die Vorhersage von Benutzerpräferenzen

– Nicht für die Generierung von offenem Text konzipiert

– Wird in Netflix, Spotify, Amazon verwendet

Wissensdiagramme & Semantische Suche:

– Hinterlegen Sie strukturierte Sachzusammenhänge

– Kann präzise Sachfragen beantworten

– Generieren Sie keine neuen Inhalte

LLMs vs. Suchmaschinen: Die wichtigsten Unterschiede

Dieser Vergleich ist wichtig, da viele Menschen LLMs mit der Google-Suche verwechseln.

Praktische Unterschiede:

Suchmaschinenfrage:

„Was ist die Hauptstadt von Frankreich?“

→ Gibt Wikipedia-Artikel über Paris, Regierungswebsites und Karten zurück

LLM-Frage:

„Erklären Sie, warum Paris an der Seine liegt und wie sich dies auf seine Entwicklung als Hauptstadt ausgewirkt hat.“

→ Erstellt eine durchdachte Synthese aus 2–3 Absätzen, in der Geografie, Geschichte und strategische Bedeutung erläutert werden

Können LLMs eine Suche durchführen?

Moderne LLMs integrieren zunehmend eine Websuche:

– Gemini (Google) verfügt über eine Echtzeit-Suchintegration

– Claude können Webbrowser-Tools zur Verfügung gestellt werden

– OpenAI fügt GPT eine Websuche hinzu

Dadurch entsteht ein Hybridsystem, das die Argumentation von LLMs mit der Aktualität von Suchmaschinen kombiniert.

LLMs vs. spezialisierte KI-Assistenten

Spezialisierte Assistenten wie:

– Siri, Alexa: Sprachschnittstellen mit begrenzten Funktionen, die typischerweise bestimmte Funktionen aufrufen

– ChatBot für den Kundenservice: Regelbasierte oder Narrow-LLM-Systeme, die vordefinierte Fragen beantworten

– Grammatikprüfer: Spezialisiert auf eine begrenzte Aufgabe

Hauptunterschied: LLMs sind universell einsetzbar. Sie passen sich jeder Aufgabe an, die Sie stellen, ohne Umschulung.

Wichtige Erkenntnisse: LLMs unterscheiden sich grundlegend von traditionellem ML (offene Generierung vs. spezifische Vorhersage), Suchmaschinen (synthetisieren vs. abrufen) und spezialisierten Assistenten (allgemein vs. eng). Sie nehmen eine einzigartige Stellung als universelle Sprachverständnissysteme ein.

Wie man LLMs effektiv nutzt: Praktische Tipps

Da Sie nun verstanden haben, was LLMs sind und welche Einschränkungen sie haben, erfahren Sie hier, wie Sie sie optimal nutzen können.

1. Schreiben Sie detaillierte, spezifische Eingabeaufforderungen

Schwache Eingabeaufforderung:

„Schreiben Sie über den Klimawandel“

Starke Aufforderung:

„Schreiben Sie einen 500-Wörter-Blogbeitrag über die Auswirkungen des Klimawandels auf die globale Nahrungsmittelproduktion. Konzentrieren Sie sich darauf, wie sich steigende Temperaturen auf Ernteerträge und Wasserverfügbarkeit in Afrika südlich der Sahara auswirken. Fügen Sie spezifische Daten für 2024 und Vorhersagen für 2030 hinzu. Verwenden Sie einen professionellen, aber verständlichen Ton für Leser ohne Klimawissenschaftshintergrund.“

Warum es wichtig ist: LLMs sind hervorragend darin, detaillierte Anweisungen zu befolgen. Je spezifischer Ihre Anfrage, desto besser ist das Ergebnis.

2. Nutzen Sie die „Prompt Engineering“-Denkweise

Behandeln Sie Eingabeaufforderungen wie Code – iterieren und verfeinern Sie.

Iterativer Ansatz:

1. Schreiben Sie eine erste Eingabeaufforderung

2. Überprüfen Sie die Ausgabe

3. Identifizieren Sie, was fehlt oder falsch ist

4. Verfeinern Sie die Eingabeaufforderung mit mehr Kontext oder Anweisungen

5. Wiederholen Sie den Vorgang, bis Sie zufrieden sind

Techniken:

– Einige Beispiele: Stellen Sie 2-3 Beispiele für das gewünschte Ausgabeformat bereit

– Rollenspiel: „Sie sind ein erfahrener Finanzberater…“

– Schritt für Schritt: „Denken Sie Schritt für Schritt…“

– Einschränkungen: „Antwort auf weniger als 200 Wörter beschränken …“

3. Überprüfen Sie die tatsächlichen Behauptungen

Verwenden Sie LLM-Ausgaben niemals als grundlegende Wahrheit ohne Überprüfung in Kontexten mit hohem Risiko.

Sichere Anwendungsfälle: Brainstorming, Ideenfindung, Entwurf, Erklärung von Konzepten

Riskante Anwendungsfälle: Zitieren von Statistiken ohne Überprüfung, Treffen medizinischer Entscheidungen, Rechtsberatung

4. Nutzen Sie LLMs als Forschungsbeschleuniger

LLMs sind außergewöhnlich gut darin, Informationen schnell zu synthetisieren.

Workflow:

1. Bitten Sie LLM, ein Thema zu erklären

2. Bitten Sie es, Lücken zu identifizieren

3. Bitten Sie es, gegensätzliche Standpunkte darzulegen

4. Nutzen Sie diese Grundlage, um tiefer zu recherchieren

Beispiel: „Fassen Sie die drei stärksten Argumente für und gegen das universelle Grundeinkommen zusammen, mit den wichtigsten Zitaten.“

5. Nutzen Sie multimodale Fähigkeiten

Moderne LLMs (2026) akzeptieren Bilder und einige akzeptieren Dokumente und Videos.

Nützliche Ansätze:

– Laden Sie einen Screenshot hoch und fragen Sie „Was passiert in diesem Bild?“

– Stellen Sie ein PDF-Dokument bereit und fragen Sie „Fassen Sie die wichtigsten Ergebnisse zusammen“

– Fragen Sie „Analysieren Sie dieses Diagramm und identifizieren Sie Trends“

– Laden Sie ein Foto eines handgeschriebenen Problems hoch und bitten Sie um eine Lösung

6. Verwenden Sie LLMs für die Codegenerierung und das Debugging

LLMs sind außergewöhnliche Programmierassistenten.

Effektive Verwendung:

– „Schreiben Sie eine Python-Funktion, die…“

– „Diesen Code debuggen: [Code einfügen]“

– „Erklären Sie in einfachen Worten, was dieser Code bewirkt“

– „Umgestalten Sie diesen Code für eine bessere Leistung“

– „Komponententests für diese Funktion schreiben“

7. Implementieren Sie die Aufforderung zur Gedankenkette

Bei komplexen Überlegungen bitten Sie das Modell ausdrücklich, Schritt für Schritt zu argumentieren.

Schwach: „Ist diese Investition eine gute Idee?“

Stark: „Analysieren Sie diese Investitionsmöglichkeit Schritt für Schritt und berücksichtigen Sie dabei: (1) potenzielle Renditen, (2) Risikofaktoren, (3) meine Risikotoleranz, (4) Alternativen. Begründen Sie dann Ihre Empfehlung.“

8. Verwenden Sie externe Tools und APIs

Erweitern Sie LLMs mit Funktionen, die ihnen fehlen:

- Rechner für Arithmetik

- Websuch-APIs für aktuelle Informationen

- Datenbankabfragen für aktuelle Fakten

- Codeausführung zur Überprüfung der Codefunktion

- Bildgenerierung für visuelle Inhalte

Dadurch entsteht eine „Argumentationsmaschine“, die viel leistungsfähiger ist als das LLM allein.

9. Modellunterschiede verstehen und richtig wählen

- GPT-5: Maximale Fähigkeiten, Codierung, komplexe Argumentation

- Claude: Genauigkeit, Analyse, langes Schreiben, Sicherheit

- Gemini: Produktivität, Integration mit Google-Tools

- Llama: Kosteneffizienz, Selbsthosting, Kontrolle

Ordnen Sie die Aufgabe dem Modell zu.

10. Implementieren Sie die Versionskontrolle für Ihre Eingabeaufforderungen

Wenn Sie LLMs wiederholt für wichtige Aufgaben verwenden:

– Speichern Sie wirksame Eingabeaufforderungen

– Dokumentieren Sie, was funktioniert und was nicht

– Iterieren Sie Ihre Vorlagen

– Teilen Sie erfolgreiche Eingabeaufforderungen mit Teams

11. Setzen Sie angemessene Erwartungen

LLMs sind:

– ✓ Ideal zum Zeichnen, Brainstorming und Erklären

– ✓ Nützlich zum Schreiben erster Entwürfe

– ✓ Hervorragend zum Erlernen neuer Themen

– ✓ Gut zum Analysieren von Text und Daten

– ✗ Nicht zuverlässig als alleinige Quelle für kritische Fakten

– ✗ Kein Ersatz für Domänenexpertise

– ✗ Nicht unfehlbar im komplexen Denken

12. Lernen Sie die Persönlichkeit Ihres LLM kennen

Jedes Hauptmodell hat unterschiedliche Stärken:

Claude:

– Durchdachte, gründliche Antworten

– Hervorragend darin, Unsicherheit einzugestehen

– Konservative Schätzungen

– Ideal für differenziertes Schreiben

GPT-5:

– Aggressiver/hilfsbereiter im Stil

– Schneller in Mathematik und Logik

– Besser bei sehr langen Kontexten

– Lässigerer Ton

Zwillinge:

– Prägnante, direkte Antworten

– Gut in Echtzeitinformationen

– Hervorragende Suchintegration

– Multimodale Stärken

Testen Sie, welches Modell für Ihren spezifischen Anwendungsfall am besten geeignet ist.

Wichtige Erkenntnis: Die Wirksamkeit von LLM hängt davon ab, wie Sie sie verwenden. Schreiben Sie detaillierte Eingabeaufforderungen, überprüfen Sie wichtige Fakten, nutzen Sie sie als Beschleunigungstools und wählen Sie das richtige Modell für Ihre spezifische Aufgabe.

Die Zukunft von LLMs: Was 2026 und darüber hinaus kommt

Was im Jahr 2026 ankommt

Echte multimodale Integration

– Alle großen LLMs verarbeiten Text, Bilder, Videos und Audio nahtlos in einzelnen Eingabeaufforderungen

– Videoverständnis in Echtzeit (nicht nur statische Bilder)

– Audio-In- und Audio-Out-Gespräch (keine Transkription erforderlich)

– Verständnis und Manipulation von 3D-Modellen

Agentische KI als Standard

– LLMs mit persistentem Speicher über Sitzungen hinweg

– Autonome Aufgabenausführung (Planung, Recherche, Automatisierung)

– Die Verwendung von Tools wird zum Standard (jedes LLM integriert standardmäßig APIs)

– Mehrstufige autonome Arbeitsabläufe ohne menschliches Eingreifen

Verbesserte Genauigkeit

– Die Halluzinationsrate sinkt durch verbesserte Trainingstechniken um 50–70 %.

– Testzeitberechnung (Modelle argumentieren bei schwierigen Problemen stärker)

– Bessere Integration mit Abrufsystemen

– Domänenspezifische, fein abgestimmte Modelle nehmen zu.

Kostensenkungen

– Die Inferenzkosten sinken von derzeit 0,01–0,15 $/mtok auf 0,001–0,01 $/mtok

– Selbstgehostete Open-Source-Modelle werden produktionsbereit

– Kleinere Modelle (50B-100B-Parameter) entsprechen bei vielen Aufgaben Grenzmodellen

– Edge-Bereitstellung wird praktisch

2027 und darüber hinaus: Der längere Horizont

Reasoning-First-Modelle

– Neues Architekturparadigma, das über Transformatoren hinausgeht

– Für lange Argumentationsketten optimierte Modelle

– Mathematische Beweise mit formaler Verifizierung

– Erstellung und Prüfung wissenschaftlicher Hypothesen

Multimodales Lernen im großen Stil

– Modelle, die gleichzeitig auf alle menschlichen Wissenstypen trainiert werden

– Videoverständnis auf fotografischer Ebene

– Verständnis der physikalischen Ursache und Wirkung anhand von Videos

– 3D-Weltverständnis aus 2D-Beobachtungen

Persistentes Gedächtnis und Lernen

– Modelle, die während Gesprächen Wissen ansammeln

– Aus dem Wenig-Schuss-Lernen wird das Einmal-Lernen

– Personalisierte Modelle, die Ihre Vorlieben kennenlernen

– Kontinuierliches Lernen aus Benutzerinteraktionen (ethisch)

Föderierte und datenschutzerhaltende Modelle

– Modelle, die lokal laufen und gleichzeitig global lernen

– Datenschutzorientierte Schulung, bei der keine Rohdaten Ihr Gerät verlassen

– Föderiertes Lernen wird zum Standard

– Verschlüsselungskompatibles maschinelles Lernen

Spezialisierte vs. allgemeine Kompromisse

– Wechsel von einem Riesenmodell zu verschiedenen Spezialmodellen

– Expertenmix wird zur universellen Architektur

– Kleinere, schnellere Modelle für einfache Aufgaben

– Extrem große Modelle für komplexe Überlegungen

– Dynamische Auswahl der zu verwendenden Modelle

Energieeffizienz

– Steigerung der Recheneffizienz um Größenordnungen

– Neuromorphe Computing-Ansätze

– Spezialisierte KI-Hardware wird zur Ware

– Der Energiebedarf für Training und Inferenz sinkt drastisch

Neue Herausforderungen und Fragen

Ausrichtung und Sicherheit

– Je leistungsfähiger die Modelle werden, desto schwieriger wird die Ausrichtung

– Wie stellen wir sicher, dass fortschrittliche KI-Systeme weiterhin nützlich sind?

– Wer kontrolliert die leistungsstärksten Modelle?

Fehlinformationen und Authentizität

– LLMs machen das Erstellen überzeugender Falschinformationen trivial

– Wie bewahren wir das Vertrauen in Informationen?

– Authentifizierung und Herkunft werden entscheidend

Arbeit und Gesellschaft

– Die Arbeitsabläufe von Wissensarbeitern verändern sich grundlegend

– Einige Arbeitsplätze verschwinden; neue Arbeitsplätze entstehen

– Die Gesellschaft muss mit Störungen umsichtig umgehen

– Bildung und Ausbildung werden kontinuierlich

Interpretierbarkeit

– Aktuelle LLMs bleiben Black Boxes

– Wie verstehen wir, wie die leistungsstärksten Modelle funktionieren?

– Können wir interpretierbare Modelle erstellen, die dennoch funktionsfähig sind?

Was Sie jetzt tun sollten

- Beginnen Sie mit dem Experimentieren: Der beste Weg, die Zukunft zu verstehen, besteht darin, diese Tools schon heute zu nutzen

- Fähigkeiten aufbauen: Konzentrieren Sie sich auf Fähigkeiten, die LLMs nicht ersetzen können (Kreativität, Urteilsvermögen, emotionale Intelligenz, Fachwissen)

- Prompt Engineering erlernen: Dies wird zu einer wertvollen beruflichen Fähigkeit

- Verstehen Sie die Einschränkungen: Überschätzen Sie nicht, was auf Sie zukommt. Manche Herausforderungen sind schwieriger als erwartet

- Bleiben Sie auf dem Laufenden: Verfolgen Sie die Entwicklungen von OpenAI, Anthropic, Google, Meta und Open-Source-Communities

Wichtige Erkenntnis: 2026–2027 wird eine weitere rasante Entwicklung erleben: höhere Genauigkeit, geringere Kosten, verbesserte Argumentation und autonome Fähigkeiten. Die LLM-Landschaft entwickelt sich in Richtung spezialisierter Modelle, verbesserter Effizienz und Agentensystemen. Die Zukunft von LLMs ist kein einzelnes superintelligentes Modell – sie ist ein Ökosystem verschiedener zusammenarbeitender KI-Systeme.

FAQ: Ihre Fragen zu LLMs beantwortet

F1: Sind LLMs bewusst oder intelligent?

A: Das ist philosophisch komplex. LLMs zeigen Verhaltensweisen, die dem Verstehen und Denken ähneln, aber sie verfügen nicht über Folgendes:

– Bewusstsein oder subjektive Erfahrung (soweit wir wissen)

– Wahres Verständnis (sie erkennen Muster, keine Bedeutung)

– Anhaltende Ziele oder Wünsche

– Handlungsfähigkeit im philosophischen Sinne

Praktische Antwort: LLMs sind äußerst leistungsstarke Werkzeuge für den Mustervergleich und die Textgenerierung, die zufällig Ergebnisse erzeugen, die einer intelligenten Konversation ähneln. Ob es sich hierbei um „Intelligenz“ handelt, hängt davon ab, wie Sie den Begriff definieren.

F2: Können LLMs Menschen an meinem Arbeitsplatz ersetzen?

A: Hängt von Ihrem Job ab. LLMs sind wahrscheinlich:

Erweitern (nicht ersetzen):

– Softwareentwickler (schnellere Entwicklung)

– Autoren (schnelleres Verfassen)

– Analysten (schnellere Recherche)

– Lehrer (personalisierte Lernwerkzeuge)

– Ärzte (bessere Diagnoseunterstützung)

Kann eventuell ersetzen:

– Kundendienstmitarbeiter (für grundlegende Unterstützung)

– Junior Paralegals (juristische Forschung)

– Dateneingabeoperatoren

– Content-Autoren (einige Arten)

– Übersetzerassistenten

Realität: Die meisten Arbeitsplätze werden durch LLMs erweitert und nicht gestrichen. Die Menschen, die lernen, effektiv mit LLMs zu arbeiten, werden am wertvollsten sein. Ihr Wettbewerbsvorteil besteht darin, dass Sie lernen, diese Tools besser zu nutzen als Alternativen.

Frage 3: Wie genau sind LLMs wirklich?

A: Die Genauigkeit variiert stark je nach Aufgabe:

- Einfache Sachfragen: 75–90 % zutreffend

- Mathematisches Denken:60–85 % genau (schlechter bei der Arithmetik)

- Codegenerierung: 70–95 % genau (abhängig von der Komplexität)

- Kreative Aufgaben: Es gilt keine Genauigkeitsmetrik

- Spezialisierte Domänen: 50–70 % (wenn außerhalb von Trainingsdaten)

Wichtiger Punkt: Sie müssen Ansprüche in Domains mit hohem Risiko überprüfen. LLMs sind selbst dann zuversichtlich, wenn sie falsch liegen.

F4: Wofür werden meine Trainingsdaten verwendet?

A: Dies variiert je nach Anbieter:

OpenAI: Trainingsdaten von GPT Plus und API fließen in zukünftiges Modelltraining ein (sofern Sie sich nicht abmelden)

Anthropic: Claude.ai-Gespräche können überprüft werden, um das Training zu verbessern, es ist jedoch eine ausdrückliche Abmeldung möglich

Google: Gemini-Konversationen können Gemini verbessern, werden jedoch von anderen Google-Diensten getrennt gehalten (mit Datenschutzkontrollen)

Allgemeine Regel: Überprüfen Sie die Datenschutzrichtlinien. Gehen Sie davon aus, dass Gespräche zur Verbesserung genutzt werden können, sofern nicht ausdrücklich anders angegeben.

F5: Woher weiß ich, ob Inhalte von einem LLM geschrieben wurden?

A: Ganz ehrlich? Es wird immer schwieriger. Schlüsselindikatoren:

LLM-generierte Inhalte häufig:

– Hat eine leicht formelhafte Struktur

– Vermeidet starke Meinungen

– Enthält Klischees und überstrapazierte Phrasen

– Verfügt über eine perfekte Grammatik (manchmal zu perfekt)

– Es fehlen konkrete persönliche Beispiele

– Folgt offensichtlichen Umrissmustern

Tests:

– Stellen Sie Folgefragen, die spezifische Kenntnisse erfordern

– Suchen Sie nach sachlichen Fehlern (Halluzinationen)

– Überprüfen Sie ungewöhnliche Randfälle – LLMs übersehen sie oft

– KI-Erkennungstools existieren, sind aber unzuverlässig

Realität: KI-Erkennung ist ein Wettrüsten. Je besser die Modelle werden, desto schwieriger wird die Erkennung.

F6: Ist die Verwendung von LLMs „Schummeln“ in der Schule?

A: Die Gesellschaft ist immer noch dabei, das herauszufinden.

Überlegungen:

– Schreiben von Arbeiten: Die Verwendung von LLMs ohne Offenlegung ist Plagiat (akademische Unehrlichkeit)

– Lerntool: Die Verwendung von LLMs zur Erklärung von Konzepten, die Sie dann synthetisieren, ist Lernen

– Hausaufgaben: Sich vollständig auf LLM-Antworten zu verlassen, verhindert das Lernen

– Brainstorming: LLMs als kreative Partner zu nutzen ist legitim

Best Practice: Überprüfen Sie die KI-Richtlinie Ihrer Institution. Viele Schulen haben inzwischen explizite Richtlinien. Das Erlernen eines ethischen Umgangs mit KI ist an sich schon eine wertvolle Fähigkeit.

F7: Erbringen größere Modelle immer eine bessere Leistung?

A: Nicht immer.

Größere Modelle sind besser in:

– Komplexes Denken

– Bearbeitung vielfältiger Aufgaben

– Nuancen verstehen

– Lange Dokumente

Kleinere Modelle können Folgendes besser leisten:

– Geschwindigkeit (Inferenz in Millisekunden vs. Sekunden)

– Kosten (1/100 des Preises)

– Datenschutz (kann lokal ausgeführt werden)

– Zuverlässigkeit in bestimmten Domänen (sofern fein abgestimmt)

Trend 2026: Die Ära „Größer ist besser“ geht zu Ende. Spezialisierte, fein abgestimmte kleinere Modelle werden zunehmend konkurrenzfähiger. Sie sollten Ihre Auswahl auf der Grundlage Ihrer spezifischen Aufgabe und nicht auf der Grundlage der maximalen Größe treffen.

F8: Wie sollte ich über das Urheberrecht und die Lizenzierung von KI nachdenken?

A: Dies ist rechtlich noch ungewiss, aber hier ist die praktische Anleitung:

Beim Generieren von Inhalten mit LLMs:

– Die von Ihnen generierten Inhalte stehen Ihnen in der Regel zur Nutzung zur Verfügung

– Namensnennung ist nicht immer gesetzlich vorgeschrieben

– Es wird jedoch zunehmend erwartet, dass die Nutzung von KI offengelegt wird

Bei Verwendung von LLM-generiertem Code:

– Achten Sie darauf, welche Lizenz Ihr Modell verwendet

– Open-Source-Modelle haben spezifische Anforderungen

– Möglicherweise gelten Urheberrechtshinweise

Best Practice: Fügen Sie nach Möglichkeit eine Offenlegungserklärung bei. „Dieser Artikel wurde mit KI-Unterstützung verfasst“ wird zum Standard.

F9: Was ist der Unterschied zwischen LLMs und GPT?

A: Häufiges Missverständnis: GPT ist eine bestimmte Modellfamilie (von OpenAI), nicht alle LLMs.

Beziehungen:

– GPT = Spezifische Modellserien von OpenAI (GPT-4, GPT-5, etc.)

– LLM = Kategorie einschließlich GPT, Claude, Zwillinge, Lama usw.

– ChatGPT = Verbraucherschnittstelle zu GPT-Modellen

Zum Beispiel: „Wie ist Kleenex im Vergleich zu Taschentüchern?“ — Kleenex ist eine Marke, Taschentücher sind die Kategorie.

F10: Wie fange ich mit LLMs an, wenn ich Anfänger bin?

A:

Schritt 1: Kostenlos starten

– Kostenlose ChatGPT-Stufe (openai.com)

– Claude (claude.ai) – kostenlos

– Gemini (gemini.google.com) – kostenlos

– Probieren Sie es jeweils eine Woche lang aus

Schritt 2: Verstehen Sie Ihren Anwendungsfall

– Was möchten Sie erreichen?

– Genauigkeit oder Geschwindigkeit wichtiger?

– Budget?

Schritt 3: Upgrade bei Bedarf

– ChatGPT Plus (20 $/Monat) für Power-User-Funktionen

– Claude.ai Plus (20 $/Monat) für ernsthafte Arbeit

– API-Zugriff für Anwendungen

Schritt 4: Lernen Sie Prompt Engineering

– Nehmen Sie an einem kostenlosen Kurs teil (deeplearning.ai)

– Experimentieren Sie mit verschiedenen Aufforderungsstilen

– Treten Sie Communities bei (r/ChatGPT, Anthropic-Foren)

Schritt 5: Einschränkungen verstehen

– Fakten unabhängig überprüfen

– Übertrauen Sie den Ausgaben nicht

– Erfahren Sie, wann Sie LLMs NICHT verwenden sollten

Ressource: Beginnen Sie unter learnai.sk/goto/skool/learnai für umfassende Kurse zu KI-Grundlagen.

Schlussfolgerung

Große Sprachmodelle haben sich von Forschungskuriositäten zu einer wesentlichen Infrastruktur entwickelt. Täglich interagieren Milliarden von Menschen mit ihnen, oft ohne es zu merken. Das Verständnis ihrer Funktionsweise – und vor allem ihrer Grenzen – wird genauso wichtig wie das Verständnis, wie man Suchmaschinen nutzt.

Was wir abgedeckt haben:

– LLMs sagen Text-Tokens mithilfe von Transformatorarchitekturen mit Selbstaufmerksamkeit voraus

– Sie werden durch Vortraining an umfangreichen Textkorpora trainiert und anschließend mithilfe von menschlichem Feedback verfeinert und optimiert

– Die führenden 2026-Modelle (GPT-5, Claude Opus, Gemini 1.5, Llama 4) bedienen unterschiedliche Anwendungsfälle

– Reale Anwendungen umfassen Gesundheitswesen, Recht, Vertrieb, Inhalte, Bildung und Kundenservice

– Kritische Einschränkungen sind Halluzinationen, veraltetes Wissen und mangelndes wirkliches Verständnis

– Die Wirksamkeit hängt davon ab, wie Sie sie durch detaillierte Eingabeaufforderungen und entsprechende Überprüfung einsetzen

– Die Zukunft weist auf multimodale Systeme, Agentenfähigkeiten und verbesserte Genauigkeit hin

Das Fazit: LLMs sind transformative Werkzeuge und kein Ersatz für menschliches Urteilsvermögen. Sie werden am besten als Beschleunigungsinstrumente von Menschen verwendet, die ihre Stärken und Grenzen kennen.

Ganz gleich, ob Sie ein Student sind, der etwas über KI lernt, ein Fachmann, der LLMs für Ihren Arbeitsplatz evaluiert, oder jemand, der sich für die Technologie interessiert, die die Informationsarbeit verändert, die Prinzipien in diesem Leitfaden gelten. Beginnen Sie mit dem Experimentieren, bleiben Sie skeptisch gegenüber den Ergebnissen und konzentrieren Sie sich auf die Erweiterung Ihrer Fähigkeiten, anstatt die Entscheidungsfindung der KI zu überlassen.

Bereit, tiefer einzusteigen? Entdecken Sie strukturierte KI-Kurse unter learnai.sk/goto/skool/learnai, um Fachwissen in den Bereichen maschinelles Lernen, Prompt Engineering und KI-Anwendungen aufzubauen.

Weitere Ressourcen

- OpenAI GPT-Dokumentation

- Anthropic Claude API-Dokumentation

- Google AI-Dokumentation

- Meta-Lama-Dokumentation

- Mistral AI-Dokumentation

- Hugging Face LLM-Kurs

- DeepLearning.AI-Kurzkurse

Wortanzahl: 4.847 Wörter