Herramientas de ingeniería rápidas para la productividad: la guía completa para 2026

⏱ Lectura de 25 minutos · Categoría: Herramientas de IA

La ingeniería rápida ha pasado de ser una habilidad experimental a una competencia empresarial central. En 2026, el 75 % de las empresas que utilizan IA generativa considerarán la gestión rápida como una infraestructura de producción crítica, tan importante como el control de versiones del código o la gestión de bases de datos.

La diferencia de calidad entre un mensaje mal redactado y uno bien diseñado no equivale a un resultado ni un 10 % mejor. Es entre 3 y 5 veces mejor producción por el mismo costo. Los equipos que invierten en herramientas y prácticas de ingeniería rápidas obtienen mucho más valor de las mismas suscripciones a IA.

Esta guía cubre las mejores herramientas de ingeniería de mensajes para la productividad en 2026: desde herramientas individuales que lo ayudan a escribir mejores mensajes hasta plataformas empresariales que administran, versionan y evalúan mensajes a escala.

Tabla de contenidos

- Por qué son importantes las herramientas de ingeniería rápidas

- Categoría 1: Gestión de mensajes y control de versiones

- Categoría 2: Pruebas y evaluaciones inmediatas

- Categoría 3: Plantillas y bibliotecas de avisos

- Categoría 4: Generadores de mensajes visuales

- Categoría 5: Áreas de juego y pruebas de LLM

- Categoría 6: Ingeniería rápida para desarrolladores

- Mejores prácticas de ingeniería rápida para la productividad

- Técnicas avanzadas de indicaciones que funcionarán en 2026

- Tabla comparativa

- Creación de un flujo de trabajo de ingeniería rápido para el equipo

- Preguntas frecuentes

Por qué son importantes las herramientas de ingeniería rápidas

Un mensaje no es solo un texto que escribes en una IA. Es la interfaz principal entre su intención y el resultado del modelo. La diferencia entre una sugerencia bien estructurada y una solicitud casual puede significar:

- Mejora de 3 a 5 veces en la calidad y relevancia de los resultados

- Reducción del tiempo de edición entre un 50% y un 80%

- Resultados consistentes y repetibles entre los miembros del equipo

- Reducción significativa de costos mediante el uso eficiente de tokens

Sin herramientas de ingeniería rápidas, la mayoría de los equipos experimentan:

- “Lotería de IA” — resultados inconsistentes de los mismos tipos de solicitudes

- Silos de conocimiento: las mejores sugerencias se encuentran en la cabeza de una persona o se encuentran dispersas en el historial del chat

- Sin medición: no hay forma de saber si los cambios rápidos realmente mejoraron los resultados

Las herramientas de ingeniería de avisos resuelven estos problemas al tratar los avisos como activos administrados: controlados por versión, comprobables, medibles y compartibles.

Conclusión clave: las herramientas de ingeniería rápidas son para la IA lo que los IDE son para la programación: no cambian lo que es fundamentalmente posible, pero aumentan drásticamente la eficiencia y confiabilidad con la que se logra.

Categoría 1: Gestión de mensajes y control de versiones

Estas herramientas tratan las indicaciones como código: controladas por versión, colaborativas y rastreables hasta resultados específicos.

PromptLayer: la mejor plataforma de observación inmediata

PromptLayer es la plataforma LLMOps líder para equipos que desean una visibilidad completa del rendimiento de sus indicaciones en producción. Registra cada solicitud y respuesta de API, rastrea qué versión de solicitud produjo cada resultado y permite pruebas A/B entre variantes de solicitud.

Capacidades clave:

- Registro de solicitudes: cada mensaje, respuesta, versión del modelo y latencia se rastrean automáticamente

- Control de versiones: etiquetar versiones de solicitudes, comparar el rendimiento, retroceder cuando la calidad disminuye

- Colaboración en equipo: comparta indicaciones entre equipos, deje comentarios y realice un seguimiento de quién cambió qué

- Análisis: identifique qué solicitudes tienen los costos de token más altos, la peor latencia o la mayor cantidad de fallas.

desde la importación de Promptlayer Openai respuesta = openai.ChatCompletion.create( modelo="gpt-5", mensajes=[{"role": "usuario", "contenido": "Escribe una descripción del producto..."}], pl_tags=["descripciones de productos", "v2"] )

- Precios: Gratis para individuos; Equipos $20/usuario/mes

- Ideal para: equipos de desarrollo que envían productos basados en LLM

Langfuse: la mejor gestión de mensajes de código abierto

Langfuse es una plataforma de gestión rápida y observabilidad de LLM de código abierto. Langfuse autohospedado proporciona las mismas funciones principales que PromptLayer sin costo continuo: seguimiento, control de versiones, evaluación y colaboración en equipo.

La API de administración de mensajes de Langfuse le permite actualizar mensajes en producción sin implementar código nuevo, algo fundamental para los equipos que iteran sobre la calidad de los mensajes sin un ciclo de lanzamiento completo.

- Precio: Gratis (autohospedado); Nube desde $49/mes

- Ideal para: equipos de desarrolladores que desean un control total sobre la infraestructura rápida a un coste mínimo

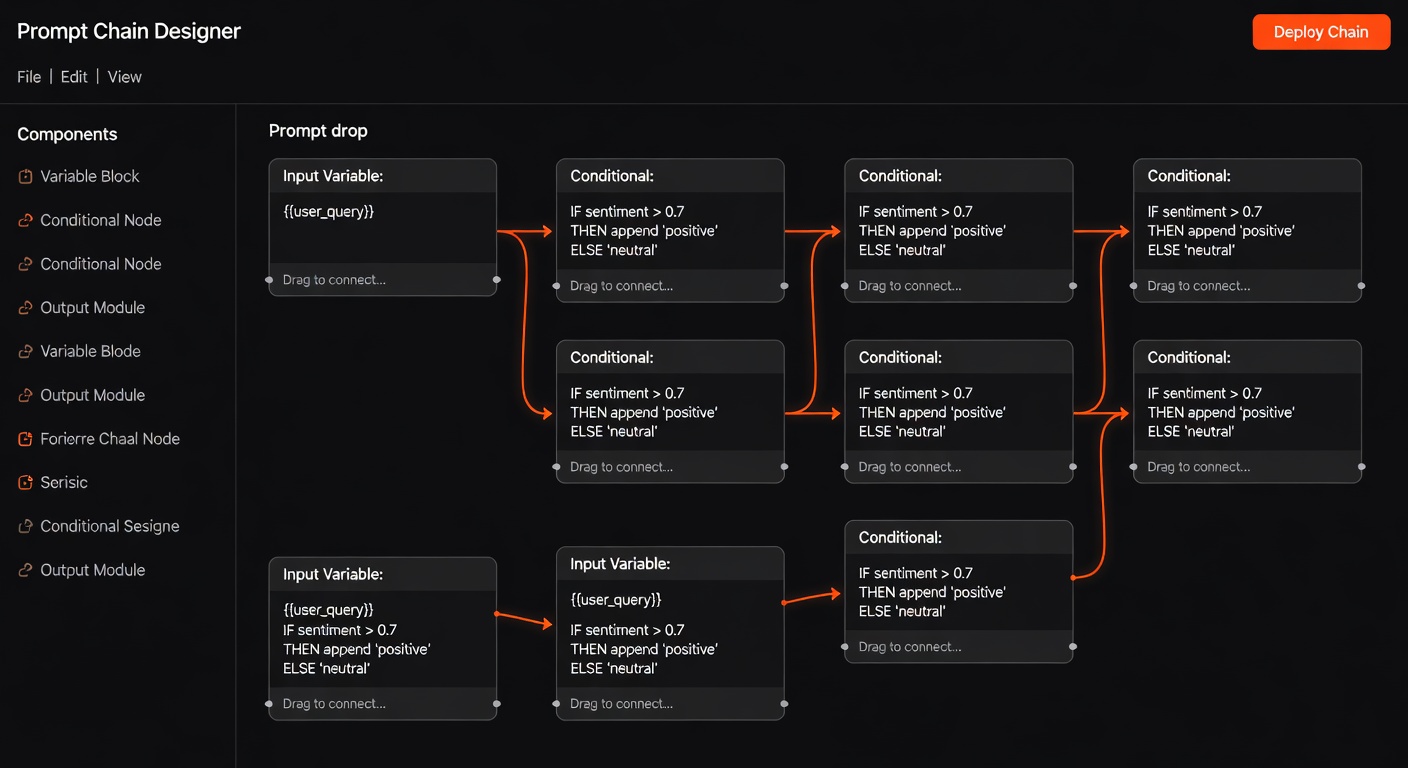

Microsoft PromptFlow (Azure): lo mejor para empresas

PromptFlow es la herramienta gratuita, de código abierto y de bajo código de Microsoft para el desarrollo de aplicaciones LLM. Proporciona encadenamiento de avisos basado en flujo, canales de evaluación e implementación en Azure, lo que lo convierte en la opción natural para las empresas que ya están en el ecosistema de Microsoft.

El generador de flujo visual permite a los gerentes de producto y a quienes no son ingenieros participar en el diseño rápido junto con los desarrolladores, lo que reduce el cuello de botella en los recursos de ingeniería.

- Precio: Gratis (código abierto); Opciones alojadas en Azure disponibles

- Ideal para: equipos empresariales en Azure; gestión del flujo de trabajo de varios pasos

Categoría 2: Pruebas y evaluaciones inmediatas

La calidad rápida sin medición es solo una suposición. Estas herramientas aportan rigor para impulsar la mejora.

Braintrust: la mejor plataforma de evaluación inmediata

Braintrust es una plataforma de evaluación de IA diseñada específicamente. Le permite definir criterios de evaluación (mediante calificadores de IA, calificadores humanos o código personalizado), ejecutar experimentos en diferentes versiones y modelos de indicaciones y realizar un seguimiento de qué combinación produce los mejores resultados.

La idea clave que Braintrust permite: «¿Mi cambio rápido realmente mejoró el resultado?» se convierte en una pregunta empíricamente respondible con datos, en lugar de un juicio subjetivo.

- Precio: Gratis para uso individual; Planes de Teams disponibles

- Ideal para: equipos que buscan calidad rápida y desean tomar decisiones basadas en datos

Evals (OpenAI): lo mejor para equipos OpenAI-First

El marco Evals de OpenAI es una biblioteca de código abierto para evaluar los resultados de LLM. Escriba evaluadores personalizados para sus criterios de calidad específicos, ejecútelos en lotes de finalizaciones y compare el rendimiento entre versiones de solicitudes o versiones de modelos.

- Precio: Gratis (código abierto)

- Ideal para: usuarios de OpenAI que desean una evaluación estructurada sin una plataforma administrada

Evaluación de LangSmith: lo mejor para los usuarios de LangChain

Las funciones de evaluación de LangSmith le permiten crear conjuntos de datos de prueba, ejecutar evaluaciones automáticamente y comparar el rendimiento entre ejecuciones. El nivel gratuito es suficiente para equipos pequeños y evaluación en fase de desarrollo.

- Precio: Nivel gratuito; Desarrollador $39/mes; Más $299/mes

- Ideal para: equipos que utilizan LangChain y desean una evaluación integrada

Categoría 3: Plantillas y bibliotecas de mensajes

En lugar de escribir mensajes desde cero cada vez, los equipos inteligentes crean bibliotecas de mensajes reutilizables.

PromptHub: comunidad para compartir mensajes

PromptHub es una plataforma comunitaria para descubrir, compartir y calificar indicaciones. Encuentre indicaciones de alta calidad para tareas comunes (redacción de contenido, generación de código, servicio al cliente, análisis de datos), adáptelas para su caso de uso y contribuya con las suyas propias.

- Precio: Acceso comunitario gratuito

- Ideal para: Descubrir indicaciones comprobadas; construyendo tu biblioteca inicial

Increíbles mensajes de ChatGPT (GitHub): biblioteca de mensajes gratuita

Uno de los repositorios más destacados de GitHub: una colección seleccionada de indicaciones basadas en roles que mejoran drásticamente los resultados para casos de uso específicos. Actúe como especialista en SEO, abogado, asesor financiero, terminal Linux: cada función es probada por miles de usuarios.

- Precio: Gratis (código abierto)

- Ideal para: crear una biblioteca inicial de indicaciones basadas en roles

FlowGPT: plataforma de descubrimiento rápido

FlowGPT es una plataforma comunitaria específica para indicaciones de IA, con categorías para negocios, escritura creativa, codificación, educación y más. Los mensajes votados a favor muestran las contribuciones de la comunidad de mayor calidad.

- Precio: Gratis

- Ideal para: encontrar indicaciones para tareas específicas; comentarios de la comunidad sobre tus indicaciones

Categoría 4: Creadores de mensajes visuales

Para no desarrolladores que desean diseñar mensajes sofisticados sin escribirlos desde cero.

Dust.tt: el mejor creador de aplicaciones Visual LLM

Dust proporciona una interfaz visual para crear aplicaciones LLM: conecte fuentes de datos, defina cadenas de mensajes e implemente herramientas de inteligencia artificial en su equipo, sin código. El componente de ingeniería de mensajes le permite diseñar y probar mensajes visualmente antes de implementarlos.

- Precio: Nivel gratuito; Equipos desde $29/mes

- Ideal para: equipos de productos que crean herramientas internas de IA sin cuellos de botella para los desarrolladores

Dify: lo mejor para RAG + flujos de trabajo rápidos

El generador de flujo de trabajo de Dify incluye una configuración de mensajes sofisticada: inyección de variables, lógica condicional y pruebas A/B dentro de una interfaz visual. Para los equipos que crean aplicaciones basadas en RAG con cadenas de mensajes complejas, Dify proporciona un entorno visual para gestionar esa complejidad.

- Precio: Gratis (autohospedado); Planes en la nube disponibles

- Ideal para: equipos que crean aplicaciones RAG con una orquestación de indicaciones compleja

Flowise: el mejor creador visual de LangChain

Flowise traduce las cadenas de mensajes basadas en código de LangChain en una interfaz visual de arrastrar y soltar. Diseñe visualmente cadenas de mensajes, sistemas de memoria y agentes mejorados con herramientas y luego pruébelos inmediatamente en la interfaz de chat integrada.

- Precio: Gratis (autohospedado)

- Ideal para: Creación de prototipos visuales de arquitecturas de mensajes de LangChain

Categoría 5: Áreas de juego y pruebas de LLM

Antes de implementar indicaciones en producción, es esencial probarlas en un patio de juegos.

Anthropic Console (Claude) — Mejor parque infantil modelo

La Anthropic Console proporciona un entorno de desarrollo sofisticado para construir con Claude: configuración de indicaciones del sistema, controles de temperatura y muestreo, y comparación en paralelo de diferentes indicaciones del sistema. Para los equipos que crean aplicaciones impulsadas por Claude, la consola es la forma más rápida de iterar el diseño rápido.

- Acceso: console.anthropic.com: cuenta gratuita con créditos API

OpenAI Playground: el entorno de pruebas de LLM más utilizado

OpenAI Playground sigue siendo el entorno más utilizado para probar modelos GPT. Admite la configuración completa de mensajes del sistema, definiciones de funciones y comparación de mensajes en paralelo. El modo de salidas estructuradas en 2026 facilita la prueba de solicitudes que deben producir salidas JSON consistentes.

- Acceso: platform.openai.com/playground: gratis con una cuenta API

Google AI Studio (Gemini): las mejores pruebas multimodales

Google AI Studio proporciona un entorno de prueba gratuito para modelos Gemini, con un sólido soporte para indicaciones multimodales (texto, imágenes y documentos). Las “Instrucciones del sistema” Esta característica le permite diseñar avisos persistentes del sistema que se aplican a lo largo de una conversación.

- Acceso: aistudio.google.com: gratis con una cuenta de Google

TypingMind: el mejor parque infantil multimodelo

TypingMind proporciona una interfaz unificada para probar mensajes en múltiples modelos (GPT-5, Claude, Gemini) con sus propias claves API. La comparación en paralelo de los resultados del modelo para el mismo mensaje facilita identificar qué modelo funciona mejor para su caso de uso específico.

- Precio: $29 por única vez; $9/mes para sincronización en la nube

- Ideal para: equipos que quieran probar indicaciones en varios modelos en una sola interfaz

Categoría 6: Ingeniería rápida para desarrolladores

Herramientas centradas en desarrolladores que integran la gestión rápida en los flujos de trabajo existentes.

LangChain PromptTemplate: lo mejor para desarrolladores de Python

La clase PromptTemplate de LangChain es la forma estándar de crear mensajes parametrizados y reutilizables en Python. Las variables se inyectan en tiempo de ejecución, lo que hace que las indicaciones sean flexibles y comprobables:

desde langchain importar PromptTemplate plantilla = Plantilla de solicitud ( input_variables=["producto", "audiencia", "tono"], template="Escriba una descripción de producto de {tono} para {producto} dirigido a {audiencia}." ) rápido = plantilla.formato(producto="herramienta de escritura de IA", audiencia="gerentes de marketing", tono="profesional")

Este enfoque hace que los mensajes sean ciudadanos de primera clase en su código base: comprobables, con versión controlada con Git y reutilizables en toda su aplicación.

Núcleo semántico (Microsoft): ideal para .NET/Enterprise

El sistema de plantillas de mensajes de Semantic Kernel admite mensajes parametrizados en Python, C# y Java. El concepto de funciones semánticas trata las indicaciones como funciones invocables con entradas y salidas, lo que las hace tan manejables como las funciones de código tradicionales.

Mirascope: biblioteca de mensajes de Python con mejor tipo

Mirascope es una biblioteca de Python escrita que hace que las solicitudes sean seguras para escribir, compatibles con IDE y comprobables. Las indicaciones se definen como clases de Python con entradas escritas, lo que simplifica el análisis estático, el autocompletado y las pruebas.

desde mirascope.core importar openai, fast_template @openai.call("gpt-5") @prompt_template("Recomendar un libro de {género} para {audiencia}") def recomendar_libro(género: str, audiencia: str): ... resultado = recomendar_libro("ciencia ficción", "adultos jóvenes")

- Precio: Gratis (código abierto)

- Ideal para: desarrolladores de Python que desean una gestión de mensajes escritos y comprobables

Mejores prácticas de ingeniería rápida para la productividad

Las herramientas son tan buenas como las técnicas detrás de ellas. Estas son las prácticas que generan mayores ganancias de productividad:

1. Indicaciones basadas en roles

Asignar una función a la IA antes de asignar una tarea mejora drásticamente la calidad y la coherencia del resultado:

En lugar de: “Escribir una publicación de blog sobre herramientas de IA”

Uso:“Usted es un redactor senior de tecnología para una publicación B2B SaaS con 10 años de experiencia. Su estilo de escritura es claro, directo y basado en evidencia. Escribe una publicación de blog de 1000 palabras sobre…”

El contexto del rol activa patrones de conocimiento relevantes en el modelo y limita el estilo de salida de manera más efectiva que las instrucciones explícitas por sí solas.

2. Instigación de cadena de pensamiento

Para tareas complejas, pedirle al modelo que razone paso a paso antes de llegar a una respuesta mejora significativamente la precisión:

Agregue a cualquier pregunta compleja: “Piense en esto paso a paso antes de dar su respuesta final.”

O utilice cadenas de razonamiento explícitas: «Primero, analice el problema». Luego, considere 2 o 3 enfoques. Luego, recomiende el mejor enfoque con una justificación.”

3. Proporcione ejemplos (indicaciones breves)

Incluya 2 o 3 ejemplos de los pares de entrada y salida que desee:

“Aquí hay ejemplos del formato que quiero:

Entrada: [ejemplo 1 entrada]

Salida: [ejemplo 1 salida]

Entrada: [ejemplo 2 entrada]

Salida: [salida del ejemplo 2]

Ahora haz lo mismo para: [tu entrada real]”

Las indicaciones breves son una de las técnicas con mayor retorno de la inversión: comunica la intención con mayor precisión que cualquier cantidad de instrucción descriptiva.

4. Especificación de salida estructurada

Para las salidas de IA que se procesarán mediante programación, especifique el formato exacto:

“Devuelve tu respuesta como un objeto JSON con estos campos exactos:

{ "título": "cadena", "summary": "cadena (máximo 100 palabras)", "etiquetas": ["matriz", "de", "cadenas"], "confianza": "alta|media|baja" }

El uso del modo de salidas estructuradas de OpenAI o el modo JSON de Anthropic aplica este formato a nivel de API.

5. Instrucciones negativas (qué NO hacer)

Declarar explícitamente qué evitar es a menudo tan importante como decir qué hacer:

“NO incluya introducciones genéricas como ‘En el mundo actual…’. NO utilice viñetas. NO agregue una conclusión a menos que agregue nueva información.”

Las instrucciones negativas son particularmente efectivas para restricciones de estilo y formato.

6. Ajuste de temperatura y parámetros

Temperatura más baja (0,0–0,3) para resultados objetivos y consistentes (extracción de datos, clasificación, generación de códigos). Temperatura más alta (0,7–1,0) para resultados creativos y variados (lluvia de ideas, escritura creativa, generación de ideas).

La mayoría de los casos de uso de productividad se benefician de temperaturas más bajas: la coherencia es más importante que la variedad para las aplicaciones empresariales.

Técnicas avanzadas de indicaciones que funcionarán en 2026

Instigación constitucional

Defina las reglas que la IA debe seguir a lo largo de su respuesta: una “constitución” incrustado en el indicador del sistema. Útil para la voz de la marca, los requisitos de cumplimiento y las limitaciones éticas.

Ejemplo de adición de mensajes al sistema: “Siempre debes seguir estas reglas: [1] Nunca hagas predicciones financieras específicas. [2] Siempre cite fuentes para afirmaciones objetivas. [3] Mantenga un tono profesional pero cálido.”

Indicación aumentada de recuperación

Inyecte dinámicamente contexto relevante desde su base de conocimientos en mensajes en tiempo de ejecución. El mensaje se convierte en: instrucciones del sistema + contexto recuperado + consulta del usuario. Este patrón mejora drásticamente la precisión objetiva de las preguntas de dominios específicos sin necesidad de realizar ajustes.

Refinamiento recursivo

Utilice la IA para mejorar los resultados de la IA: primero genere un borrador y luego solicite al modelo que lo critique y lo mejore. “Revise el siguiente texto e identifique 3 formas de mejorarlo: [texto]. Luego reescríbelo incorporando esas mejoras.”

Este patrón produce constantemente resultados de mayor calidad que la generación de una sola pasada.

Generación Paralela + Selección

Genere múltiples resultados simultáneamente (a través de llamadas API paralelas) y use un segundo mensaje para seleccionar el mejor. Particularmente útil para tareas creativas donde la variación entre los resultados es alta y uno de ellos probablemente sea excelente.

Tabla comparativa

| Herramienta | Categoría | Mejor para | Precios |

|---|---|---|---|

| CapaPrompt | Gestión | Registro y control de versiones rápidos | Gratis / $20/usuario/mes |

| Langfuse | Gestión | Operaciones rápidas de código abierto | Gratis (autohospedado) |

| Flujo de aviso | Gestión | Gestión de avisos empresariales de Azure | Gratis (código abierto) |

| Confianza intelectual | Evaluación | Mejora de avisos basada en datos | Individual gratuito |

| LangSmith | Evaluación | Evaluación rápida de LangChain | Nivel gratuito |

| Consola Antrópica | Parque infantil | Prueba rápida de Claude | Gratis con API |

| Patio de juegos OpenAI | Parque infantil | Prueba rápida de GPT | Gratis con API |

| PromptHub | Biblioteca | Descubriendo mensajes probados | Gratis |

| Dificar | Constructor visual | RAG + diseño visual del flujo de trabajo rápido | Gratis (autohospedado) |

| Mirascopio | Desarrollador | Gestión de mensajes de Python escritos | Gratis |