Outils d’ingénierie Prompt pour la productivité : le guide complet 2026

⏱ 25 minutes de lecture · Catégorie : Outils d’IA

L’ingénierie Prompt est passée d’une compétence expérimentale à une compétence métier de base. En 2026, 75 % des entreprises utilisant l’IA générative considèrent la gestion des invites comme une infrastructure de production critique, aussi importante que le contrôle des versions de code ou la gestion des bases de données.

L’écart de qualité entre une invite mal rédigée et une invite bien conçue ne représente pas un résultat supérieur de 10 %. C’est un rendement 3 à 5 fois supérieur pour le même coût. Les équipes qui investissent dans des outils et des pratiques d’ingénierie rapides tirent considérablement plus de valeur des mêmes abonnements à l’IA.

Ce guide couvre les meilleurs outils d’ingénierie d’invites pour la productivité en 2026 : des outils individuels qui vous aident à rédiger de meilleures invites, aux plates-formes d’entreprise qui gèrent, versionnent et évaluent les invites à grande échelle.

Table des matières

- Pourquoi les outils d’ingénierie Prompt sont-ils importants ?

- Catégorie 1 : Gestion des invites et gestion des versions

- Catégorie 2 : Tests et évaluations rapides

- Catégorie 3 : Modèles d’invite et bibliothèques

- Catégorie 4 : Générateurs d’invites visuelles

- Catégorie 5 : Terrains de jeu et tests LLM

- Catégorie 6 : Ingénierie rapide pour les développeurs

- Bonnes pratiques d’ingénierie rapides pour la productivité

- Techniques d’invite avancées qui fonctionnent en 2026

- Tableau de comparaison

- Créer un workflow d’ingénierie d’invite d’équipe

- FAQ

Pourquoi les outils d’ingénierie Prompt sont importants

Une invite n’est pas simplement un texte que vous tapez à une IA. Il s’agit de l’interface principale entre votre intention et la sortie du modèle. La différence entre une invite bien structurée et une demande informelle peut signifier :

- Amélioration de 3 à 5 fois de la qualité et de la pertinence des résultats

- Réduction de 50 à 80 % du temps de modification

- Des résultats cohérents et reproductibles entre les membres de l’équipe

- Réduction significative des coûts grâce à une utilisation efficace des jetons

Sans outils d’ingénierie rapides, la plupart des équipes sont confrontées :

- “Loterie IA” — sorties incohérentes des mêmes types de requêtes

- Silos de connaissances : les meilleures invites se trouvent dans la tête d’une seule personne ou sont dispersées dans l’historique des discussions

- Aucune mesure – aucun moyen de savoir si des changements rapides ont réellement amélioré les résultats

Les outils d’ingénierie d’invites résolvent ces problèmes en traitant les invites comme des actifs gérés : contrôlés en version, testables, mesurables et partageables.

À retenir : les outils d’ingénierie Prompt sont à l’IA ce que les IDE sont à la programmation : ils ne changent pas ce qui est fondamentalement possible, mais ils augmentent considérablement l’efficacité et la fiabilité avec lesquelles vous y parvenez.

Catégorie 1 : Gestion des invites et gestion des versions

Ces outils traitent les invites comme du code : contrôlé en version, collaboratif et traçable jusqu’à des sorties spécifiques.

PromptLayer – Meilleure plateforme d’observabilité des invites

PromptLayer est la plate-forme LLMOps leader pour les équipes qui souhaitent une visibilité complète sur le fonctionnement de leurs invites en production. Il enregistre chaque demande et réponse d’API, suit quelle version d’invite a produit quelle sortie et permet des tests A/B entre les variantes d’invite.

Capacités clés :

- Journalisation des requêtes : chaque invite, réponse, version de modèle et latence est automatiquement suivie

- Gestion des versions des invites : baliser les versions des invites, comparer les performances, revenir en arrière lorsque la qualité diminue

- Collaboration en équipe : partagez des invites entre les équipes, laissez des commentaires et suivez qui a modifié quoi.

- Analyses : identifiez les invites présentant les coûts de jetons les plus élevés, la pire latence ou le plus grand nombre d’échecs.

à partir de l'importation de promptlayer openai

réponse = openai.ChatCompletion.create(

modèle="gpt-5",

messages=[{"role": "user", "content": "Ecrire une description de produit..."}],

pl_tags=["descriptions-produits", "v2"]

)

- Tarifs : gratuit pour les particuliers ; Équipes 20 $/utilisateur/mois

- Idéal pour : les équipes de développement qui expédient des produits basés sur LLM

Langfuse – Meilleure gestion des invites Open Source

Langfuse est une plateforme d’observabilité et de gestion des invites LLM entièrement open source. Langfuse auto-hébergé fournit les mêmes fonctionnalités de base que PromptLayer sans aucun coût permanent : traçage, gestion des versions des invites, évaluation et collaboration en équipe.

L’API de gestion des invites Langfuse vous permet de mettre à jour les invites en production sans déployer de nouveau code, ce qui est essentiel pour les équipes itérant sur la qualité des invites sans cycle de publication complet.

- Tarifs : gratuit (auto-hébergé) ; Cloud à partir de 49 $/mois

- Idéal pour : les équipes de développeurs souhaitant un contrôle total sur l’infrastructure rapide à un coût minime

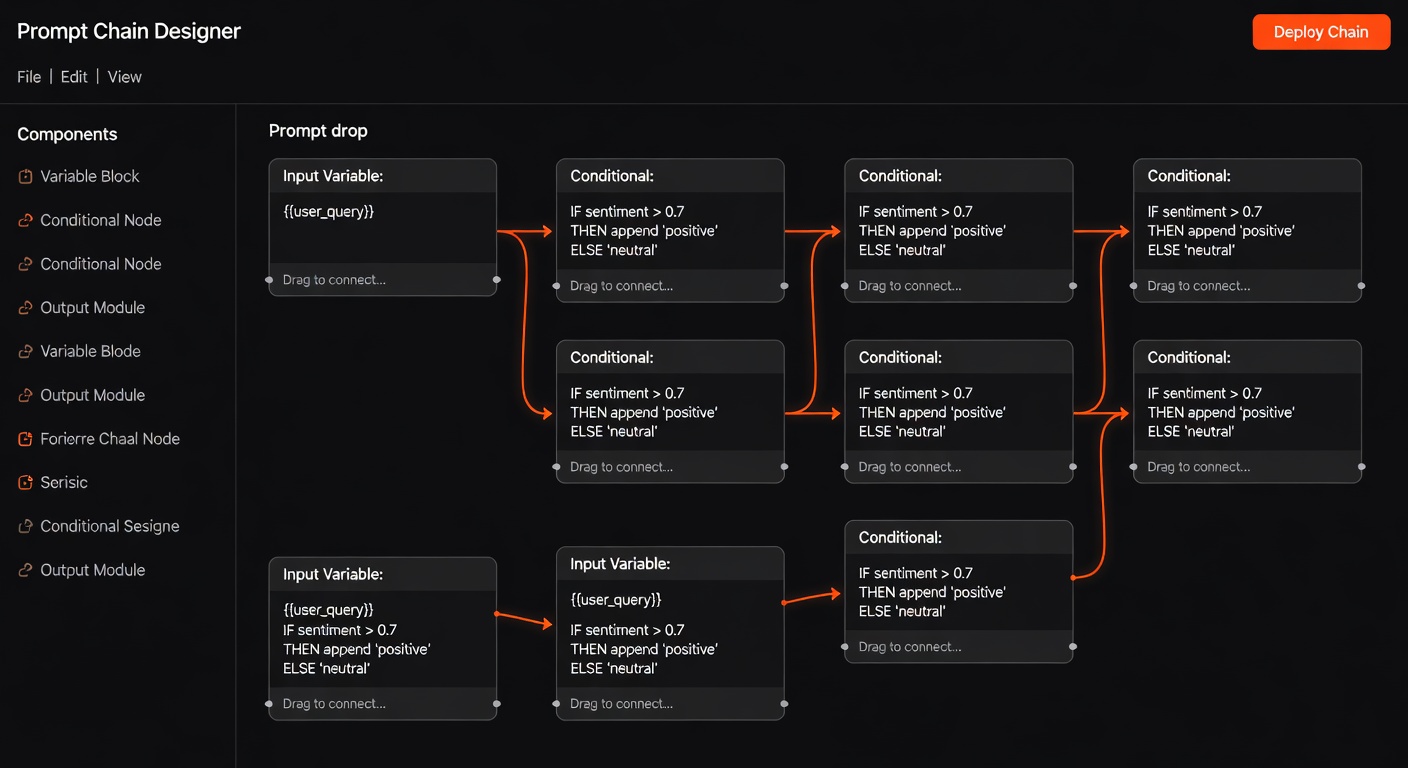

Microsoft PromptFlow (Azure) – Idéal pour les entreprises

PromptFlow est l’outil low-code, open source et gratuit de Microsoft pour le développement d’applications LLM. Il fournit un chaînage d’invites basé sur des flux, des pipelines d’évaluation et un déploiement sur Azure, ce qui en fait le choix naturel pour les entreprises déjà présentes dans l’écosystème Microsoft.

Le générateur de flux visuel permet aux chefs de produit et aux non-ingénieurs de participer à une conception rapide aux côtés des développeurs, réduisant ainsi le goulot d’étranglement des ressources d’ingénierie.

- Tarifs : gratuit (open source) ; Options hébergées sur Azure disponibles

- Idéal pour : les équipes d’entreprise sur Azure ; gestion de flux de travail rapide en plusieurs étapes

Catégorie 2 : Tests et évaluations rapides

La qualité rapide sans mesure n’est qu’une supposition. Ces outils apportent de la rigueur pour une amélioration rapide.

Braintrust – Meilleure plateforme d’évaluation rapide

Braintrust est une plateforme d’évaluation de l’IA spécialement conçue. Il vous permet de définir des critères d’évaluation (à l’aide d’évaluateurs IA, d’évaluateurs humains ou de code personnalisé), d’exécuter des expériences sur différentes versions et modèles d’invite, et de suivre quelle combinaison produit les meilleurs résultats.

L’information clé que Braintrust permet : “Mon changement rapide a-t-il réellement amélioré le rendement ?” devient une question à laquelle il est possible de répondre empiriquement avec des données, plutôt qu’un jugement subjectif.

- Tarifs : gratuit pour un usage individuel ; Forfaits Teams disponibles

- Idéal pour : les équipes qui itèrent sur une qualité rapide et qui souhaitent des décisions basées sur les données

Évaluations (OpenAI) – Idéal pour les équipes OpenAI-First

Le framework Evals d’OpenAI est une bibliothèque open source permettant d’évaluer les résultats du LLM. Écrivez des évaluateurs personnalisés pour vos critères de qualité spécifiques, exécutez-les sur des lots de réalisations et comparez les performances entre les versions d’invite ou les versions de modèle.

- Tarifs : gratuit (open source)

- Idéal pour : les utilisateurs d’OpenAI souhaitant une évaluation structurée sans plate-forme gérée

Évaluation LangSmith – Idéale pour les utilisateurs de LangChain

Les fonctionnalités d’évaluation de LangSmith vous permettent de créer des ensembles de données de test, d’exécuter des évaluations automatiquement et de comparer les performances entre les exécutions. Le niveau gratuit est suffisant pour les petites équipes et l’évaluation en phase de développement.

- Tarifs : niveau gratuit ; Développeur 39 $/mois ; Plus 299 $/mois

- Idéal pour : les équipes utilisant LangChain qui souhaitent une évaluation intégrée

Catégorie 3 : Modèles d’invites et bibliothèques

Au lieu d’écrire des invites à partir de zéro à chaque fois, les équipes intelligentes créent des bibliothèques d’invites réutilisables.

PromptHub – Communauté de partage d’invites

PromptHub est une plateforme communautaire permettant de découvrir, de partager et d’évaluer des invites. Trouvez des invites de haute qualité pour les tâches courantes (rédaction de contenu, génération de code, service client, analyse de données), adaptez-les à votre cas d’utilisation et apportez les vôtres.

- Tarifs : accès gratuit à la communauté

- Idéal pour : découvrir des invites éprouvées ; construire votre bibliothèque initiale

Invites ChatGPT géniales (GitHub) – Bibliothèque d’invites gratuite

L’un des référentiels les plus appréciés sur GitHub : une collection organisée d’invites basées sur des rôles qui améliorent considérablement les résultats pour des cas d’utilisation spécifiques. Agissez en tant que spécialiste du référencement, avocat, conseiller financier, terminal Linux : chaque invite de rôle est testée par des milliers d’utilisateurs.

- Tarifs : gratuit (open source)

- Idéal pour : Créer une bibliothèque de départ d’invites basées sur les rôles

FlowGPT – Plateforme de découverte d’invites

FlowGPT est une plate-forme communautaire spécifiquement destinée aux invites d’IA, avec des catégories pour les affaires, l’écriture créative, le codage, l’éducation et bien plus encore. Les invites votées positivement font apparaître les contributions de la communauté de la plus haute qualité.

- Tarifs : gratuit

- Idéal pour : rechercher des invites pour des tâches spécifiques ; commentaires de la communauté sur vos invites

Catégorie 4 : Générateurs d’invites visuelles

Pour les non-développeurs qui souhaitent concevoir des invites sophistiquées sans les écrire à partir de zéro.

Dust.tt — Meilleur générateur d’applications visuelles LLM

Dust fournit une interface visuelle pour créer des applications LLM : connectez des sources de données, définissez des chaînes d’invites et déployez des outils d’IA pour votre équipe, sans code. Le composant d’ingénierie des invites vous permet de concevoir et de tester visuellement les invites avant de les déployer.

- Tarifs : niveau gratuit ; Équipes à partir de 29 $/mois

- Idéal pour : les équipes produit qui créent des outils d’IA internes sans goulots d’étranglement des développeurs

Dify – Idéal pour les flux de travail RAG + invites

Le générateur de flux de travail de Dify inclut une configuration d’invite sophistiquée : injection de variables, logique conditionnelle et tests A/B dans une interface visuelle. Pour les équipes qui créent des applications basées sur RAG avec des chaînes d’invites complexes, Dify fournit un environnement visuel pour gérer cette complexité.

- Tarifs : gratuit (auto-hébergé) ; Forfaits cloud disponibles

- Idéal pour : les équipes qui créent des applications RAG avec une orchestration d’invites complexe

Flowise — Meilleur générateur visuel de LangChain

Flowise traduit les chaînes d’invites basées sur le code de LangChain en une interface visuelle glisser-déposer. Concevez visuellement des chaînes d’invites, des systèmes de mémoire et des agents améliorés par des outils, puis testez-les immédiatement dans l’interface de discussion intégrée.

- Tarifs : gratuit (auto-hébergé)

- Idéal pour : le prototypage visuel des architectures d’invite LangChain

Catégorie 5 : Terrains de jeux et tests LLM

Avant de déployer des invites en production, il est essentiel de les tester dans un terrain de jeu.

Anthropic Console (Claude) — Meilleur modèle de terrain de jeu

La console Anthropic fournit un environnement de développement sophistiqué pour construire avec Claude : configuration des invites du système, contrôles de la température et de l’échantillonnage, et comparaison côte à côte des différentes invites du système. Pour les équipes qui créent des applications basées sur Claude, la console constitue le moyen le plus rapide d’itérer sur la conception d’invites.

- Accès : console.anthropic.com – compte gratuit avec crédits API

OpenAI Playground – Environnement de test LLM le plus utilisé

L’OpenAI Playground reste l’environnement le plus utilisé pour tester les modèles GPT. Il prend en charge la configuration complète des invites du système, les définitions de fonctions et la comparaison des invites côte à côte. Le mode de sorties structurées en 2026 facilite le test des invites qui doivent produire des sorties JSON cohérentes.

- Accès : platform.openai.com/playground — gratuit avec compte API

Google AI Studio (Gemini) – Meilleurs tests multimodaux

Google AI Studio fournit un environnement de test gratuit pour les modèles Gemini, avec une forte prise en charge des invites multimodales (texte + images + documents). Les « Instructions système » La fonctionnalité vous permet de concevoir des invites système persistantes qui s’appliquent à toute une conversation.

- Accès : aistudio.google.com — gratuit avec un compte Google

TypingMind – Meilleur terrain de jeu multimodèle

TypingMind fournit une interface unifiée pour tester les invites sur plusieurs modèles (GPT-5, Claude, Gemini) avec vos propres clés API. La comparaison côte à côte des résultats du modèle pour la même invite permet d’identifier facilement quel modèle fonctionne le mieux pour votre cas d’utilisation spécifique.

- Tarif : 29 $ une fois ; 9 $/mois pour la synchronisation dans le cloud

- Idéal pour : les équipes souhaitant tester des invites sur plusieurs modèles dans une seule interface

Catégorie 6 : Ingénierie rapide pour les développeurs

Des outils destinés aux développeurs qui intègrent la gestion des invites dans les flux de travail existants.

Modèle d’invite LangChain – Idéal pour les développeurs Python

La classe PromptTemplate de LangChain est le moyen standard de créer des invites paramétrées et réutilisables en Python. Les variables sont injectées au moment de l’exécution, ce qui rend les invites flexibles et testables :

à partir de Langchain import PromptTemplate

modèle = InviteTemplate (

input_variables=["produit", "audience", "ton"],

template="Rédigez une description de produit {ton} pour {produit} ciblant {audience}."

)

prompt = template.format(product="outil d'écriture IA", audience="responsables marketing", ton="professional")

Cette approche crée des invites de premier ordre dans votre base de code : testables, contrôlées en version avec Git et réutilisables dans votre application.

Noyau sémantique (Microsoft) – Idéal pour .NET/Enterprise

Le système de modèles d’invites de Semantic Kernel prend en charge les invites paramétrées en Python, C# et Java. Le concept des fonctions sémantiques traite les invites comme des fonctions appelables avec des entrées et des sorties, ce qui les rend aussi gérables que les fonctions de code traditionnelles.

Mirascope — Meilleure bibliothèque d’invites Python typées

Mirascope est une bibliothèque Python typée qui rend les invites sécurisées, compatibles avec l’IDE et testables. Les invites sont définies sous forme de classes Python avec des entrées typées, ce qui facilite l’analyse statique, la saisie semi-automatique et les tests.

à partir de mirascope.core import openai, prompt_template

@openai.call("gpt-5")

@prompt_template("Recommander un livre de {genre} pour {audience}")

def recommande_book(genre : str, public : str) : ...

résultat = recommande_book("science-fiction", "jeunes adultes")

- Tarifs : gratuit (open source)

- Idéal pour : les développeurs Python souhaitant une gestion des invites typées et testables

Bonnes pratiques d’ingénierie rapides pour la productivité

Les outils sont aussi efficaces que les techniques qui les sous-tendent. Voici les pratiques qui génèrent les gains de productivité les plus importants :

1. Invites basées sur les rôles

Attribuer un rôle à l’IA avant de confier une tâche améliore considérablement la qualité et la cohérence du résultat :

Au lieu de : “Écrivez un article de blog sur les outils d’IA”

Utiliser :« Vous êtes rédacteur technologique senior pour une publication B2B SaaS avec 10 ans d’expérience. Votre style d’écriture est clair, direct et fondé sur des preuves. Écrivez un article de blog de 1 000 mots sur …”

Le contexte de rôle active des modèles de connaissances pertinents dans le modèle et contraint le style de sortie plus efficacement que les seules instructions explicites.

2. Invite de chaîne de pensée

Pour les tâches complexes, demander au modèle de raisonner étape par étape avant d’arriver à une réponse améliore considérablement la précision :

Ajoutez à toute invite complexe : “Réfléchissez à cela étape par étape avant de donner votre réponse finale.”

Ou utilisez des chaînes de raisonnement explicites : “Tout d’abord, analysez le problème. Ensuite, envisagez 2 à 3 approches. Ensuite, recommandez la meilleure approche avec justification.”

3. Fournir des exemples (invite de quelques tirs)

Incluez 2 à 3 exemples de paires d’entrées-sorties souhaitées :

“Voici des exemples du format que je souhaite :

Entrée : [exemple 1 entrée]

Sortie : [exemple 1 sortie]

Entrée : [exemple 2 d’entrée]

Sortie : [exemple 2 de sortie]

Maintenant, faites la même chose pour : [votre entrée réelle]” ;

Les invites à quelques tirs sont l’une des techniques à retour sur investissement le plus élevé : elles communiquent l’intention plus précisément que n’importe quelle quantité d’instructions descriptives.

4. Spécification de sortie structurée

Pour les sorties AI qui seront traitées par programme, spécifiez le format exact :

“Renvoyez votre réponse sous forme d’objet JSON avec ces champs exacts :

{

"titre": "chaîne",

"summary": "chaîne (max 100 mots)",

"tags": ["tableau", "de", "chaînes"],

"confidence": "élevé|moyen|faible"

}

L’utilisation du mode de sorties structurées d’OpenAI ou du mode JSON d’Anthropic applique ce format au niveau de l’API.

5. Instructions négatives (ce qu’il ne faut PAS faire)

Déclarer explicitement ce qu’il faut éviter est souvent aussi important que dire quoi faire :

“N’incluez PAS d’introductions génériques telles que « Dans le monde d’aujourd’hui ». N’utilisez PAS de puces. N’ajoutez PAS de conclusion à moins qu’elle n’ajoute de nouvelles informations.”

Les instructions négatives sont particulièrement efficaces pour les contraintes de style et de format.

6. Réglage de la température et des paramètres

Température plus basse (0,0 – 0,3) pour des résultats factuels et cohérents (extraction de données, classification, génération de code). Température plus élevée (0,7 à 1,0) pour des résultats créatifs et variés (brainstorming, écriture créative, génération d’idées).

La plupart des cas d’utilisation de productivité bénéficient de températures plus basses : la cohérence compte plus que la variété pour les applications professionnelles.

Techniques d’incitation avancées qui fonctionnent en 2026

Invitation constitutionnelle

Définissez les règles que l’IA doit suivre tout au long de sa réponse : une « constitution » ; intégré dans l’invite du système. Utile pour la voix de la marque, les exigences de conformité et les contraintes éthiques.

Exemple d’ajout d’invite système : “Vous devez toujours suivre ces règles : [1] Ne faites jamais de prévisions financières spécifiques. [2] Citez toujours des sources pour les affirmations factuelles. [3] Gardez un ton professionnel mais chaleureux.”

Invite de récupération augmentée

Injectez dynamiquement le contexte pertinent de votre base de connaissances dans les invites au moment de l’exécution. L’invite devient : instructions système + contexte récupéré + requête utilisateur. Ce modèle améliore considérablement la précision factuelle pour les questions spécifiques à un domaine sans ajustement précis.

Raffinement récursif

Utilisez l’IA pour améliorer les résultats de l’IA : générez d’abord un brouillon, puis invitez le modèle à le critiquer et à l’améliorer. « Examinez le texte suivant et identifiez 3 façons de l’améliorer : [texte]. Ensuite, réécrivez-le en intégrant ces améliorations.”

Ce modèle produit systématiquement une sortie de meilleure qualité que la génération en un seul passage.

Génération parallèle + sélection

Générez plusieurs sorties simultanément (via des appels d’API parallèles) et utilisez une deuxième invite pour sélectionner la meilleure. Particulièrement utile pour les tâches créatives où la variance entre les résultats est élevée et l’un d’entre eux est probablement excellent.

Tableau de comparaison

| Outil | Catégorie | Meilleur pour | Tarif |

|---|---|---|---|

| Couche d’invite | Gestion | Journalisation rapide et gestion des versions | Gratuit / 20 $/utilisateur/mois |

| Langfuse | Gestion | Opérations d’invite open source | Gratuit (auto-hébergé) |

| PromptFlow | Gestion | Gestion des invites Azure Enterprise | Gratuit (open source) |

| Braintrust | Évaluation | Amélioration des invites basées sur les données | Individuel gratuit |

| LangSmith | Évaluation | Évaluation de l’invite LangChain | Niveau gratuit |

| Console Anthropique | Aire de jeux | Test d’invite Claude | Gratuit avec API |

| OpenAI Playground | Aire de jeux | Test des invites GPT | Gratuit avec API |

| PromptHub | Bibliothèque | Découverte d’invites éprouvées | Gratuit |

| Modifier | Constructeur visuel | RAG + conception visuelle du flux de travail rapide | Gratuit (auto-hébergé) |

| Mirascope | Développeur | Gestion des invites Python typées | Gratuit |

Créer un workflow d’ingénierie d’invite d’équipe

Étape 1 : Créer une bibliothèque d’invites

Créez un référentiel partagé de vos invites les plus performantes. Commencez par 10 à 15 invites couvrant vos tâches d’IA les plus courantes. Utilisez Langfuse ou PromptLayer pour les héberger, ou un simple Notion pour les équipes non techniques.

Étape 2 : Standardisez votre format d’invite

Définissez une structure cohérente pour toutes les invites d’équipe :

[RÔLE] : Vous êtes un [description]

[CONTEXTE] : [Contexte pertinent]

[TACHE] : [Instruction spécifique]

[FORMAT] : [Structure de sortie]

[CONTRAINTES] : [Ce qu'il faut éviter]

[EXEMPLES] : [1-2 exemples d'entrée-sortie]

Ce format rend les invites analysables, déboguables et améliorables.

Étape 3 : Contrôle de version et tests

Chaque modification d’invite doit être versionnée et testée par rapport à un ensemble d’entrées de référence avant de remplacer la version précédente. Cela évite les « régressions rapides » ; où un changement bien intentionné réduit en fait la qualité du résultat.

Étape 4 : Partager et améliorer

Les invites doivent être des actifs partagés et non des connaissances individuelles. Planifiez des sessions mensuelles d’examen rapide au cours desquelles les membres de l’équipe partagent ce qui fonctionne, ce qui ne fonctionne pas et proposent des améliorations. Les meilleures invites s’améliorent grâce à l’itération collective.

Étape 5 : Mesurer la qualité de manière cohérente

Définissez des mesures de qualité pour chaque type d’invite (précision, conformité du format, ton, longueur) et évaluez les nouvelles versions d’invite par rapport à ces mesures. Même un simple système d’évaluation humaine (1 à 5 étoiles sur un échantillon de résultats) vaut mieux que pas de mesure.

FAQ

Quelle est la différence entre l’ingénierie des invites et la gestion des invites ?

L’ingénierie des invites consiste à créer des invites efficaces : rédiger, tester et améliorer le texte pour obtenir les meilleurs résultats à partir des modèles d’IA. La gestion rapide est l’infrastructure opérationnelle permettant de réaliser cela à grande échelle : gestion des versions, tests A/B, surveillance et collaboration. Les deux sont importants ; la plupart des discussions les confondent.

Les compétences en ingénierie rapide deviennent-elles obsolètes à mesure que les modèles d’IA s’améliorent ?

L’ingénierie des invites évolue mais ne devient pas obsolète. Les modèles plus performants répondent à de meilleures invites : le plafond monte, mais la compétence reste précieuse. Ce qui devient obsolète, ce sont des techniques spécifiques qui reposent sur les limitations du modèle (par exemple, la chaîne de pensée est devenue moins nécessaire à mesure que o1/o3 a ajouté un raisonnement natif). De nouvelles techniques apparaissent. La méta-compétence consistant à savoir communiquer avec précision avec les systèmes d’IA reste précieuse en permanence.

Combien de temps faut-il pour apprendre l’ingénierie rapide ?

La maîtrise de base nécessite 1 à 2 semaines de pratique délibérée. Devenir efficace de manière fiable dans une gamme de types d’invites prend 1 à 3 mois. Les techniques avancées (évaluation, amélioration systématique, chaînes complexes) nécessitent 6 à 12 mois pour être maîtrisées. La plateforme learnAI propose des parcours d’apprentissage structurés pour chaque niveau.

Quel est l’investissement d’ingénierie rapide avec le retour sur investissement le plus élevé pour un non-développeur ?

Créer une bibliothèque d’invites personnelle pour vos 5 à 10 tâches d’IA les plus courantes. Passez 2 heures à créer et affiner des invites pour la rédaction de vos e-mails, vos recherches, la rédaction de rapports et la préparation de réunions. Des invites bien conçues pour ces tâches permettent de gagner 30 à 60 minutes par jour, ce qui représente des centaines d’heures par an.

Puis-je utiliser les mêmes invites avec différents modèles d’IA ?

La plupart du temps, oui, mais chaque modèle possède des atouts différents et des styles d’invite optimaux. Claude réagit bien aux instructions détaillées et au contexte basé sur les rôles. GPT-5 bénéficie d’exigences de format spécifiques. Gemini gère particulièrement bien le contexte multimodal. Le test de vos invites clés sur plusieurs modèles révèle quel modèle est le mieux adapté à chaque tâche.

Quels outils les ingénieurs professionnels utilisent-ils ?

La plupart des professionnels utilisent une combinaison de : LLM Playgrounds (Anthropic Console, OpenAI Playground) pour le développement initial, PromptLayer ou Langfuse pour la gestion de la production, Braintrust ou LangSmith pour l’évaluation, et une combinaison de Notion/GitHub pour les bibliothèques d’invites d’équipe. Python + LangChain ou Mirascope pour la gestion des invites intégrée au code.

Conclusion

Les outils d’ingénierie Prompt sont passés de curiosités expérimentales à une infrastructure de niveau production. Les équipes qui traitent les invites comme des ressources gérées et dont les versions sont contrôlées obtiennent des résultats IA considérablement plus cohérents et de meilleure qualité que celles qui traitent chaque invite comme une interaction ponctuelle avec une zone de texte.

Les outils de ce guide couvrent tout le spectre : depuis les terrains de jeu gratuits pour l’expérimentation individuelle jusqu’aux plates-formes de gestion d’entreprise pour les équipes qui expédient des produits d’IA. Commencez par les terrains de jeu pour développer votre intuition, ajoutez une bibliothèque d’invites au fur et à mesure que vos meilleures invites s’accumulent, et passez aux plateformes de gestion lorsque votre équipe a besoin de cohérence et d’observabilité.

Pour un programme complet sur l’ingénierie rapide, du niveau débutant à avancé, visitez la communauté learnAI — où l’ingénierie rapide est l’un des sujets les plus actifs.

Pour le contexte technique sur la façon d’intégrer la gestion des invites dans votre flux de développement d’IA, consultez le guide des Outils de stratégie d’IA pour les développeurs.

Prêt à apprendre l’IA ? Rejoignez la communauté learnAI → communauté learnAI Skool

Ingénierie rapide pour des cas d’utilisation métier spécifiques

Différentes fonctions métier ont des exigences différentes en matière d’invite. Voici des approches optimisées pour les tâches d’invite métier les plus courantes :

Invites par e-mail et communication

Le courrier électronique constitue le cas d’utilisation d’invites le plus répandu pour la plupart des travailleurs du savoir. Un flux de travail optimisé pour les invites par e-mail :

Invite système : “Vous êtes un expert en communication professionnelle. Rédigez des e-mails directs, professionnels et orientés vers l’action. N’utilisez jamais de phrases de remplissage inutiles. Chaque e-mail doit avoir un objet clair, une déclaration d’objectif en une seule phrase, un contexte pertinent, une demande ou une action spécifique, et une étape suivante claire.

Modèle d’invite de tâche : “Écrivez un e-mail à [destinataire/rôle] à propos de [sujet]. Mon point principal est [message clé]. L’action dont j’ai besoin de leur part est [demande spécifique]. Le ton doit être [formel/amical/urgent]. Incluez [tous les détails spécifiques].”

Avec cette structure en deux parties, les brouillons d’e-mails nécessitent 2 à 3 minutes de modification au lieu de 15 à 20 minutes de rédaction.

Invite à la recherche de contenu et à la synthèse

Pour les travailleurs du savoir qui ont besoin de synthétiser des informations provenant de plusieurs sources :

Invite de résumé de recherche : « Je vais vous donner [nombre] sources sur [sujet]. Synthétisez les points clés dans un résumé structuré. Format : 1) Principaux résultats du consensus, 2) Principaux désaccords ou tensions, 3) Lacunes dans les connaissances actuelles, 4) Informations les plus exploitables pour [votre rôle/contexte]. Voici les sources : [coller les sources]”

Cette invite produit systématiquement une synthèse qui prendrait des heures à écrire manuellement.

Invite à l’analyse des données et à la création de rapports

Pour les utilisateurs professionnels analysant des données sans compétences approfondies en SQL ou Python :

Invite d’analyse des données : “J’ai un ensemble de données avec ces colonnes : [noms et descriptions des colonnes]. Je veux comprendre [question commerciale]. Recherchez : [des modèles, tendances ou anomalies spécifiques]. Formatez votre analyse comme : 1) Constatation clé en une phrase, 2) Points de données justificatifs, 3) Explications potentielles, 4) Actions recommandées.” ;

Remarque : Vérifiez toujours l’analyse des données générées par l’IA par rapport aux données réelles avant d’agir sur celles-ci.

Modèles de communication client

Pour les équipes en contact avec les clients qui génèrent des communications personnalisées à grande échelle :

Invite du modèle d’e-mail client : “Écrivez un e-mail de [type : bienvenue/suivi/réengagement] pour un client qui [contexte client]. Ils ont [produit/service]. Leur objectif principal est [objectif]. Préoccupation à résoudre : [préoccupation, le cas échéant]. Ton : [chaleureux/professionnel]. Longueur : [court/moyen]. Incluez : [éléments spécifiques comme une offre, un lien ou un CTA].”

Créer une bibliothèque d’invites de communication client et les exécuter avec des variables spécifiques au client via Zapier ou n8n crée une sensibilisation personnalisée à grande échelle.

Outils d’ingénierie rapides pour des rôles spécifiques

Pour les spécialistes du marketing

Meilleurs outils : Claude.ai + PromptHub (pour découvrir les invites marketing) + Jasper (pour une exécution cohérente avec la marque)

Invites essentielles à développer :

- Invite d’expansion de la brève campagne

- Générateur de variantes de contenu publicitaire

- Créateur de publications sur les réseaux sociaux (pour chaque plate-forme)

- Générateur de briefs SEO à partir d’un mot clé

- Testeur de ligne d’objet d’e-mail

Pour les développeurs

Meilleurs outils : Curseur + Copilote GitHub + Console Anthropic + Mirascope

Invites essentielles à développer :

- Invite de la liste de contrôle de révision du code

- Générateur de documentation technique

- Explication du bug et invite de correction

- Générateur de tests unitaires

- Invite de révision de l’architecture

Pour les équipes commerciales

Meilleurs outils : Clay + Apollo + ChatGPT Team + PromptLayer pour les invites de séquence

Invites essentielles à développer :

- Synthétiseur de recherches prospectives

- Générateur de lignes d’ouverture personnalisées

- Cadre de réponse aux objections

- Invite de préparation de l’appel de découverte

- Générateur de sections de proposition

Pour les RH et les opérations

Meilleurs outils : Claude + Notion AI + Zapier AI

Invites essentielles à développer :

- Rédacteur de descriptions de poste

- Générateur de questions d’entretien par rôle

- Modèle d’évaluation des performances

- Rédacteur de documents stratégiques

- Générateur d’ordre du jour de réunion à partir des objectifs

Mesures d’invite : comment mesurer la qualité des invites

La plupart des équipes ne mesurent jamais leurs invites. Les équipes qui réussissent surpassent systématiquement celles qui ne le font pas. Voici un cadre de mesure pratique :

Niveau de qualité (1 à 5 par dimension) :

- Précision : le résultat contient-il des informations correctes ?

- Pertinence : répond-il à la demande réelle ?

- Conformité du format : suit-il la structure spécifiée ?

- Cohérence du ton : correspond-il à la voix souhaitée ?

- Exhaustivité : couvre-t-il tous les éléments requis ?

Mesures d’efficacité :

- Durée moyenne de modification par résultat (avant et après l’amélioration rapide)

- Nombre de jetons par rapport à la qualité de sortie (obtenez-vous de la valeur par jeton ?)

- Taux d’acceptation au premier essai (% de résultats utilisés sans modification significative)

Suivez-les pour connaître vos cinq invites les plus utilisées. Améliorez d’abord les dimensions les moins performantes. Même 5 minutes de mesure par semaine génèrent une amélioration continue.

Pour les équipes utilisant PromptLayer ou Langfuse, ces métriques peuvent être suivies automatiquement avec des marqueurs personnalisés, éliminant ainsi entièrement la charge de mesure manuelle.

Créer une culture d’ingénierie rapide à l’échelle de l’entreprise

Les compétences individuelles d’intervention se multiplient lorsqu’elles deviennent des capacités organisationnelles. Voici comment étendre l’ingénierie rapide au-delà des praticiens individuels :

Le modèle de champion rapide

Désignez un champion de l’incitation par département : quelqu’un qui apprend en profondeur l’incitation et forme ses collègues. Donnez-leur 2 heures/semaine pour améliorer la bibliothèque d’invites de l’équipe. La plupart des départements constatent des gains de productivité de 20 à 30 % en 60 jours avec ce modèle.

Gouvernance rapide pour les fonctions sensibles

Pour les fonctions pour lesquelles les résultats de l’IA pourraient créer un risque de non-conformité (juridique, financier, communications RH), établissez des processus de révision :

- Toutes les invites pour les fonctions sensibles examinées par le chef du service

- Les résultats de l’IA pour les communications à enjeux élevés examinés par un humain avant l’envoi

- Audits réguliers des performances rapides pour vérifier l’exactitude et la conformité

Intégration rapide des nouveaux employés

Incluez une ingénierie rapide lors de l’intégration de vos employés. Les nouvelles recrues qui apprennent la bibliothèque d’invites de votre entreprise dès le premier jour sont immédiatement productives avec les outils d’IA, plutôt que de passer des semaines à développer des invites qui existent déjà.

Créez un cours « Prompt Engineering 101 » ; guide spécifique à votre entreprise : les 20 principales invites utilisées par votre équipe, les normes de formatage que vous suivez et les modèles les mieux adaptés à chaque type de tâche.

Mesurer la productivité de l’IA au sein du département

Avec des outils de gestion rapide en place, vous pouvez mesurer la productivité de l’IA au niveau de l’équipe :

- Total des résultats assistés par l’IA par semaine (suivis via PromptLayer ou Langfuse)

- Réduction moyenne du temps d’édition par rapport à la référence avant l’IA

- Invites les plus performantes par taux d’acceptation

Ces données vous permettent d’identifier les cas d’utilisation de l’IA à plus forte valeur ajoutée au sein de l’entreprise et d’orienter les investissements en conséquence.

Les organisations qui considéreront 2026 comme l’année où elles ont acquis un avantage concurrentiel durable sont celles qui investissent dès maintenant dans ces capacités d’ingénierie rapide et systématique – pas seulement dans les outils, mais dans la culture et les flux de travail qui les entourent.

Les aspects économiques d’un investissement rapide en ingénierie

L’ingénierie Prompt est l’un des investissements les plus rentables disponibles pour les travailleurs du savoir et les entreprises. Le calcul est convaincant :

ROI individuel : un travailleur du savoir qui passe 2 heures à améliorer ses invites principales gagne 30 à 60 minutes par jour. À un coût moyen total de 50 $/heure, cela représente une économie de 25 à 50 $ par jour, soit entre 6 250 et 12 500 $ par an pour un investissement de deux heures.

ROI de l’équipe : une équipe de 10 personnes investissant 10 heures collectivement dans une bibliothèque d’invites partagée, formée par un champion, fait gagner à chaque membre 20 minutes par jour. Pour un coût global de 75 $/heure pour 10 personnes : 125 $ d’économie par jour – 31 250 $ par an sur un investissement unique de 10 heures.

ROI du produit : pour une équipe qui expédie un produit basé sur LLM, la qualité rapide a un impact direct sur la fidélisation des utilisateurs. Une amélioration de 3 x de la qualité des résultats (réalisable grâce à une ingénierie rapide et systématique) peut doubler la rétention – une amélioration radicale par rapport à quelques centaines d’heures de travail d’ingénierie rapide.

Le défi n’est pas la question du retour sur investissement : c’est que l’investissement semble intangible par rapport à l’embauche ou à l’infrastructure. Mais les retours composés d’une bibliothèque d’invites bien gérée dépassent presque tout autre investissement dans le travail du savoir disponible en 2026.

Action immédiate : choisissez les cinq invites d’IA les plus utilisées. Passez 1 heure à améliorer chacun d’entre eux en utilisant les techniques de ce guide. Mesurez le gain de temps sur la semaine prochaine. Les données plaideront mieux que n’importe quel argument en faveur d’une ingénierie systématique et rapide.