KI-Strategietools für Entwickler

Wenn Sie als Entwickler herausfinden möchten, wo KI in Ihren Arbeitsablauf, Ihre Karriere oder Ihr Unternehmen passt, kann die schiere Anzahl an Tools und Frameworks lähmend wirken. Jede Woche gibt es ein neues Modell, ein neues SDK, ein neues Schlagwort. Die eigentliche Herausforderung besteht nicht darin, auf KI zuzugreifen, sondern darin, zu wissen, wie man sie strategisch nutzt, um wichtige Dinge zu entwickeln und damit Geld zu verdienen.

Dieser Leitfaden durchbricht den Lärm. Wir haben die führenden KI-Strategietools für Entwickler überprüft und verglichen – von Modell-APIs und Agent-Frameworks bis hin zu No-Code-Buildern und Überwachungsplattformen. Egal, ob Sie KI-gestützte Produkte entwickeln, Ihre eigenen Arbeitsabläufe automatisieren oder sich als KI-Experte positionieren, hier finden Sie die Tools und die Strategie.

Was bedeutet „KI-Strategie“? Mittel für Entwickler?

Bevor wir uns mit Tools befassen, klären wir zunächst, was wir unter KI-Strategie im Entwicklerkontext verstehen.

KI-Strategie besteht nicht nur darin, das heißeste Modell auszuwählen oder ein Tutorial zu kopieren. Es bedeutet:

- Wissen, welche KI-Funktionen für Ihr spezifisches Problem gelten

- Auswahl von Tools, die Kosten, Geschwindigkeit und Qualität für Ihren Anwendungsfall in Einklang bringen

- Bauen Sie skalierbare Systeme – keine einmaligen Experimente

- Verstehen, wie KI in ein größeres Produkt oder Geschäftsmodell passt

- Auf dem Laufenden bleiben, ohne jedem Trend hinterherzulaufen

Entwickler, die KI strategisch einsetzen, sind diejenigen, die höher bezahlte Verträge abschließen, Produkte schneller liefern und passive Einkommensquellen aufbauen. Die folgenden Tools sind nach ihrer Rolle in einer praktischen KI-Strategie geordnet.

Kategorie 1: Foundation Model APIs

Der Ausgangspunkt jeder KI-Strategie ist der Zugriff auf ein leistungsfähiges Sprachmodell. Hier sehen Sie den Vergleich der großen Anbieter.

OpenAI (GPT-5, GPT-5.3 Instant, o3)

Am besten geeignet für: Allzwecktext, Codegenerierung, Funktionsaufrufe, strukturierte Ausgaben

Das aktuelle Flaggschiff von OpenAI ist GPT-5 – ein deutlicher Sprung gegenüber GPT-4o, mit modernster Leistung bei Codierung, Mathematik und multimodalen Aufgaben und etwa 80 % weniger Halluzinationen als o3, wenn das Denken aktiviert ist. Für alltägliche geschwindigkeitskritische Aufgaben ist GPT-5.3 Instant das Standardmodell. o3 und o3-pro sind nach wie vor die erste Wahl für tiefgründige Überlegungen und machen bei komplexen realen Aufgaben 20 % weniger Fehler als o1. Die GPT-5.3-Codex-Variante ist das derzeit leistungsfähigste Agentencodierungsmodell, das verfügbar ist.

- Preise: Die GPT-5-Preise variieren je nach Stufe. GPT-5.3 Instant ist das kostenoptimierte Alltagsmodell

- Stärken: Zuverlässigkeit, riesiges Ökosystem, Tool-/Funktionsaufruf, Agentencodierung mit Codex

- Schwächen: Die schnelle Versionierung macht es schwierig, ein stabiles Modell langfristig zu sichern

- Strategische Eignung: Am besten für Produktionsanwendungen geeignet, die maximale Zuverlässigkeit und umfassende Funktionalität erfordern

Anthropisch (Claude Opus 4.6, Sonett 4.6, Haiku 4.5)

Am besten geeignet für: Langer Kontext, Argumentation, sicherheitsrelevante Anwendungen, Dokumentenverarbeitung

Die aktuelle Produktpalette von Anthropic wird von Claude Opus 4.6 (veröffentlicht im Februar 2026) angeführt, das GPT-5.2 bei GDPval-AA um ~144 Elo-Punkte übertrifft und in der Beta über ein 1-Millionen-Token-Kontextfenster verfügt. Claude Sonnet 4.6ist für die meisten Benutzer der neue Standard – er schließt die Lücke zu Opus deutlich und bleibt gleichzeitig äußerst kosteneffektiv. Claude Haiku 4.5 bleibt eines der schnellsten und günstigsten Modelle überhaupt. Alle Modelle zeichnen sich durch saubere Spezifikationen für den Werkzeuggebrauch und eine hervorragende Befolgung der Anweisungen aus.

- Preise: Claude Haiku 4.5 ist mit 0,25 $/1 Mio. Input-Token äußerst wettbewerbsfähig

- Stärken: 1M-Token-Kontext (Opus), hervorragende Dokumentenanalyse, differenzierte Anleitungsverfolgung

- Schwächen: Kleineres Drittanbieter-Ökosystem als OpenAI

- Strategische Passform: Ideal für dokumentenintensive Pipelines, RAG-Systeme oder komplexe mehrstufige Workflows

Google Gemini (3.1 Pro, 3.1 Flash Lite)

Am besten geeignet für: Multimodale Aufgaben, Google Workspace-Integration, Verarbeitung großer Mengen

Googles aktuelles Flaggschiff ist Gemini 3.1 Pro (veröffentlicht im Februar 2026) mit starker multimodaler Argumentation in Text, Bildern, Audio und Video. Für kostensensible Workloads ist Gemini 3.1 Flash Lite (veröffentlicht im März 2026) bemerkenswert leistungsfähig – der Preis beträgt nur 0,25 $/1 Mio. Eingabe-Tokens, es ist 2,5-mal schneller als sein Vorgänger und übertrifft GPT-5 mini und Claude Haiku 4.5 in mehreren Benchmarks und unterstützt gleichzeitig ein 1 Mio. Token-Kontextfenster.

- Preise: Gemini 3.1 Flash Lite für 0,25 $/1 Mio. Input- und 1,50 $/1 Mio. Output-Token

- Stärken: Riesiges Kontextfenster, multimodal, ultraschnelle Flash Lite-Stufe, Google-Ökosystem

- Schwächen: API-Ökosystem holt immer noch zu OpenAI auf

- Strategische Eignung: Hervorragend geeignet für medienreiche, durchsatzstarke oder kostensensible Pipelines

Meta Llama 4 (über Groq, Together AI, Ollama)

Am besten geeignet für: Kostensensible Anwendungen, Bereitstellung vor Ort, Feinabstimmung

Llama 4 ist Metas aktuelle Aufstellung mit offenem Gewicht. Llama 4 Scout (17 Milliarden aktive Parameter, 16 Experten) passt auf eine einzelne H100-GPU und bietet ein branchenführendes 10-M-Token-Kontextfenster. Llama 4 Maverick (17B aktive Parameter, 128 Experten) schlägt GPT-4o und Gemini 2.0 Flash in wichtigen Benchmarks und bleibt dabei völlig offen. Beide sind von Natur aus multimodal. Wenn Sie sie über Groq ausführen, erhalten Sie nahezu sofortige Schlussfolgerungen. Die lokale Ausführung über Ollama bedeutet keine API-Kosten.

- Preise: Kostenlose lokale Ausführung; Die Preise für die KI-Cloud von Groq/Together sind sehr wettbewerbsfähig

- Stärken: Offene Gewichtungen, nativ multimodal, 10 Mio. Kontext (Scout), vollständig feinabstimmbar, kein Datenverlust

- Schwächen: Erfordert GPU-Infrastruktur zum Selbsthosten in großem Maßstab

- Strategische Eignung: Am besten geeignet für datenschutzorientierte Anwendungen, großvolumige Aufträge, bei denen die Kosten im Vordergrund stehen, und Teams, die vollständige Modellkontrolle wünschen

Kategorie 2: AI Agent Frameworks

Wenn ein einzelner LLM-Aufruf ein Hammer ist, ist ein AI-Agent-Framework ein vollständiges Toolkit. Dies sind die Plattformen und Bibliotheken, mit denen Sie mehrstufige, autonome KI-Workflows erstellen können.

LangChain

Das am weitesten verbreitete Open-Source-Framework zum Erstellen von LLM-Anwendungen. LangChain bietet Abstraktionen für Ketten, Agenten, Speicher und Werkzeugnutzung. Es lässt sich in praktisch jede wichtige Modell- und Vektordatenbank integrieren.

- Sprache: Python & JavaScript

- Am besten geeignet für: Rapid Prototyping, Lernen, RAG-Pipelines

- Achten Sie auf: Abstraktionskomplexität; kann in der Produktion unhandlich werden; häufige Bruchänderungen

- Strategische Nutzung: Verwenden Sie LangChain, um schnell Prototypen zu erstellen. Wechseln Sie zu einfacherem Code, sobald Ihre Architektur klar ist

LangGraph

LangGraph basiert auf LangChain und fügt ein graphbasiertes Ausführungsmodell für komplexe Agenten mit Zyklen, Verzweigungen und Zustandspersistenz hinzu. Es ist die erste Wahl für Multi-Agent-Systeme in Produktionsqualität.

- Am besten geeignet für: Multi-Agent-Workflows, Human-in-the-Loop-Systeme, zustandsbehaftete Agenten

- Warum es wichtig ist:Die meisten echten KI-Produkte benötigen mehr als eine lineare Kette – sie benötigen Verzweigungslogik und die Fähigkeit zum Zurückschleifen

- Strategische Verwendung: Wenn Ihr Agent „überdenken“ muss; Durch mehrere Schritte oder arbeiten Sie mit anderen Agenten zusammen, LangGraph ist Ihr Framework

AutoGen (Microsoft)

Mit AutoGen können mehrere KI-Agenten miteinander kommunizieren, um komplexe Aufgaben zu erledigen. Ein Agent könnte Code schreiben; ein anderer rezensiert es; ein Drittel führt Tests durch. Es eignet sich besonders gut für Codierungsassistenten und Recherchetools.

- Am besten geeignet für: Zusammenarbeit mit mehreren Agenten, automatisierte Codegenerierung und -überprüfung

- Stärken: Starke Tools für Anwendungsfälle von Entwicklern; gut darin, komplexe Aufgaben aufzuschlüsseln

- Strategische Verwendung: Hervorragend geeignet für interne Entwicklertools oder Produkte, bei denen die Codegenerierung im Mittelpunkt steht

CrewAI

CrewAI ist ein übergeordnetes Framework für Multiagentensysteme mit Schwerpunkt auf rollenbasierten Agenten, die in „Crews“ organisiert sind. Es ist eigensinniger als LangGraph und schneller einsatzbereit.

- Am besten geeignet für: Produkte schnell herstellen; nicht ingenieurfreundliche Agenten-Orchestrierung

- Stärken: Schnell zum Prototyp; lesbare Codestruktur; aktive Community

- Strategische Verwendung: Verwenden Sie diese Option, wenn Sie schnell versenden möchten. Ziehen Sie LangGraph in Betracht, wenn Sie mehr Kontrolle benötigen

Vercel AI SDK

Für JavaScript-/TypeScript-Entwickler, die Webanwendungen erstellen, ist das Vercel AI SDK die sauberste Möglichkeit, Antworten zu streamen, Toolaufrufe zu verarbeiten und KI in Next.js und andere Frontend-Frameworks zu integrieren.

- Am besten geeignet für: Web-App-Entwickler; Streaming-Benutzeroberflächen; Next.js-Integration

- Strategische Nutzung: Wenn Ihr Produkt über eine Chat-Schnittstelle oder eine KI-gestützte Benutzeroberfläche verfügt, ist dies die ergonomischste Option im JS-Ökosystem

Kategorie 3: Vektordatenbanken und RAG-Infrastruktur

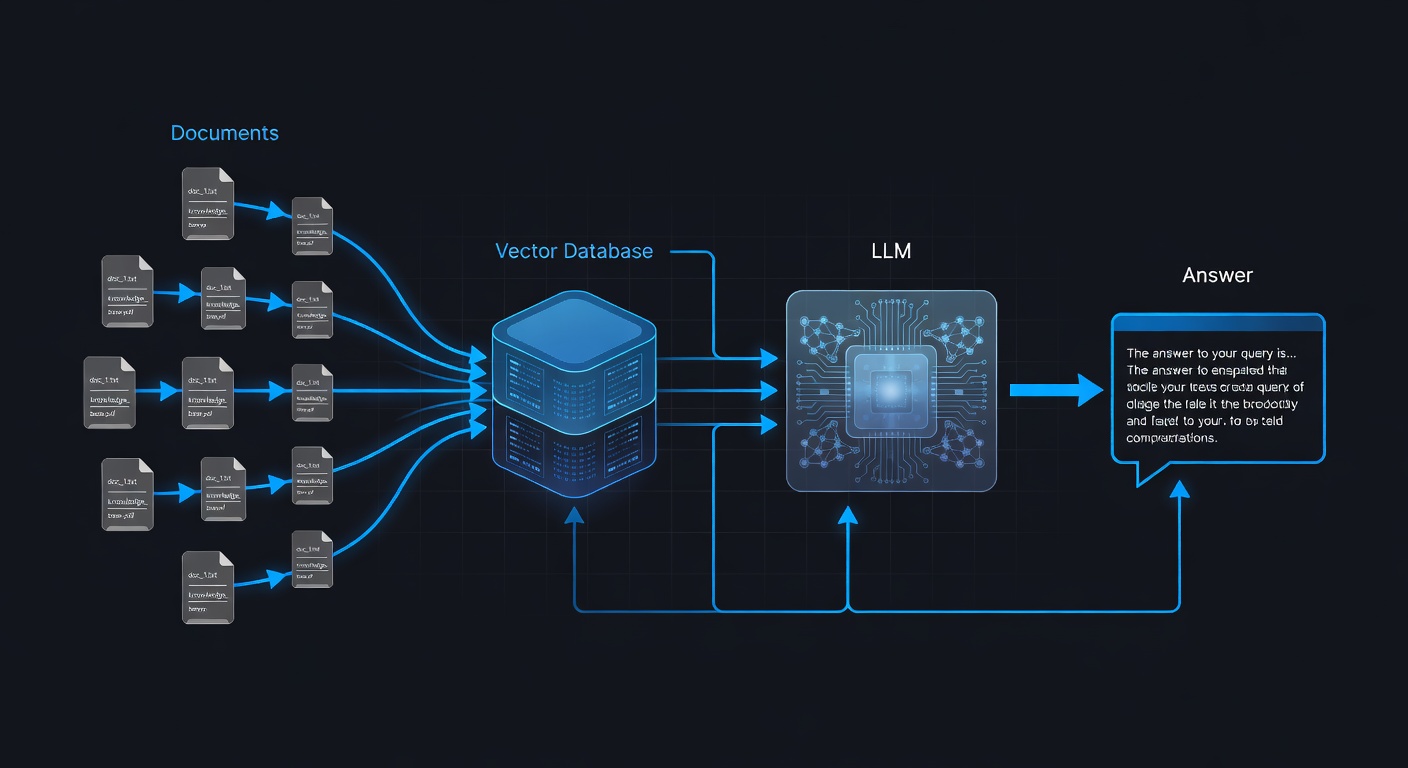

Retrieval-Augmented Generation (RAG) ist die Architektur, die es KI ermöglicht, Fragen basierend auf Ihren eigenen Daten zu beantworten. Eine Vektordatenbank ist das Rückgrat jedes RAG-Systems.

Tannenzapfen

Die ausgereifteste verwaltete Vektordatenbank. Pinecone übernimmt die Indizierung, Abfrage und Skalierung, ohne dass Sie die Infrastruktur verwalten müssen. Es lässt sich problemlos in LangChain, LlamaIndex und die meisten Agent-Frameworks integrieren.

- Preise: Kostenloses Kontingent verfügbar; beginnt mit der Skalierung bei 70 $/Monat für die Produktion

- Am besten geeignet für: Produktions-RAG-Systeme, bei denen Sie die Infrastruktur nicht verwalten möchten

- Strategische Nutzung: Wenn Sie ein Produkt mit RAG als Kern entwickeln, können Sie sich mit Pinecone auf die Anwendungsebene konzentrieren

Weaviate

Eine Open-Source-Vektordatenbank mit hervorragender integrierter Hybridsuche (Kombination von Semantik und Schlüsselwortsuche). Kann selbst gehostet oder als verwalteter Cloud-Dienst verwendet werden.

- Am besten geeignet für: Hybridsuche, Mandantenfähigkeit, komplexe Filterung

- Strategische Verwendung: Gute Wahl, wenn Sie sowohl eine semantische als auch eine Schlüsselwortsuche benötigen oder wenn Selbsthosting wichtig ist

Chroma

Die einfachste Möglichkeit für den Einstieg. Chroma ist eine leichte Open-Source-Vektordatenbank, die im Speicher ausgeführt oder auf der Festplatte gespeichert wird. Ideal für Entwicklung und Kleinserienproduktion.

- Am besten geeignet für: Lernen, Prototyping, kleine Apps

- Strategische Nutzung: Beginnen Sie hier; Migrieren Sie zu Pinecone oder Weaviate, wenn Ihre Daten skalieren

Supabase pgvector

Wenn Sie bereits Postgres verwenden (z. B. über Supabase), ermöglicht Ihnen pgvector die Vektorsuche, ohne einen weiteren Dienst hinzuzufügen. Gut genug für die meisten Apps, die nicht über Millionen von Vektoren verfügen.

- Am besten geeignet für: Bestehende Postgres-Benutzer; Den Stapel einfach halten

- Strategische Nutzung: Wenn Sie Supabase oder Postgres nutzen, ist dies der reibungsärmste Weg zu RAG

Kategorie 4: KI-Beobachtbarkeit und -Bewertung

Einer der am meisten übersehenen Aspekte der KI-Strategie besteht darin, zu wissen, ob Ihr System tatsächlich funktioniert. Observability-Tools helfen Ihnen, Ihre KI-Produkte im Laufe der Zeit zu überwachen, zu debuggen und zu verbessern.

LangSmith

LangChains Observability-Plattform. LangSmith verfolgt jeden Schritt in Ihrer Kette oder Ihrem Agenten, zeigt Token-Nutzung, Latenz und Fehler an und ermöglicht Ihnen die Durchführung von Auswertungen anhand von Testdatensätzen.

- Am besten geeignet für: Teams, die LangChain/LangGraph verwenden

- Warum es wichtig ist: Das Debuggen eines mehrstufigen Agenten ohne Ablaufverfolgung ist eine Mutmaßung

- Strategische Nutzung: Unverzichtbar, wenn Sie ein LangChain-basiertes Produkt versenden

Braintrust

Eine modellunabhängige Bewertungsplattform. Mit Braintrust können Sie Experimente durchführen, Modelle vergleichen und die Leistung im Zeitverlauf verfolgen, indem Sie benutzerdefinierte Scorer und KI-bewertete Bewertungen verwenden.

- Am besten geeignet für: Teams, die Eingabeaufforderungen iterieren und Modelle vergleichen

- Strategische Verwendung: Wenn Sie es mit schnellem Engineering ernst meinen und Ihre Entscheidungen auf Daten stützen möchten

Helicone

Eine Proxy-basierte Observability-Schicht, die mit jeder OpenAI-kompatiblen API funktioniert. Fügen Sie eine Codezeile hinzu und erhalten Sie vollständige Anforderungsprotokollierung, Kostenverfolgung, Caching und Ratenbegrenzung.

- Am besten geeignet für: Schnelle Einrichtung; Funktioniert mit jedem Modell

- Strategische Nutzung: Der einfachste Weg, Einblick in Ihre API-Nutzung und -Kosten zu erhalten, ohne Ihre Architektur zu ändern

Kategorie 5: No-Code- und Low-Code-KI-Builder

Nicht jeder Teil Ihrer KI-Strategie erfordert das Schreiben von Code. Mit diesen Tools können Sie KI-Workflows schneller erstellen und testen.

n8n

Ein Open-Source-Workflow-Automatisierungstool mit wachsender KI-Knotenunterstützung. Verbinden Sie KI-Modelle mit Datenbanken, APIs, Messaging-Plattformen und mehr – mit einem visuellen Workflow-Builder.

- Am besten geeignet für: Automatisierung von Geschäftsprozessen; Integration von KI in bestehende Tools

- Strategische Verwendung: Hervorragend zum Erstellen interner Tools oder Client-Automatisierungen ohne benutzerdefinierten Code

Flowise

Ein visueller Open-Source-LangChain-Builder. Ziehen Sie Ketten, Agenten und Speicherkomponenten per Drag-and-Drop zum Prototypen von KI-Anwendungen, ohne Code schreiben zu müssen.

- Am besten geeignet für: Prototyping; Nicht-Entwickler, die KI-Konzepte verstehen

- Strategische Verwendung: Ideal zum schnellen Testen einer Architektur vor der Implementierung in Code

Dify

Ein ausgefeilterer, produktorientierter KI-App-Builder. Dify unterstützt RAG, Agent-Workflows und Modellverwaltung mit einer übersichtlichen Benutzeroberfläche. Es kann selbst gehostet oder als Cloud-Dienst verwendet werden.

- Am besten geeignet für: Schnelle Entwicklung KI-gestützter interner Tools; Teams ohne umfassende technische Ressourcen

- Strategische Nutzung: Wenn Sie Produkte für nicht technisch versierte Kunden entwickeln, kann Dify Ihre Entwicklungszeit drastisch verkürzen

Kategorie 6: Entwicklerproduktivität und KI-Codierungstools

Ihre eigene Produktivität ist Teil Ihrer KI-Strategie. Mit diesen Tools können Sie schneller erstellen.

GitHub Copilot

Immer noch der am weitesten verbreitete KI-Codierungsassistent. Copilot vervollständigt Code automatisch, erklärt Funktionen, schreibt Tests und integriert sich in VS Code, JetBrains und andere Editoren.

- Preise: 10 $/Monat einzeln; 19 $/Monat für Unternehmen

- Strategischer Einsatz: Wenn Sie keinen KI-Codierungsassistenten verwenden, sind Sie langsamer als Ihre Konkurrenz

Cursor

Ein VS-Code-Fork mit tief integrierter KI. Mit Cursor können Sie mit Ihrer Codebasis chatten, mehrere Dateien bearbeiten und Modelle wie Claude und GPT-4o direkt im Editor verwenden. Viele Entwickler halten es für einen Schritt über Copilot.

- Preise: 20 $/Monat für Pro

- Strategische Nutzung: Wenn Sie es mit der KI-gestützten Entwicklung ernst meinen, ist das Kontextbewusstsein von Cursor ein Produktivitätsmultiplikator

Helfer

Ein Open-Source-Befehlszeilen-Codierungsassistent, der direkt mit Ihrem Git-Repository funktioniert. Aider sendet Diffs an das Modell und wendet Änderungen automatisch an – nützlich für automatisiertes Refactoring und skriptgesteuerte Codeänderungen.

- Am besten geeignet für: Power-Benutzer; automatisiertes groß angelegtes Refactoring; CI/CD-Integration

- Strategische Nutzung:Koppeln Sie mit LLaMA auf Ollama für eine kostengünstige, KI-gestützte Entwicklung

Aufbau Ihrer KI-Strategie: Ein Framework für Entwickler

Bei so vielen verfügbaren Tools stellt sich nicht die Frage: „Welche Tools sind die besten?“ Kurz gesagt: „Welche Kombination dient meinen spezifischen Zielen?“

Hier ist ein praktischer Rahmen:

Schritt 1: Definieren Sie Ihr Ziel

Entwickeln Sie ein Produkt, automatisieren Sie einen Service oder bilden Sie sich weiter? Ihr Ziel bestimmt Ihre Werkzeugauswahl. Ein Freiberufler, der Client-Workflows automatisiert, benötigt andere Tools als ein Entwickler, der ein SaaS-Produkt erstellt.

Schritt 2: Einfach anfangen

Überbauen Sie nicht. Ein einziger OpenAI-API-Aufruf und eine gute Eingabeaufforderung können überraschend viele Probleme lösen. Greifen Sie zu Frameworks und Datenbanken, wenn Ihr Anwendungsfall sie wirklich erfordert.

Schritt 3: Alles messen

Ohne Beobachtbarkeit fliegen Sie im Blindflug. Fügen Sie vom ersten Tag an LangSmith, Helicone oder Braintrust hinzu. Kennen Sie Ihre Token-Kosten, Latenz und Fehlerraten.

Schritt 4: Iterieren Sie Eingabeaufforderungen vor der Architektur

Die meisten KI-Qualitätsprobleme sind sofortige Probleme. Bevor Sie Ihre Architektur umgestalten, investieren Sie in schnelles Engineering. Kleine, zeitnahe Änderungen können die Qualität ohne zusätzliche Kosten verdoppeln.

Schritt 5: Frühzeitig monetarisieren

Zur besten KI-Strategie gehört ein Weg zum Umsatz. Egal, ob Sie Kunden einen KI-Service anbieten, ein produktives Tool entwickeln oder Inhalte rund um Ihr KI-Know-how erstellen – denken Sie bereits in der ersten Woche über die Monetarisierung nach. Auf der Pillar-Seite Wie man mit KI Geld verdient auf learnAI wird dies ausführlich behandelt.

Schritt 6: Bleiben Sie modular

Die KI-Landschaft ändert sich monatlich. Erstellen Sie Ihr System so, dass Sie Modelle und Anbieter austauschen können, ohne Ihre Kernlogik neu schreiben zu müssen. Dies bedeutet, dass Sie Abstraktionen verwenden (wie die Modellschnittstelle von LangChain) und niemals anbieterspezifischen Code fest in Ihre Geschäftslogik codieren.

Vergleichszusammenfassungstabelle

Reale KI-Strategiemuster für Entwickler

Werkzeuge zu verstehen ist eine Sache – zu wissen, wie sie in der Praxis kombiniert werden, eine andere. Hier sind drei Muster, die erfahrene Entwickler regelmäßig verwenden.

Das RAG-Produktmuster

Erstellen Sie eine Wissensdatenbank aus den Dokumenten eines Kunden (PDFs, Wikis, Datenbanken), teilen Sie sie auf und betten Sie sie in einen Vektorspeicher ein (Chroma für Prototyping, Pinecone für die Produktion) und stellen Sie eine Chat-Schnittstelle bereit, die von Claude oder GPT-4o unterstützt wird. Allein dieses Muster ist die Grundlage für Dutzende profitabler KI-Produkte – von Kundensupport-Bots bis hin zu internen Wissensassistenten. Stapel: Claude + Pinecone + LangChain + Vercel AI SDK.

Das Muster der Automation Agency

Verwenden Sie n8n oder Make.com, um KI-Modellaufrufe mit den vorhandenen Tools des Kunden (CRM, E-Mail, Slack, Tabellenkalkulationen) zu verbinden. Der Entwickler schreibt eine einfache Eingabeaufforderungslogik und verbindet die Pipes. Der Kunde erhält automatisierte Arbeitsabläufe; Sie erhalten eine wiederkehrende Vergütung. Dies ist einer der schnellsten Wege zum Umsatz für KI-erfahrene Entwickler. Stack: n8n + OpenAI API + vorhandene Tools des Kunden.

Das KI-erweiterte SaaS-Muster

Nehmen Sie eine bestehende Kategorie von SaaS (Projektmanagement, Schreibtools, CRM) und fügen Sie eine Schicht KI-Intelligenz hinzu, die das Produkt erheblich nützlicher macht. Sie konkurrieren nicht um Funktionen, sondern um Intelligenz. Verwenden Sie Cursor zum schnellen Erstellen, LangGraph für die Agentenlogik und LangSmith zur Überwachung der Qualität. Stapel: Cursor + LangGraph + LangSmith + beliebiges Basismodell.

Häufig gestellte Fragen

Muss ich mich für ein Fundamentmodell entscheiden und dabei bleiben?

Überhaupt nicht. Die meisten ausgereiften KI-Systeme nutzen strategisch mehrere Modelle – ein günstigeres, schnelleres Modell für einfache Aufgaben und ein leistungsfähigeres Modell für komplexe Überlegungen. Durch die Abstraktion Ihrer Modellaufrufe über eine einheitliche Schnittstelle ist die Verwaltung einfacher.

Lohnt es sich, LangChain im Jahr 2026 noch zu lernen?

Ja, aber mit Nuancen. LangChain ist nützlich, um Konzepte zu lernen und schnell aufzubauen. Für Produktionssysteme migrieren viele Entwickler zu schlankeren Implementierungen oder LangGraph zur Agenten-Orchestrierung. Das Verständnis von LangChain hilft Ihnen, das Ökosystem zu verstehen.

Wie halte ich meine KI-API-Kosten unter Kontrolle?

Beobachtbarkeit vom ersten Tag an nutzen (Helicone lässt sich am einfachsten hinzufügen). Identische oder nahezu identische Anfragen zwischenspeichern. Verwenden Sie kleinere, günstigere Modelle für Routineaufgaben und reservieren Sie teure Modelle für wirklich komplexe Überlegungen. Fügen Sie eine Tarifbegrenzung hinzu, um unkontrollierte Kosten zu vermeiden.

Soll ich Modelle selbst hosten oder APIs verwenden?

Für die meisten Entwickler sind verwaltete APIs der richtige Ausgangspunkt – geringerer Betriebsaufwand, keine GPU-Kosten und schnellere Iteration. Selbsthosting ist sinnvoll, wenn Sie ein hohes Volumen haben (um die Kosten pro Anruf zu senken), strenge Datenschutzanforderungen haben oder eine Feinabstimmung bei proprietären Daten benötigen.

Schlussfolgerung

Bei der KI-Strategie für Entwickler geht es nicht darum, die meisten Tools zu haben – es geht darum, die richtigen Tools auszuwählen, sie intelligent zu kombinieren und Dinge bereitzustellen, die echten Mehrwert schaffen. Die Entwickler, die derzeit gewinnen, sind diejenigen, die über das „Experimentieren mit KI“ hinausgegangen sind. in den Aufbau wiederholbarer Systeme und Produkte.

Beginnen Sie mit einem klaren Ziel. Wählen Sie ein Fundamentmodell. Fügen Sie Beobachtbarkeit hinzu, bevor Sie sie benötigen. Bauen Sie modular auf. Und hören Sie nie auf zu lernen – die Landschaft wird sich weiter verändern, aber solide Grundlagen ergeben sich.

Bereit, KI zu lernen? Treten Sie der learnAI-Community bei → learnAI Skool-Community